一月底的时候,公司前沿AI技术探索官付哥发了一条朋友圈:

用了将近6个小时,用玲珑精绘把这张群像油画放大了22倍。22倍的概念,不是简单地用指尖在手机屏幕上拉大图片。而是要放大22倍,依旧保持细节精度,不失真,不变形。

实现40倍精绘放大

春节刚一上班,团队又玩出了新高度,付哥发了个朋友圈,用18个小时,把一张熊猫图片直接放大到原图的40倍!

按道理,此时应有40倍的对比图,但是

按道理,此时应有40倍的对比图,但是 咳咳,言归正传,22倍的对比效果大家已经看见了,40倍的差距更是悬殊。将1低分辨率熊猫图片输入,并映射为52,200×28,672像素的高保真输出,实现超分辨率图像放大,这背后是深度学习架构,以及顶级服务器,二者缺一不可。

咳咳,言归正传,22倍的对比效果大家已经看见了,40倍的差距更是悬殊。将1低分辨率熊猫图片输入,并映射为52,200×28,672像素的高保真输出,实现超分辨率图像放大,这背后是深度学习架构,以及顶级服务器,二者缺一不可。

这次大胆尝试之所以成功,源于玲珑精绘对端到端的训练策略(ETET strategy)的精确运用,优化了特征提取和图像重建的深度流程。通过精细调校的损失函数和反向传播,AI模型在大规模数据集上进行自我调整和超参数优化,以达到信息保真度和视觉感知质量的最佳平衡。传统的双三次插值和最近邻插值方法在图像放大过程中通常会遇到锯齿效应和模糊性等问题。而玲珑精绘采用的图像超分辨率技术则显著减少了这些降质因素,通过细粒度特征学习和自适应激活函数,复原出丰富的图像纹理和清晰的边缘详细信息。这不是一次简单的尺寸跳跃,而是对卷积神经网络(CNN)和生成对抗网络(GAN)等人工智能技术的一次淋漓尽致的展现。精绘=细节高清重绘

这次大胆尝试之所以成功,源于玲珑精绘对端到端的训练策略(ETET strategy)的精确运用,优化了特征提取和图像重建的深度流程。通过精细调校的损失函数和反向传播,AI模型在大规模数据集上进行自我调整和超参数优化,以达到信息保真度和视觉感知质量的最佳平衡。传统的双三次插值和最近邻插值方法在图像放大过程中通常会遇到锯齿效应和模糊性等问题。而玲珑精绘采用的图像超分辨率技术则显著减少了这些降质因素,通过细粒度特征学习和自适应激活函数,复原出丰富的图像纹理和清晰的边缘详细信息。这不是一次简单的尺寸跳跃,而是对卷积神经网络(CNN)和生成对抗网络(GAN)等人工智能技术的一次淋漓尽致的展现。精绘=细节高清重绘玲珑精绘能做到放大40倍依旧清晰,是因为精绘可以将画面中每一个细节进行高清重绘。

但是放大不等于精绘。放大是一个容易被大众接受的词语,不用过多解释。但是精绘,相当于把原图增加更多细节,在细节上做AI重绘,图片“放大”也不失真,因为在放大后的细节有AI在智能填补。

⬆️22倍精绘之后细节

放大后的面部、颜料色彩、阴影高光、笔触质感等等细节皆清晰可见。

算力基座功不可没

玲珑精绘此次取得的显著成果离不开真视通的算力基座。真视通H800服务器以其强大而稳定的性能,与玲珑算法完美匹配,为此次成果的实现提供了坚实保障。

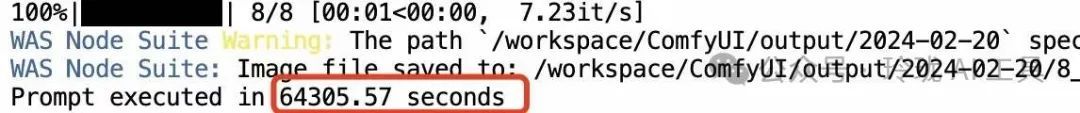

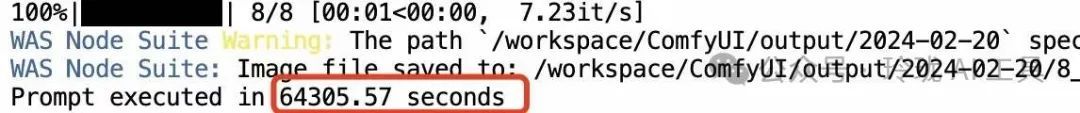

整个处理过程历时18个小时,耗时64305.57秒。长时间的运算充分彰显了算力环境的稳定性,并且通过其强大的并行处理能力,加快了训练周期,实现了复杂计算任务的高效运行。

此外,配合先进的深度学习框架,还有效地降低了计算成本和能耗,同时提高了图像处理管道的吞吐量。

这项成就将从根本上扩展电子视觉系统的应用领域,包括医学诊断影像、卫星遥感、高精度打印和文化遗产数字化。在商用领域,扩展了高清视频播放和虚拟现实的边界。

我们可以预见,会有更多的AI增强型图像处理工具面世,致力于在高效性、可访问性和性能之间找到完美平衡。而玲珑精绘在人工智能领域的应用潜力无疑将会不断拓展,与更多应用场景结合出美丽果实🍒

-END-