近日刷屏的Sora暂时还处于内测状态,想玩也玩不了,其他同行也没闲着,近日Pika联合北大、斯坦福大学推出的文生图SOTA—RPG,将文生图推到了一个新的高度。这RPG非彼RPG,即Recaptioning、Planning and Generating(重述、规划和生成),就是使用多模态大语言模型进行重述、规划和生成来掌握文本到图像的扩散。

这个技术并不是突然冒出来,2023年5月加州大学伯克利分校就已经提出了LMD,即LLM-grounded Diffusion(以大语言模型为基础的扩散)。

论文地址:https://bair.berkeley.edu/blog/2023/05/23/lmd/。

其后来又提出了LMD+,LMD和LMD+通过引入LLM作为前端提示解析器和布局规划器,极大地提高了文本到图像生成模型的提示跟随能力。它以统一的方式提高空间推理、对否定的理解、属性绑定、生成计算能力等,而没有明确针对每一个目标。LMD 完全免训练(即使用现成的 SD 模型)。LMD+ 采用额外的适配器以实现更好的控制。该 LMD+ 模型基于Stable Diffusion v1.4 ,并集成了用GLIGEN训练的适配器。该模型可以直接使用LLMGroundedDiffusionPipeline,这是 LMD+ 的简化管道,无需按框生成。

演示地址:https://huggingface.co/spaces/longlian/llm-grounded-diffusion。

RPG将LMD+的路径推进到更高的层次。它是一种强大的免训练范例,利用专有的 MLLM多模态大预言模型(例如 GPT-4、Gemini-Pro)或开源本地 MLLM(例如 miniGPT-4)作为即时重述器和区域规划器,并与互补区域一起使用。扩散以实现文本到图像的生成和编辑。其框架非常灵活,可以推广到任意 MLLM 架构和扩散主干。

我不介绍它的论文内容,说实话我也看不懂,专业人生请自行查询论文。

论文地址:https://arxiv.org/pdf/2401.11708.pdf

代码地址:https://github.com/YangLing0818/RPG-DiffusionMaster

我们来看看这个文生图SOTA解决了哪些问题,直接上图。

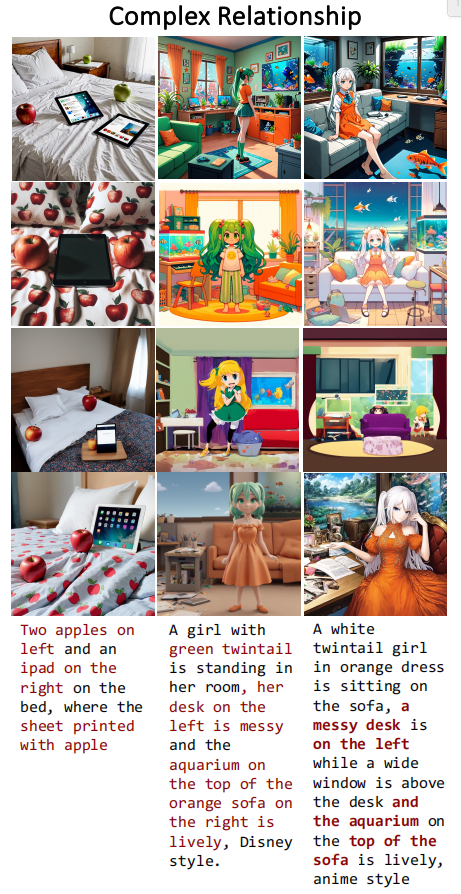

关系复杂的多对象文生图(1024*2048)

prompt:A green twintail girl in orange dress is sitting on the sofa while a messy desk under a big window on the left, a lively aquarium is on the top right of the sofa, realistic style

一个穿着橙色连衣裙的绿色长尾女孩坐在沙发上,左边一扇大窗户下是一张凌乱的桌子,沙发右上角是一个活泼的水族馆,逼真的风格

面对人物的复杂属性和空间描述,模型给出的整个画面的结构、人与物品的关系都完全符合提示词。

而对于同样的提示词,我们来看一下当前最先进的SDXL和DALL·E 3的表现:

DALLE3

SDXL

复杂属性绑定的多人文生图(1024*2048)

Prompt:From left to right, a blonde ponytail Europe girl in white shirt, a brown curly hair African girl in blue shirt printed with a bird, an Asian young man with black short hair in suit are walking in the campus happily.

从左到右,一个穿着白色衬衫、扎着金发马尾辫的欧洲女孩,一个穿着印着小鸟的蓝色衬衫、棕色卷发的非洲女孩,一个穿着西装、黑色短发的亚洲年轻人正开心地在校园里散步。

1024*1024

1024*1024

保持数字精度的文生图(1024*1024)

1024*1024

跟controlnet结合后更精确的文生图

对于我来说看到这些文生图效果的冲击不亚于Sora。从结果来看RPG解决了文生图领域三大难题,一个就是多属性复杂关系的效果控制,二是图片空间上的精确划分,三就是图片对于数字精度的表现。希望大神们尽快实现开源应用,AI画画的再也不用苦逼的一边调整提示词一边等着抽卡了。