尽管量子计算技术距离实际应用阶段尚有一段时日,可科技企业依旧在该项技术上投入了高达数十亿美元的资金。那么,未来的量子计算机究竟会在哪些方面得以应用?又为何诸多专家笃定其将引发颠覆性的变革呢?

构建一台能够驾驭量子力学独特性质的计算机,此构想自20世纪80年代起便一直处于争议之中。不过,在过去的数十年间,科学家们于制造大规模量子设备方面已然取得了颇为显著的进展。当下,从谷歌到IBM等一众科技巨头,连同若干资金充裕的初创公司,均已在这项技术领域投入了巨额资金——并且已经成功研制出了多台量子计算机以及量子处理单元(QPUs)。

从理论层面来讲,量子计算机具备解决那些即便是最为强大的传统计算机也无力应对之难题的能力。不过,业内普遍达成共识,即在实现这一目标之前,此类设备必须在规模和可靠性方面实现大幅提升。但一旦达成这一条件,人们便寄希望于该项技术能够攻克化学、物理、材料科学乃至机器学习等诸多领域内当下无法解决的诸多难题。

加拿大滑铁卢大学量子计算研究所执行所长诺伯特·吕特肯豪斯在接受采访时指出:“它绝非仅仅是一台速度更快的传统计算机,而是一种全然不同的范式。量子计算机能够高效地完成一些传统计算机根本无从下手的任务。”

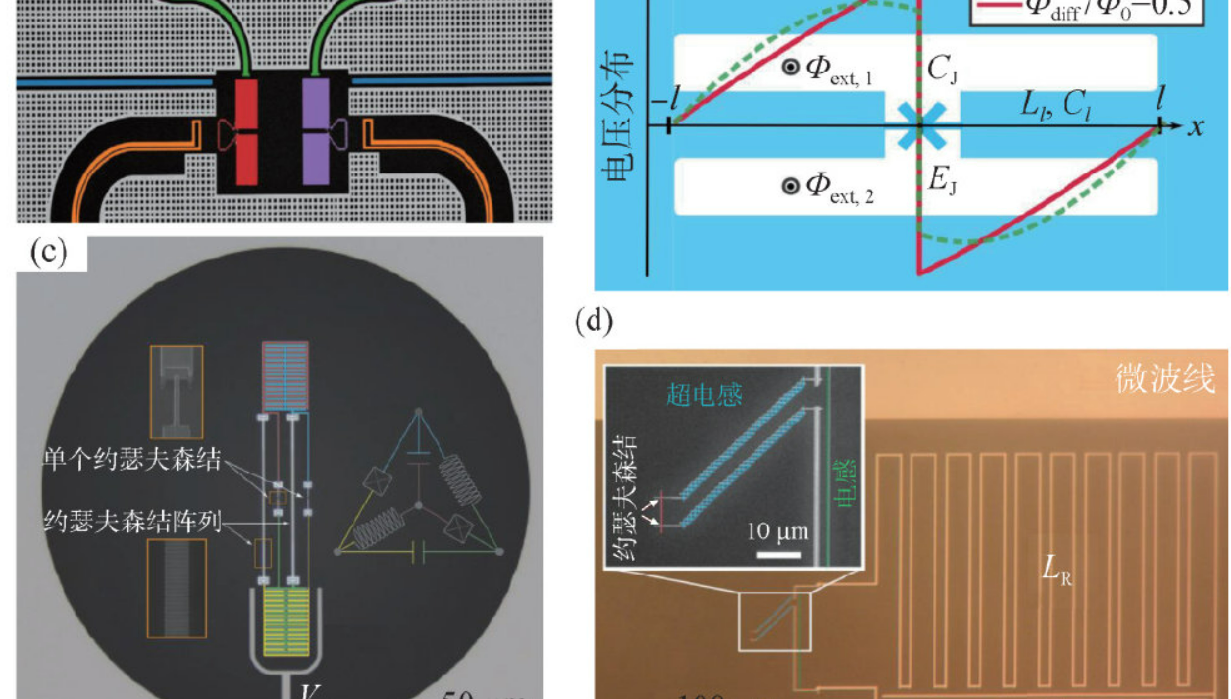

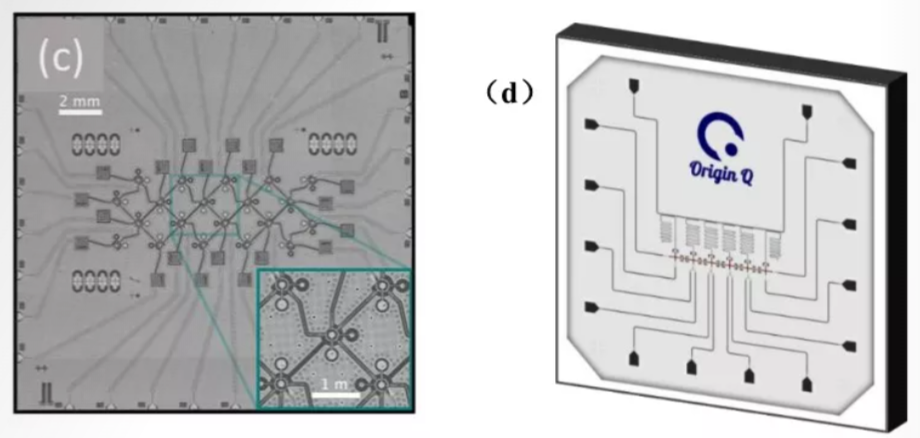

当前的技术状况量子计算机最为根本的构建模块乃是量子比特(qubit)——这是一种量子信息的计量单位,其与传统计算机中的比特存在一定的相似性,不过它却拥有一项极为神奇的特性,即能够同时呈现0和1的复杂组合状态。量子比特能够依托多种不同类型的硬件予以实现,诸如超导电路、被囚禁的离子,甚至是光子(光粒子)等。

至于传统的半导体材料,量子比特通过操纵半导体材料(如硅、锗等)或缺陷材料(如金刚石、氮化铝或碳化硅中的缺陷中心)中的单个电子来模拟量子比特。将微波和磁场应用于这些材料,使其表现出叠加、纠缠和其他量子特性。例如,在半导体量子点中,通过控制量子点中的电子数量和能量状态,可以实现量子比特的构建。这时,就需要半导体加工工艺来制备量子点等结构,并且需要相应的电极和电路来对量子比特进行控制和测量。通常还需要低温环境来减少热噪声对量子比特的影响。

然而,美国麻省理工学院(MIT)量子工程中心主任威廉·奥利弗(William Oliver)表示,这并不意味着当下的量子计算机毫无用处。他在接受“生活科学”采访时谈到:“如今量子计算机的主要用途在于,一是学习如何制造规模更大的量子计算机,二是学习如何运用量子计算机。”

制造规模更大的处理器能够为如何设计出更大、更可靠的量子机器提供极为关键的洞察视角,并且能够为开发与测试新型量子算法搭建起一个平台。它们还能够让研究人员对量子纠错方案展开测试,而这对于充分实现该技术的潜在价值而言至关重要。这些方案通常会涉及将量子信息分散至多个物理量子比特之上,以此来创建一个单一的“逻辑量子比特”,该“逻辑量子比特”具备更强的抗干扰能力。

在这一领域近期所取得的诸多突破表明,容错量子计算或许已并非遥不可及之事。包括QuEra、Quantinuum和谷歌在内的多家公司近期均已成功展示了可靠生成逻辑量子比特的能力。要将量子比特的数量扩展至数千个(倘若不是数百万个的话),从而使其能够解决实际问题,这无疑需要耗费大量的时间以及众多的工程投入。不过,一旦达成这一目标,一系列令人振奋的应用便将呈现在人们眼前。

量子技术有望成为变革推动者的领域

量子计算能力的关键奥秘在于一种被称作叠加态的量子现象。该现象使得一个量子系统在未被测量之前,能够同时处于多种不同的状态。在量子计算机当中,这便使得能够将底层的量子比特设置成一种能够代表某一问题所有潜在解决方案的叠加态。

当我们运行算法时,那些错误的答案将会受到抑制,而正确的答案则会得到强化。如此一来,待到计算结束之时,唯一留存下来的答案便是我们所寻找的那个答案。

这使得解决那些对于传统计算机而言必须按顺序逐一处理,但规模却过于庞大的问题成为可能。并且在某些特定领域,随着问题规模的不断增大,量子计算机进行计算的速度相较于传统计算机而言,有可能会呈现出指数级的提升。

最为明显的应用领域之一在于模拟物理系统,毕竟世界本身便是由量子力学原理所支配的。那些使得量子计算机拥有强大计算能力的奇特现象,同样也导致在传统计算机上以具有实际应用价值的规模来模拟众多量子系统变得极为困难。不过,由于量子计算机是基于相同的原理进行运作的,所以它们理应能够高效地对各式各样的量子系统的行为进行建模。

这极有可能会对化学和材料科学等领域产生极为深远的影响,在这些领域当中,量子效应发挥着至关重要的作用,并且有可能会在从电池技术到超导体、催化剂乃至制药等诸多方面带来突破性的进展。

量子计算机同样也存在一些并非那么令人满意的用途。倘若拥有足够数量的量子比特,数学家彼得·肖尔(Peter Shor)在1994年所发明的一种算法便能够破解支撑当今互联网绝大部分应用的加密技术。幸运的是,研究人员已经研发出了新的加密方案来规避这一风险,并且在今年早些时候,美国国家标准与技术研究院(NIST)已经发布了新的“后量子”加密标准,而且目前该标准已经在实际应用当中。

量子计算新兴的可能性

人们期望这项技术能够在优化方面发挥出应有的作用,所谓优化,即指在众多可能的解决方案当中寻找某个问题的最佳解决方案。从缓解城市交通流量到为物流公司寻找最佳配送路线等诸多实际挑战,均可归结为优化过程。此外,为达成特定的金融目标而构建最佳股票投资组合,这也有可能成为一种潜在的应用。

不过,截至目前,绝大多数的量子优化算法所能够提供的加速效果均未达到指数级。由于量子硬件的运行速度要比目前基于晶体管的电子设备慢得多,所以当这些算法在实际设备上进行实施时,其在速度方面所具备的适度优势很有可能会迅速消失。

与此同时,量子算法的进展也对传统计算的创新起到了一定的刺激作用。当量子算法设计者提出不同的优化方案时,我们计算机科学领域的科学家们也会相应地对其算法进行改进,如此一来,原本似乎所拥有的优势最终便会消失殆尽。

其他一些目前正处于积极研究阶段,但长期潜力尚不明确的领域包括使用量子计算机搜索大型数据库或者进行机器学习,机器学习涉及对大量数据进行分析以发现有用的模式。在这些领域当中,加速效果同样未达到指数级,而且还存在一个额外的问题,即把大量的传统数据转换为算法能够处理的量子状态——这是一个相对缓慢的过程,有可能会迅速抵消掉任何可能存在的计算优势。

但目前尚处于早期阶段,在算法突破方面依旧存在着广阔的空间。我们需要了解如何构建量子算法,识别并利用这些程序元素,发现新的元素(如果存在的话),并了解如何将它们组合起来以生成新的算法。

这应当会对该领域未来的发展起到一定的指导作用,同时也是企业在做出投资决策时应当予以牢记的一点。当我们推动该领域向前发展时,不要过早地将注意力集中在非常具体的问题上。我们仍然需要解决更多的一般性问题,然后才能由此衍生出众多的应用。