在给学员小Z做第二次AI System Design模拟面试时,我抛出了设计RAG(Retrieval-Augmented Generation)系统的题目。他的表现暴露了典型的“学院派”短板:

概念混淆:将Vector DB(向量数据库)与LLM(大语言模型)描述为同步阻塞调用,不理解异步流水线(Async Pipeline)在高并发场景下的必要性。

工程盲区:处理超长文本时,只知道固定长度切片(Fixed-length chunking),对滑动窗口(Sliding Window)或Map-Reduce等高级策略一无所知。

优化缺失:检索模块未考虑Re-rank(重排序)模型,不清楚如何用Cross-Encoder提升召回精度。

那一刻我确信,这位Top 30 CS硕士虽熟知SOTA模型,但距离胜任IBM的AI Engineer职位,还隔着一道MLOps(机器学习运维)的鸿沟。

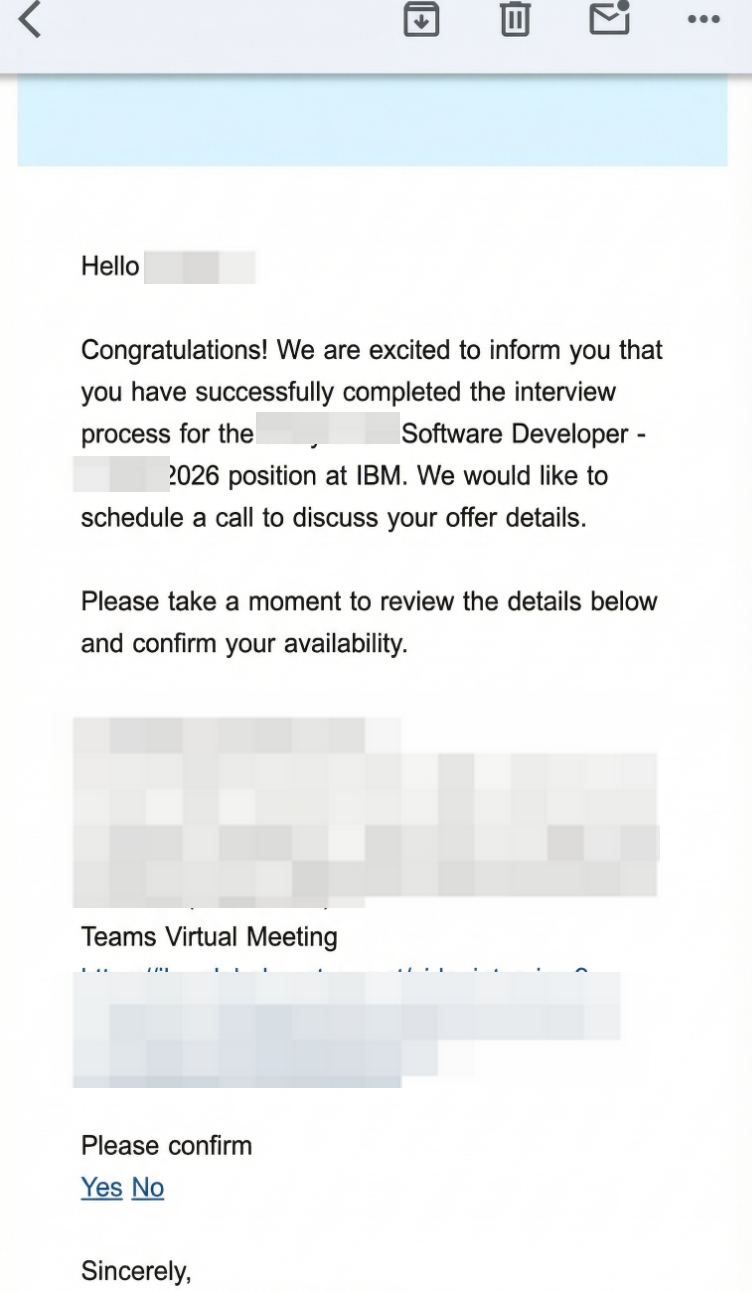

【背景与结果】

背景:Top 30 CS Master

结果:斩获IBM - AI Software Engineer (New Grad)Offer

目标:深入参与企业级AI工程化建设

此前,小Z的简历满是Colab学术Demo,面试一问生产环境并发、GPU调度、API延迟优化就卡壳。他缺的不是模型理论,而是将模型部署上线的全流程工程能力。

【核心突破:以IBM标准为尺,重塑工程能力】

1. 深度重构RAG全链路,夯实技术底座

我们放弃“拿来主义”,对标企业级标准,对RAG每个环节进行定制优化:

数据预处理(Data Ingestion):针对PDF/TXT/HTML文档,用Unstructured库精细化提取元素。设计基于语义连贯性的递归切片策略,结合RecursiveSplitterNodeParser处理嵌套结构,确保Chunk的语义完整性。

Embedding与索引(Vector Indexing):进行基准测试(Benchmark),对比text-embedding-ada-002与bge-large-zh-v1.5等模型在特定中文语料上的召回表现(Recall@K)。选定模型后,利用Faiss库的IVF_FLAT索引,精细调整nlist(聚类中心数)和nprobe(搜索探针数),在检索速度与精度间找到最佳平衡。

混合检索与精排(Hybrid Retrieval & Re-ranking):引入稀疏检索器(BM25)与稠密检索器(Vector Search)的混合检索策略。召回Top 50候选后,用轻量级Cross-Encoder模型(bge-reranker-base)二次精排,将结果缩至Top 3送入LLM,有效抑制“幻觉”(Hallucination)。

2. 端到端工程化落地,打造生产级系统

为证明能力,我们完成了一个完整、可对外服务的项目:

模型服务化(Model Serving):规避第三方API限制,用PyTorch加载INT4量化的开源LLM(如Llama-3-8B-Instruct-GPTQ)。利用vLLM推理引擎替换低效的Transformers,--tensor-parallel-size设为4,实现惊人吞吐量提升。

容器化与编排:后端采用FastAPI框架,设计清晰RESTful API。编写优化Dockerfile,多阶段构建减小镜像体积。通过Docker Compose编排服务,一键启动包含FastAPI、Redis缓存、PostgreSQL(带pgvector)和Nginx网关的生产环境。

可观测性(Observability):接入Prometheus和Grafana,实时监控QPS、P99延迟、Token生成速率及GPU显存/利用率。编写自定义Exporter,捕获RAG各环节耗时,为优化提供数据支撑。

【面试交锋:用工程细节赢得认可】

在IBM终面中,小Z展现出扎实的工程素养:

详解vLLM的Continuous Batching机制与TGI的差异,及如何提升并发效率。

展示Faiss索引参数调整如何将特定查询召回率从65%提升至92%,并现场画出RAG架构图,标明数据流向。

分享Docker中解决CUDA版本冲突和NCCL通信超时的踩坑经历,证明独立排查生产环境问题的能力。

最终,他成功拿下IBM - AI Software Engineer (New Grad)的Offer。这不仅是一次求职胜利,更是从“模型使用者”到“系统工程构建者”的身份蜕变。

【结语】

AI领域的竞争力,常源于“理论认知”与“工程交付”的断层。再前沿的LLM应用,也由具体技术决策堆砌而成。只有亲手构建、部署、监控并优化完整系统,晦涩术语才能内化为解决问题的利刃。

© 蒸汽教育 2026 全球留学生求职标杆企业