当黄仁勋在 GTC2026 大会舞台上再次亮出 "核弹级" 技术,整个科技圈都沸腾了 —— 英伟达不仅掏出了新一代 AI 芯片黑科技,更是直接喊出万亿美元营收目标。这背后,是一场即将重构全球算力格局的革命。

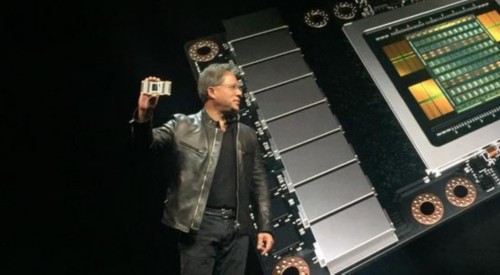

GTC2026 大会现场,黄仁勋手中的新一代 AI 芯片 "GB200 Super" 成了全场焦点。这款被他称为 "AI 算力新基石" 的芯片,在 FP8 精度下的算力直接突破了 1000TOPS,相比上一代产品性能提升超 3 倍,却把功耗控制在了 300W 以内。更让人惊讶的是,它首次实现了芯片间的 "光互联集群",1024 颗芯片组成的超级集群延迟仅为传统架构的 1/10。

这不是简单的性能迭代,而是英伟达对 AI 算力底层逻辑的重构。过去,AI 大模型的训练效率瓶颈一直卡在芯片间的数据传输上,光互联技术相当于给算力集群打通了 "光速高速公路"。按照英伟达的测算,用 GB200 Super 集群训练万亿参数大模型,时间能从原来的 3 个月压缩到 10 天以内,成本直接降低 60%。这一技术不仅能让大模型企业的训练门槛大幅降低,更能支撑起真正的 "通用人工智能" 落地 —— 毕竟只有足够强的算力,才能喂饱需要海量数据训练的多模态大模型。

黄仁勋敢喊出万亿美元营收目标,靠的不只是单颗芯片的性能,而是一套覆盖 "云 - 边 - 端" 的全场景算力生态。在 GTC2026 上,英伟达正式发布了 "AI 算力操作系统"Project Aurora,它能实现从数据中心超级集群到边缘智能设备的算力统一调度。比如,当城市智慧交通系统需要处理突发车流数据时,Aurora 可以自动把云端闲置算力调度到边缘节点,延迟控制在 1 毫秒以内。

更关键的是,英伟达正在把 AI 芯片从 "硬件单品" 变成 "算力服务"。他们推出的 "按需算力池" 服务,让中小企业不用再斥巨资采购芯片,而是像用水电一样按需购买 AI 算力。这一模式直接打破了算力资源的垄断,让更多企业能接入顶级 AI 算力。按照英伟达的规划,到 2030 年,全球 AI 算力服务市场规模将突破 5 万亿美元,而他们要做的就是这个市场的 "水电运营商"—— 这正是万亿美元营收目标的核心支撑。

这场由英伟达掀起的算力革命,正在重塑整个科技行业的规则。在 GTC2026 大会的闭门论坛上,黄仁勋透露,英伟达已经和全球 Top20 的云厂商达成了 "下一代算力集群" 合作,2027 年之前将部署超过 10 万个 GB200 Super 节点。同时,他们还和汽车、医疗、制造业等传统行业巨头合作,把 AI 算力直接嵌入到生产场景中。

比如在汽车领域,英伟达的 DRIVE Thor 芯片已经实现了 "车路云一体化" 算力协同:车辆端负责实时感知,边缘节点负责区域调度,云端负责全局优化,让自动驾驶的决策速度提升了 10 倍。在医疗领域,用 GB200 Super 训练的 AI 病理分析模型,能在 30 秒内完成 1000 张病理切片的分析,准确率比人类医生还高 2%。这些跨行业的落地场景,正在让 AI 算力从实验室走向千行百业,也为英伟达打开了源源不断的营收入口。

黄仁勋在 GTC2026 的结尾演讲中说:"AI 算力的革命,不是让少数人拥有更强大的工具,而是让所有人都能用上 AI 的力量。" 英伟达的万亿美元目标,本质上是押注 AI 算力将像电力一样成为基础设施。当每一个工厂、每一辆汽车、每一台设备都需要 AI 算力支撑时,这场由 GTC2026 开启的革命,终将改变我们的生活。你认为英伟达能实现这个看似疯狂的目标吗?不妨在评论区留下你的看法。