大数据技术,特别是Hadoop、Spark与Flink的框架演进,是过去二十年中信息技术领域最引人注目的发展之一。这些技术不仅改变了数据处理的方式,而且还推动了对数据驱动决策和智能化的需求。在大数据处理领域,选择合适的大数据平台是确保数据处理效率和性能的关键。本文将深入比较Hadoop、Spark与Flink框架的优缺点,并为读者提供在不同场景下的选择建议。

Hadoop

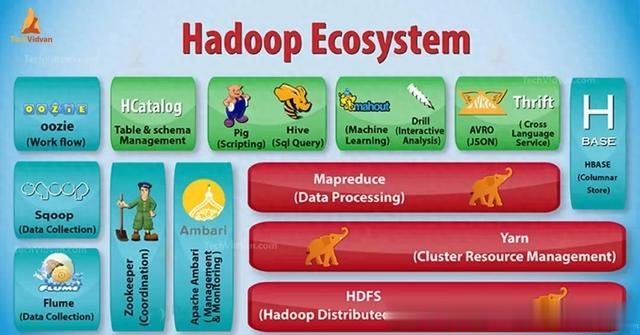

Hadoop最初由Doug Cutting在2004年受MapReduce编程模型启发而开发,其名字来源于他儿子的玩具大象。Hadoop的演进主要围绕其三大核心组件:HDFS(Hadoop Distributed File System)、MapReduce和YARN(Yet Another Resource Negotiator)进行。●Hadoop MapReduce:Hadoop版本的MapReduce编程模型,可以处理海量数据,主要面向批处理。●HDFS:HDFS全称为Hadoop Distributed File System,是Hadoop提供的分布式文件系统,有很好的扩展性和容错性。●YARN:YARN是Yet Another Resource Negotiator的缩写,是Hadoop生态系统中的资源调度器,可以管理一个Hadoop集群,并为各种类型的大数据任务分配计算资源。这三大组件中,数据存储在HDFS上,由MapReduce负责计算,YARN负责集群的资源管理。除了三大核心组件,Hadoop生态圈还有很多其他著名的组件:●Hive:借助Hive,用户可以编写SQL语句来查询HDFS上的结构化数据,SQL会被转化成MapReduce执行。●HBase:HDFS上的数据量非常庞大,但访问和查询速度比较慢,HBase可以提供给用户毫秒级的实时查询服务,是一个基于HDFS的分布式数据库。●Storm:Strom是一款实时计算框架,主要负责流处理。●Zookeeper:Hadoop生态圈很多组件使用动物来命名,形成了一个大型动物园,Zookeeper是这个动物园的管理者,主要负责分布式环境的协调。

1. Hadoop的优点稳定性高:Hadoop经过长时间验证,稳定性较高。适用于批处理: 在大规模批处理场景下表现出色。成熟的生态系统: 生态系统庞大,有丰富的工具和支持。2. Hadoop的缺点实时性差: 不适合处理对实时性要求较高的场景。编程模型相对复杂: 使用MapReduce需要编写大量代码。3.Hadoop的适用场景适用于需要稳定批处理的大规模数据处理场景,如离线数据分析。

Spark

Spark于2009年诞生于加州大学伯克利分校,2013年被捐献给Apache基金会。Spark是一款大数据计算框架,其初衷是改良Hadoop MapReduce的编程模型和执行速度。与Hadoop相比,Spark的改进主要有两点:● 易用性:比起MPI,MapReduce模型更友好,但仍然不够方便,因为并不是所有计算任务都可以简单拆分成map和reduce,有可能为了解决一个问题,要设计多个MapReduce任务,任务之间相互依赖,整个程序非常复杂,导致代码的可读性差。Spark提供更加方便易用的接口,提供Java、Scala、Python和R几种语言的API,支持SQL、机器学习和图计算,覆盖了绝大多数大数据计算的场景。● 速度快:Hadoop的map和reduce之间的中间结果都需要落地到磁盘上,而Spark尽量将大部分计算放在内存中,加上Spark的有向无环图优化,在官方的基准测试中,Spark比Hadoop快一百倍以上。

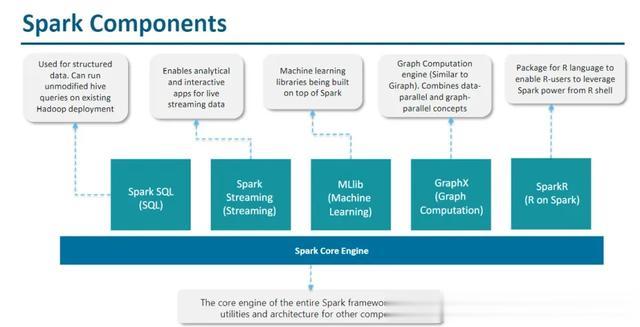

Spark的核心在于计算,主要目的在于优化Hadoop MapReduce计算部分,在计算层面提供更细致的服务,比如提供了常用几种数据科学语言的API,提供了SQL、机器学习和图计算支持,这些服务都是最终面向计算的。Spark并不能完全取代Hadoop,实际上,Spark融入到了Hadoop生态圈,成为其中的重要一元。一个Spark任务很可能依赖HDFS上的数据,向YARN来申请计算资源,将HBase作为输出结果的目的地。当然,Spark也可以不用依赖这些Hadoop组件,独立地完成计算。

Spark主要面向批处理需求,因其优异的性能和易用的接口,Spark已经是批处理界绝对的王者。Spark Streaming提供了流处理的功能,它的流处理主要基于mini-batch的思想,即将输入数据流拆分成多个批次,每个批次使用批处理的方式进行计算。因此,Spark是一款批量和流式于一体的计算框架。1.Spark的优点高性能:Spark的内存计算模型使其在迭代算法和交互式查询中表现出色。多模块支持: 支持批处理、流处理、机器学习等多个模块。易用性: 相对于Hadoop的MapReduce,Spark的API更为友好。2.Spark的缺点对内存要求较高: 需要足够的内存来发挥其性能优势。相对年轻: 相对于Hadoop,Spark相对年轻,生态系统相对较小。3.Spark的适用场景适用于需要高性能批处理、交互式查询以及流处理的场景,如数据仓库和实时数据处理。

Flink

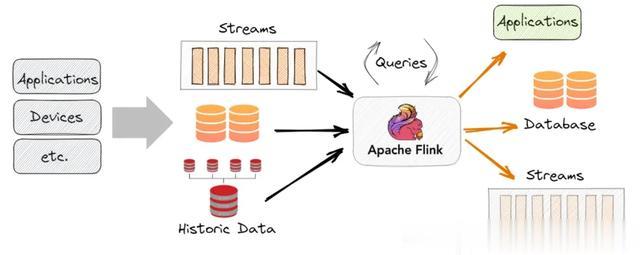

Flink是由德国几所大学发起的的学术项目,后来不断发展壮大,并于2014年末成为Apache顶级项目。Flink主要面向流处理,如果说Spark是批处理界的王者,那么Flink就是流处理领域的冉冉升起的新星。在Flink之前,不乏流式处理引擎,比较著名的有Storm、Spark Streaming,但某些特性远不如Flink。

第一代被广泛采用的流处理框架是Strom。在多项基准测试中,Storm的数据吞吐量和延迟都远逊于Flink。Storm只支持"at least once"和"at most once",即数据流里的事件投递只能保证至少一次或至多一次,不能保证只有一次。对于很多对数据准确性要求较高的应用,Storm有一定劣势。第二代非常流行的流处理框架是Spark Streaming。Spark Streaming使用mini-batch的思想,每次处理一小批数据,一小批数据包含多个事件,以接近实时处理的效果。因为它每次计算一小批数据,因此总有一些延迟。但Spark Streaming的优势是拥有Spark这个靠山,用户从Spark迁移到Spark Streaming的成本较低,因此能给用户提供一个批量和流式于一体的计算框架。Flink是与上述两代框架都不太一样的新一代计算框架,它是一个支持在有界和无界数据流上做有状态计算的大数据引擎。它以事件为单位,并且支持SQL、State、WaterMark等特性。它支持"exactly once",即事件投递保证只有一次,不多也不少,这样数据的准确性能得到提升。比起Storm,它的吞吐量更高,延迟更低,准确性能得到保障;比起Spark Streaming,它以事件为单位,达到真正意义上的实时计算,且所需计算资源相对更少。数据都是以流的形式产生的,数据可以分为有界(bounded)和无界(unbounded),批量处理其实就是一个有界的数据流,是流处理的一个特例。Flink基于这种思想,逐步发展成一个可支持流式和批量处理的大数据框架。经过几年的发展,Flink的API已经非常完善,可以支持Java、Scala和Python,并且支持SQL。Flink的Scala版API与Spark非常相似,有Spark经验的程序员可以用一个小时的时间熟悉Flink API。与Spark类似,Flink目前主要面向计算,并且可以与Hadoop生态高度集成。

1.Flink的优点流处理优势: 在流处理场景中表现出色,支持低延迟的数据处理。支持事件时间处理: 对于事件时间处理有较好的支持,适合实时分析。状态管理:Flink内置了强大的状态管理机制,便于处理有状态的计算。2.Flink的缺点相对较小的生态系统: 相对于Spark,Flink的生态系统相对较小。学习曲线较陡峭: 对于初学者,学习Flink可能相对较为复杂。3.Flink的适用场景适用于对实时性要求较高,需要流处理能力的场景,如实时数据分析和监控。

如何选择?

1.根据数据处理类型批处理: Hadoop适用于稳定的大规模批处理。交互式查询、流处理: Spark提供了全面的解决方案。实时流处理: Flink在实时性要求较高的场景中表现优越。2.根据学习曲线初学者: 对于初学者,Spark的API相对友好。经验丰富者:需要根据项目需求和个人经验权衡。3.根据性能需求对实时性要求不高: Hadoop可能是一个稳定的选择。高性能批处理: Spark在这方面有着卓越表现。实时流处理: Flink在这方面具有优势。在选择大数据平台时,需根据项目需求、性能要求以及开发团队经验进行权衡。Hadoop、Spark和Flink各有优劣,选择适合自己项目的平台是提高大数据处理效率和性能的关键。希望本文能为读者提供对这三个主流大数据处理框架的深入了解,帮助做出明智的选择。

FineDataLink是一款低代码/高时效的数据集成平台,它不仅提供了数据清理和数据分析的功能,还能够将清理后的数据快速应用到其他应用程序中。FineDataLink的功能非常强大,可以轻松地连接多种数据源,包括数据库、文件、云存储等,而且支持大数据量。此外,FineDataLink还支持高级数据处理功能,例如数据转换、数据过滤、数据重构、数据集合等。使用FineDataLink可以显著提高团队协作效率,减少数据连接和输出的繁琐步骤,使整个数据处理流程更加高效和便捷。