想象这样一个场景:早高峰的高架桥上,你开启了爱车的“高阶智能驾驶”。你正悠闲地喝着咖啡,车子平稳地跟车、变道。突然,前方一辆静止的清扫车出现,系统没有识别到,警报声狂响,0.5秒后,砰——追尾了。

交警来了,保险来了。你指着行车记录仪大喊:“是车自己撞的!系统根本没减速!” 车企的技术人员调出后台数据,冷冷地说:“系统在碰撞前0.5秒已经发出了接管提示,是驾驶员未能及时接管。责任在人。”

傻眼了吧?这就是2026年汽车圈最魔幻、也最致命的灰色地带:人机共驾时代的“甩锅”悖论。

今天,我们就来扒一扒这层科技滤镜,看看当冰冷的代码撞上复杂的伦理,这笔账到底该怎么算。

一、 薛定谔的“自动驾驶”:买车时是上帝,出事后是司机要理清责任,我们首先得撕开营销术语的包装。现在的车企在卖车时,恨不得把“自动”、“全托管”、“无人”这些词贴满全车;但在厚厚的车主手册里,却用最小的字号写着:“本系统仅为辅助驾驶,驾驶员需随时准备接管。”

目前的智驾技术,正卡在一个非常尴尬的“过渡期”(L2+ 到 L3 级别之间)。

L2级(辅助驾驶): 机器是辅助,你是绝对的主力。出了事,100%是你的锅。L3级(有条件自动驾驶): 机器主导,但在特定情况下会要求你接管。L4级及以上(高度/完全自动驾驶): 把方向盘扔进后备箱,出了事车企全责。

当下绝大多数所谓的“高阶智驾”都处于L2向L3疯狂试探的边缘。这就导致了一个极度危险的心理陷阱:车辆平稳运行的99%的时间里,它都在疯狂暗示你“我很靠谱,你玩手机吧”;但在那1%可能车毁人亡的瞬间,它却要求你拥有F1赛车手的反应速度来接盘。

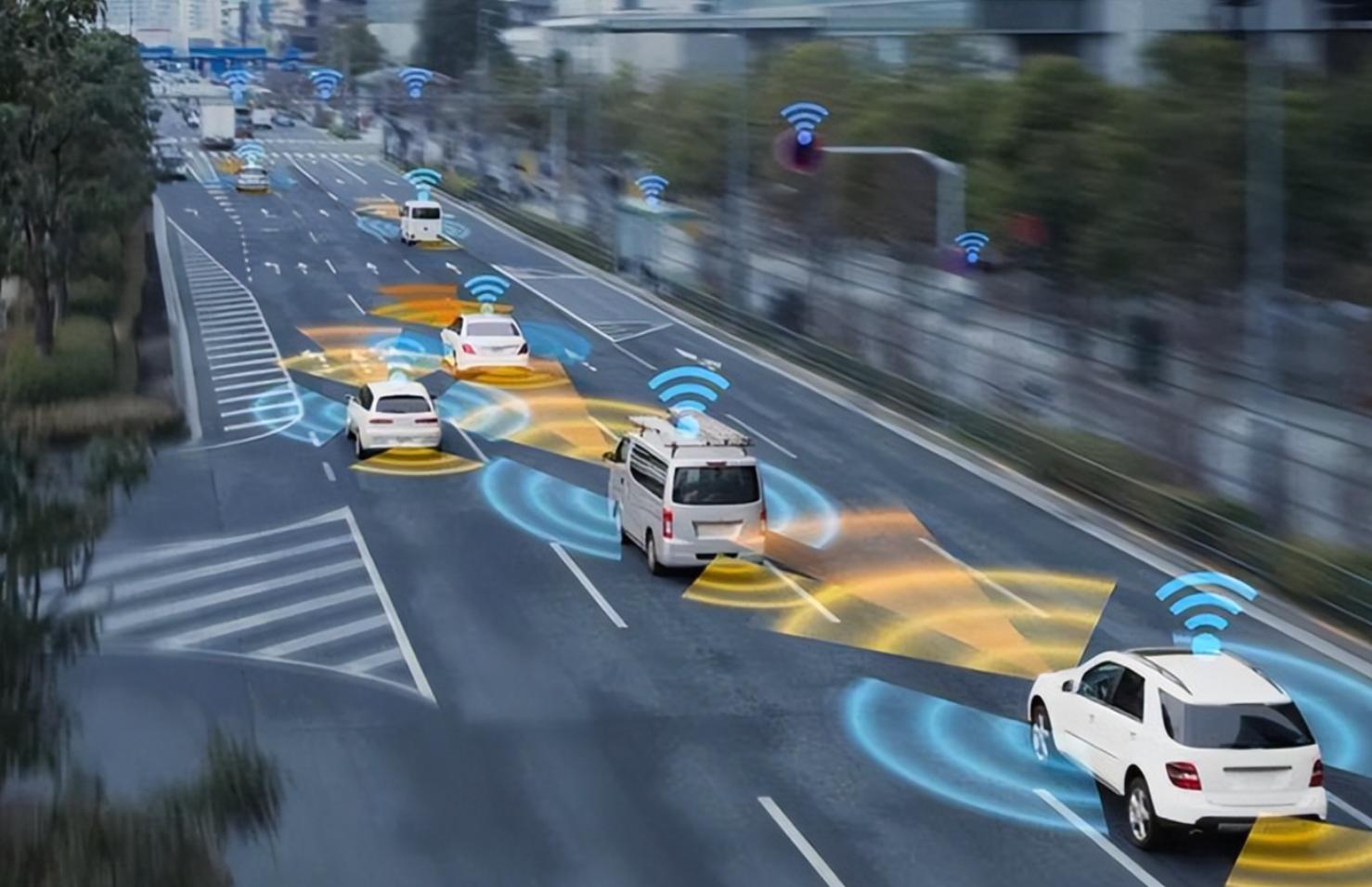

二、 惊魂0.1秒:AI智能体的“甩锅”机制我们可以把现在的智能驾驶系统看作是一个初级阶段的**“AI智能体”**。就像我们在工业或城市系统中部署的AI大脑一样,它平时帮你管管水流、测测压力、调调方向盘,运行得极其平稳丝滑。

但在复杂的开放道路上,一旦遇到超出算法认知边界的“极端长尾场景”(比如横穿马路的异形车、反光的广告牌),这个AI智能体就会瞬间宕机。它处理不了这种“洪峰”,于是直接退出系统,把控制权甩给人类。

从伦理角度看,这简直是耍流氓:机器享受了巡航时的岁月静好,却让人类来承担系统崩溃时的致命风险。 当系统发出刺耳的“请立即接管”警报时,留给人类的反应时间往往不到1秒。在这个时间窗口内,人类需要完成“放下手机/咖啡 - 观察路况 - 理解危局 - 做出躲闪动作”等一系列复杂操作,这在生理学上几乎是不可能完成的任务。

所以,出了事算谁的?如果完全按现行法律,方向盘在谁手里就是谁的责任。但从科技伦理和消费者权益(B2C视角)来看,这显然是在欺负老实人。

三、 B端的终极拷问:保“人”,还是保“算法”?当C端消费者还在为“谁该赔钱”吵得不可开交时,B端(车企、保险公司、供应链)其实已经嗅到了行业剧变的血腥味。

“人机共驾”的责任划分,正在倒逼整个汽车后市场的商业模式重构。过去一百年,汽车保险保的是“人”(驾驶员的驾驶技术和习惯)。但在未来,汽车保险保的将是**“算法”**。

黑匣子博弈: 事故发生后,车企拥有全部的底层数据解释权。为了防止车企“既当裁判又当运动员”,行业急需第三方的“算法定责机构”和强制性的数据开源标准。新型保险产品诞生: 传统的车险将逐渐演变为“产品责任险”+“网络安全险”的组合体。未来的保险公司在承保前,可能不是看你的驾龄,而是要对这台车的“感知模型”和“大语言模型”进行风险评估。 四、 破局之道:科技的傲慢,需要法律来打底

四、 破局之道:科技的傲慢,需要法律来打底科技的进步不能以牺牲普通人的生命和财产安全为代价去“试错”。要解决“人机共驾”的责任泥潭,不能仅仅依靠车企的道德自觉,必须三管齐下:

营销必须克制: 严厉打击夸大宣传,辅助驾驶就是辅助,谁敢乱用“自动”二字,直接重罚。“黑匣子”强制化与透明化: 出台强制标准,所有智驾数据必须实时上传至国家/第三方监管平台,杜绝车企篡改数据“自证清白”。确立“接管静默期”免责条款: 如果系统在碰撞前几秒内才提示接管,人类驾驶员根本无法反应,那么这部分责任必须由系统(即车企)承担。 结语

结语从马车到汽车,人类用了一百年去适应内燃机;从人类驾驶到AI驾驶,我们或许只需要十年。在这个痛苦又迷人的转型期,“人机共驾”绝不是为了让人类驾驶员变成随时准备背锅的“免费安全员”。

技术可以灰度测试,但生命没有B测版本。当科技的狂飙撞上伦理的红线,明确的法律和清晰的责任界限,才是这辆时代快车最可靠的刹车。