提到AI基础设施,绝大多数人第一反应都是:选哪个大模型?是Anthropic、OpenAI,还是主流开源模型?

但行业顶层玩家早已看清真相:当下AI基建最核心的问题,从来不是选模型,而是如何搭建配套基础设施,让模型真正能用、好用。

Anthropic、OpenAI、CrewAI、LangChain这些行业巨头,不约而同把这套支撑体系叫做智能体调度层,它囊括了流程编排、工具调用、记忆存储、上下文管理、异常处理等核心能力。

行业早已达成共识:大模型从来不是产品,基础设施才是。可对于这套调度层该怎么做,各家吵翻了天!

轻量vs厚重?AI智能体调度层路线之争各大厂商的思路,形成了一条完全对立的技术谱系:

✅ Anthropic:极致轻量

全程极简循环,拼接提示词→调用模型→执行工具→反复运行,把所有决策权全部交给模型,调度层只做基础承接。

✅ OpenAI:结构化约束

加码指令栈、专属编排模式、标准化任务交接,给模型加上明确的运行规则。

✅ CrewAI:混合模式

确定性流程负责路由校验,自主智能体处理其余业务,兼顾稳定与灵活。

✅ LangGraph:全量厚重

把所有决策、流程流转全部编码固化,调度层包揽一切,模型只负责执行核心计算。

说白了,这场争论就是:到底该多信任模型?是少编码逻辑,还是把规则写死?

但所有人都陷入了一个误区,从未有人质疑:智能体调度层,天生就该和传统后端割裂吗?

致命痛点!AI智能体落地的绕不开的坑

现在的AI智能体架构,完全是“两层皮”:

调度层管智能体运行、工具、记忆;传统后端管队列、状态、接口、监控,二者完全独立,靠HTTP请求勉强连接。

这就导致了一系列无解问题:

❌ 调试难到崩溃:系统出错只能跨平台翻日志、拼链路,智能体的随机性让故障排查难上加难;

❌ 复杂度指数爆炸:1个智能体+5个后端服务,有5条故障链路;4个智能体直接飙升到80条,完全没法管控;

❌ 适配性极差:随机化的大模型,强行跑在确定性的传统后端里,架构天生水土不服。

我们一直都做错了!想要AI智能体真正落地,必须先重构“后端”的定义。

颠覆认知!后端本质只有3个核心跳出固有思维,从底层拆解会发现,传统后端没那么复杂,归根结底就三大要素:

工作节点:负责调度所有任务;触发器:触发服务运行的开关(接口、定时、队列、状态变更都算);函数:真正执行业务逻辑的最小单元。

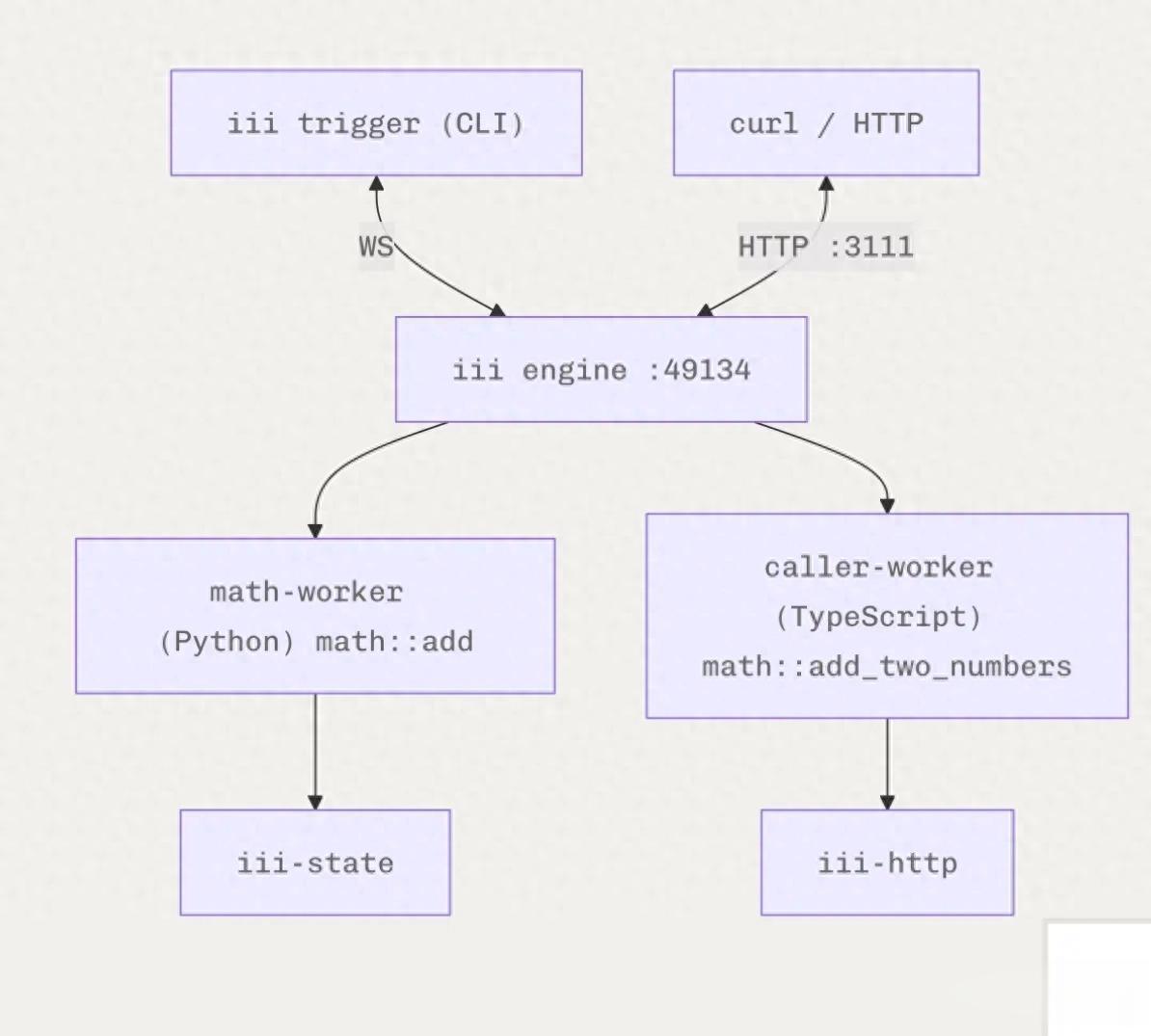

工作节点:负责调度所有任务;触发器:触发服务运行的开关(接口、定时、队列、状态变更都算);函数:真正执行业务逻辑的最小单元。基于这个颠覆性的抽象逻辑,全新的AI基建框架iii应运而生,直接终结行业争论!

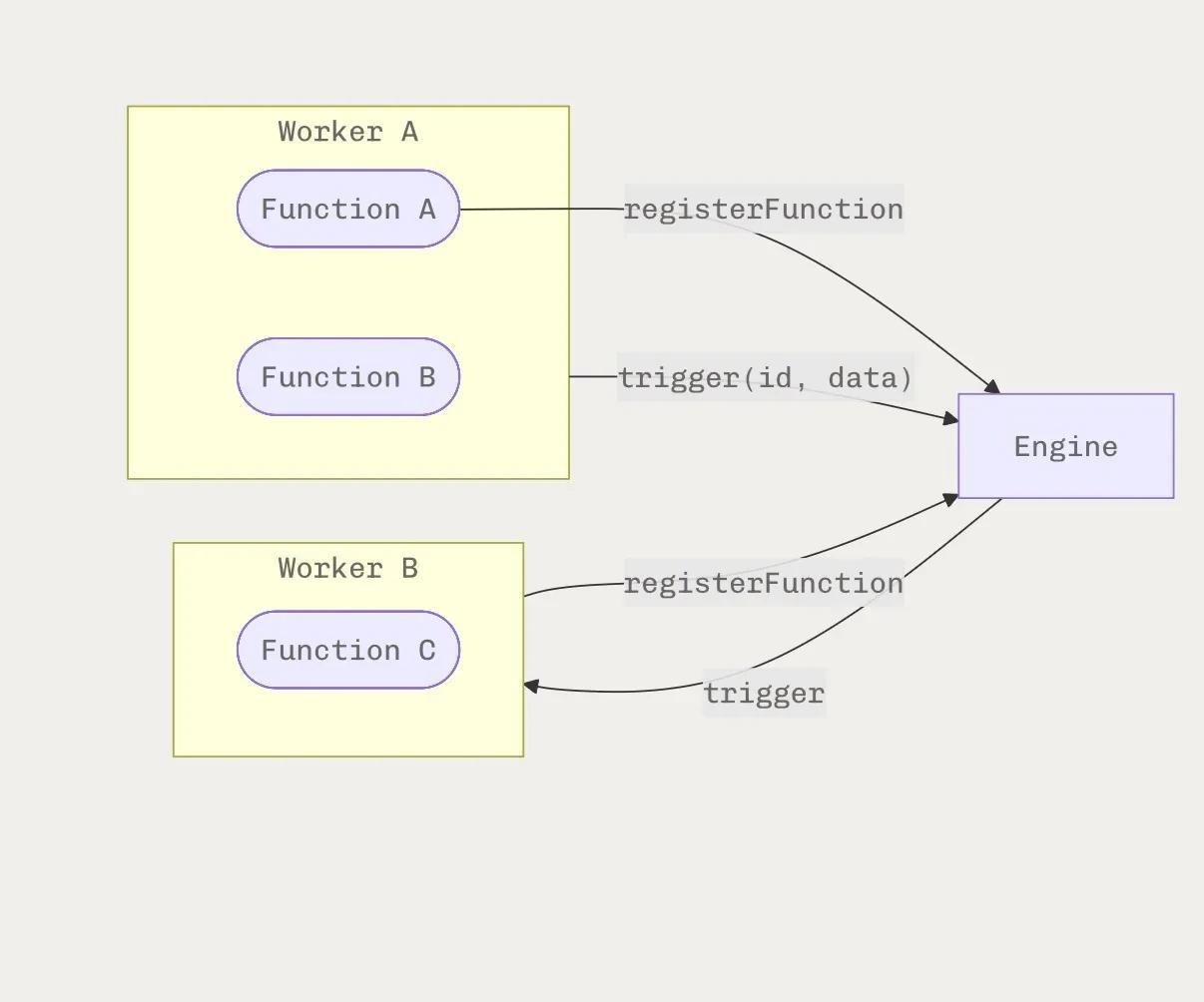

彻底重构!智能体就是后端的一部分iii的核心理念简单到极致:万物皆为工作节点。

不管是TypeScript服务、Python算法、Rust微服务,还是AI智能体,全都是平等的工作节点,没有任何区别!

智能体不再需要单独对接后端,不用额外搭建调度层,直接接入系统,用同一套规则运行:

智能体的工具=系统函数;智能体的记忆=全局状态;智能体的编排=触发器组合。没有专属的智能体基建,因为调度层本身就是后端!

三大革命性能力,传统架构根本比不了

1. 实时发现:智能体实时掌握全网能力,永远不会出现上下文过期;

2. 无感拓展:运行中随时加功能、加节点,不用重启、不用改配置,不影响业务;

3. 全链路追踪:跨语言、跨服务、跨智能体,一条trace查到底,调试效率直接拉满。

更炸裂的是,AI智能体还能自主创建硬件隔离的沙箱节点,用完即销毁,基础设施彻底变成可灵活调用的设计模式,不再是固定产品。

写在最后行业还在纠结“给模型包多少层调度”,却没发现一开始的方向就错了。

真正的AI基础设施,从来不是模型+独立调度层,而是打破所有边界,让智能体、后端、前端、边缘设备全部融入同一套体系。

选对底层逻辑,远比纠结模型选型更重要。当复杂度彻底简化,AI智能体才会真正走进规模化落地的时代。

iii已经开源,AI基建的范式革命,才刚刚开始!