特斯拉在自动驾驶数据上对监管机构的拖延,究竟是“交不出来”,还是“不想现在交”?

最近,美国国家公路交通安全管理局(NHTSA)对特斯拉“完全自动驾驶”(FSD)软件涉嫌违反交通规则的调查,正在演变成一场关于数据、透明度和企业责任的拉锯战。

NHTSA在2025年10月启动调查,起因是58起与FSD相关的事故,包括闯红灯和驶入对向车道。到了12月,相关事故案例已增至80起。监管机构要求特斯拉在2026年1月19日前,提交包括视频、事件数据记录器(EDR)和CAN总线文件在内的关键数据。

然后,特斯拉没能按时提交。

特斯拉在截止日期前一周表示,有8313份记录需要人工审查,每天只能处理约300份,同时应付多个调查“负担过重”。NHTSA给了五周延期到2月23日,并暗示这是“最后的通融”。

结果前几天,特斯拉再次申请延期,理由是涉及核心事故数据的具体文件数量,要等事件清单最终确定后才能统计,然后才能开始查询和格式化。NHTSA再次批准,将关键数据的最后期限推到了3月9日。

这场本来严肃的安全调查,为何一而再,再而三地拖延?

是不能,还是不想?特斯拉给出的理由放在其他公司身上,可能说得过去,数据量太大,人手不够,流程复杂。

但它可是特斯拉啊,作为一家拥有数百万辆汽车在路上行驶、号称收集了超过80亿英里FSD行驶数据的公司,面对区区80起事故的数据调取,结果遇到了“技术问题”,这不是在打自己的脸吗?

按理说,特斯拉的核心竞争力是软件和数据处理。它的神经网络模型每天都在处理来自全球车队的EB级数据。

所以,针对特定事件(如事故)建立高效、自动化的数据提取和分析流程,应该是其最基本的数据工程能力之一。如果连80个已知事故的关联数据都无法在几个月内有效整理出来,那只有两种可能:

要么,公司内部的数据治理和合规工具链极度落后。 这意味着,尽管特斯拉擅长收集和利用数据来“训练”AI,却不擅长为了“监管”和“溯源”而管理数据。

要么,这是一个故意的策略性选择。 特斯拉并非“不能”,而是选择将有限的工程资源投入到更能产生商业价值的地方,或者,故意打时间差,而不是优先满足监管机构的合规需求。

我认为,第二个可能性更大。

因为就在NHTSA等待数据的同时,特斯拉正在德州奥斯汀紧锣密鼓地推进其无人驾驶出租车(Robotaxi)服务。

而Robotaxi使用的,正是被NHTSA调查的同一套FSD软件。这给人的感觉就很微妙了。

特斯拉FSD:在L2和L4之间反复横跳特斯拉在最近一份提交给加州公共事业委员会(CPUC)的文件中,展现出了对FSD的矛盾说辞。

一方面,特斯拉主张,所谓的“Robotaxi”服务本质上仍是SAE Level 2级别的辅助驾驶系统。它承认,在奥斯汀和湾区的服务,不仅每辆车里都有一名持证的人类驾驶员,还配备了位于美国本土的远程操作员团队作为后备。特斯拉甚至引用2025年12月旧金山大停电事件,称Waymo的真无人车队因无法处理大量请求而瘫痪,而自己的车队因为有“人”在驾驶,所以“不受影响”。

这相当于公开承认:“Robotaxi”不是真正的无人驾驶,它的优势恰恰在于它“有人”。

但另一方面,在同一份文件中,特斯拉强烈反对Waymo提出的“禁止L2级别服务使用‘无人驾驶’、‘自动驾驶’或‘Robotaxi’等营销术语”的提议。逻辑是,现有的广告法足以应对虚假宣传,无需额外规定。

特斯拉给人的感觉是:在监管和法律责任上,我希望你把我当成一个需要人类监督的L2系统;但在市场营销和用户心智上,我希望你把我当成一个可以实现“无人驾驶”的Robotaxi。

这样,就能享受到两头的好处:既能以L2的身份规避更严格的AV(自动驾驶汽车)法规和数据报告要求,又能用L4的概念来吸引消费者、支撑高昂的股价和FSD订阅费。

如果FSD因大量违规行为而被强制召回或功能受限,其“Robotaxi”的故事就讲不下去了。

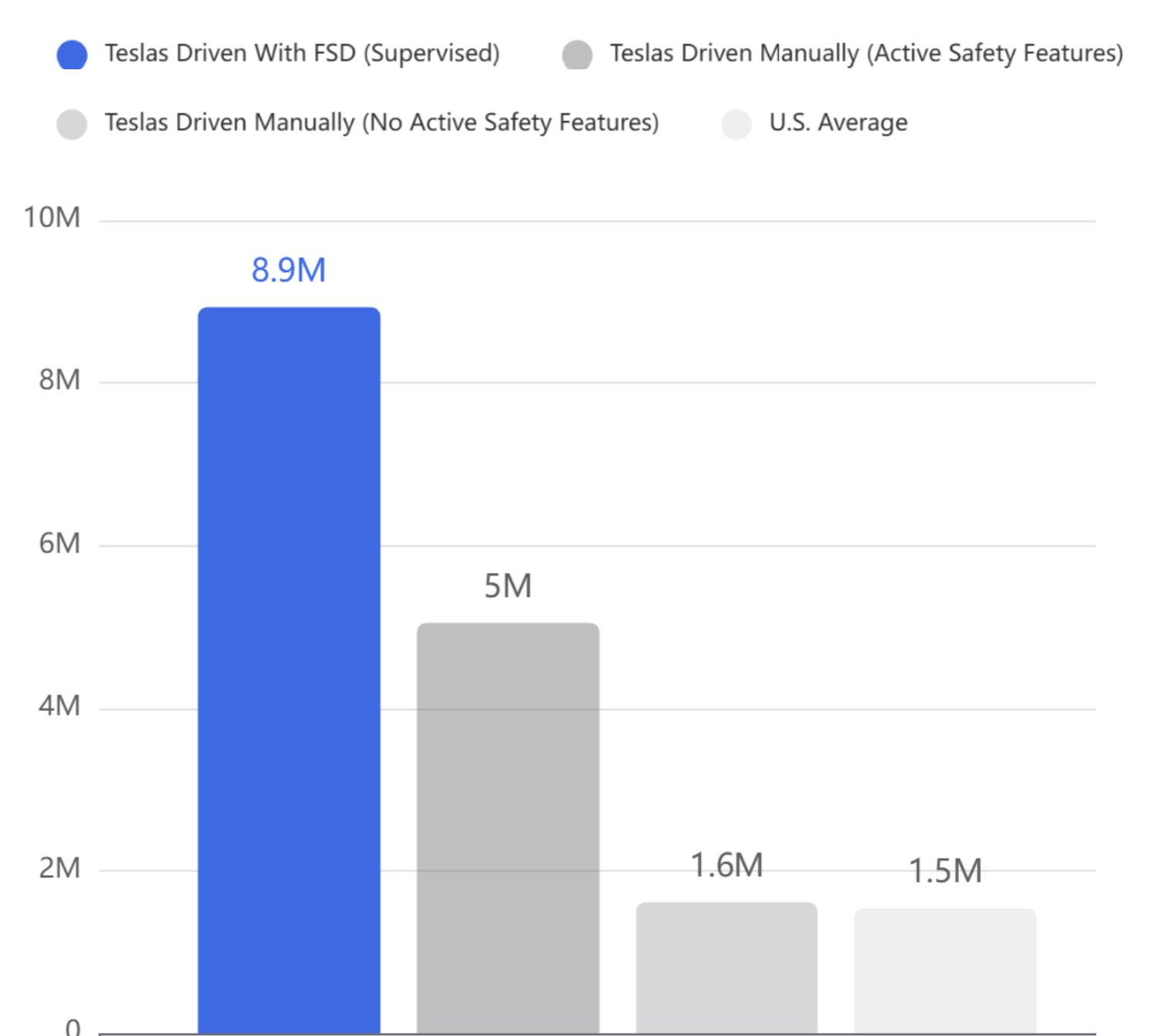

“7倍安全”的数据幻想为了支撑其技术领先的形象,特斯拉发布了详尽的车辆安全报告,声称使用FSD(Supervised)的车辆,发生重大碰撞前的行驶里程是人类驾驶员平均水平的7倍。

这个数字听起来非常惊人,但只要稍加分析,就会发现其中充满了“统计陷阱”。卡内基梅隆大学教授Phil Koopman的指出了其中至少存在三重数据陷阱。

首先,比较基线不公。特斯拉将搭载最新安全技术的新款特斯拉,与美国道路上平均车龄超过12年的旧车进行比较。这本身就是一场不公平的比赛。正确的比较对象,应该是同样装配了主动安全功能的新车,或者更直接的,是同一辆特斯拉开启FSD和关闭FSD时的表现。

其次,存在系统性数据偏差。特斯拉对“碰撞”的定义依赖于安全气囊弹开等指标,排除了许多未触发气囊但车辆已严重受损(例如需要拖车)的事故,而人类驾驶员的统计数据则包含了这些情况。

最后,“轻松里程”偏见。FSD用户更倾向于在路况良好、FSD能轻松应对的“简单”路段(如高速公路)开启功能。而在光线不佳、路况复杂等高风险场景下,系统可能会自动退出或驾驶员选择不使用。这相当于FSD只跑了赛道上最容易的部分,却宣称自己比跑完整赛道的选手成绩更好。

特斯拉的这份安全报告,展现了用数据讲故事的高超能力,同时也反向印证了,为何它不愿意将未经“修饰”的原始数据轻易交给NHTSA。因为未经筛选的数据,有可能会得到不同的结论。

Waymo:透明度是最终的护城河与特斯拉形成鲜明对比的,是Waymo。Waymo目前每周在六个城市完成45万次完全无人的驾驶服务。它的车辆里没有安全员,只有乘客。面对技术问题,比如此前被曝出的车辆在特定情况下会绕行校车,Waymo在几周内就主动提交了自愿召回。

更重要的是,Waymo公开发布经过同行评议的研究报告,用详尽、可验证的数据证明其自动驾驶系统在安全性上显著优于人类驾驶员(整体安全约5倍,涉及行人时约12倍)。

Waymo的联席CEO Tekedra Mawakana曾公开呼吁行业提高透明度,她认为,如果你要把没有驾驶员的车辆放到路上,你就有责任告诉公众到底发生了什么。

Waymo的路线,是典型的“重资产、慢功夫”,通过严谨的工程、冗余的传感器(激光雷达、摄像头、雷达融合)和有限地域的精细化运营,逐步建立技术和公众的信任。而特斯拉则试图用“影子模式”和海量数据“暴力破解”通用人工智能驾驶,这条路更快,也更具风险。

两家公司的差异,不仅仅是技术路线之争,更是企业哲学之争。Waymo选择将安全和透明度作为建立信任的基石,而特斯拉则似乎更相信“增长能解决一切问题”的互联网打法。

小结回到最初的问题:特斯拉的数据延迟,是困难还是策略?

答案很可能是两者的结合,但策略性因素的比重显然更大。这是一种利用监管流程的复杂性,为自身技术迭代和商业扩张争取时间的“监管套利”行为。从目前来看,监管机构的行动速度可能跟不上特斯拉的扩张步伐。

长远来看,只有那些敢于将自己的数据放在阳光下,接受最严苛审视的公司,才能真正赢得未来。因为在人命关天的安全领域,透明度不是一种选择,而是一种责任。