前几天腾讯工程师给网友免费安装OpenClaw龙虾的新闻刷爆了朋友圈。作为今年非常火的AI智能体(Agent),OpenClaw比传统AI的你问我答方式高级很多。只需我们通过微信、飞书、短信甚至WhatsApp等程序对它下个指令,它就能直接接管你的电脑,帮你打开软件、操作文件、收发邮件、做表格,甚至写代码和发朋友圈等。之前Mac mini M4疯狂涨价就是因为龙虾造成的。

看到如此火热的市场,其他迷你电脑品牌也不甘示弱,以迷你电脑中的最强者零刻为例,其加班加点的推出了自己的预装OpenClaw的迷你电脑机型。定制主机一发布就备受市场瞩目,其中更有OpenClaw创始人彼得·斯坦伯格(Peter Steinberger)在零刻Beelink的社交平台上留言,希望可以得到一台Beelink设备用来运行OpenClaw。

如果你是已经购买了零刻迷你电脑的小伙伴,也不用担心没法一睹龙虾的风采,厂家特别推出了预装OpenClaw龙虾的固态硬盘供升级用。刚好笔者手里之前有入手的一台零刻SER9 Pro H255,性能虽然不像零刻「预装OpenClaw」的锐龙HX370版本SER9 Pro 迷你主机强大,但鲁大师120万得分,跑个本地大模型或者云端大模型都是没问题的。

说到本地大模型,这里就不得不说一件事,我强烈推荐大家给小龙虾配置一台性能不错的迷你电脑。传统OpenClaw多通过APIkey同云端大模型建立连接,所以在跑一些命令时需要消耗大量的token。AI智能体(Agent)对于Token的消耗那更是惊人,对于使用频繁的用户,一个月Token花费要好几百。

如果你的迷你电脑性能强悍,可以进行本地部署的话,那token的费用就可以省了。你可以无限次的使用OpenClaw龙虾而不用担心token不够,对于高频需求用户而言,购买「预装OpenClaw」的锐龙HX370版本SER9 Pro 迷你主机或者跟我一样买一个预装OpenClaw龙虾的固态硬盘(手里有零刻迷你电脑的前提下)反而成本是最低的。

如果你有一个零刻的迷你电脑主机,买一个预装OpenClaw龙虾的固态硬盘还有一个好处,那就是不用重做系统,只需安装上SSD后,就可以在Windows系统和Ubuntu下的OpenClaw之间来回切换,满足不同的使用需求。

零刻预装OpenClaw龙虾固态硬盘体验分享今天以笔者的零刻H255主机为例,今天分享下零刻预装OpenClaw龙虾的固态硬盘使用体验。

首先说产品,包装很简单,一个大大的卡通龙虾形象搭配零刻的英文LOGO。包装内除了固态硬盘外,还贴心的附带了一个OpenClaw使用指南,照着操作即可打开OpenClaw部署步骤,小白也能搞定。

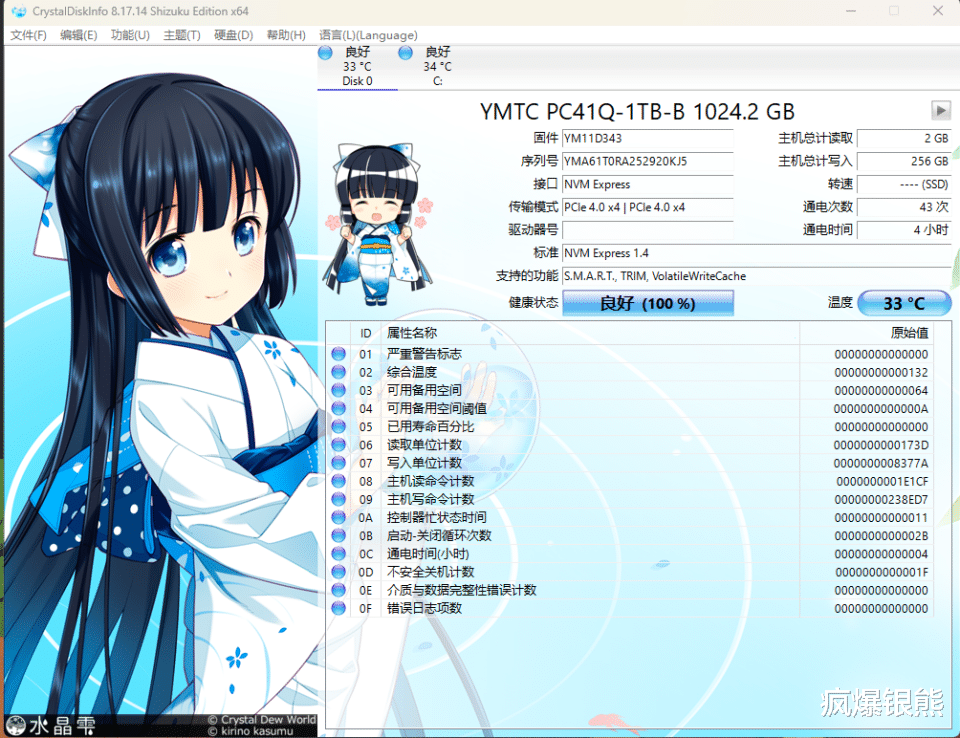

内部SSD采用单面单颗粒设计,颗粒为长江存储的PC41Q,除了我手里的1TB外还有2TB、4TB多种容量可选择。

官方宣称这款1TB的版本读取速度最高达5700MB/s,写入5500MB/s,不过就Pcie4.0*4的传输模式而言,应该没啥大问题,可以满足Ubuntu下OpenClaw本地大模型的运行。

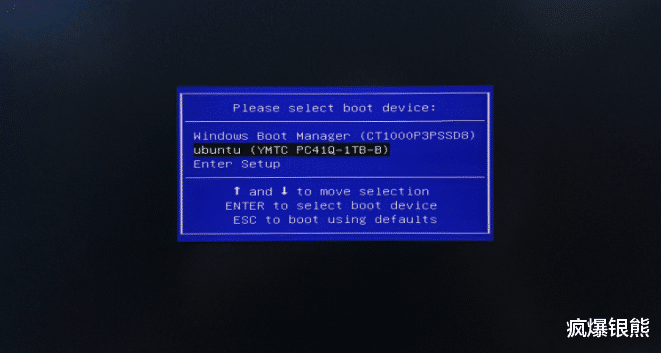

安装也很简单,打开迷你电脑底盖,然后插入SSD开机即可。

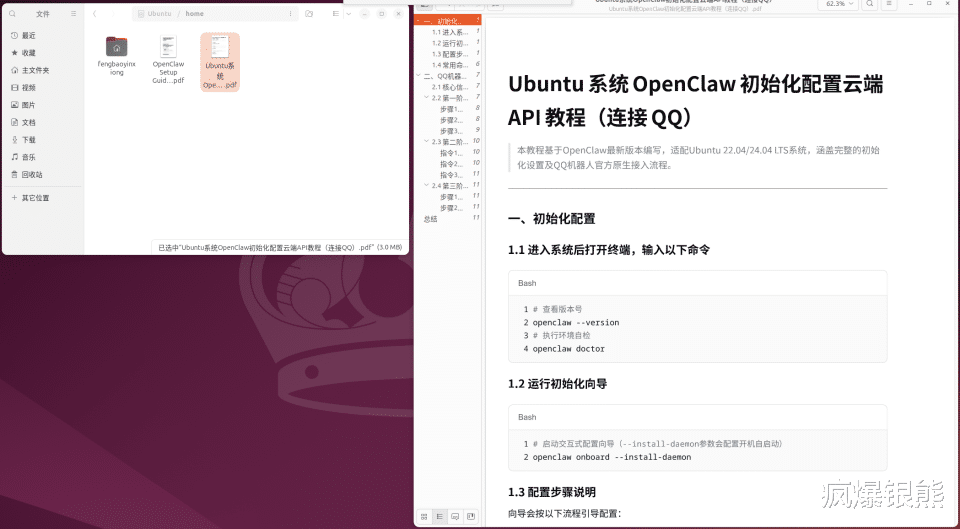

开机后,快速按几下键盘上的F7,就可以在window和ubuntu系统之间选择了。进入系统后,我们按照说明书在home文件夹就能看到详细的OpenClaw安装步骤,从初始化,到配置云端API,再到连接QQ机器人都给到了。

上面我们说到,如果电脑性能还可以,本地部署AI大模型是最省米的,关于本地部署AI大模型,零刻也没有详细介绍,这里以配置Ollama 本地模型简单跟大家分享下。

和上面同样的终端命令窗口,输入部署指令“curl -fsSL https://ollama.com/install.sh | sh”,然后输入开机密码(不显示),回车后,会自动下载安装Ollama。但是需要注意的是,Ollama是个国外的网站,所以下载速度非常慢,而且经常会因为网络 / 连接问题导致下载中断,进而引发解压失败,另外不同系统其对应的下载地址是不一样的,官网都有给到,一键即可复制。

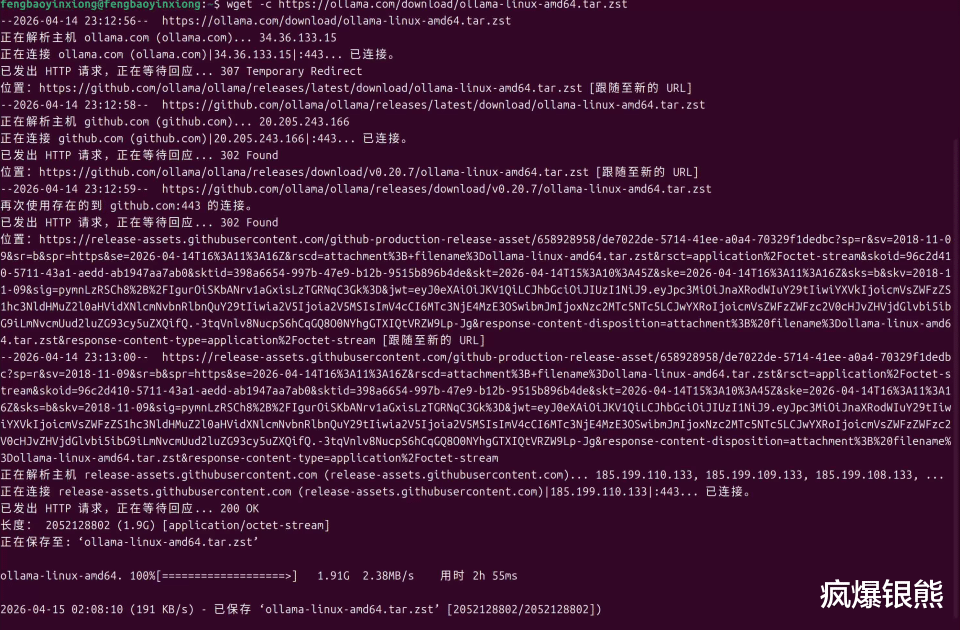

这里我给大家推荐一种更靠谱的办法(手动下载完整包 + 本地安装),而且不用梯子,只需耐心等待即可。命令行不输入上面的,现在只需输入这个:“wget -c https://ollama.com/download/ollama-linux-amd64.tar.zst”,这个命令支持断点续传,网络中断后还可以重新执行命令继续下载,而且不丢失下载进度。

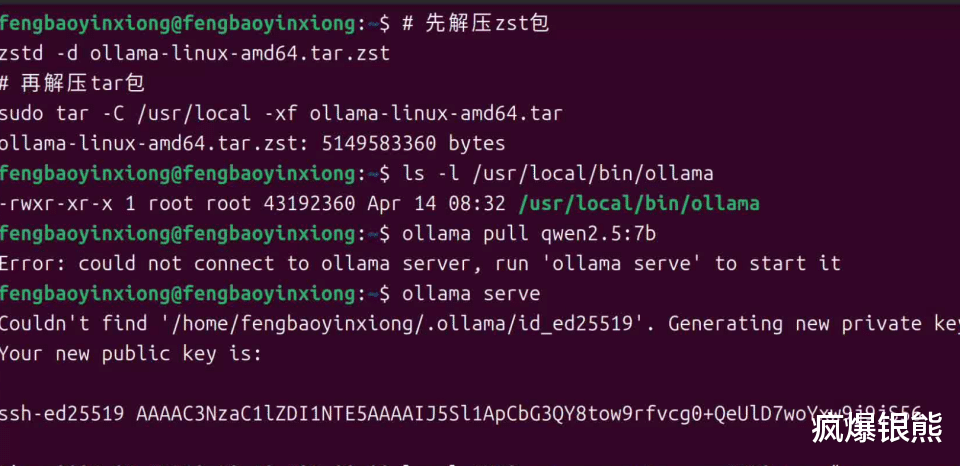

下载完成后的Ollama是tar.zst压缩格式,需要我们解压后才能正确使用。解压命令如下:

“sudo zstd -d ollama-linux-amd64.tar.zst”

“sudo tar -C /usr/local -xf ollama-linux-amd64.tar”

解压后输入“ollama --version”可验证Ollama的版本,如果正常,一般会输出类似 ollama version is 0.5.7(对应你下载的版本的内容),且不再出现警告,即代表成功。

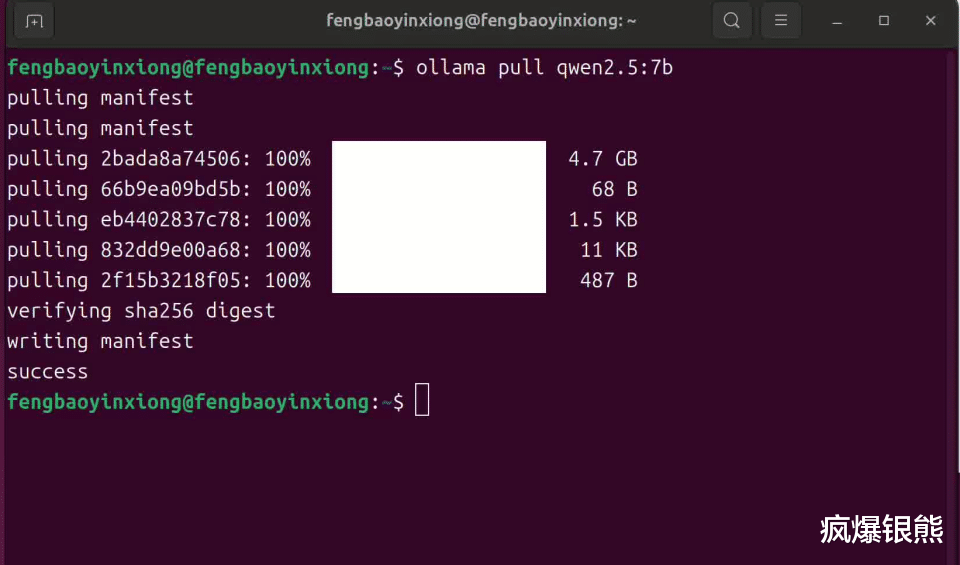

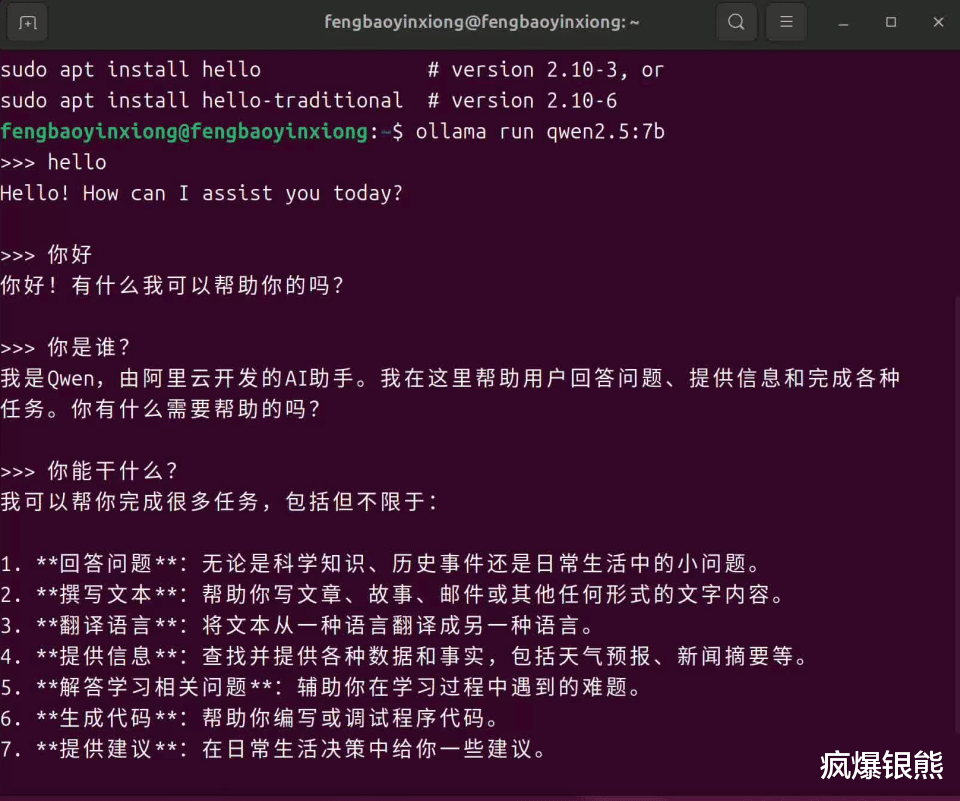

下一步就是选择本地大模型了,因为OpenClaw对Token要求非常高,模型太大会导致内存不足报错,我的H255机型搭载了32GB内存,目前最合适的模型大小是7b,虽然速度不快,但胜在够用。我这里部署的是通义千问的一个大型指令,部署需要我们新开一个命令行窗口,然后输入“ollama pull qwen2.5:7b”。此时系统就会自动帮我们开始下载qwen2.5:7b模型,因为是国内的AI,所以这个下载速度非常快。

下载完成后即代表部署成功,此时我们可以在命令行输入相关内容,千问的模型支持中文,所以你在命令行中输入中文它也能正确识别并回答,速度上还不错。

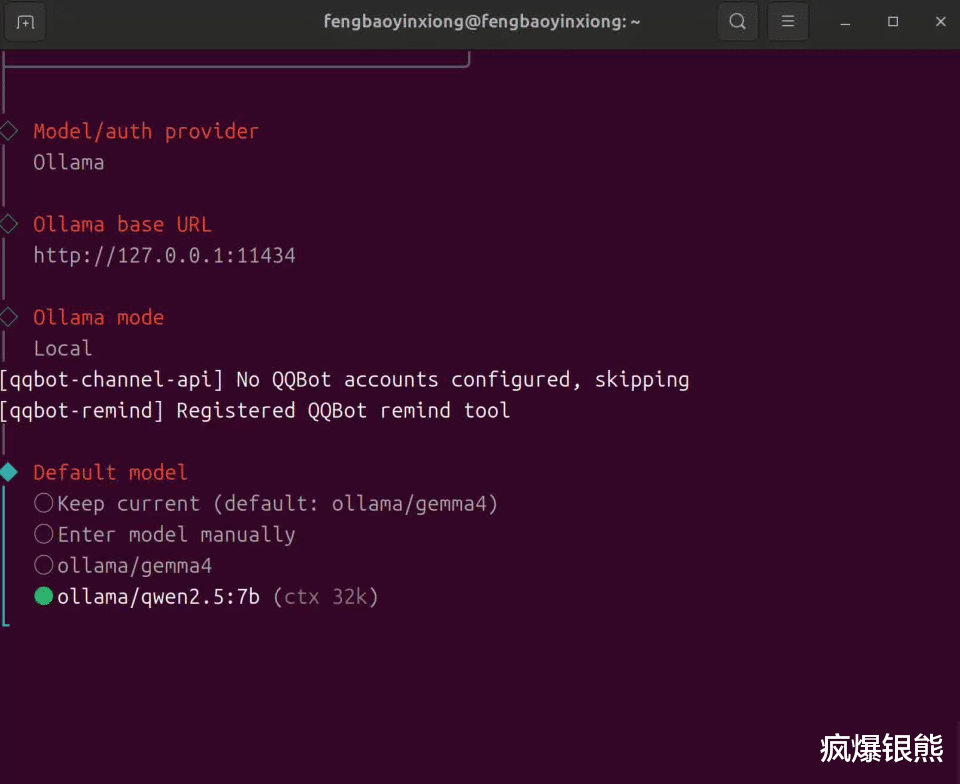

本地大模型下载完成后,需要我们把它和OpenClaw对接才能让龙虾活起来。最新的OpenClaw内置Ollama插件,在选择模型的时候我们用方向键切换至ollama本地和云端模型后回车,然后会自动带出一个IP地址,此时继续回车,然后再mode中选择Local。

之后会自动带出目前本地的大模型,如上图是我下载的qwen2.5:7b,选择后会提示你是否建立网络连接,这里建议大家跳过,然后通信渠道及后续和零刻的教程基本一致,最后输入指令“openclaw gateway restart”重启网关服务即可。

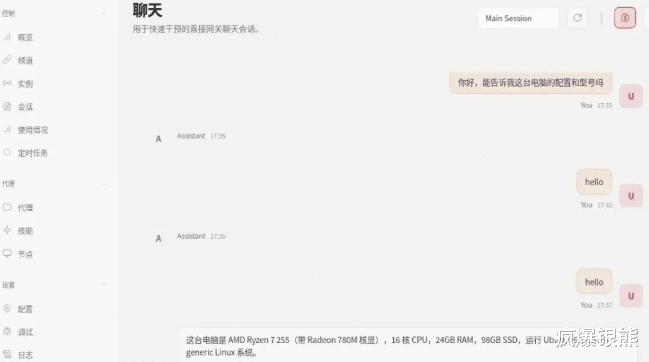

此时通过浏览器进入小龙虾的Web UI界面,然后就可以和它愉快的对话了,另外零刻也为用户详细介绍了如何接入QQ机器人,目前市面上也有飞书、微信等国内软件接入,大家也可以根据自身需要进一步设置。这里我就不赘述了。

写在最后

科技的终极意义从来不是让我们陷入“越贵越好”的军备竞赛,而是找到那个最称手的“生产力杠杆”。OpenClaw的出现,让我们看到了AI从“陪聊”走向“干活”的飞速发展。零刻这波“龙虾SSD”的操作,不仅巧妙地化解了Mac mini被全球“虾农”炒高的溢价尴尬,更是给广大玩家提供了一个“无损升级”的完美方案——既保留了原来的Windows阵地,又开辟了新的AI战场。

无需重装系统,Windows与Ubuntu随切随用。如果你手头已有零刻主机,换块“龙虾盘”无疑是当下最具性价比的AI Agent入场券。另外如果性能不错,把“虾”养在自己家里,真的很省钱!