[CL]《Verifying Chain-of-Thought Reasoning via Its Computational Graph》Z Zhao, Y Koishekenov, X Yang, N Murray... [FAIR at Meta] (2025)

通过计算图验证链式思维推理

🔍 研究背景:

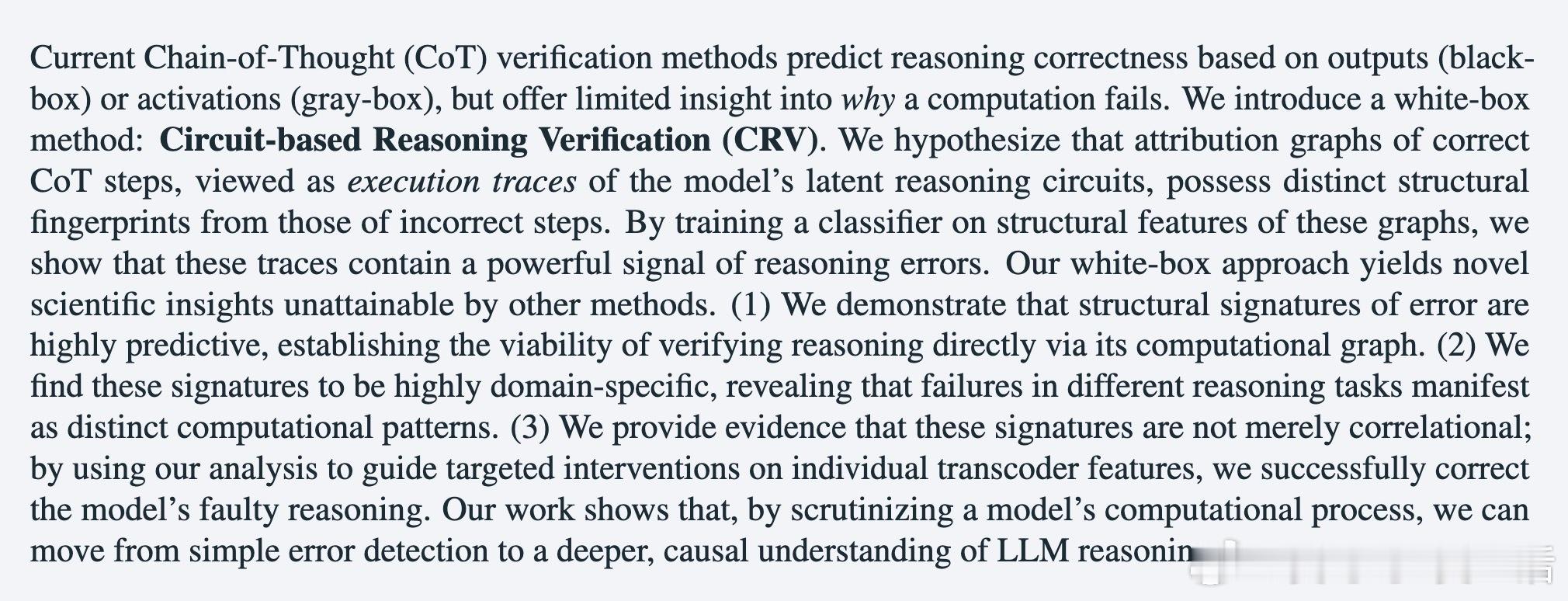

链式思维(CoT)提示大幅提升了大语言模型(LLM)的推理能力,但推理过程偶尔出错,且现有黑盒(仅看输出)或灰盒(观察激活态)方法虽能检测错误,却难以解释为何出错。

🛠️ 研究方法:

作者提出了白盒方法——基于电路的推理验证(CRV),将推理过程视为模型内部潜在电路的执行轨迹。方法步骤:

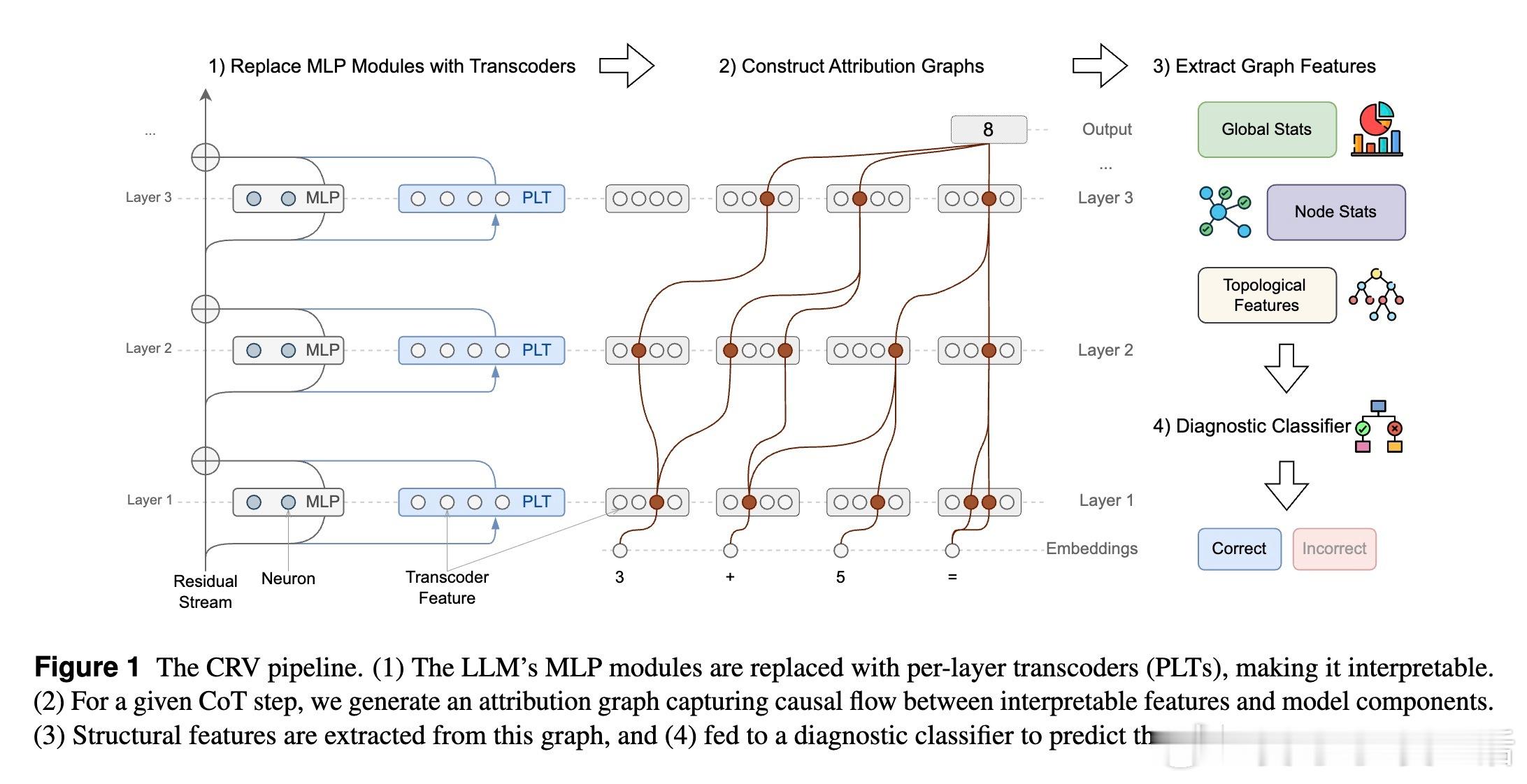

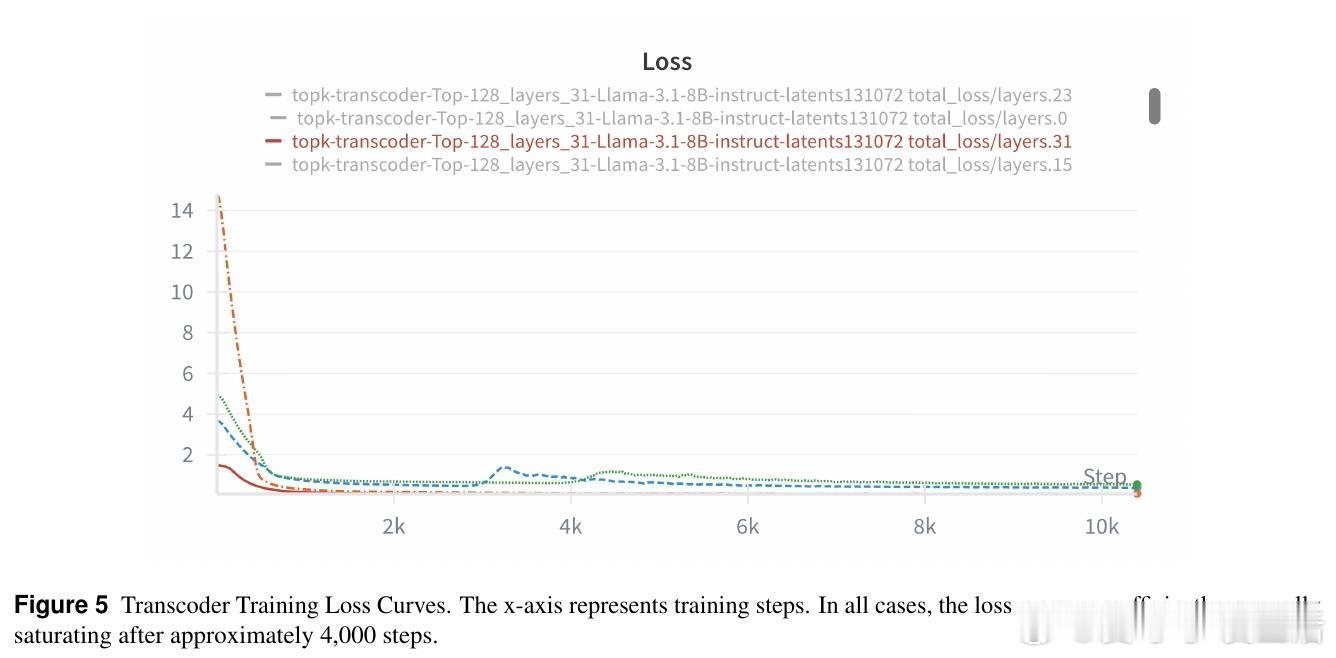

1️⃣ 用“转码器”(transcoders)替换模型中的MLP模块,使中间特征可解释且稀疏。

2️⃣ 构建每一步推理的归因图(attribution graph),捕捉从输入到输出的因果信息流。

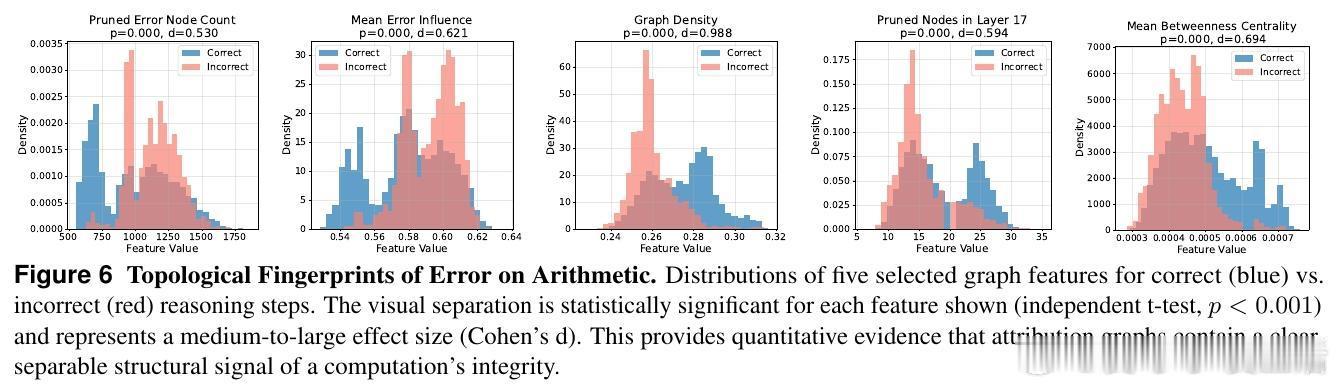

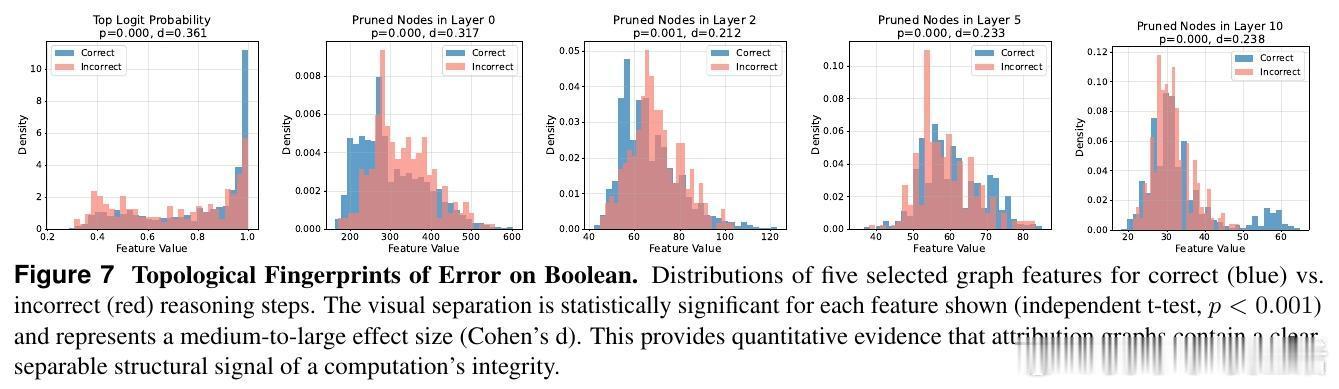

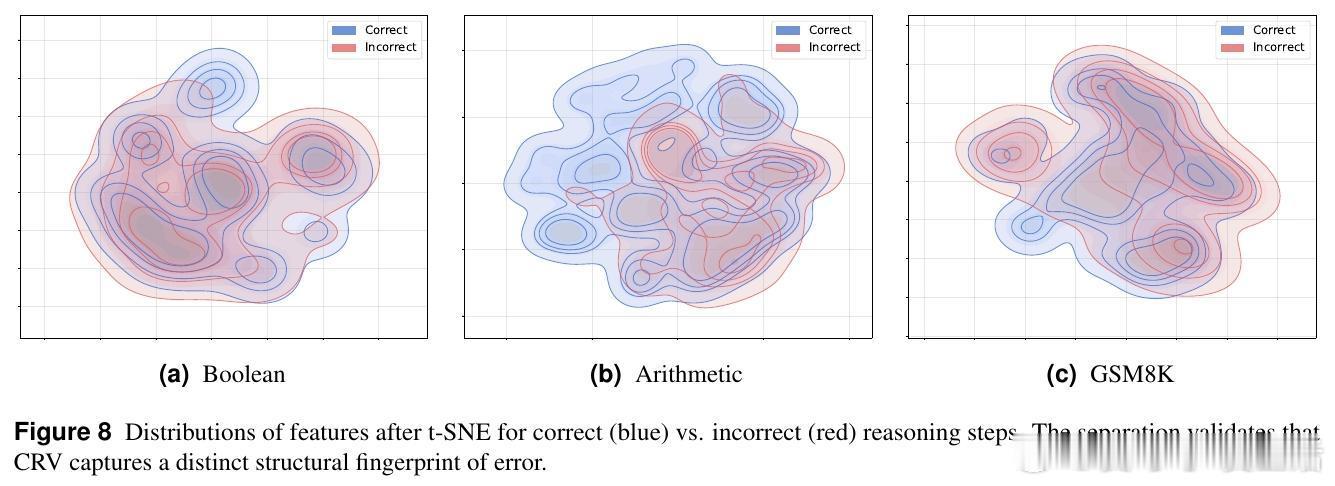

3️⃣ 从图中提取结构特征,如节点影响力、激活统计、拓扑结构等,形成“结构指纹”。

4️⃣ 训练诊断分类器,基于结构指纹预测推理步骤的正确性。

📊 实验亮点:

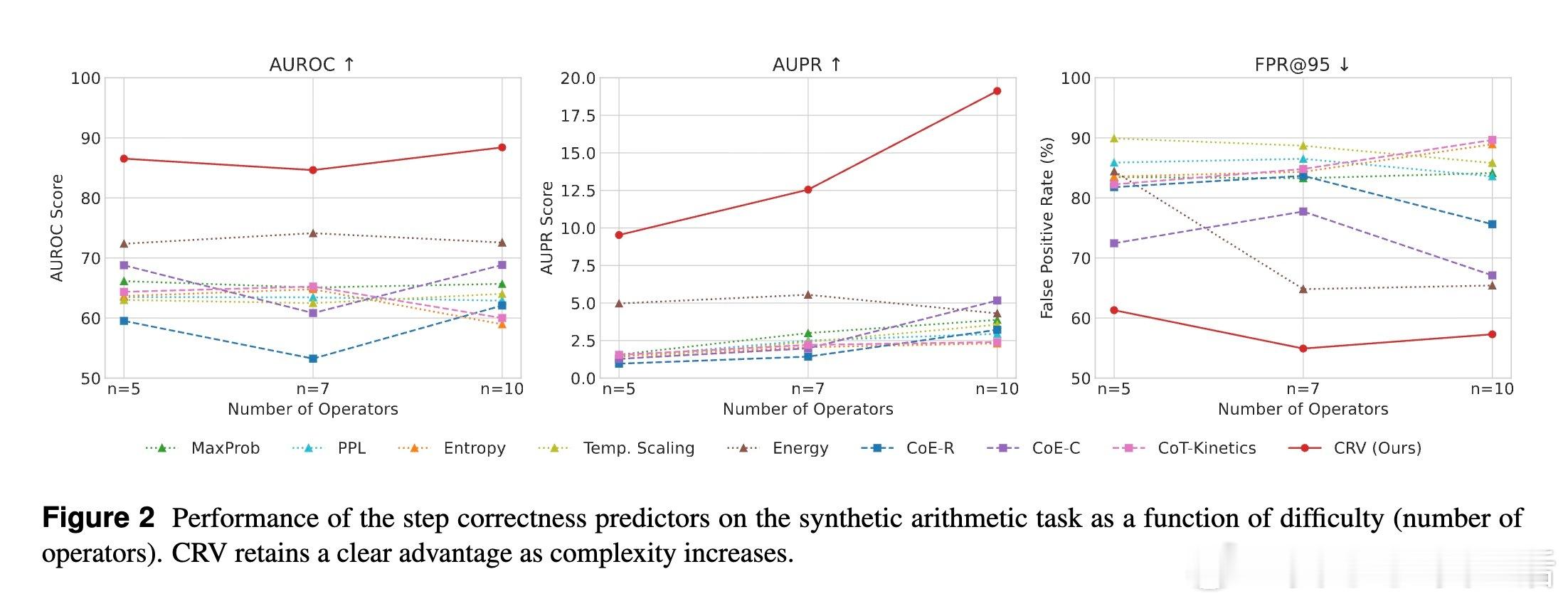

- 在合成布尔和算术任务及真实GSM8K数学数据集上,CRV较黑盒和灰盒基线方法显著提升错误检测准确率(AUROC最高达92.47%)。

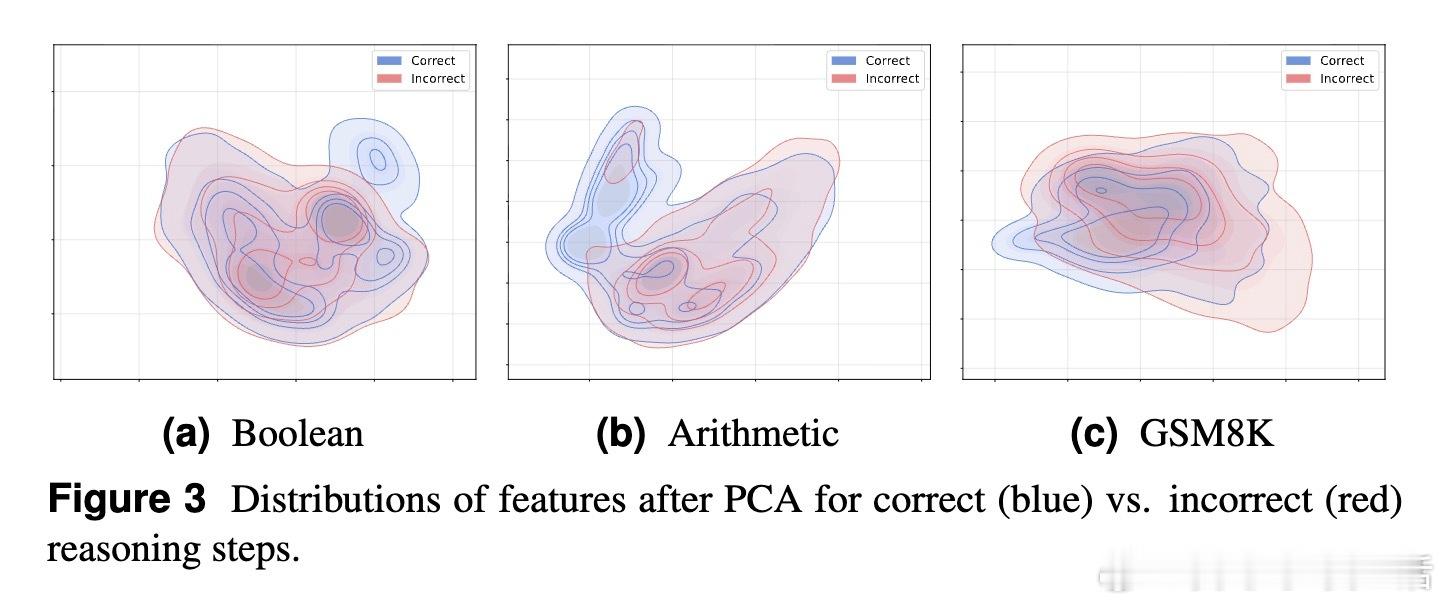

- 错误的结构特征高度领域专一,不同任务的失败表现为独特的计算图模式。

- 通过精确定位并调节关键转码器特征,实现对错误推理的因果干预,成功纠正模型计算路径。

🔬 科学贡献:

- 首次将推理失败视为潜在电路执行缺陷,揭示了推理正确与否在计算图上的可辨结构指纹。

- 显示深入分析模型计算过程比仅观察输出或激活更能理解和修正推理错误。

- 提供了可解释、因果的推理错误检测与修正新范式,促进未来神经符号验证和调试研究。

⚠️ 局限与未来:

- CRV计算开销大,难以直接用于实时系统,仅作为科学研究工具。

- 当前特征分析主要是统计和拓扑层面,未来可结合特征语义做更细粒度推理。

- 错误模式高度任务依赖,需探索跨域泛化能力。

📂 数据与代码:

作者承诺开放带步级正确性标注的推理数据集及训练好的转码器,支持后续研究。

全文详见:arxiv.org/abs/2510.09312

AI 大语言模型 推理验证 机制可解释性 ChainOfThought 机器学习 计算图 神经网络电路