以前要微调那种超大型的AI模型,动辄得花上几百万,这价格让学校、小实验室、初创公司和个人开发者们根本玩不起。但现在不一样了,AI基础设施企业趋境科技的KTransformers技术和LLaMA-Factory工具强强联合,找到了一个省钱又省力的好办法。

简单来说,这个新方案能让你用很少的GPU资源,就像给大模型做一次轻量的“专项培训”。实际测试中,它只需要大约41GB的显存和2T的内存,速度还能达到每秒处理46.55个token。对开发者来说操作也很简单:只要安装好KTransformers和LLaMA-Factory,配置一个文件然后运行,微调任务就开始了。最关键的是,这是目前在消费级显卡上实现微调超大参数MoE模型的唯一可行方案。

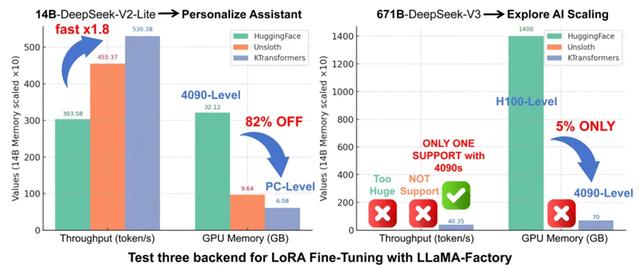

在性能对比测试中,KTransformers微调方案优势显著。在较小规模的MoE模型(DeepSeek-14B)测试中,其吞吐速度超过传统方案1.8倍,显存占用较传统方案降低82%。传统方案多依赖H100等高端GPU,而KTransformers可支持4090级消费级显卡,大幅降低了硬件门槛。