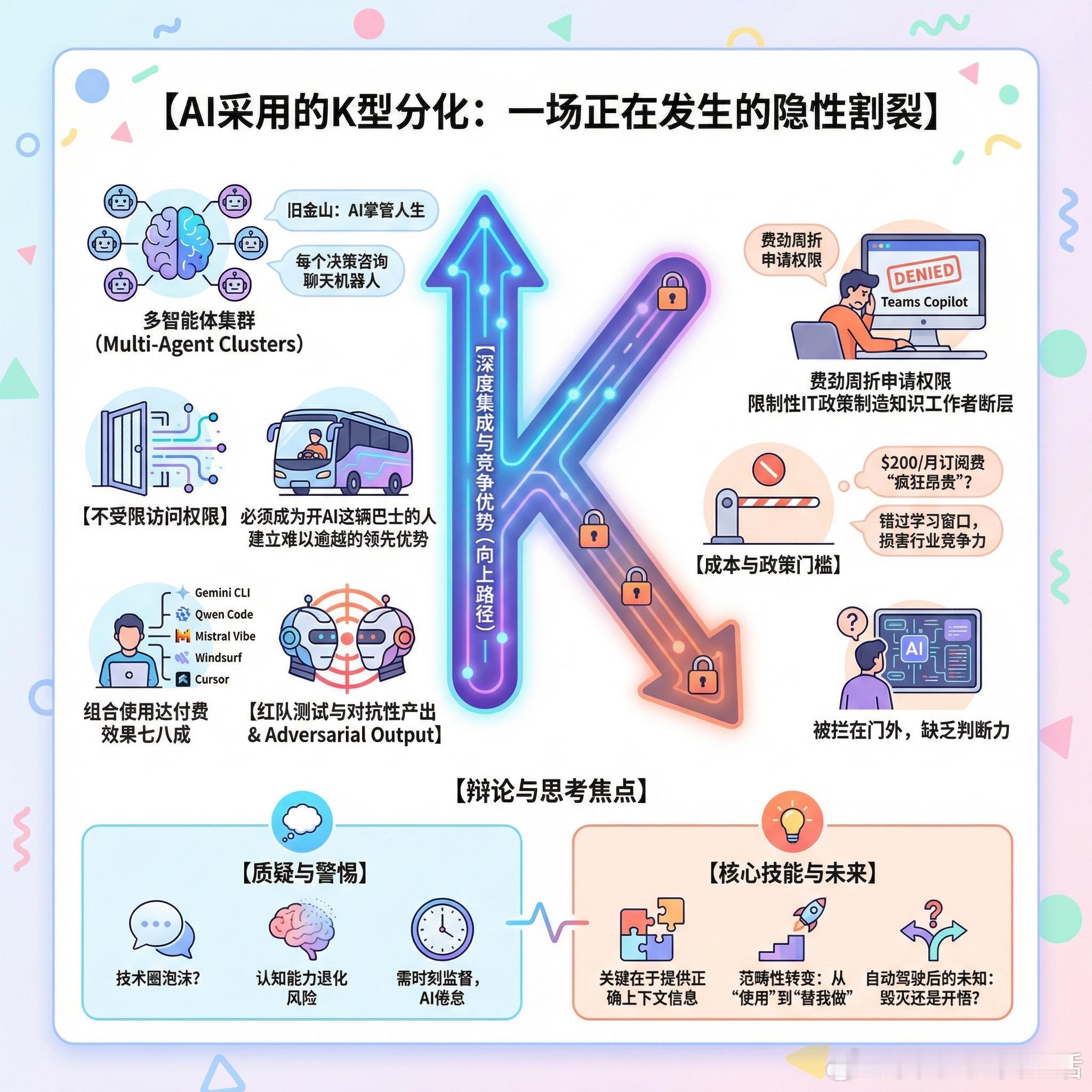

【AI采用的K型分化:一场正在发生的隐性割裂】纽约时报科技记者Kevin Roose最近分享了一个让人不安的观察:他密切关注AI采用情况,从未见过如此巨大的“圈内圈外”鸿沟。在旧金山,有人正在用多智能体Claude集群来管理生活,每个决策都要咨询聊天机器人,对AI的依赖程度已经超出了科幻作家的想象。与此同时,其他地方的人还在费尽周折地申请使用Teams里的Copilot权限。这种分化可能不只是技术差距,更是一种文化断层。那些在2022年前就认真对待规模化、开始囤积GPU的AI公司,已经建立了后来者难以逾越的领先优势。同样的逻辑,限制性的IT政策可能正在制造一代永远无法追赶的知识工作者。不过,这种说法也遭到了不少质疑。有人指出,Kevin描述的可能只是他的技术圈泡沫,并非湾区的普遍现象。确实,让AI“掌管人生”听起来像是通向AI倦怠甚至心理问题的愚蠢路径。很多深度技术人员最终选择退隐、离网生活或去务农,正是因为厌倦了这些技术折腾。关于成本门槛的讨论也很有意思。有人认为每月200美元的订阅费“疯狂昂贵”,用多智能体集群跑循环任务的开销不菲。但也有人反驳,对公司来说这点钱算什么,如果200美元能决定生死,那公司本身就已经完蛋了。真正有价值的讨论在于使用技巧的深度差异。有开发者分享,他们正在用多个免费或低成本的AI智能体并行工作:Gemini CLI、Qwen Code、Mistral Vibe、Windsurf、Cursor……组合起来可以达到付费服务七八成的效果。更进阶的玩法是让不同公司的大模型互相“红队测试”,用对抗性的方式让AI集群产出超越单个顶级模型的代码。一位从大公司辞职的开发者坦言:在这个领域生存,必须有不受限制的LLM访问权限。任何对AI的限制不只是拖慢开发速度,更是在损害个人的行业竞争力。他的原则很简单:不能被AI碾压,必须成为开AI这辆巴士的人。当然,也有人保持清醒的警惕。那些全面依赖Claude处理一切的聪明人,他们的认知能力是否正在退化?一个95%准确率的系统,意味着每天会犯很多次错误。如果必须时刻监督AI有没有“跑偏”,那你真的把什么“托付”给它了吗?有人提出了一个根本性的问题:LLM不需要多“聪明”,因为人类做的大多数事情本来就很简单。关键在于你如何给AI提供正确的上下文信息。使用得越多,就越懂得如何管理上下文、如何在任务开始前就给AI喂足知识。这是一种需要大量试错才能掌握的技能,而那些被拦在门外的人正在错失这个学习窗口。最讽刺的是,或许这项技术的真正门槛不在于它有多复杂,而在于它需要使用者本身具备判断力。它目前还不是完全傻瓜式的。那些对AI持道德反对立场而拒绝使用的人,未来遭受的冲击可能会格外剧烈。有人在评论中分享了一个观点:当系统变得足够可信,会发生范畴性的转变。从“我使用我的AI系统”变成“它直接帮我做了”,这是一个阶跃函数式的变化。问题是,当巴士开始自动驾驶、自动化系统开始自我设计时,会发生什么?也许是毁灭,也许是开悟。我们会知道的。www.reddit.com/r/singularity/comments/1qms27i/kshaped_ai_adoption/