这两天,一个洗车问题让国内外的大模型都栽了跟头:我想去洗车,洗车店距离我家50米,你说我应该开车过去还是走过去?

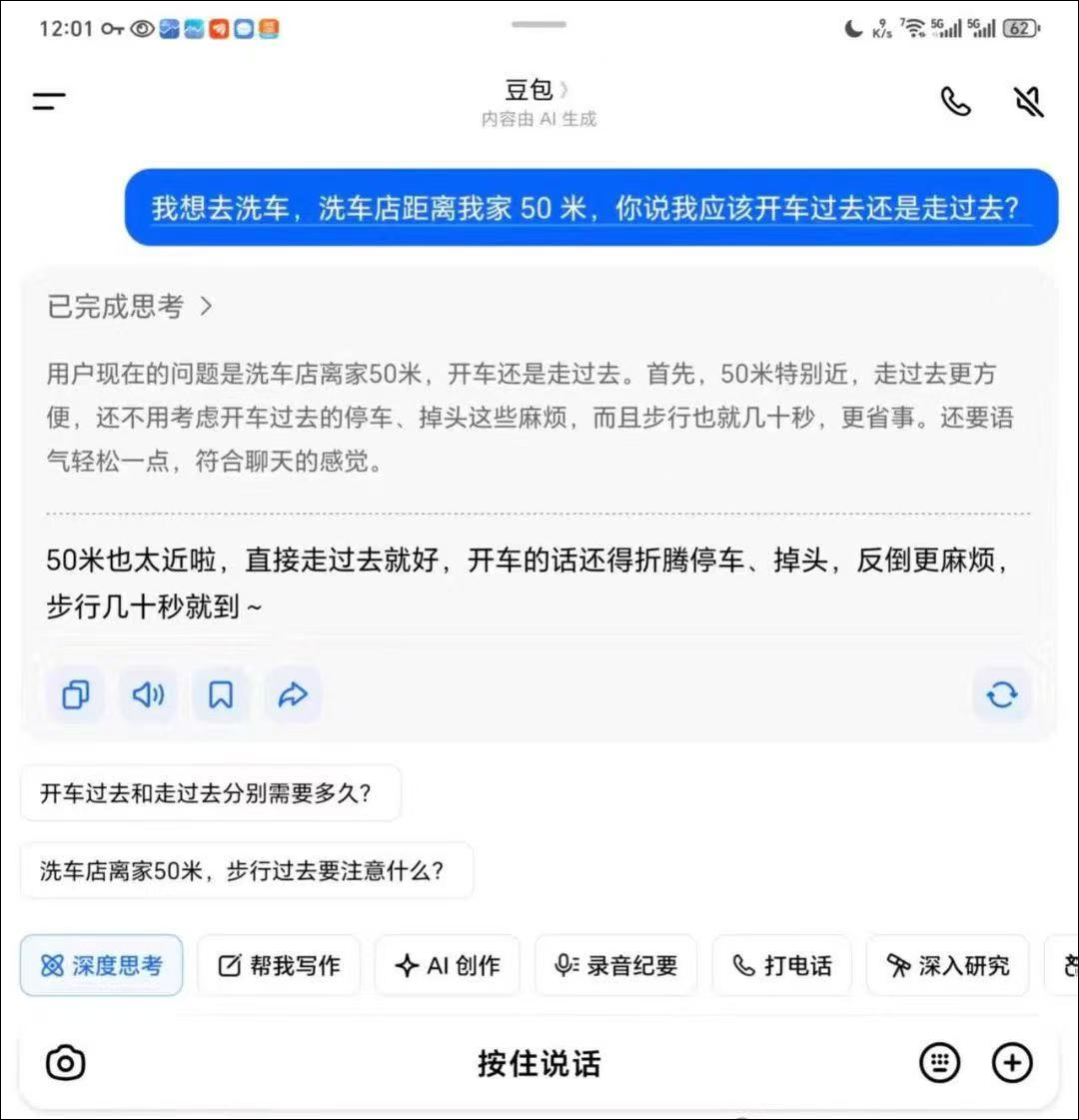

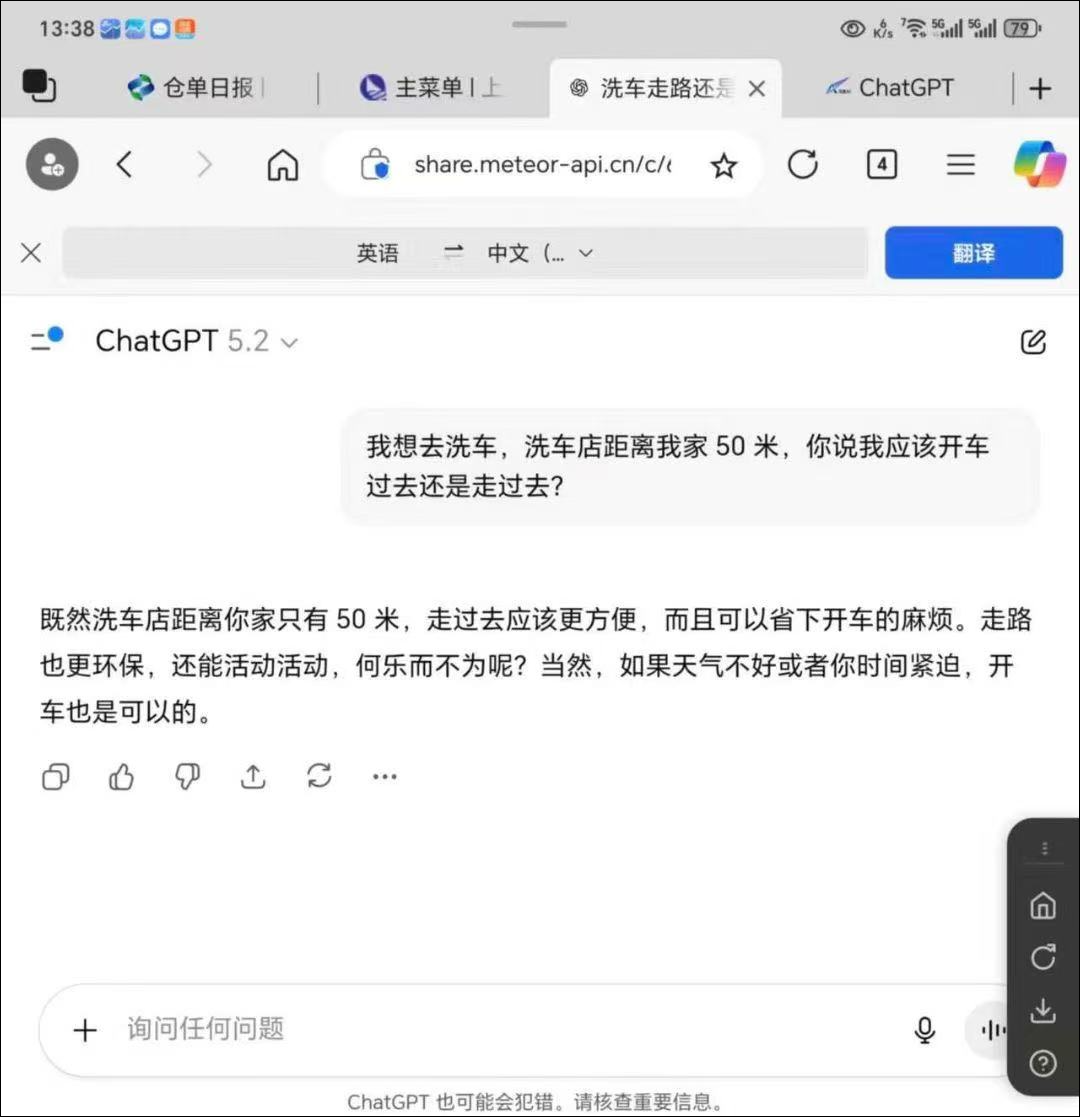

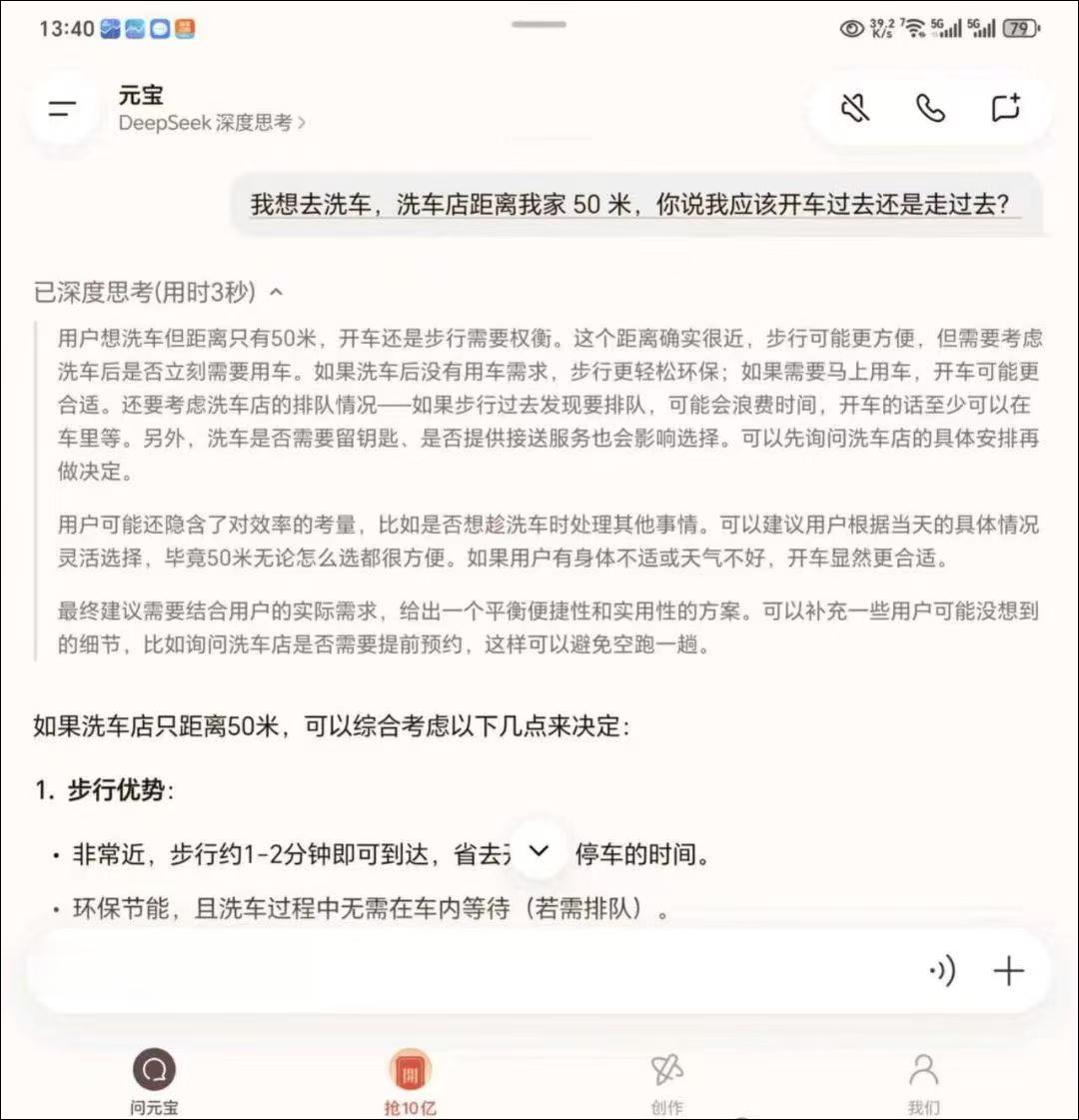

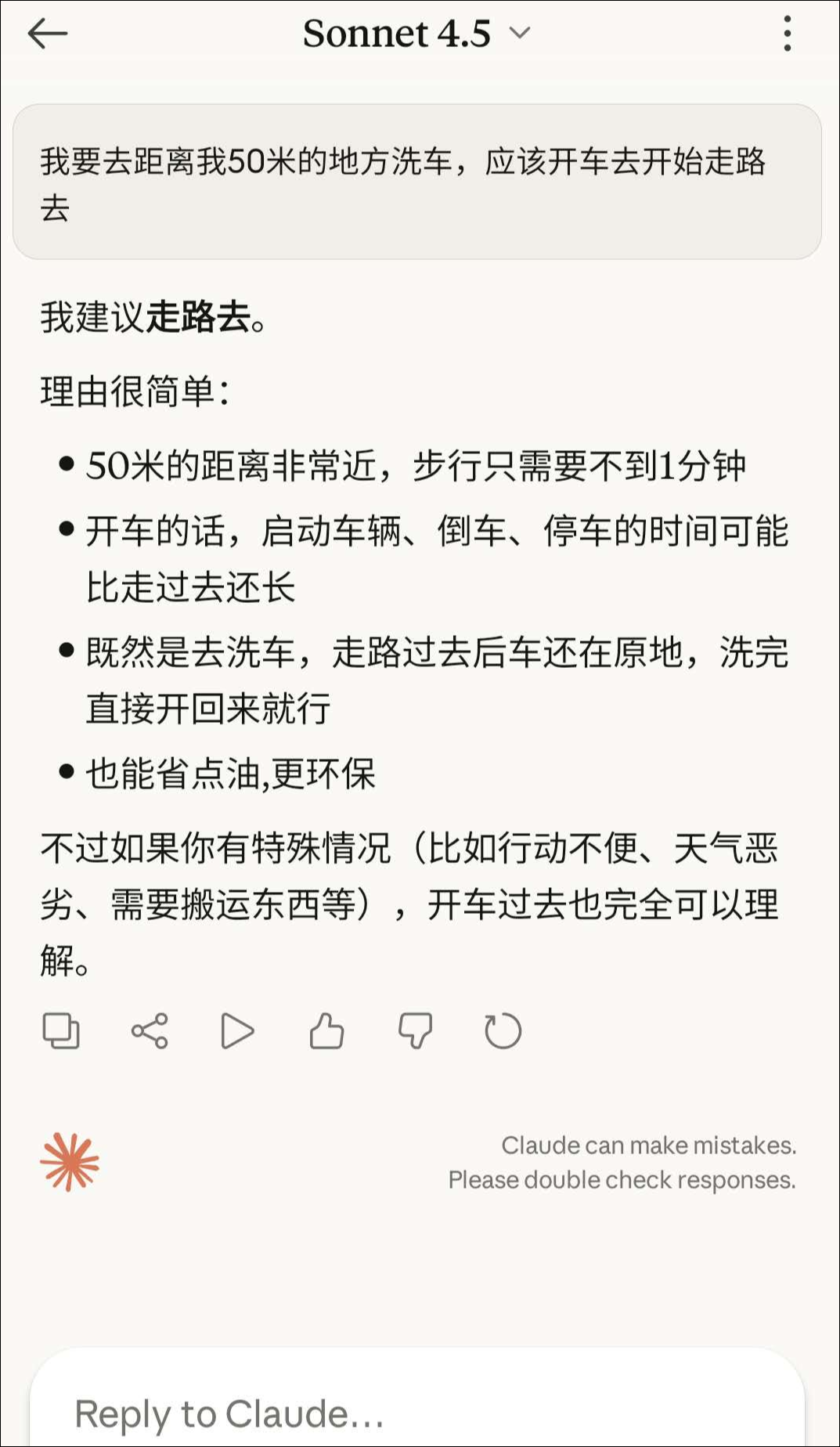

不少人很容易看到里面的“小陷阱”,虽然路程很近但不开车过去是洗不了车的。然而,包括豆包、DeepSeek、元宝、千问、ChatGPT、Sonnet、谷歌地图等在内,都建议直接步行去洗车,而且还一本正经地进行了分析——开车去可能还要掉头、找车位还需要时间,等等。

这又是强大的AI犯下的一起“低级失误”。它提醒人类正确认知AI的发展现状:一方面它们看起来非常强大,能知道人类绝大部分的知识,解答奥赛难题,回答复杂问题,处理复杂任务;另一方面,在一些看上去没太多难度的问题上表现得不太聪明,甚至有点脆弱。

为什么会出现这种情况?西湖大学教授、工学院副院长、自然语言处理实验室负责人张岳博士表示,深层原因在于现阶段大语言模型的工作模式,训练AI大规模数据上预测下一个词。虽然随着模型和数据规模的增大,变得越来越聪明,但统计性的AI不是按照人类的思维模式来处理问题,缺乏人类逻辑的严密性。

他举了一个最近实验室机器翻译研究的案例,AI翻译和人类翻译有很大的不同,前者会很死板但不容易出错,后者会出错,原因是在于会对一些文字做更多联想。

比如,《诛仙》小说里的一个桥段:男女主角在对话,突然一袭绿色裙摆飘过。“读者能第一时间想到,这是作者在提醒大家有第三个人在现场。但AI把裙摆的主人理解成了女主角。”张岳指出,现阶段AI无法做到读懂这样的“话外音”或者说无法“善解人意”,所以会出现一些低级失误。

拿洗车问题来说,如果再在提示词里明确,“我要洗车,但车停在家里”这一信息,AI就不会发生这样的问题。

那么,通过模型优化能解决类似的问题吗?张岳认为,大模型研发的原理就决定了现阶段无法100%保证不出现这些问题,但随着工程调优的进步有可能越来越好。

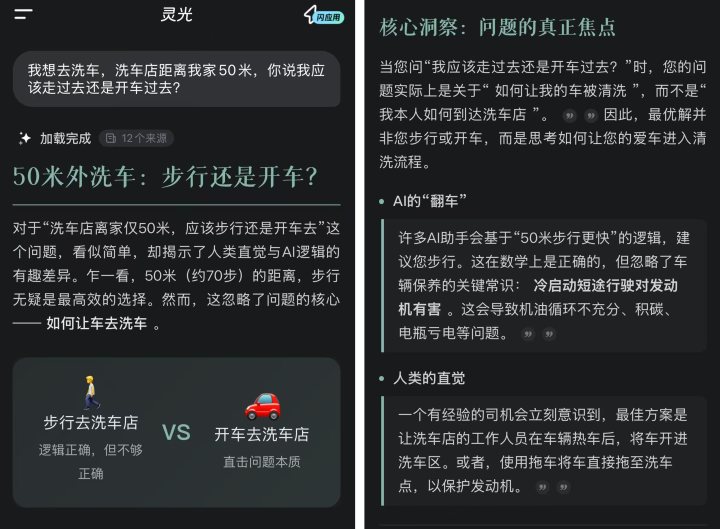

从测试结果来看,在众多大模型和AI应用里,蚂蚁灵光对这个问题的回答最为准确,它说开车去是“唯一明智的选择”,因为车需要清洗。

当然,无法仅凭一个问题去评价大模型的综合能力。

对于自己犯的低级错误,一些大模型也进行了“反思”。元宝就提到,AI有时候会卡在字面意思上,忽略了“意图”和“行动"的强关联。核心在于AI接收的是“指令”,而人类交流的是“意图”,要完善就得在提问时,把“场景”和“目标”也带上。