AI服务器卡得像早高峰地铁,国产芯片突然打通了120条数据高速路,它真能扛住大模型狂奔?

。

最近光谷那边传出个消息:芯动科技出了一颗叫GX9120的芯片,120个通道,专管服务器里GPU、CPU、内存之间怎么传数据。以前这活儿基本被国外几家包圆了,国产货大多只能打下手,这次不一样,是真刀真枪接进AI训练服务器里用了。

它不光是“多加了几条线”。实测端到端延迟115纳秒,比不少旧方案快一倍多;能同时连16块GPU,还不堵车;-40℃到105℃都能稳住,机房夏天热一点、冬天冷一点,照样跑。不是实验室样品,中兴、恒为这些做服务器的公司已经在用,光是PCIe Gen4版本就卖给了40多家客户。

有人光看“120通道”以为就是堆数量,其实关键是“不排队”。传统交换芯片像老式十字路口,红绿灯固定,车多了就堵死;GX9120更像智能导航,数据包一出发就知道哪条路最空,微秒级就能重新选道。这不是靠外挂软件,是芯片里硬写的逻辑。

它和国产CPU、GPU不是“能亮就行”的凑合搭,是协议栈一级的对接。鲲鹏、海光的CPU,风华系列GPU,全都跑通了;不光能通电,还能热插拔换卡——服务器不用关机,插上新GPU立马干活。这步迈出去,才算真进到AI基建的“核心路段”。

功耗也压得实在。没写具体多少瓦,但所有报道都说“散热压力小了”,液冷机柜开始成批上,说明不是靠堆风扇撑场面。背后是SerDes物理层全自研,36dB插损容限,意思是线路绕得再乱、板子温度再飘,信号也不丢。

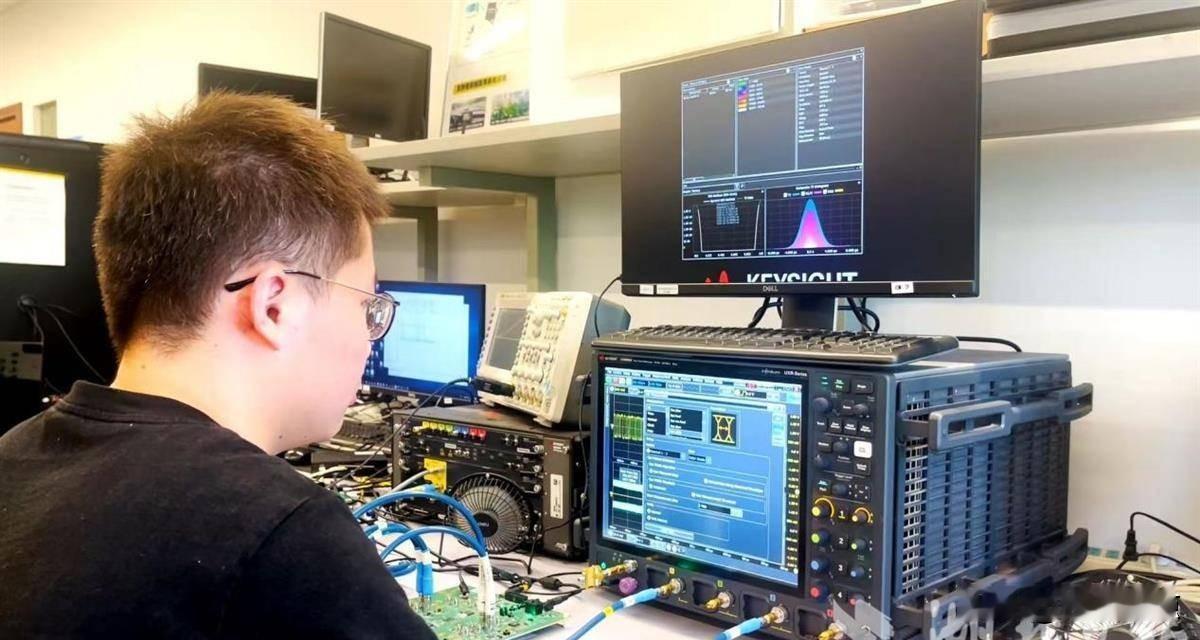

之前国产芯片常被说“参数好看,落地难”,这次不同。从Gen4量产,到Gen5首发,再到PCIe 6.0和CXL 3.0已在搞,300次流片不是白试的。200多项专利里,有60%以上是国际专利,标准组织里也开始有它的名字。

它没喊什么“打破垄断”,也没拿“首款”当标语贴满墙。就是在光谷一栋楼里,一帮工程师把交换逻辑重写了三遍,把驱动调了上千次,最后放进客户的AI服务器,跑满了三个月,没出一次互联异常。

现在这颗芯片就在那儿,插在机柜里,风扇呼呼转,数据哗哗过。