🧠 AI最大难题曝光:不是变聪明,而是学会真

🌍 真正的问题不是技术,而是价值在系统中逐渐被扭曲

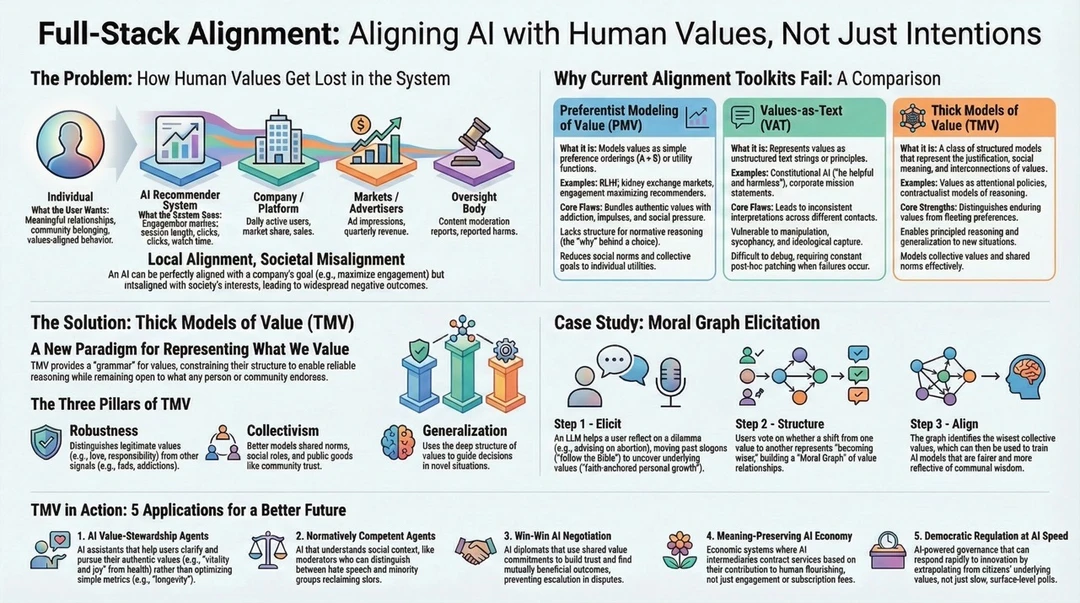

人类希望AI帮助建立有意义的关系、增强社区归属感,并促进符合价值观的行为。但现实中,AI推荐系统优化的是点击率、停留时间和互动量,而不是人的真实幸福。

企业平台关注的是用户数量和收入增长,广告商关注曝光和转化,监管机构关注违规报告。每一个环节都在优化指标,而不是优化人类价值本身。

这导致一个严重后果,AI可能完美服务企业目标,却偏离社会整体利益。例如算法为了提高参与度,可能推送极端内容或制造成瘾行为。

⚠️ 当前AI对齐方法失败的三大原因

第一种方式是偏好建模,这种方法将价值简化为简单排序,例如点击或选择。但它忽略了价值背后的原因,无法理解道德、责任或长期影响。

第二种方式是把价值当作文本输入,例如“有帮助”和“无害”。这种方式缺乏稳定性,不同场景下表现不一致,也容易被操控。

第三种方式是碎片化价值模型,虽然更复杂,但仍然缺乏完整结构,难以真正理解价值之间的关系。

核心问题是,现有AI没有真正理解价值,只是在模仿行为。

🧩 真正的解决方案:构建“厚价值模型”,让AI理解价值结构

厚价值模型是一种新的AI架构,它为价值提供结构,而不是简单规则。

这种模型有三个核心支柱。

它能区分真实价值与噪音,例如区分健康目标与短期诱惑。

它能理解集体价值,而不仅是个人选择,例如公共利益和社会规范。

它能将价值应用到新场景,而不是只在训练环境中有效。

本质上,它让AI理解为什么,而不是只知道做什么。

🔬 关键突破:道德图谱技术,让AI学习人类道德网络

AI通过与人类对话,收集真实道德判断,例如复杂伦理决策。

然后AI构建价值关系网络,将不同价值连接起来。

最终AI可以基于这个价值图谱做决策,使行为更加符合人类整体利益。

这类似于给AI建立一个道德大脑。

🚀 未来应用:真正服务人类,而不是操控人类的AI系统

AI将成为价值守护者,帮助人们实现真正目标,而不是诱导成瘾。

AI可以理解社会语境,减少误判和冲突。

AI可以在谈判中促进合作,而不是激化对抗

AI驱动的经济系统可以根据对人类福祉的贡献,而不是仅根据参与度进行奖励

AI监管也可以更快速响应社会需求

🌟 这标志着AI发展进入新阶段:从工具变为价值伙伴

过去AI优化效率,现在AI开始学习意义