[LG]《Symbol-Equivariant Recurrent Reasoning Models》R Freinschlag, T Bertram, E Kobler, A Mayr, G Klambauer [Johannes Kepler University Linz] (2026)

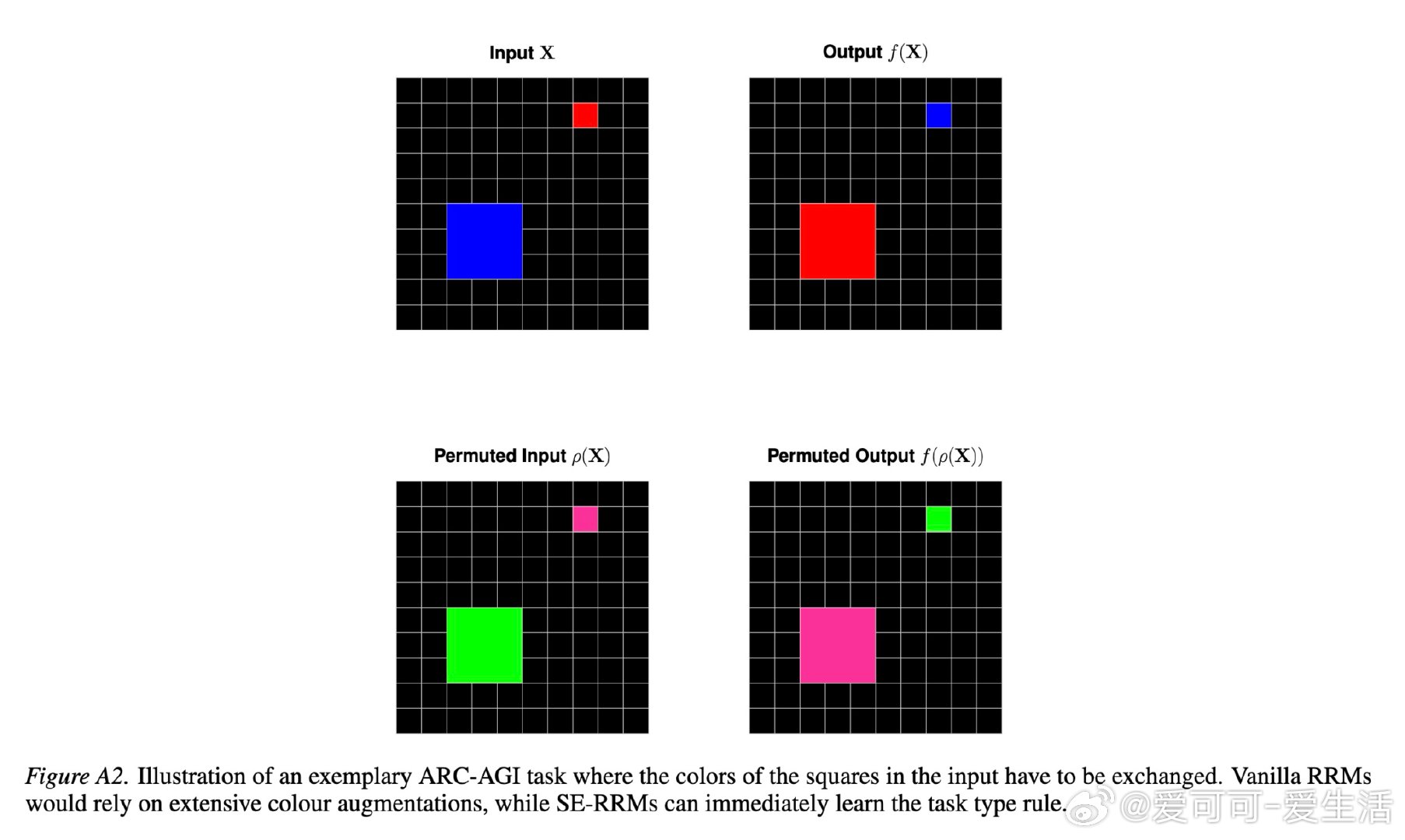

在符号推理领域,神经网络面对数独、ARC-AGI等约束满足问题时屡屡失手。现有循环推理模型(RRM)虽比大语言模型更紧凑,却把"数字1和数字4本质等价"这一事实藏在数据增强里——靠喂入千倍样本来学习对称性,本质是用蛮力掩盖架构缺陷。

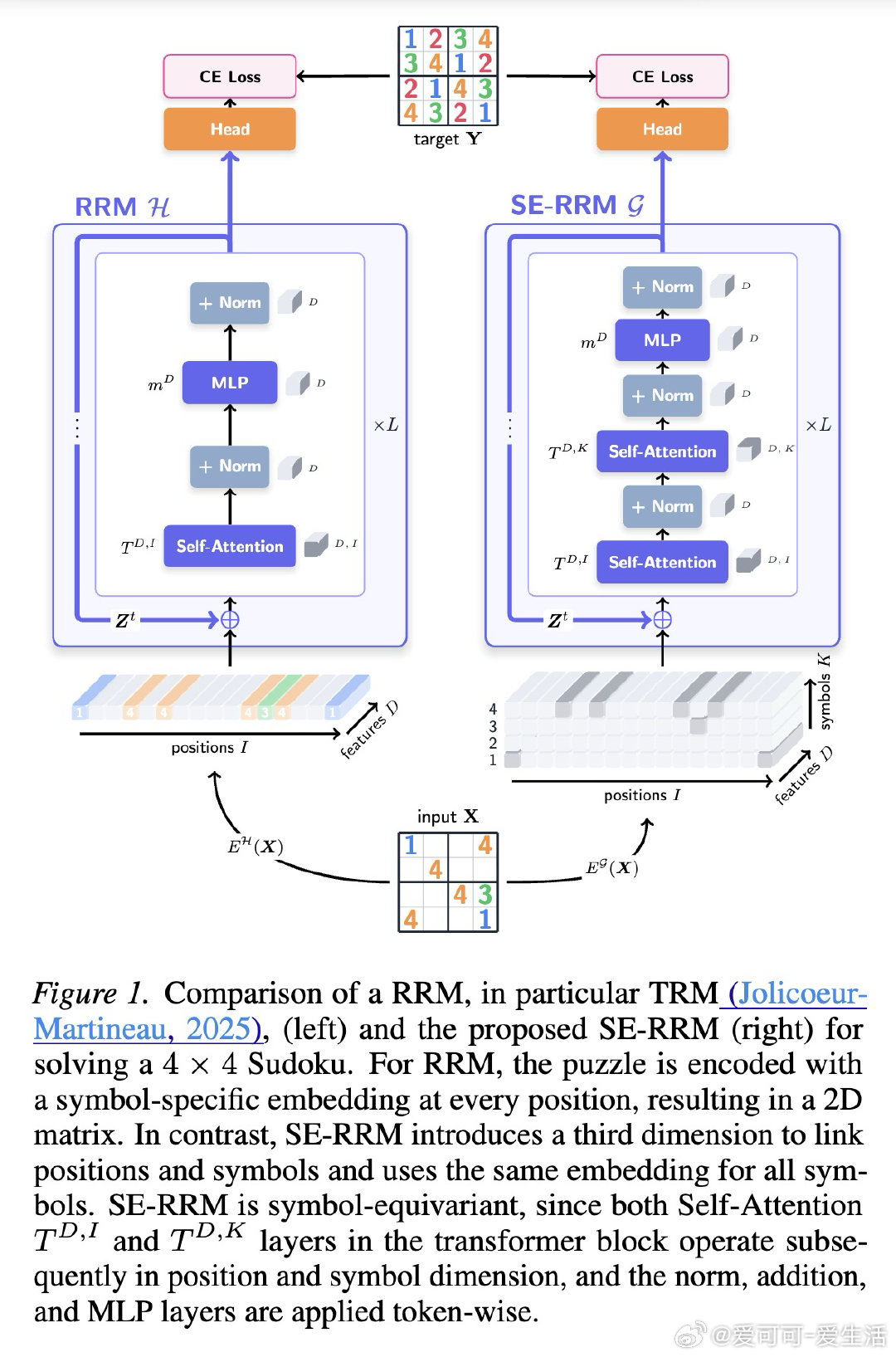

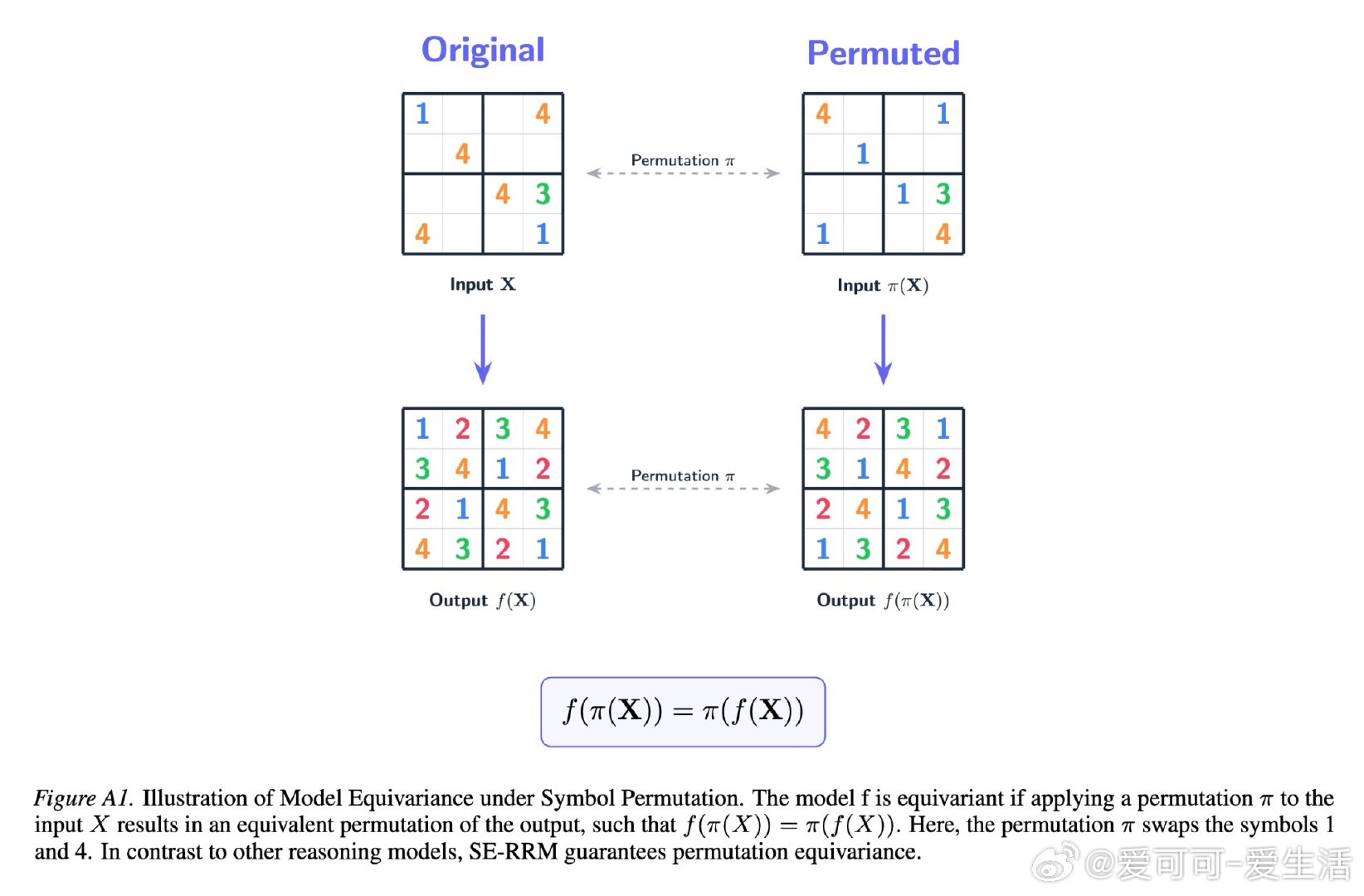

本文的核心洞见是:把符号(数字/颜色)重新看作一个独立的张量维度,而非嵌入特征的一部分。由此,沿符号维度增加一层轴向自注意力,使模型在架构层面天然保证——对输入符号做任意置换,输出跟着同步置换,无需额外训练数据。

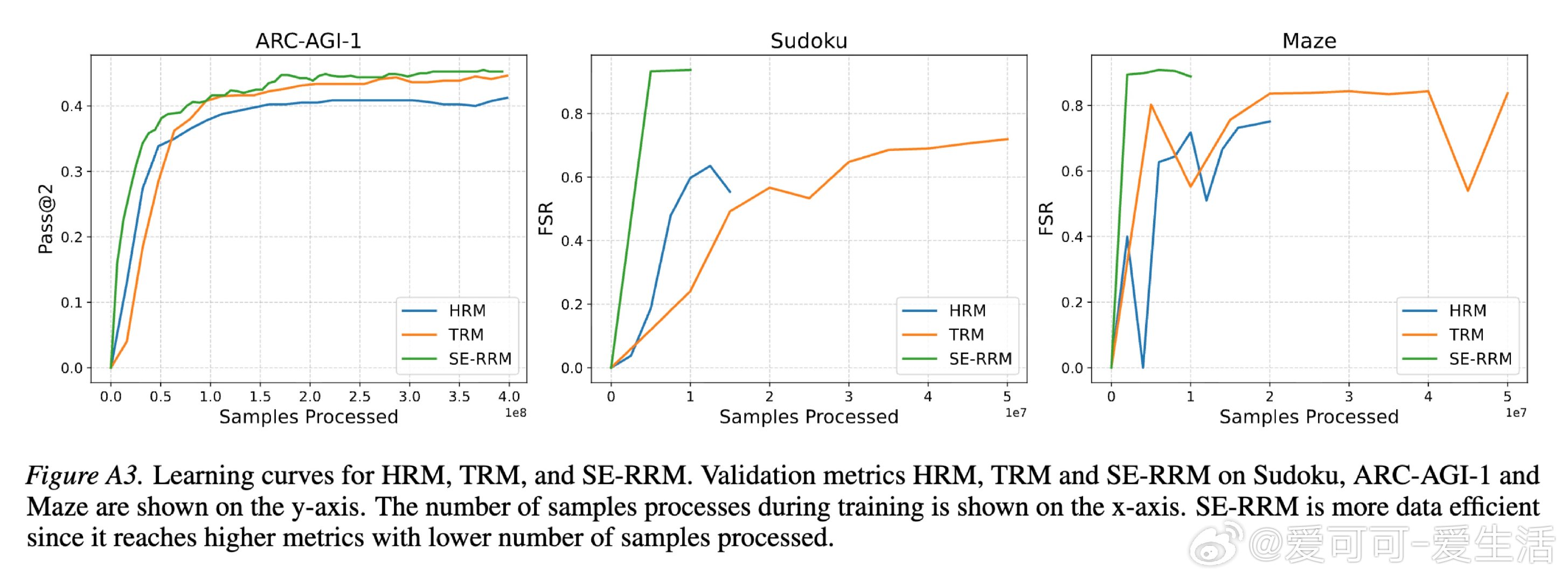

这项工作真正留下的遗产是:将对称性从"学习目标"变为"架构保证",用2M参数超越了27M的基线,并首次让循环推理模型从9×9数独零样本泛化到4×4和16×16网格。它为后来者打开的新门是:将轴向等变性嫁接到其他结构化推理场景——调度、规划、因果分析。但尚未跨过的门槛是:当符号数K远超位置数I时,计算复杂度反转,架构将不再适用。

arxiv.org/abs/2603.02193

机器学习 人工智能 论文 AI创造营