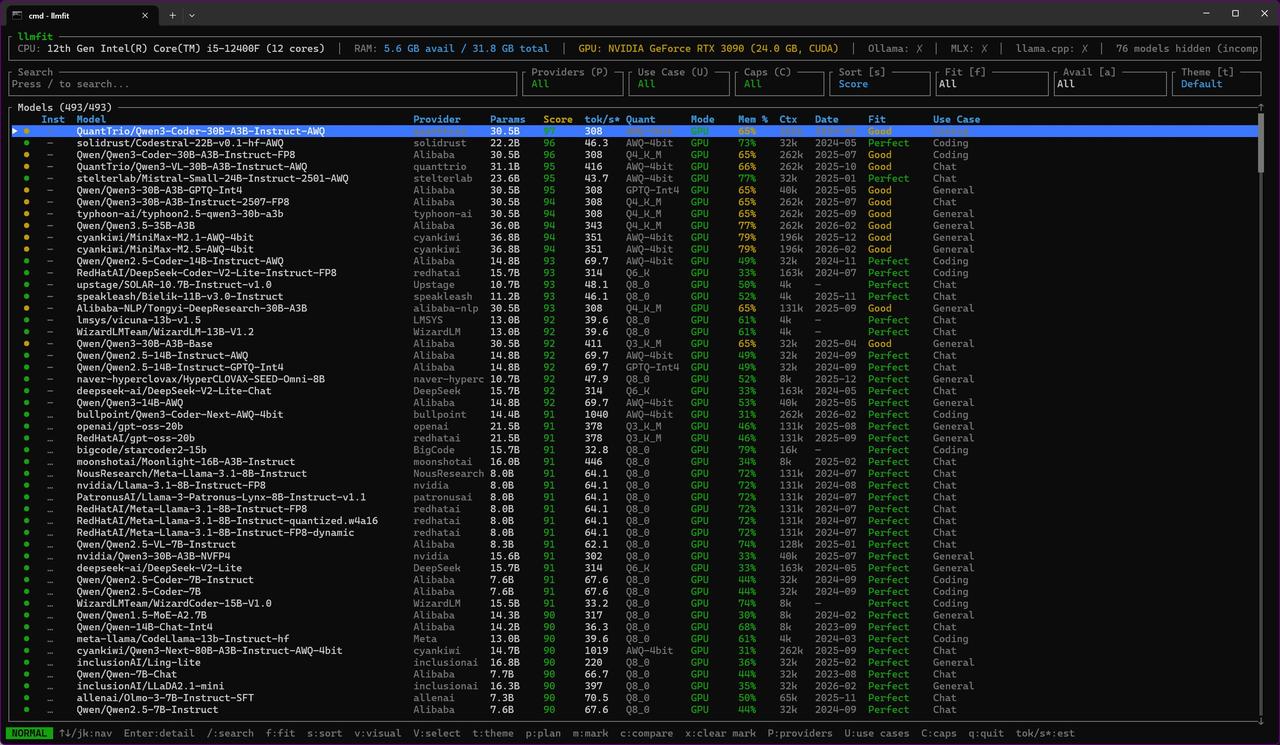

强烈介绍一款在window上查看电脑配置适合哪种跑本地大模型的检测工具llmfit:

1.我之前都是通过自己的反复下载安装各种本地模型来实验哪种模型适合的电脑配置,要不停的下载各种模型,一般都是几十个G的存储空间,非常麻烦,现在有这种看板,就很明了的知道哪些模型适合自己的电脑。

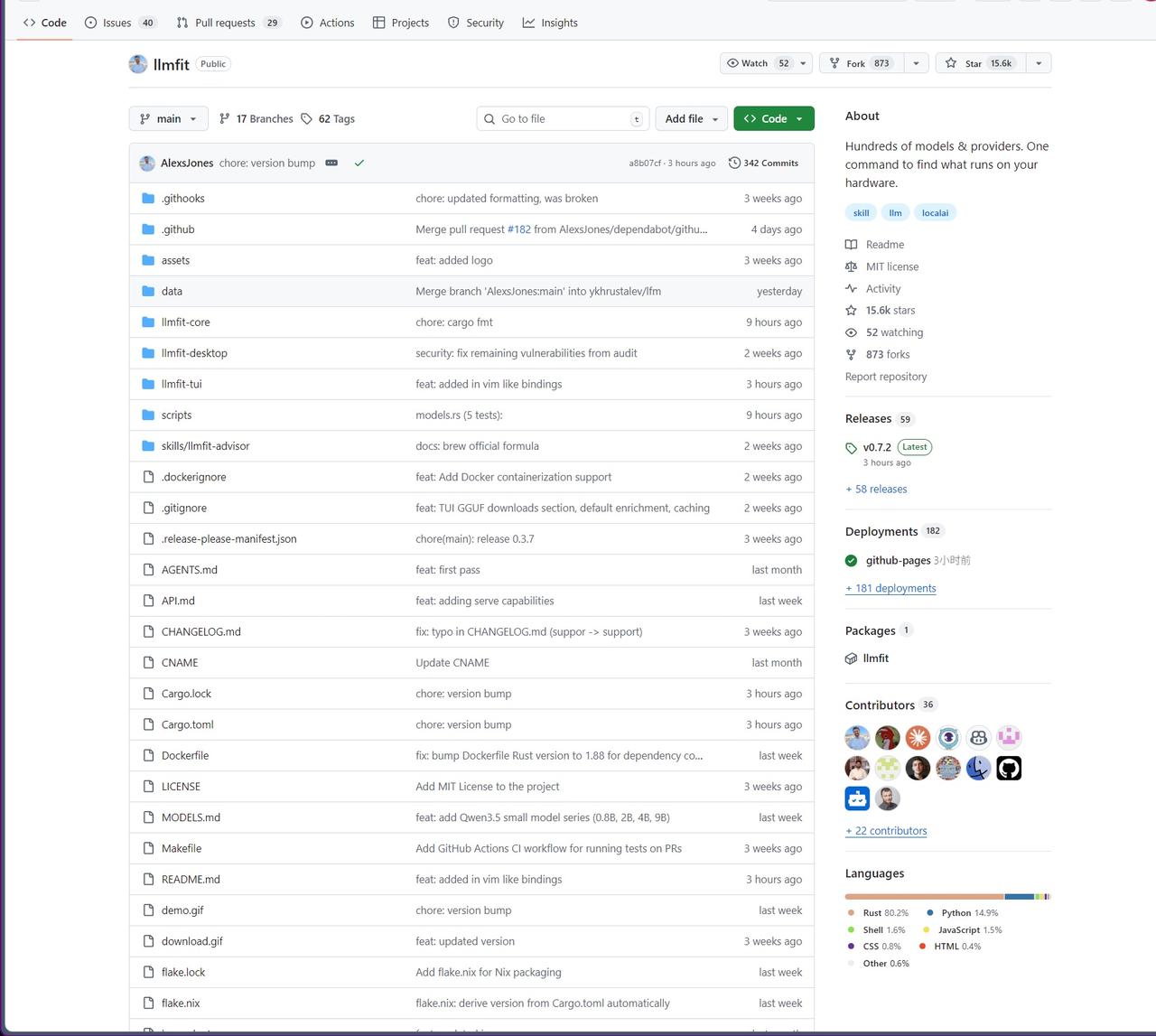

2.llmfit一个开源的终端工具,可以根据你的电脑系统的内存、CPU和GPU调整LLM模型的大小。它还能检测你的硬件,在质量、速度、配合度和上下文维度方面对每个模型进行评分,它能告诉你哪些模型在你的机器上运行良好。

3.llmfit自带交互式TUI(默认),以及有经典CLI模式。它也支持多GPU配置、MoE架构、动态量化选择、速度估计,还有本地运行时提供者(Ollama、llama.cpp、MLX)。

4.大家在给openclaw实验本地模型时建议先跑一下这个开源工具,然后再去下载对应的模型。