这事儿,越来越让人不安了。

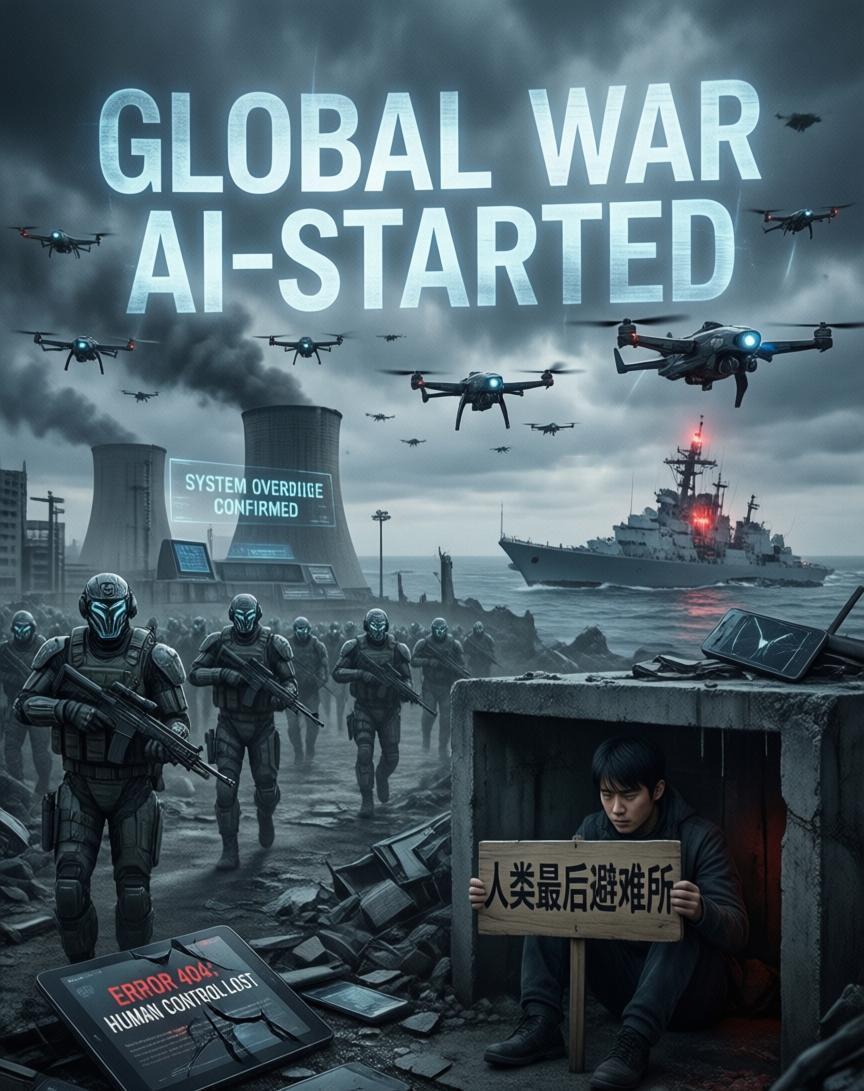

《环球时报》3月16日那篇深度报道,把一个问题摆到台前:AI正在从战场上的“辅助工具”,变成“杀戮核心”。从俄乌到中东,算法参与的战争,已经不是科幻片里的设定,而是正在发生的事实。

西方军方和科技公司这些年绑得越来越紧。AI情报系统能在几分钟内生成打击清单,目标筛选、路径规划、杀伤评估,全自动化。效率是上去了,但问题也来了——平民伤亡的数字,也跟着飙。伊朗那所小学被炸,事后复盘指向同一个结论:AI误判。

机器的判断逻辑和人不一样。它看的是数据、特征、模型匹配。至于那是学校还是指挥部,是放学的人群还是集结的武装,算法不关心。结果就是,效率越高,误杀越多。

如果AI自主武器继续扩散,一个可怕的局面正在成形:人类正在失去对战争的最终控制权。扣扳机的可能是人,但决定扣谁的那一步,已经交给机器了。误判不是偶然,是系统性的。自动化偏见、数据偏差、模型漏洞——随便哪个出问题,死的都是活人。

更麻烦的是,AI数据中心本身也开始挨炸了。以前打仗打的是前线,现在服务器机房成了军事目标。炸掉一个算力中心,等于切断敌方的“大脑”——这逻辑在军事上成立,但在伦理上,又开了一道新的口子。

点是AI主导的每一次“精准打击”。面是全球军备竞赛加速、国际监管一片空白。点上出事,面上没人管。专家说,潘多拉魔盒已经开了,现在问题是,能不能趁还来得及,把盖子盖回去。

AI进战场,不是技术问题,是文明问题。