前两天跟一个做AI的朋友聊天,他抱怨说现在选算力真头疼。

厂商宣传清一色是千卡集群、万卡超节点,参数一个比一个唬人。但他算了一笔账:千卡集群那是给头部大厂准备的,全国真正需要的也就那二三十家。他这种做企业服务的,要的是能跑起来、成本可控的东西,不是拿来当背景板的算力图腾。

我说那你现在用啥?他说8卡吧,跑千亿参数模型确实吃力,微调一次等得心焦;想上384卡吧,一看机房条件直接劝退——供电要改、制冷要加、空间要腾,折腾下来预算翻倍都不止。

这不就是典型的两头大、中间空吗?

聊着聊着,他说现在业内慢慢有个共识:32卡其实是千亿级大模型商业化的一条底线。低于32,你得缩着跑——参数切分、精度妥协,效果打折扣。

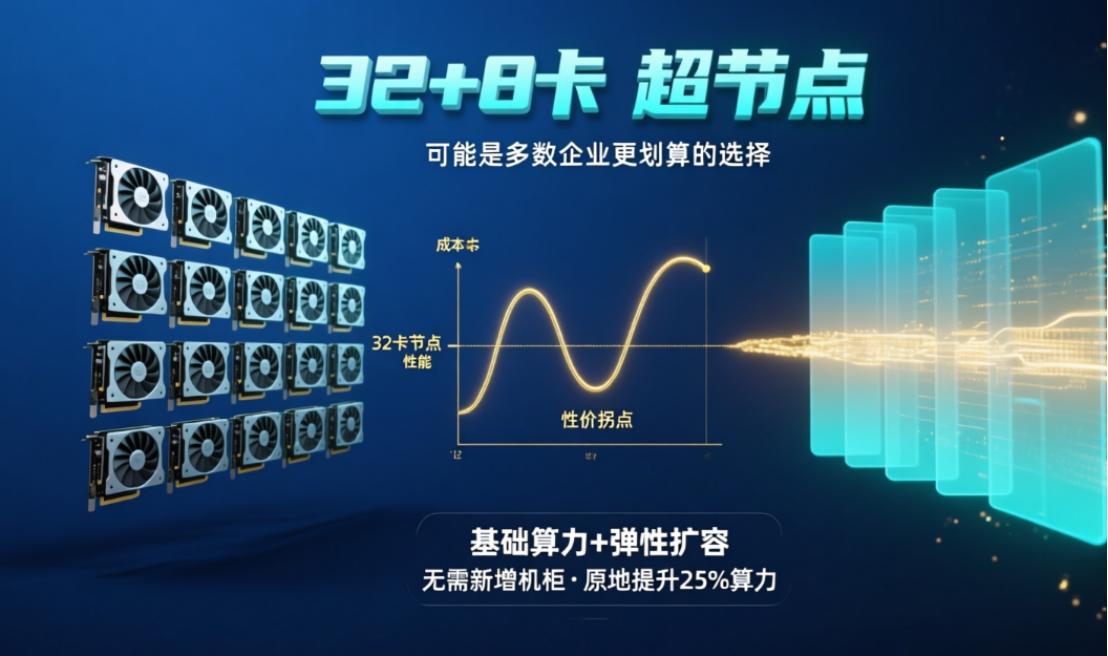

但问题是,32卡也只是“将将够用”——跑是能跑,但batch size不敢调大,训练时间拖得长,业务高峰期还得排队等资源。市面上从32直接跳到64,64又太贵,机房条件也跟不上。大部分小规模规模的企业,高不成低不就,卡在中间最难受。

我们一致觉得,要是能有40卡或者48卡就好了,性能宽松一点,心里也踏实。

至于甄别产品好坏,就一句话:问销售,能不能实现32到40、48的原地扩容? 能,说明产品真为企业落地想过;不能,那就是参数竞赛的产物。

聊完我觉得挺有道理。算力这东西,核心价值是帮企业把业务跑起来,不是拿来秀肌肉的。32+8这个规格,确实值得更多成长型企业看一看。

和朋友聊算力 GTC