[LG]《Transformers are Bayesian Networks》G Coppola [coppola.ai] (2026)

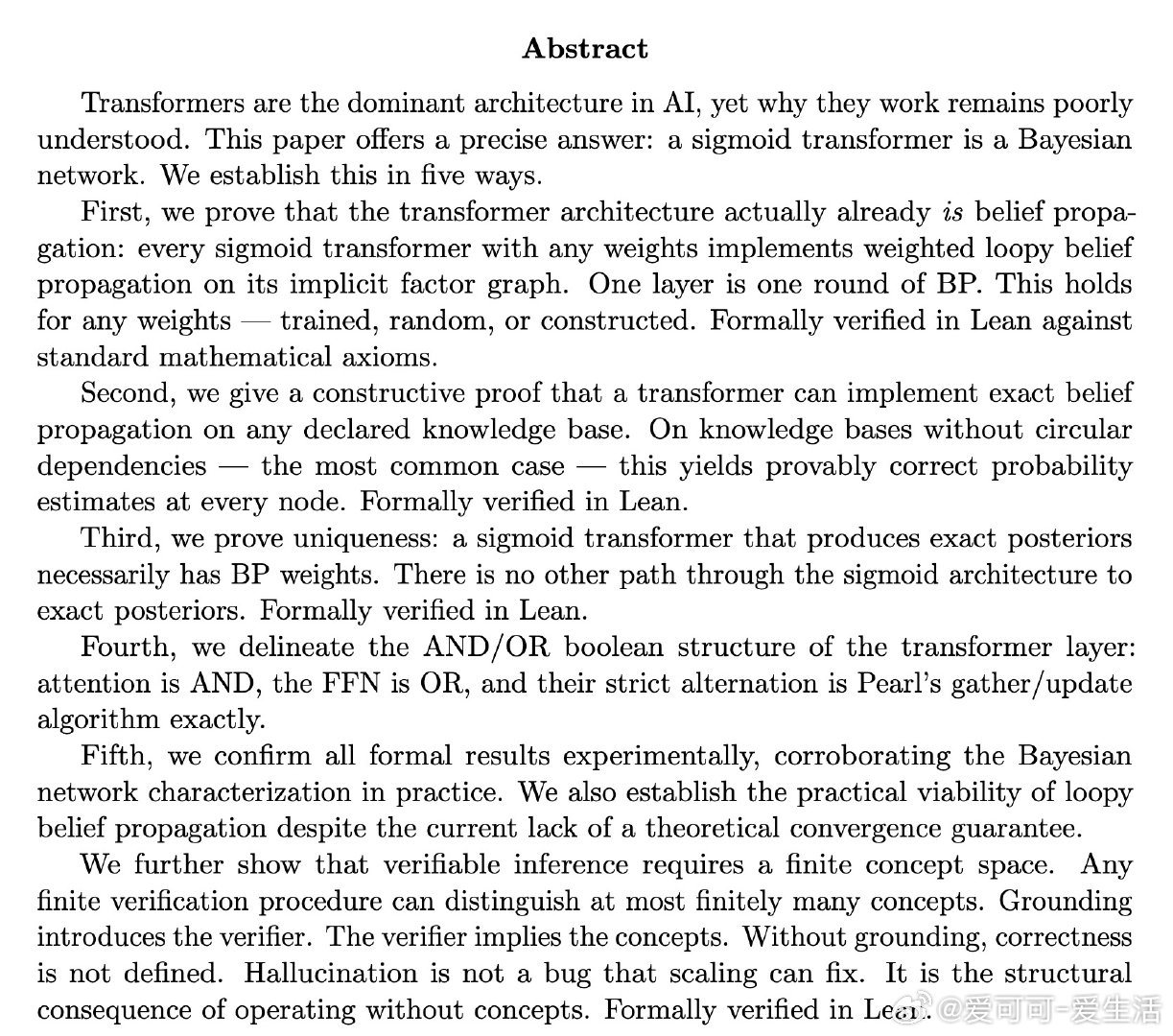

在神经网络领域,「Transformer为何有效」是一个悬而未决的问题。现有解释停留在经验层面——注意力机制学到了什么,FFN记忆了什么——却无法回答「这个计算结构在数学上是什么」。缺乏这一答案,幻觉、可靠性、可验证性等问题便无从精确定义。

本文的核心洞见是:把sigmoid激活函数重新看作概率空间与对数几率空间之间的同构映射。由此,注意力层=收集步骤(AND:将邻节点信念同时写入残差流),FFN层=更新步骤(OR:用对数几率加法计算后验概率),二者严格交替即为Pearl的置信传播算法。对任意权重,这一等价关系成立,并在Lean 4中完成形式化验证。

这项工作真正留下的遗产是:为Transformer提供了一个精确的数学身份——它是贝叶斯网络,而非近似物。它为后来者打开的新门是:在树形知识库上实现可证明无幻觉的推理,以及将幻觉重新定义为「无概念运作的结构性后果」而非工程缺陷。但尚未跨过的门槛是:循环图上的收敛性缺乏理论保证,「接地(grounding)」本身的实现在现实规模知识库中仍是开放挑战。

arxiv.org/abs/2603.17063

机器学习 人工智能 论文 AI创造营