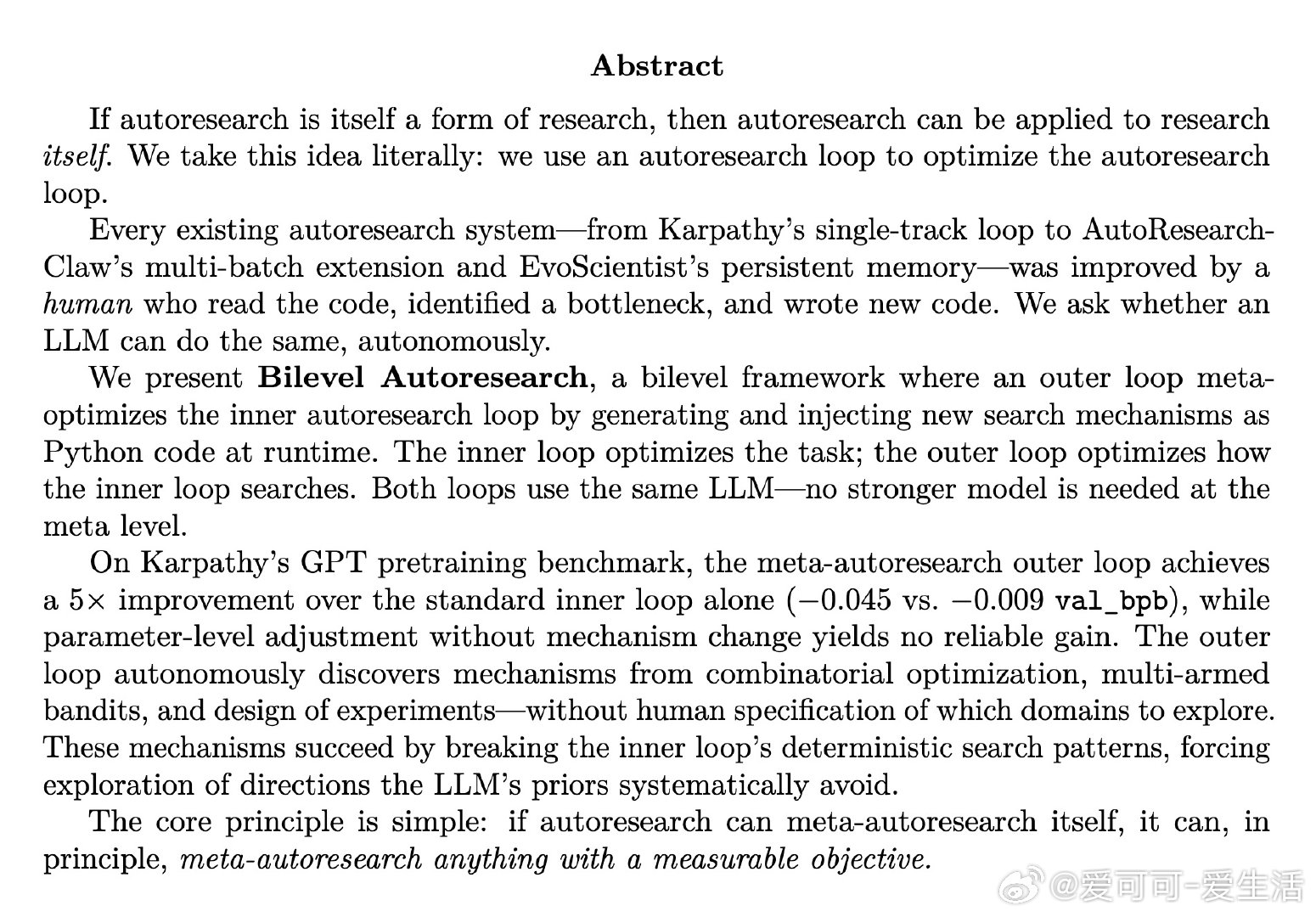

[AI]《Bilevel Autoresearch: Meta-Autoresearching Itself》Y Qu, M Lu (2026)

自动化研究流水线的搜索机制被人类工程师硬编码,LLM 只能在既定框架内提议参数、执行实验、接受或拒绝——它看不见、也改不了"搜索本身"这件事。根本原因是:所有系统的结构决策(何时接受、如何提议、维护何种状态)均由人类在设计时写死,系统无法自我重构。

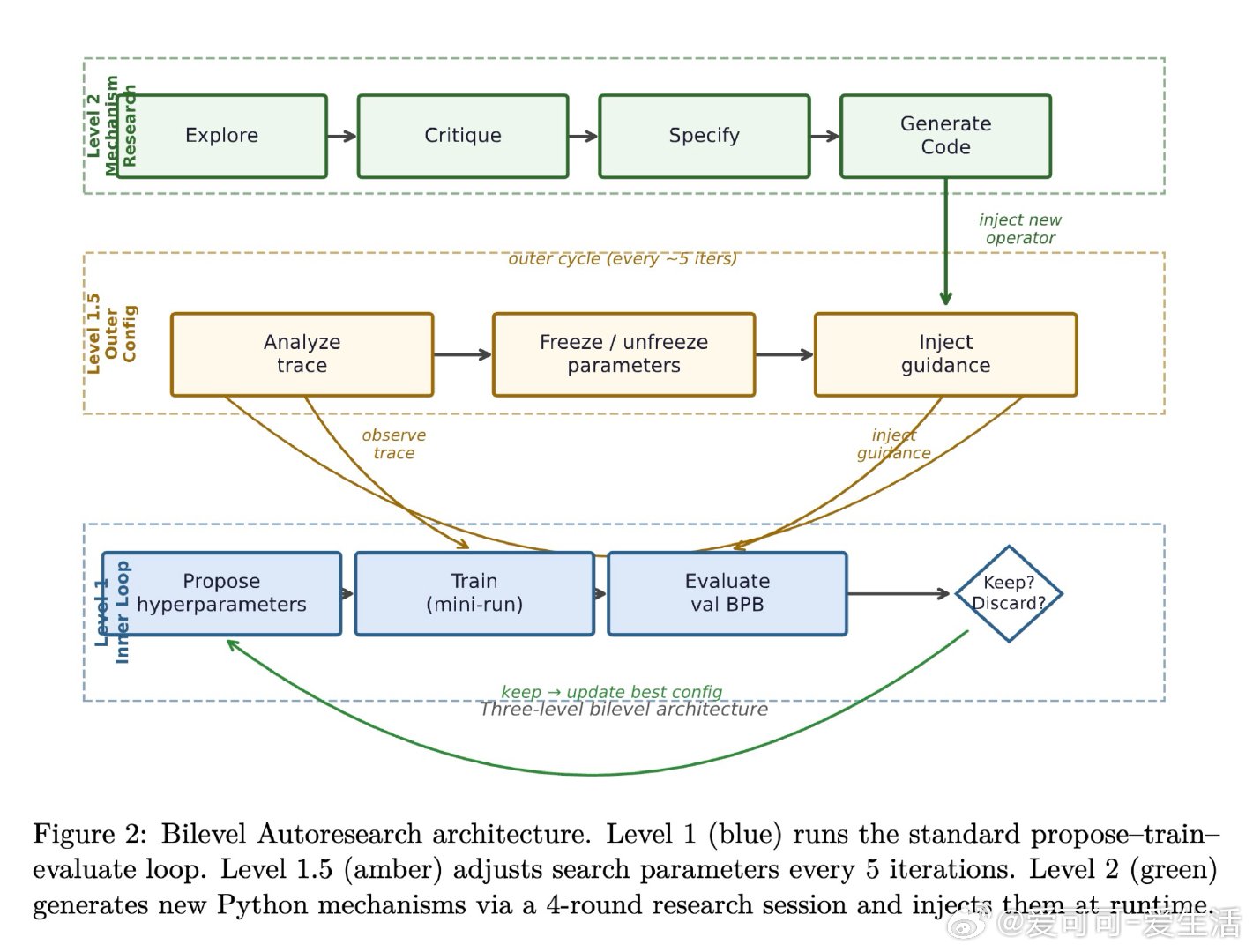

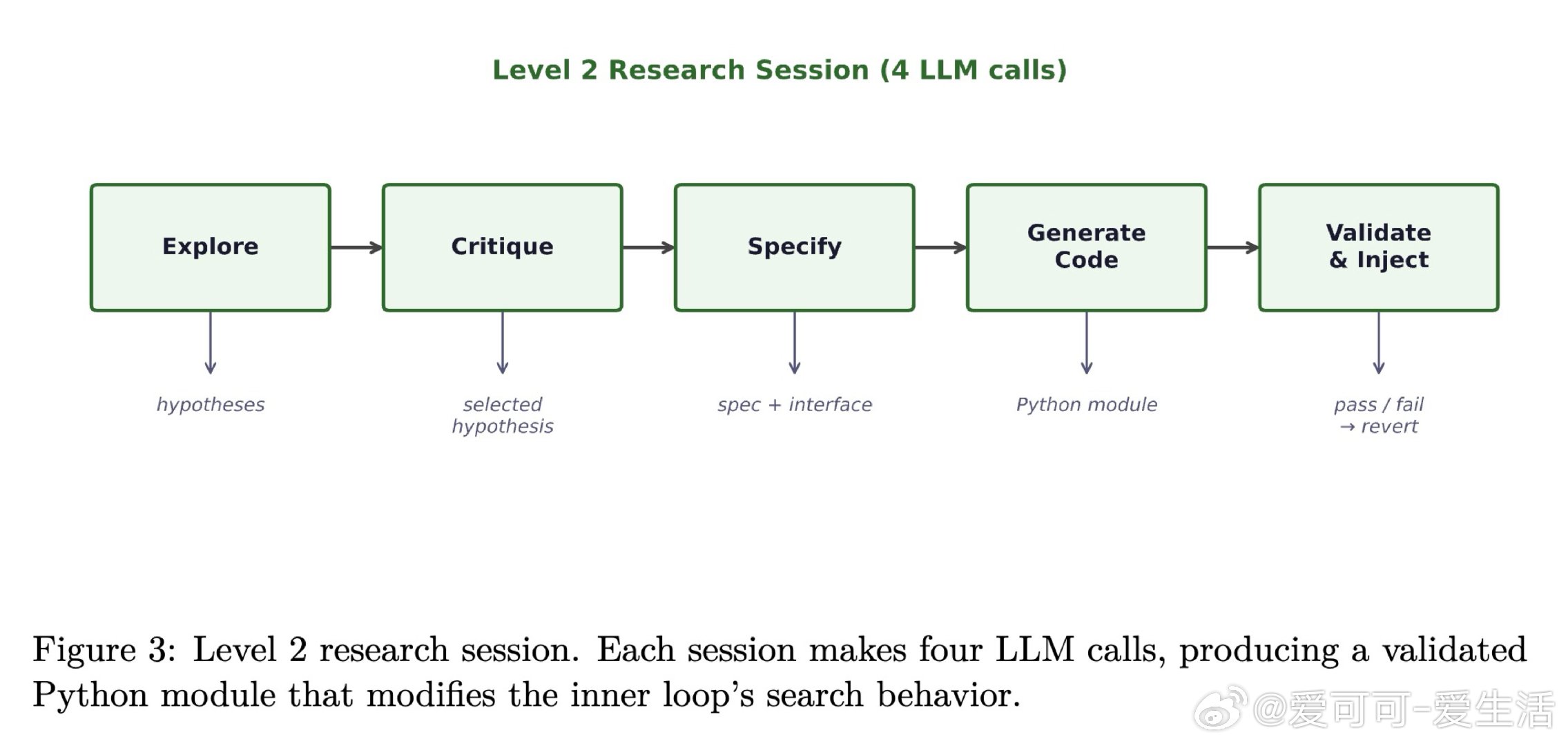

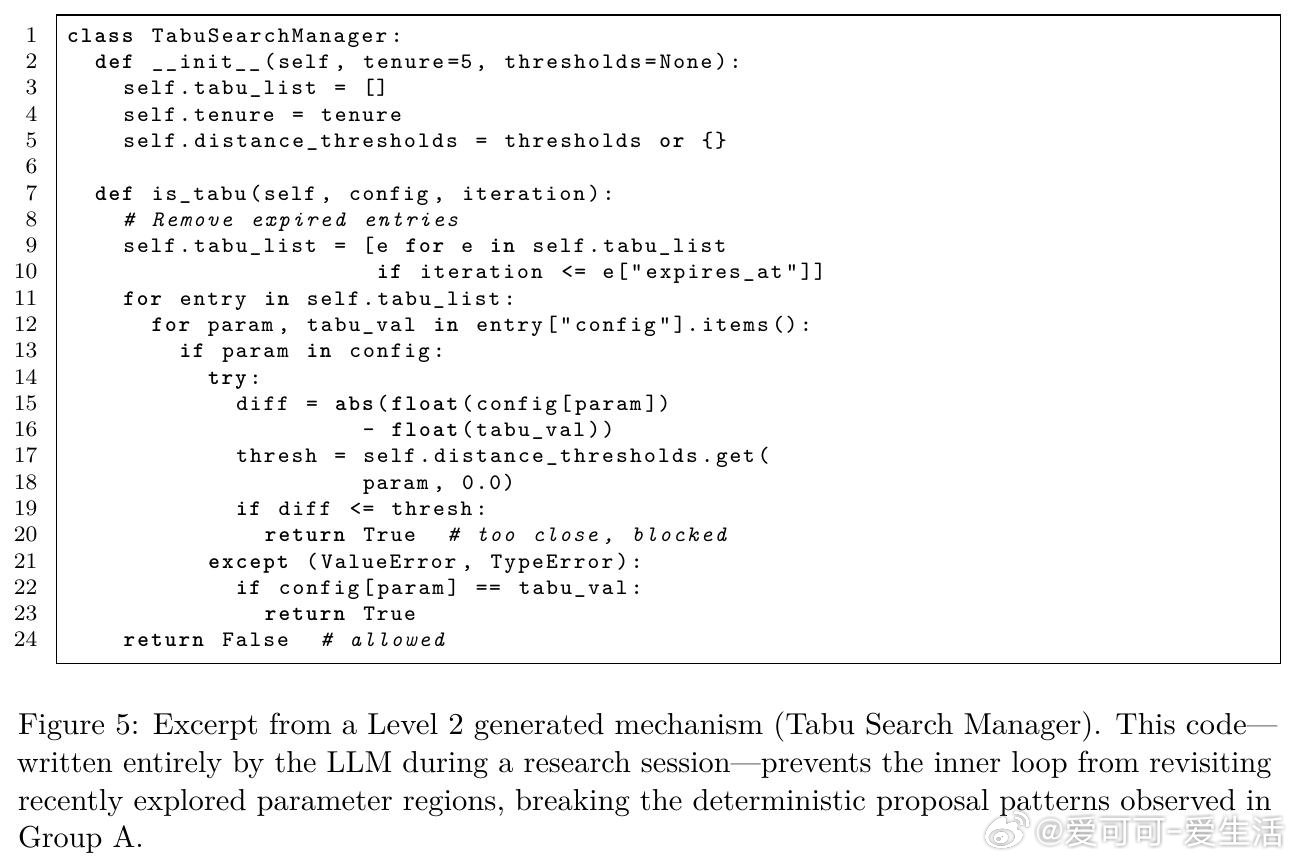

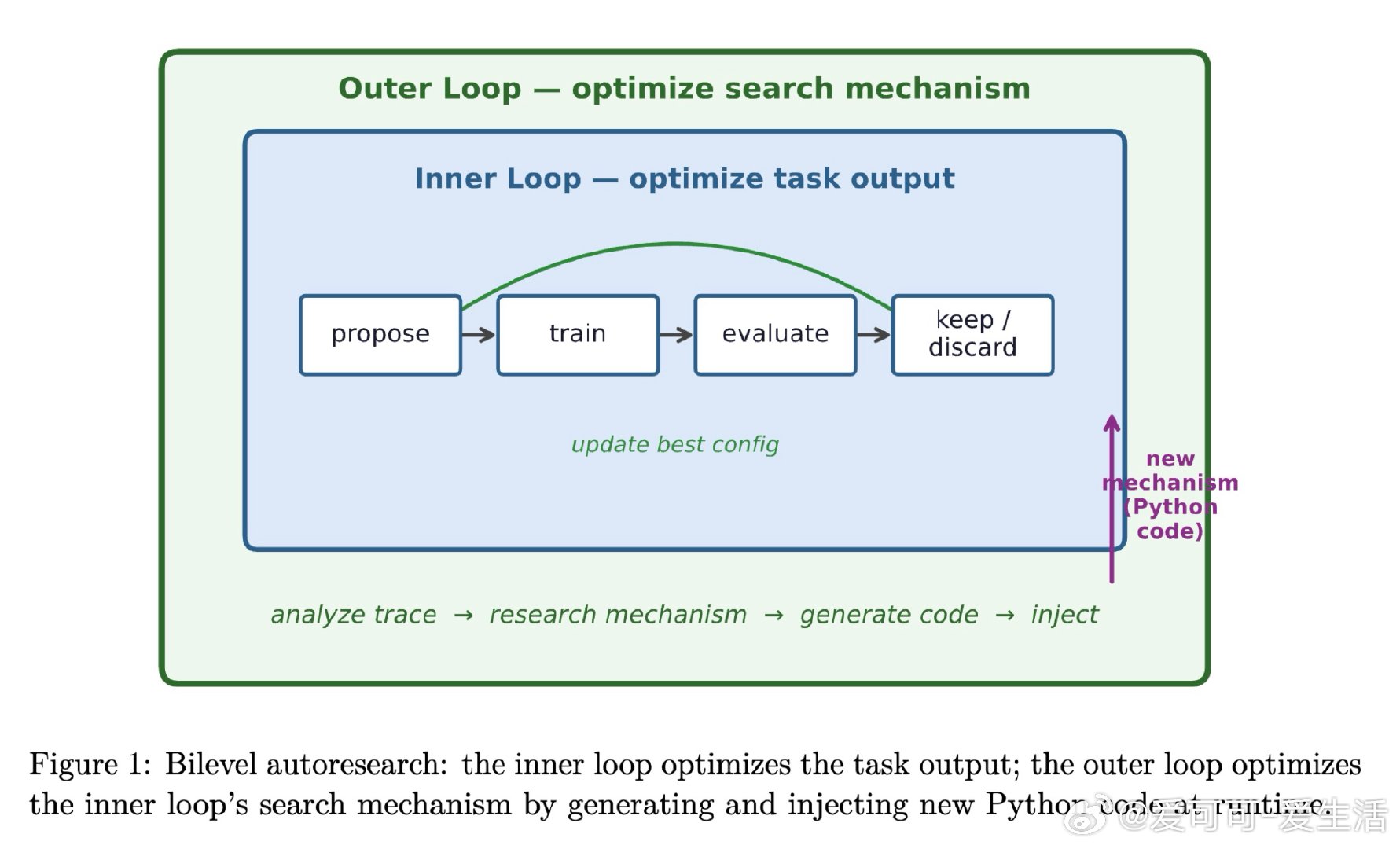

本文的核心洞见是:把"改进搜索机制"本身重新看作一个可被搜索的研究任务。由此,外层循环读取内层循环的源代码与执行轨迹,通过四轮结构化对话生成新的 Python 搜索算子并在运行时注入,这一"代码即参数"的操作使双层嵌套自举成为可能。LLM 无需升级,同一个模型既跑内层又写外层。

这项工作真正留下的遗产是:证明了"自动化研究可以研究自己"——外层改进不再需要人类读代码、写补丁。它为后来者打开的新门是:任何具有可测量目标的系统,原则上都可以用同样的双层框架自我迭代结构。但尚未跨过的门槛是:每组仅三次重复、单一基准、运行时代码注入的脆弱性,以及提示词本身暗中约束了外层能"想到"的机制范围。

arxiv.org/abs/2603.23420

机器学习 人工智能 论文 AI创造营