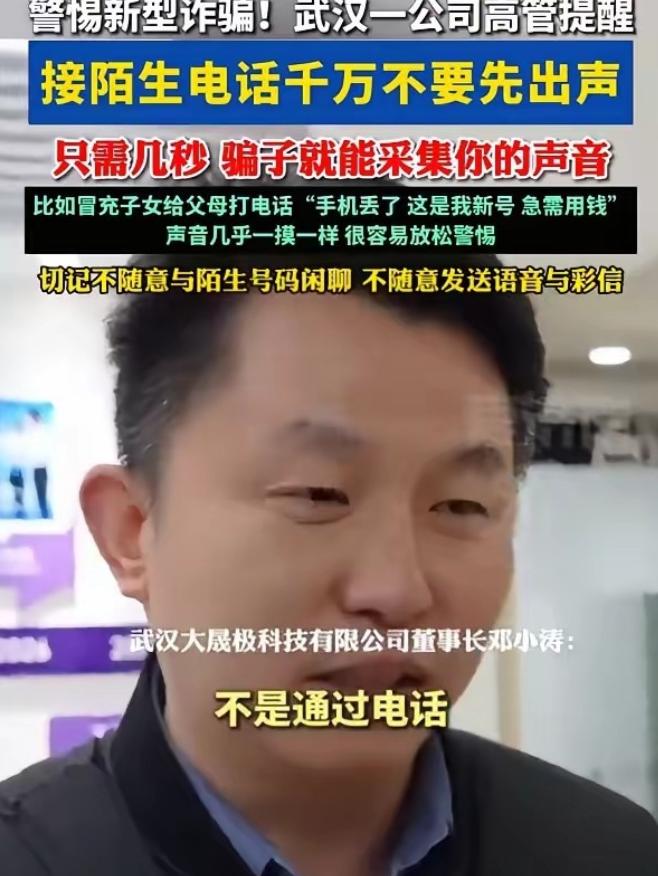

防不胜防!湖北武汉,一科技公司高管在接受采访时提醒,接到陌生电话时不要先出声,不要以为识别出对方是诈骗电话就放下戒备,因为我们的声音只需要几秒钟就可能被对方用AI采集下来,到时候受骗的可能就是家人了。

近日,多地接连发生AI声音克隆诈骗案件,不少家庭因此蒙受巨额损失,有的老人被骗走一辈子的积蓄,有的企业负责人短短十分钟就损失数百万元,这些受害者并非粗心大意,却都栽在了看似不起眼的声音泄露上。

更令人揪心的是,此类诈骗案件还在持续上涨,骗子的手段隐蔽又狡猾,让很多人防不胜防。

这一切的背后,都是AI声音克隆技术被不法分子滥用的结果,而这也正是武汉一位科技公司高管在接受采访时着重提醒大家的重点。

之所以会出现如此多的AI声音克隆诈骗,核心原因在于技术门槛的降低和大众反诈认知的滞后。

如今,AI语音合成技术已经发展到极低样本学习阶段,不再需要大量语音素材,仅仅5到10秒的清晰声音,就能精准提取一个人的声纹特征,就像给声音做了一份独一无二的DNA指纹,无论是音色、语调,还是语速和细微的发音习惯,都能被完美复刻。

更可怕的是,网上随处可见低成本的声音合成工具,骗子不需要复杂的操作,不到一分钟就能生成一段普通人根本分辨不出真伪的语音,这也让诈骗行为变得更加容易实施。

与此同时,很多人还在用老一套的反诈思路,总觉得自己警惕性高,能够识破诈骗套路,却忽略了最基础的声音泄露风险。

大多数人接到陌生电话时,都会下意识地说一句“喂,你好”,就是这短短几秒的声音,就可能被骗子悄悄采集。

骗子通常会伪装成快递员、客服或者市场调研人员,用无关紧要的话题诱导人们开口,很多人挂了电话还浑然不觉,殊不知自己的声音已经被骗子获取,为后续的诈骗埋下了巨大隐患。

武汉大晟极科技有限公司的董事长邓小涛,深耕声纹识别领域多年,他在接受采访时提醒,接到陌生电话时不要先出声,不要以为识别出对方是诈骗电话就放下戒备,因为我们的声音只需要几秒钟就可能被对方用AI采集下来,到时候受骗的可能就是家人了。

骗子的诈骗流程环环相扣,每一步都精准抓住了人们的心理弱点。

他们先通过陌生电话、社交平台语音留言等多种渠道,采集到目标人物的声音,再用AI技术合成语音,然后结合非法获取的家庭信息,冒充目标人物的亲友、同事甚至领导,编造紧急场景实施诈骗。

有一位老人,就接到了冒充自己孙子的电话,电话里的声音和孙子一模一样,还带着哭腔说自己打架撞伤了人,急需医药费。

老人心疼不已,丝毫没有怀疑,连夜凑齐16万元转给了对方,直到事后联系上真正的孙子,才知道自己被骗,而那通电话里的声音,仅仅是骗子用之前采集到的3秒语音克隆出来的。

还有一位企业负责人,接到了“好友”的求助电话,对方不仅声音和好友别无二致,还能精准说出两人过往的合作细节,一番焦急的求助后,企业负责人在短短10分钟内就被骗走了430万元。

这些案例都让人警醒,骗子刻意营造出紧急氛围,反复强调“别告诉别人”“马上转钱不然来不及”,就是为了让受害者没有时间冷静思考,利用情绪压倒理性,从而达到诈骗的目的。

这些案例的发生,恰恰印证了那位科技公司高管的提醒,很多人就是因为没有重视陌生电话的声音泄露风险,才让骗子有了可乘之机,最终连累家人蒙受损失。

面对日益猖獗的AI声音克隆诈骗,国家也在加大打击和监管力度。

2025年,公安部组织全国公安机关开展AI诈骗专项打击整治行动,全年打掉利用AI技术实施诈骗的团伙超过170个,还打掉了各类非法提供声音合成服务的黑产窝点320余个,抓获涉案嫌疑人两千多名,从源头压缩了黑产生存空间。

同时,国家网信办也出台了相关细则,要求所有提供公开语音合成服务的平台落实用户实名制,对合成内容做水印标注,还要对生成的语音数据留痕备查,从技术层面堵住骗子可利用的漏洞。

对于普通民众来说,防范此类诈骗其实并不复杂,关键在于守住底线、改变习惯。

接到陌生电话时,一定要等对方先开口,如果对方迟迟不说话,或者只是诱导自己开口,直接挂断即可。

平时不要和陌生号码闲聊,不要随意发送语音、彩信,更不要在公开网络平台发布带有自己声音的内容。

遇到自称亲友、同事的求助电话,哪怕声音再熟悉,涉及转账、借钱等事宜,都不能仅凭电话就相信,一定要通过原号码回拨、视频通话或者联系其他家人等方式核实情况。

如今,AI技术给我们的生活带来了诸多便利,但也被不法分子当成了诈骗工具。

唯有提高警惕,更新反诈认知,才能守住自己和家人的钱袋子,避免被骗子有机可乘。

如果各位看官老爷们已经选择阅读了此文,麻烦您点一下关注,既方便您进行讨论和分享,又能给带来不一样的参与感,感谢各位看官老爷们的支持!