技术巡猎 比亚迪 音频分离模型训练方法、音频分离方法、用电设备及介质。在车机这种算力没那么阔绰的平台上,轻量级音频分离模型怎么样才可以训练得更稳定、收敛更快呢?比如说,一段音频里,混着人声和背景音乐,系统想把里面的背景音乐单独拎出来,尽量把人声剥掉,怎么做?

原文给了两套损失函数,然后做了融合。第一套叫目标能量加权损失。一段混合音频里,人声不是每一帧都一样响。有的地方是清唱,人声特别突出;有的地方伴奏很强,人声只是薄薄一层。如果训练的时候所有片段都一视同仁,模型就容易顾头不顾尾,真正最容易露馅的地方反而学得不够。比亚迪这里先去算每一帧里目标音频和背景音频的能量占比,再给这一帧一个权重。人声越强,那一帧的权重越高,模型就会更认真地去消掉这部分干扰。

背后的逻辑很接地气。人耳对“残留人声”特别敏感,尤其是在伴奏本来就弱、或者人声特别突出的地方,哪怕漏一点,听起来都很明显。所以这套方法不是简单追求整体平均分,而是盯着最容易被听出来的问题下手。这样做的目的,可以让模型优先优化目标音频能量高的区域,减少人声残留,改善最后的听感。

第二套叫时域分频损失。这部分也很有意思。它承认一个很朴素的事实:音频不是所有频段都一样重要。专利里先把音频按频段切开,比如0-800Hz、800-4000Hz、4000Hz以上,分别对应低频、中频、高频。人声很多关键信息,往往集中在低频和中频,高频里更多是泛音、空气感或者乐器的亮部。那训练的时候,如果不分频段,模型可能在不那么重要的地方也花了不少力气,真正该重点优化的人声频带反而不够精准。

所以它的做法,是把估计输出和真实背景音频都拆成多个子带,然后每个子带分别算误差,再按重要性给不同频段配权重。人声更集中的低中频,权重大一点;没那么关键的高频,可以轻一点。这个思路很像修车时先看主问题而不是边角料。方向盘跑偏、制动异响和雨刷声,你处理优先级肯定不一样。音频分离也是一样,频段有主次,训练就不该一碗水端平。

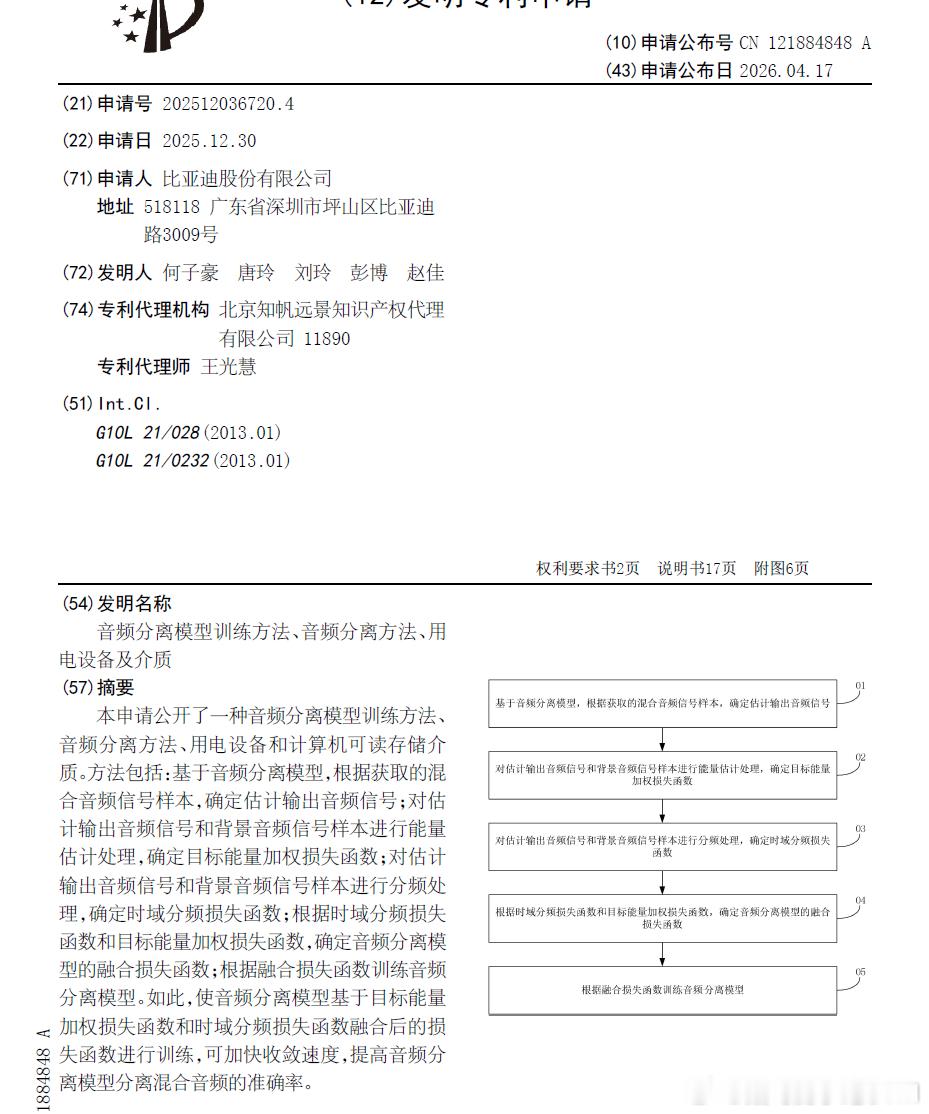

到这里,这份专利的味道就出来了。它其实是在做更细的资源分配:按时间帧挑重点,按频段再挑重点。一个看哪里人声最强,一个看哪些频段最值得盯住。最后再把这两套逻辑合成一个融合损失函数,让模型在训练时同时兼顾稳定性、收敛速度和分离精度。这种融合可以通过线性加权来实现,还可以根据训练状态去调两个损失项的权重比例。

更进一步的地方在后面。它不只做“帧级加权”和“频段加权”这两个动作,在每个频段内部,还看目标音频在这一段里的能量分布。也就是说,它不是只告诉模型“低中频重要”,而是继续告诉它“低中频里这几帧尤其重要”。

另外,背景音频样本和目标音频样本是按预设能量比例去混合的,而且是一帧一帧对应混合的。这个动作的价值在于,模型不是只在一种固定强弱关系下学习,而是能看到更多不同的人声/伴奏搭配情况。可以这么理解它,它不是只拿“标准题”练习,而是故意把题目难度拉开,让模型更适应真实世界里各种乱七八糟的音频情况。

为什么这种专利会出现在车企手里?原因也不复杂。现在车载座舱早就不是放歌这么简单了,K歌、语音、视频、会议、娱乐编辑,这些需求都在往车里走。但车不是录音棚,也不是云端大机房,车机的芯片算力、功耗、实时性都要算账。大模型当然能做很多事,可最后落到量产车上,真正决定体验的,是“在现有硬件上跑起来够不够稳定、够不够快”。

于是这份专利的路径就很典型:一味堆模型规模没意思,不如让轻量模型学得更有针对性。