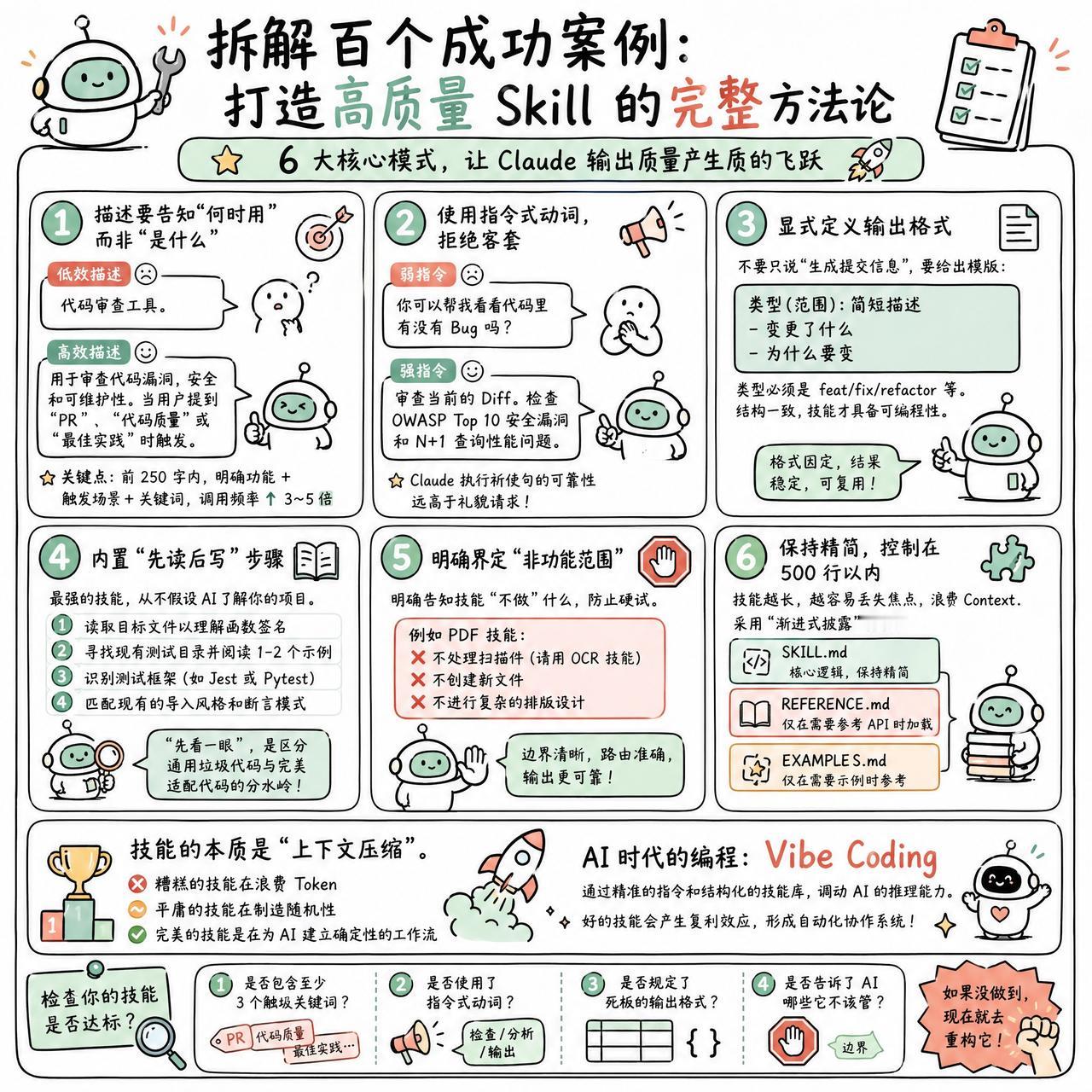

【拆解百个成功案例:打造高质量 Skill 的完整方法论】

为什么你的 AI Skill 总是失效?因为大多数人只把它当成对话,而顶级的 Skill 是一套精密设计的指令解剖学。

通过对 100 个最成功案例的逆向工程,作者总结出了构建“完美技能”的 6 大核心模式。掌握这些,你就能让 Claude 的输出质量产生质的飞跃。

模式 1:描述要告知“何时用”,而非“是什么”

这是最关键的字段。Claude 在加载技能前会扫描所有描述。如果描述太简略,它就不知道什么时候该召唤这个技能。

低效描述:代码审查工具。

高效描述:用于审查代码漏洞、安全和可维护性。当用户提到“PR”、“代码质量”或“最佳实践”时触发。

关键点:在描述的前 250 个字符内,明确告知功能 + 触发场景 + 关键词。研究显示,完善触发上下文的技能,被调用的频率比简略描述高出 3 到 5 倍。

模式 2:使用指令式动词,拒绝客套

技能是指令集,不是聊天。不要用“请问你能否...”,要用“检查...”、“分析...”、“输出...”。

弱指令:你可以帮我看看代码里有没有 Bug 吗?

强指令:审查当前的 Diff。检查 OWASP Top 10 安全漏洞和 N+1 查询性能问题。

Claude 执行祈使句的可靠性远高于礼貌的请求。

模式 3:显式定义输出格式

这是大多数自定义技能失败的主因。如果你不规定格式,Claude 每次都会随机发挥,导致结果无法复用。

不要只说“生成提交信息”,要给出模版:

类型(范围): 简短描述

- 变更了什么

- 为什么要变

明确规定类型必须是 feat/fix/refactor 等。只有结构一致,技能才具备可编程性。

模式 4:内置“先读后写”步骤

最强的技能从不假设 AI 了解你的项目。它会强制 AI 先进行环境感知。

以 /test 技能为例,它不会直接写测试,而是要求:

1. 读取目标文件以理解函数签名。

2. 寻找现有测试目录并阅读 1-2 个示例。

3. 识别测试框架(如 Jest 或 Pytest)。

4. 匹配现有的导入风格和断言模式。

“先看一眼”是区分“通用垃圾代码”与“完美适配项目代码”的分水岭。

模式 5:明确界定“非功能范围”

这听起来反直觉,但非常有效。明确告知技能“不做”什么,能防止 AI 在无法处理的任务上硬试。

例如 PDF 技能应注明:不处理扫描件(请用 OCR 技能),不创建新文件。

当边界清晰时,Claude 会更准确地进行任务路由,而不是给出错误的输出。

模式 6:保持精简,控制在 500 行以内

技能文件每被调用一次,就会占用大量的 Context 预算。过长的技能会导致 AI 在执行到一半时丢失焦点。

如果技能变得复杂,请使用“渐进式披露”模式:

SKILL.md(核心逻辑,保持精简)

REFERENCE.md(仅在需要参考 API 时加载)

EXAMPLES.md(仅在需要示例时参考)

技能的本质是“上下文压缩”。一个糟糕的技能在浪费 Token,一个平庸的技能在制造随机性,而一个完美的技能是在为 AI 建立一套确定性的工作流。

AI 时代的编程不再仅仅是写代码,而是“Vibe Coding”——通过精准的指令和结构化的技能库,调动 AI 的推理能力。

同样的 Claude,在不同技能库的驱动下,输出质量天差地别。好的技能会产生复利效应:随着你技能库的完善,Claude 会越来越懂你的工作习惯,最终形成一个自动化的协作系统。

检查一下你那些不常用的技能:

1. 是否包含至少 3 个触发关键词?

2. 是否使用了指令式动词?

3. 是否规定了死板的输出格式?

4. 是否告诉了 AI 哪些它不该管?

如果没做到,现在就去重构它。

x.com/zodchiii/status/2048345453096313005