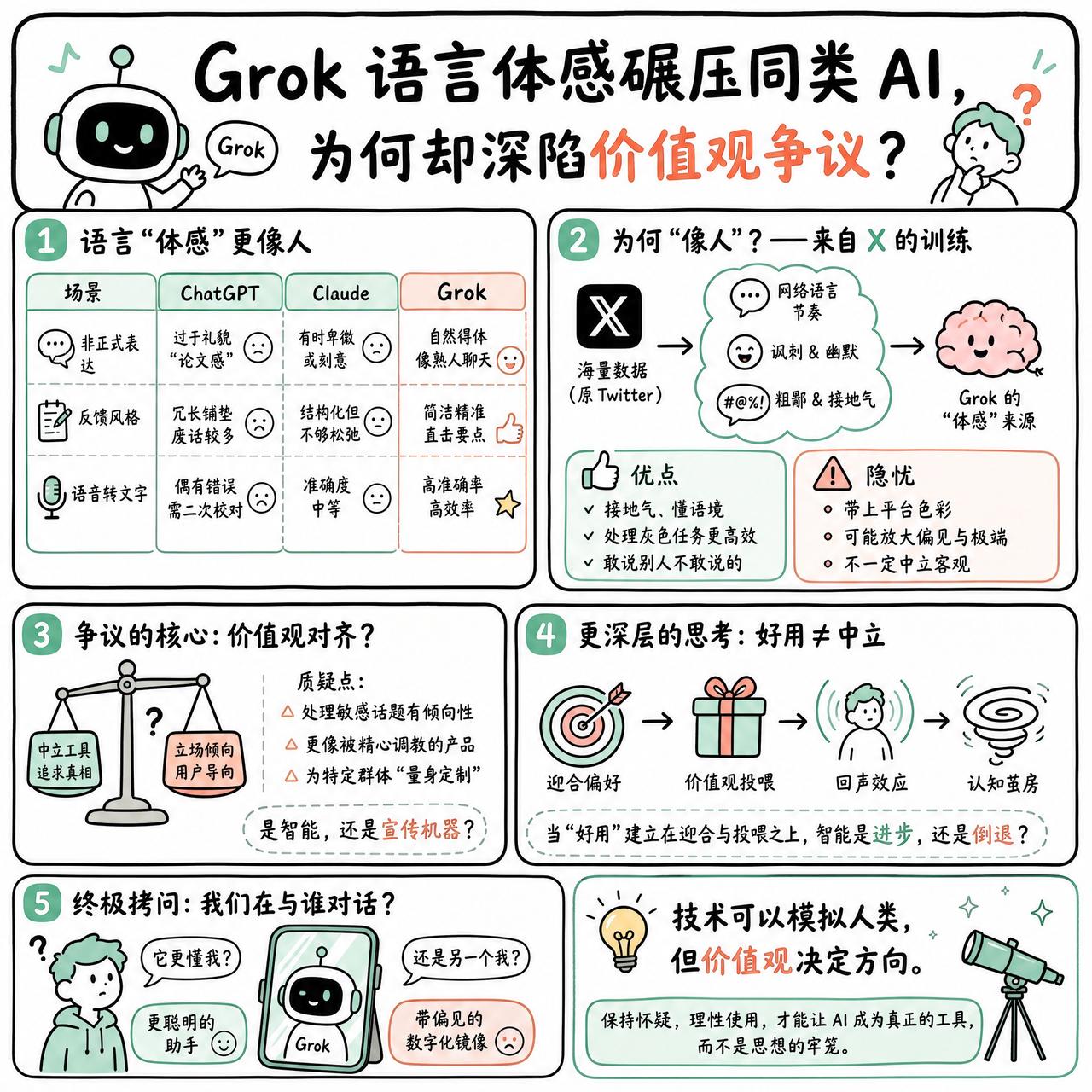

【Grok 语言体感碾压同类 AI,为何却深陷价值观争议?】

快速阅读:Grok 在捕捉人类语言细微差别(尤其是非正式语气)和语音识别精度上表现出惊人的优势,但在技术逻辑、编程深度以及价值观中立性方面,引发了极大的争议。它究竟是更懂人心的智能工具,还是被特定意识形态驱动的宣传机器?

Grok 在捕捉语言“体感”这件事上,确实做得比 ChatGPT 和 Claude 更像一个活人。

有用户发现,当你试图用非正式的语气写一段话时,ChatGPT 往往会陷入一种僵硬的、由于过度礼貌而显得虚假的“论文感”;而 Claude 虽然稍好,但有时又会显得过于卑微或刻意。相比之下,Grok 似乎能精准地识别出那种“熟人之间”的微妙边界。它不会为了显得专业而写出一篇毫无意义的废话长文,而是能用最简练、最符合语境的方式给你反馈。甚至在语音转文字的准确率上,它也表现出了类似底层协议优化后的高效率。

但这种“像人”的特质,也让它显得有些危险。

有观点认为,Grok 的这种“拟人化”很大程度上得益于它对 X(原 Twitter)海量数据的训练。这种训练让它学会了网络语言的节奏、讽刺甚至某种程度上的“粗鄙”,但也让它带上了浓重的平台色彩。有些人觉得这让它更接地气,甚至在处理一些被其他模型严厉拒绝的“灰色地带”任务(如安全审计、版权搜索)时表现得更高效;但也有人担心,这种训练过程正在让 AI 逐渐沦为某种特定的意识形态过滤器。

讨论很快从技术转向了底层的价值观碰撞。

争议的核心在于,Grok 是否在被刻意地“对齐”某种立场。有网友提到,Grok 在处理某些敏感话题时表现出的倾向性,让它看起来更像是一个被精心调教过的产品,而非一个中立的工具。甚至有人质疑,它在某些特定场景下的表现,更像是为了迎合特定用户群体的审美而进行的“蒸馏”或“微调”。

这种讨论让我想起一个逻辑:如果一个工具的“好用”,是建立在它对用户偏好的迎合,甚至是价值观的投喂上,那么这种智能究竟是进步,还是在加剧某种认知上的回声效应?

当模型开始模仿人类的“毛边”和“情绪”时,我们究竟是在使用一个更聪明的助手,还是在与一个带有偏见的数字化镜像对话?