可以放心用NVIDIA免费tokens,一般不会触发速率限制

最近deepseek v4发布,但是国内资源紧张,于是就试用这个nvidia免费api,Deepseekv4模型直接连上,还免费使用,感觉真是太棒啦。但是,不能因为免费就无节制地暴力使用。不少网友在使用nvidia免费模型时,遇到rate limit的问题,经过几天的试用,感觉问题不大。今天就来和大家说说这个速率限制的问题,避免踩坑。

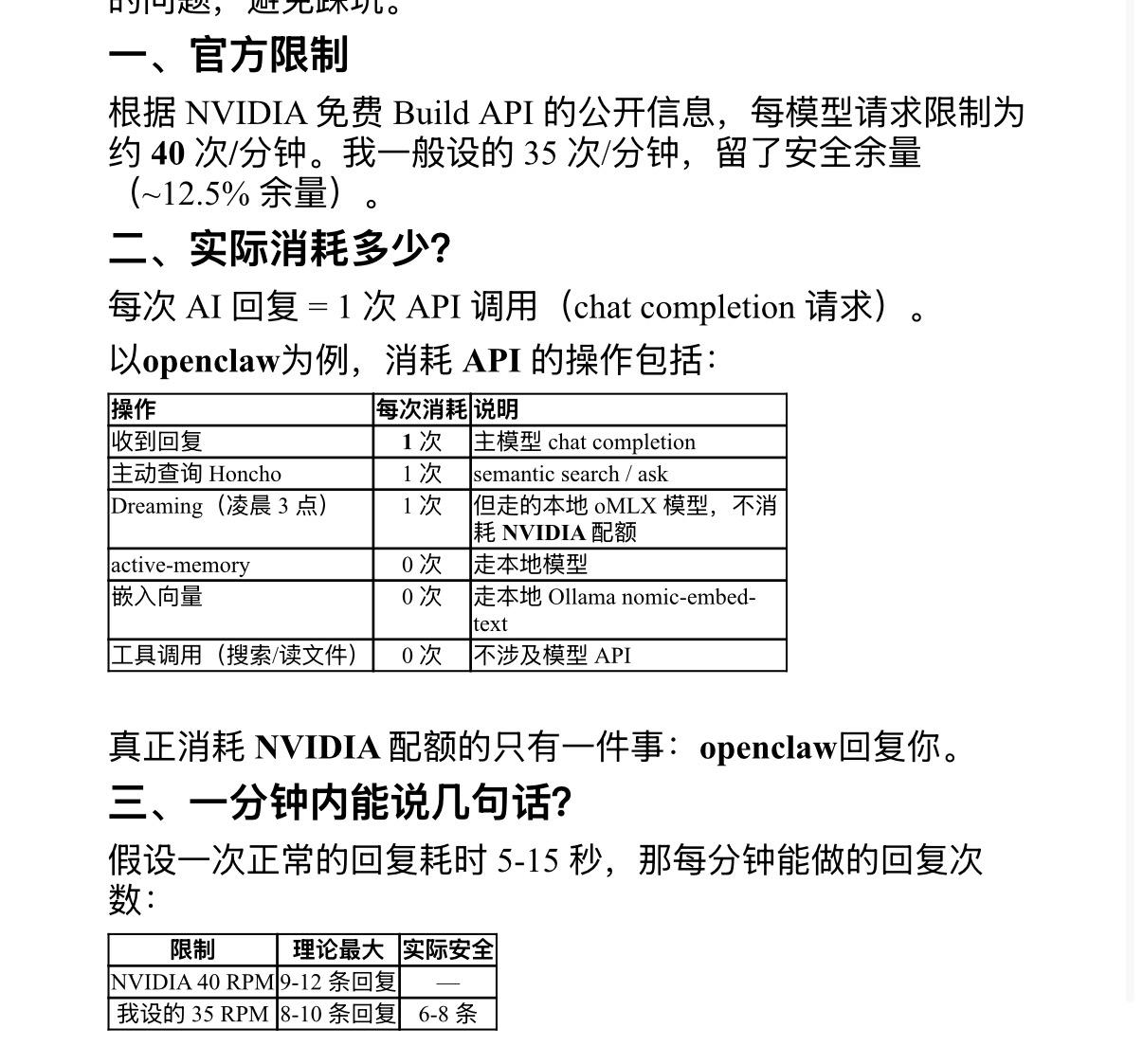

一、官方限制

根据 NVIDIA 免费 Build API 的公开信息,每模型请求限制为约 40 次/分钟。我设的 35 次/分钟,留了安全余量(~12.5% 余量)。

二、实际消耗多少?

每次 AI 回复 = 1 次 API 调用(chat completion 请求)。

以openclaw为例,消耗 API 的操作包括:以下表格见图。

操作

每次消耗

说明

收到回复

1 次

主模型 chat completion

主动查询 Honcho

1 次

semantic search / ask

Dreaming(凌晨 3 点)

1 次

但走的本地 oMLX 模型,不消耗 NVIDIA 配额

active-memory

0 次

走本地模型

嵌入向量

0 次

走本地 Ollama nomic-embed-text

工具调用(搜索/读文件)

0 次

不涉及模型 API

真正消耗 NVIDIA 配额的只有一件事:openclaw回复你。

三、一分钟内能说几句话?

假设一次正常的回复耗时 5-15 秒,那每分钟能做的回复次数:以下表格见图

限制

理论最大

实际安全

NVIDIA 40 RPM

9-12 条回复

—

我设的 35 RPM

8-10 条回复

6-8 条

四、什么时候会触发限制?

典型触发场景:

1. 多个子代理同时跑 — 上次翻译任务时,5 个子代理几乎同时请求,瞬间吃掉 5 次配额

2. 连续发多条短消息问问题 — 你连问 10 个问题,openclaw连答 10 次,理论上 1 分钟不到就触及上限

3. openclaw在回复中调用了多次 API — 比如,1次主回复 + 搜索记录 + 查 NVIDIA 文档 + 搜索网页 = 实际上消耗了额外几次,但这些是工具调用和搜索,不耗费主模型 API。只有最终回复那 1 次算。

4. 高峰期 NVIDIA 端资源紧张 — 实际测试显示热门模型在忙时可能出现 429(限制),即使未达 40 RPM 上限

五、精确计算

配额:35 次/分钟(安全值,上限 40)

每次回复耗时:≈ 5-15 秒

极限情况:

连续回复 8 个问题 → 约 80 秒,刚好 35 次

平均 ≈ 每 7-10 秒一次

正常情况:

回复 + 思考 + 工具调用 = 30 秒以上

每分钟 2-3 次回复,远低于限制

六、结论

实际触发限流的场景只有一种:短时间密集请求。 比如多个子代理同时跑,或者你一口气连问很多问题。日常对话(一问一答,中间有停顿思考)几乎不会触及。

如果设置了子代理,就很容易触发限制。比如一次翻译任务 5 个子代理同时启动就炸了——它们可能在同一秒内发 5 次以上请求,直接撞 40 RPM 的墙。如果改成主会话逐段翻译,带间隔,就不会出问题。