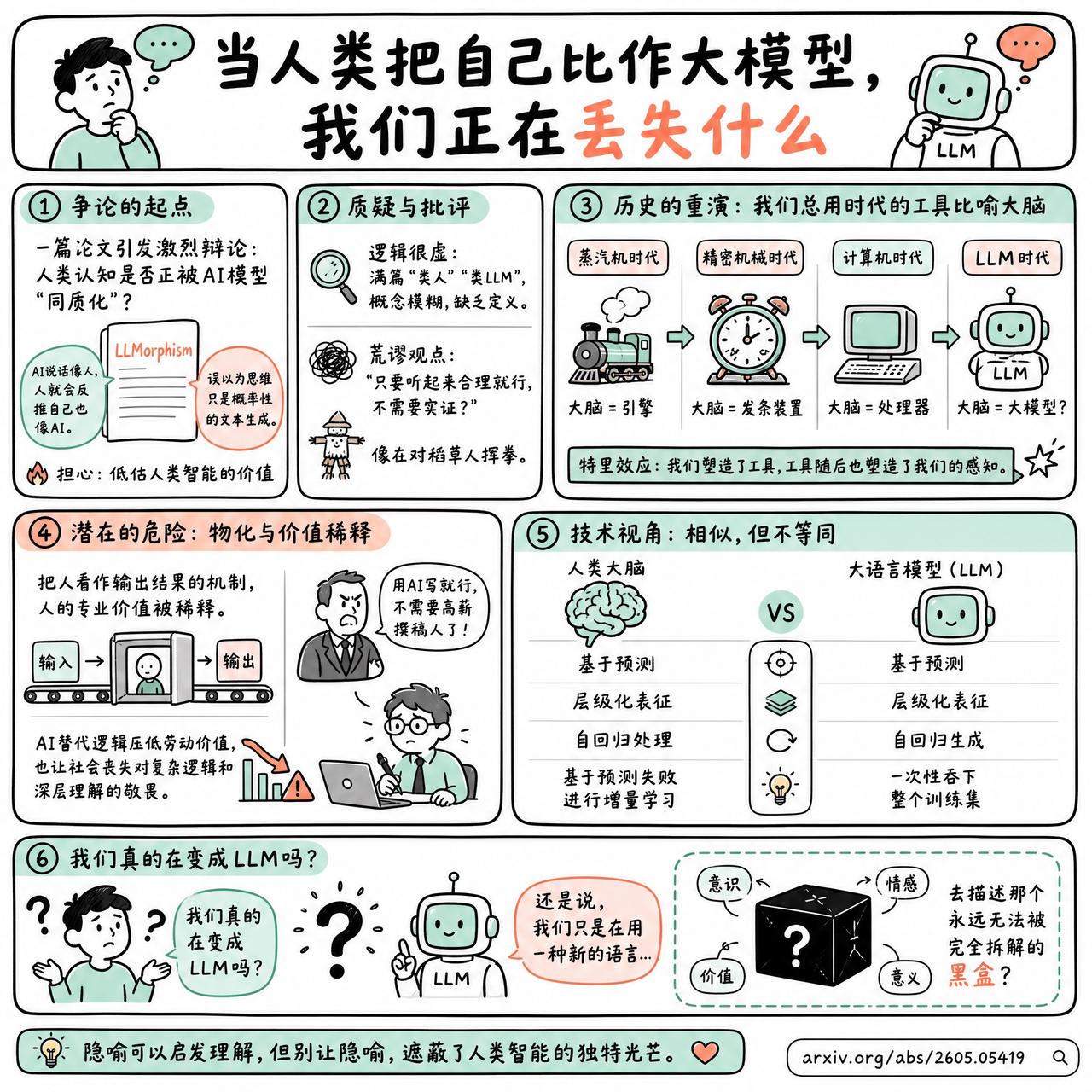

【当人类把自己比作大模型,我们正在丢失什么】

快速阅读:一篇名为“LLMorphism”的论文引发了关于人类认知是否正被AI模型“同质化”的激烈辩论。人们担心,当语言模型的表达变得极其流畅时,我们会误以为人类的思维逻辑也只是概率性的文本生成,从而导致对人类智能价值的低估。

有人在论文里提出了一个词:LLMorphism,指那种认为人类认知就像大语言模型的偏见。论文担心,如果AI说话像人,人就会反推自己也像AI。

这听起来有点像在对着稻草人挥拳。

有网友觉得这篇论文逻辑很虚,满篇都是“类人”或“类LLM”这种模糊的感官描述,缺乏严谨定义。甚至有人直言,这种观点简直荒谬,认为这会导致社会进入一个“只要听起来合理就行,不需要实证”的时代。

但换个角度看,这种隐喻的流行其实是历史的重演。在蒸汽机时代,人们把大脑比作引擎;在时钟精密机械时代,大脑变成了发条装置;有了计算机,大脑就是处理器。现在有了LLM,我们自然会用它的词汇去描述自己。

这其实是一种“特里效应”:我们塑造了工具,工具随后也塑造了我们的感知。

有观点认为,这种倾向是有危险的。它可能导致一种“物化”:如果把人看作是输出结果的机制,那么人的专业价值就会被稀释。就像有些老板试图用AI辅助写作来取代高薪撰稿人一样,这种逻辑在压低劳动价值的同时,也可能让社会丧失对复杂逻辑和深层理解的敬畏。

不过,也有人持更底层的技术观察。比如,人类语言皮层在某种程度上确实表现出预测性、层级化和自回归的特征。区别在于,人类大脑是基于预测失败进行增量学习的,而LLM需要一次性吞下整个训练集。

我们真的在变成LLM吗?还是说,我们只是在用一种新的、更方便的语言,去描述那个永远无法被完全拆解的黑盒?

arxiv.org/abs/2605.05419