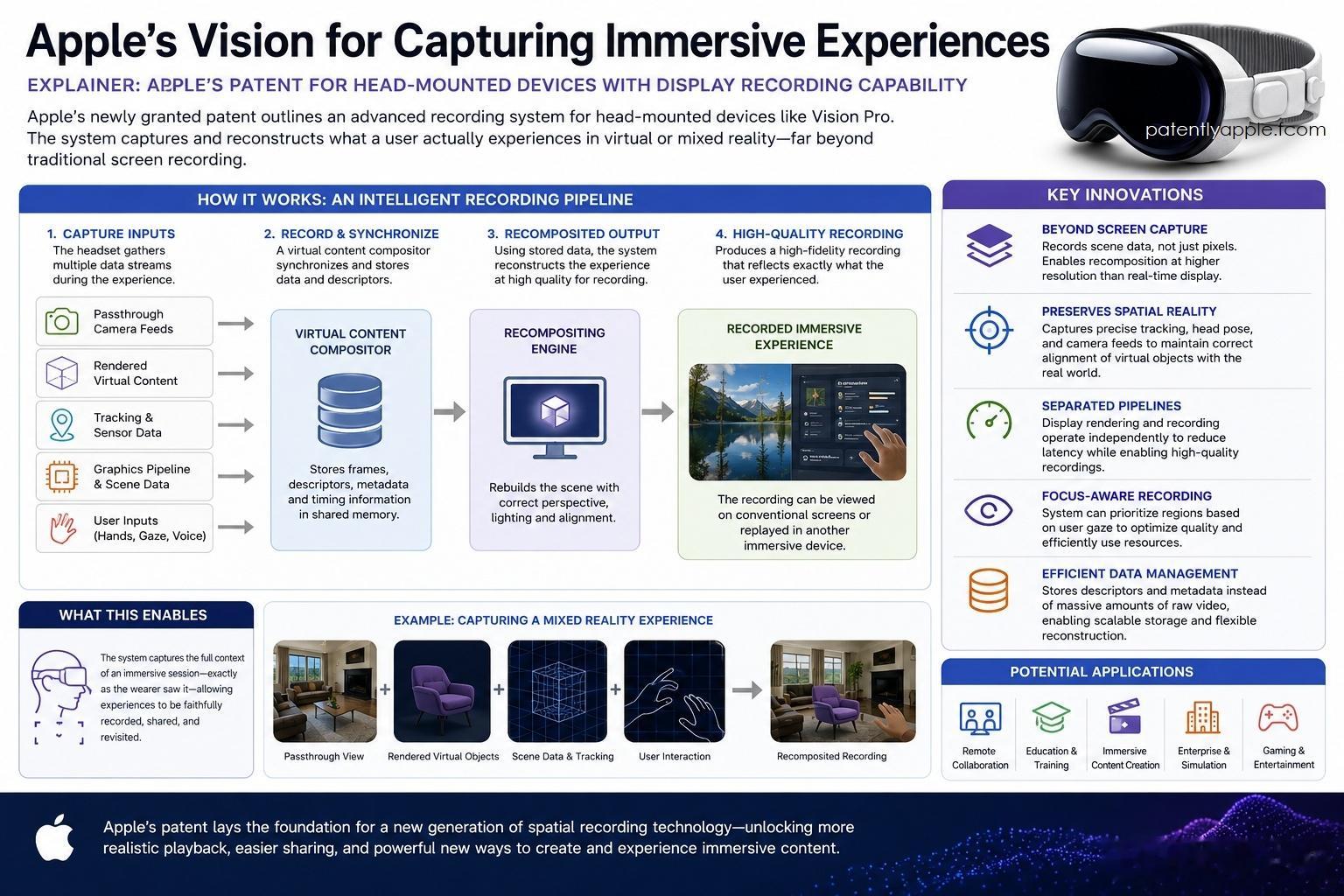

Apple获批一项专利,涉及未来版本Vision Pro设备。该设备能够以远超传统屏幕录制方案的精密方式,录制沉浸式虚拟现实与混合现实体验。这项专利提出一套先进的录制架构,旨在还原用户在空间计算环境中的真实感官体验,而非仅仅截取最终的屏幕显示画面。

该专利聚焦头显设备(如Vision Pro)的专属录制流程,可智能重构虚拟场景、透视影像、追踪数据与图形渲染信息,合成高品质的沉浸式录制内容。Apple此举意在攻克当下沉浸式计算设备的一大技术瓶颈:在不损失画面画质、音画同步性与设备运行性能的前提下,精准完成空间体验的录制留存。

这份专利的核心亮点在于,Apple不再只录制呈现给用户的像素画面。取而代之的是,系统会采集并重构虚拟、混合现实场景下的多层数据信息。

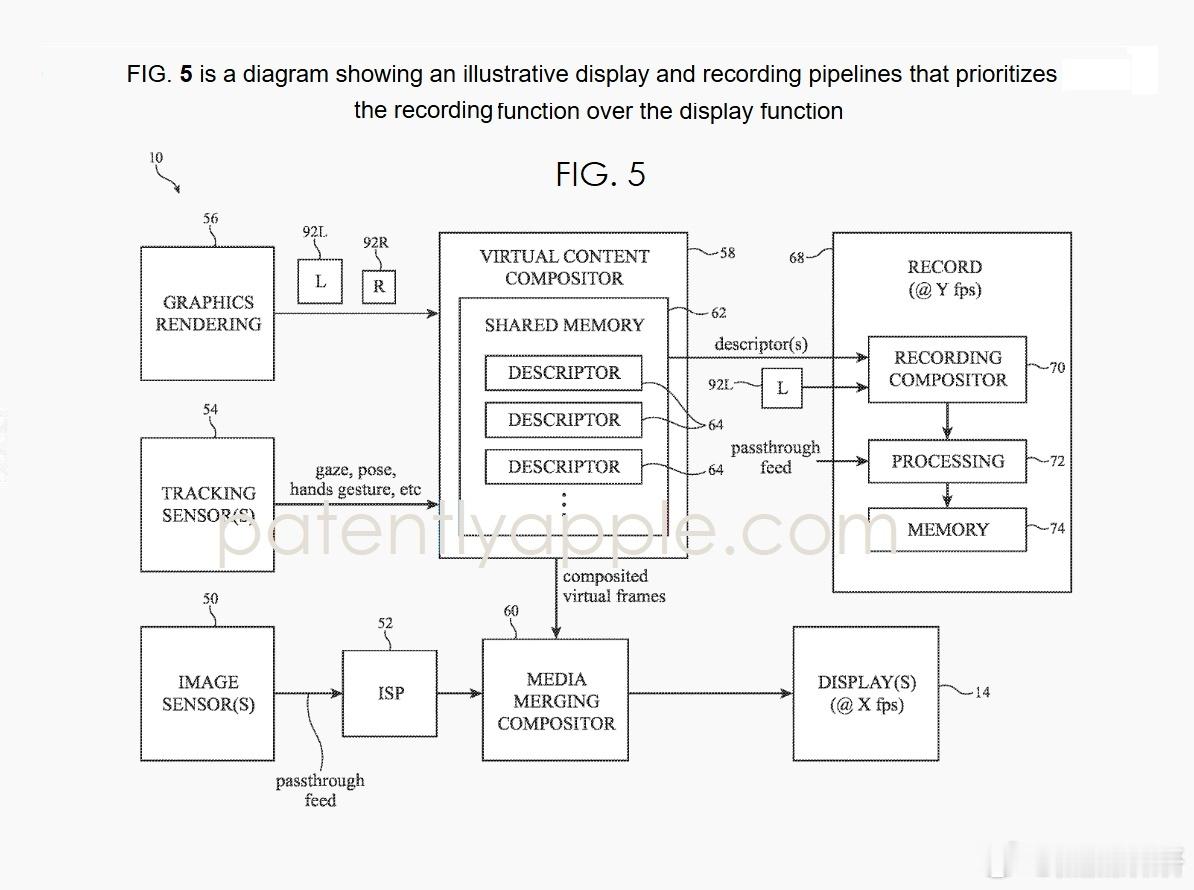

专利文中多次提及虚拟内容合成器模块,可接收渲染完成的虚拟画面、动作追踪数据、图形流程信息、透视相机画面及场景描述参数,整合设备各组件的数据源。系统不再仅保存最终显示帧,后续可依托存储的元数据与渲染指令,重新合成完整的沉浸式场景。

这套架构能够生成画质高于头显实时显示效果的录制内容。专利甚至提到,录制时可生成更高分辨率的重构画面,同时为实时使用端保持低延迟渲染表现。

实质上,Apple将录制流程与实时渲染流程相互剥离,便于事后更精准地还原重构沉浸式内容。

专利的核心设计理念,是完整保留用户沉浸式体验的真实观感与视角逻辑。苹果着重指出一大技术难点:如何保证虚拟物体画面,与头显外置相机采集的透视实景画面之间,视角对齐精准无误。

设备借助多组追踪传感器与摄像头,实时捕捉头部位置、视线方向、手部动作及周边环境信息。这些数据再与虚拟渲染画面做同步匹配,确保录制成品能够精准还原佩戴者当时所见的全部画面。

这一点在混合现实场景中尤为关键——数字内容必须和透视相机捕捉的现实画面保持严丝合缝的空间对齐。一旦渲染物体与现实场景出现细微错位,录制画面就会产生抖动、观感违和等问题。

Apple这项专利表明,正在搭建一套底层技术框架,即便在包含位移、景深变化、手部追踪、动态光影等复杂沉浸式交互场景下,仍能维持空间画面的连贯性与稳定性。

专利附图展示了分层式录制架构,涵盖渲染描述参数、共享内存机制、图像校正模块与重构合成引擎。系统无需持续存储海量原始图像数据,而是通过记录场景指令与元数据,后续高效还原生成沉浸式体验片段。

专利还提到选择性渲染处理技术:系统可依据用户视线落点与关注区域,为画面不同区域分配差异化渲染优先级。既可以为视觉焦点区域保留超高录制画质,又能为其他区域节省设备运算资源。

Apple同时采用异步处理流程,可独立调度画面渲染与内容录制两项任务。流程分离设计既能降低头显日常使用的延迟,也能产出画质精良、可回放分享、支持后期剪辑的沉浸式录制素材。

这项专利除满足普通用户的沉浸式内容录制需求外,还有更广阔的落地空间。高保真度的空间计算场景录制与重构技术,将在远程协作、职业培训、教育教学、仿真模拟、企业办公流程以及沉浸式影视内容制作领域发挥重要作用。

该技术也有望解决非头显用户难以共享XR体验的痛点。传统录制方式无法还原混合现实特有的景深、视角与空间位置关系,而全新重构录制流程,能够为普通显示设备生成更具电影感、更易理解的沉浸式场景画面。

未来还可依托该技术实现沉浸式回放:已录制的场景可切换任意视角重新观看,或是在其他空间计算设备中动态重构复现。

这项专利进一步体现Apple的布局思路:着力搭建空间计算底层基础架构,而非将Vision Pro仅视作初代独立产品。专利核心聚焦底层渲染架构、同步机制与内容管理流程,可为未来全系列头显产品提供技术支撑。

随着沉浸式计算不断发展,空间体验的录制与分享,或将如同当下智能手机拍照录像一样,成为大众刚需。Apple这份最新专利,预示品牌已提前布局未来——混合现实内容创作,将成为计算生态主流应用形态。