你有没有想过这样一个问题:为什么二十年前,几个大学生在宿舍里捣鼓出一个网站,就能服务全中国几百万网民;而今天,一家互联网公司动辄上万员工、几百亿的硬件投入,却依然觉得“不够用”?

这不是怀旧,而是一个残酷的结构性转变。

我最近在梳理互联网发展史的时候,发现一个特别有意思的现象:从2000年到2015年左右,互联网公司最引以为傲的标签就是“小而精”。几十个人的团队,几台租来的服务器,一个足够好的产品,就能撬动上千万用户,现金流好得让传统企业眼红。

但进入AI时代后,一切都反了过来。现在的互联网公司正在变得越来越“重”——重资产、重算力、重电力、重基建。曾经那个靠创意和代码就能改变世界的轻量化时代,似乎正在离我们远去。

让我们先把时间拨回到2004年。

那一年,Facebook在哈佛大学的宿舍里诞生。马克·扎克伯格和他的几个室友,用几台普通的个人电脑作为服务器,搭建了一个校园社交网站。上线仅仅24小时,就吸引了上千名哈佛学生注册。一个月后,哈佛半数以上的本科生都成了它的用户。

你知道当时Facebook的团队有多大吗?最初只有扎克伯格一个人,后来慢慢扩展到几个人,再到十几个人。直到2005年,也就是Facebook成立一年后,团队规模才勉强达到30人。而此时,它的用户已经突破了600万。

600万用户,30个人。平均一个人服务20万用户。

这不是孤例。2005年,YouTube在情人节那天上线。三位前PayPal员工——查德·赫尔利、陈士骏和贾维德·卡里姆,在一个车库里搞定了所有事情。最初的代码量少得惊人,服务器也是从eBay上淘来的二手货。上线后不到一年,YouTube就被谷歌以16.5亿美元收购。而收购时,整个团队只有不到70个人。

国内的故事同样精彩。

2000年,腾讯QQ刚刚起步的时候,马化腾和他的几个创业伙伴挤在深圳华强北的一间办公室里。那会儿QQ的用户量在短时间内就突破了100万,但腾讯的整个技术团队不到10个人。马化腾后来回忆说,为了维持服务器运转,他们甚至不得不把QQ的软件压缩到一张软盘的大小。

还有一个更极端的例子——Craigslist。这个全球最大的分类信息网站,直到2010年前后,依然保持着不到50人的团队规模,却服务着全球超过500个城市的数千万用户。它的首页代码极其简单,二十年来几乎没怎么变过,但就是这样“简陋”的产品,每年创造的收入高达数亿美元。

为什么那个时代的互联网可以做到“小而精”?

底层逻辑其实并不复杂。

第一,摩尔定律的红利。芯片性能每18个月翻一番,而价格保持不变甚至下降。这意味着你不需要自己造芯片,也不需要建数据中心,只需要去租几台云服务器(或者干脆用自己的PC),就能获得足够强的算力。

第二,互联网的边际成本接近于零。软件产品一旦开发出来,每多服务一个用户的额外成本几乎可以忽略不计。带宽和存储的价格也在持续下降。AWS(亚马逊云)在2006年推出的时候,一台虚拟服务器的价格低得惊人,而且还在不断降价。

第三,流量红利。那时候的互联网是一片蓝海,用户增长速度远超服务器扩容的速度。你不需要花大钱买流量,只要产品足够好,用户自己就会帮你传播。病毒式营销在那个年代是真的可以靠口碑实现的。

所以,那个时代的互联网公司可以保持极轻的资产结构——轻团队、轻服务器、轻运营。创始人可以把90%的精力都放在产品本身上,而不是纠结于基础设施。

但这一切,正在被AI彻底改变。

时间快进到2023年。

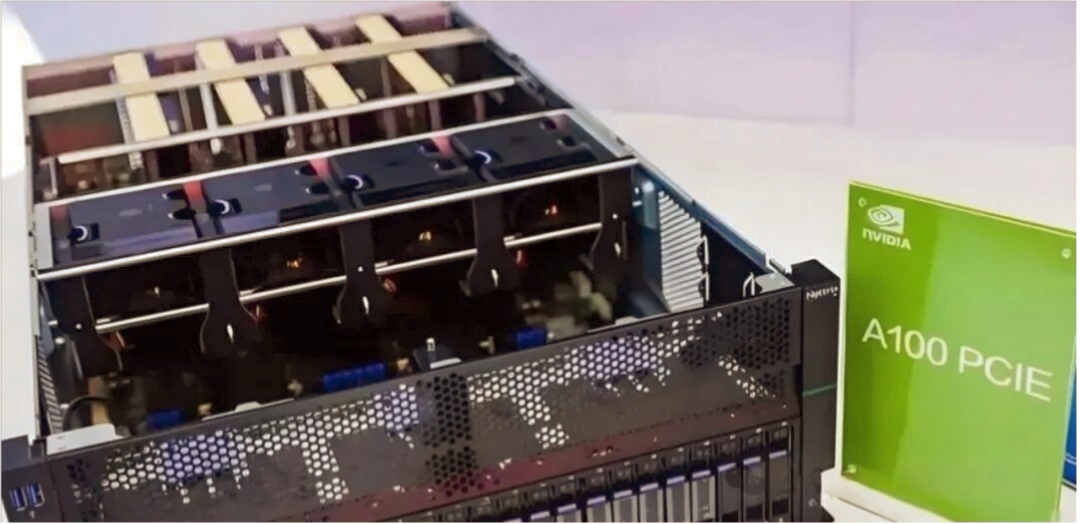

ChatGPT在2022年底横空出世,整个科技界为之震动。但很少有人注意到一个细节:OpenAI为了支撑ChatGPT的日常运行,动用了超过3万张英伟达A100 GPU。而A100 GPU的价格是多少?一张大约1万到1.5万美元。光是硬件的投入,就是数亿美元。

这还只是开始。

2024年,谷歌发布了Gemini 1.5,一个参数量达到万亿级别的模型。训练这样一个模型,需要的算力成本大约是1.9亿美元。而推理成本呢?每次用户向Gemini提问,谷歌都要在后台调用数千张GPU进行实时计算,消耗大量的电力和时间。

有技术大佬算过一笔账:一个中等规模的大模型,如果每天有100万活跃用户,每个用户平均进行10次问答,每次问答需要处理约5000个token(也就是大约3500个汉字)。那么,光是推理所需要的GPU算力,就需要大约2000张A100级别以上的显卡。

每张A100的功耗是400瓦,2000张就是800千瓦。再加上散热、存储、网络设备,整个机房的功耗轻松突破1兆瓦。

这是什么概念?一个普通家庭一年的用电量大约是3000度。1兆瓦的机房,一天就要消耗24000度电,相当于8个家庭一年的用电量。

而电费,只是冰山一角。

更麻烦的是,AI业务的算力需求不是线性的,而是指数级的。随着模型参数量的增加、上下文长度的扩展、多模态能力的加入,算力需求几乎每三到四个月就要翻一番。这就是著名的“大模型缩放定律”。

于是,互联网公司发现自己陷入了一个悖论:产品越受欢迎,用户越多,推理成本就越高,利润反而越薄。

传统互联网的边际成本接近于零,而AI互联网的边际成本是正的,而且还不低。每一次API调用,每一次token生成,背后都是实打实的电费和芯片折旧。

面对这个困境,互联网公司别无选择,只能开始“增重”。

2023年,微软宣布在未来几年内投入500亿美元,用于扩建自己的AI数据中心。这个数字,相当于微软过去五年资本支出的总和。

2024年初,亚马逊宣布计划在全球范围内新建超过100个数据中心,专门用于AI推理和训练。每个数据中心的建设成本大约在5亿到10亿美元之间。

谷歌更夸张。他们在2024年宣布,将在俄亥俄州、内布拉斯加州和得克萨斯州购买三块大型土地,用于建设“AI就绪”的数据中心。这些数据中心不仅要配备最新的GPU集群,还要自带天然气发电站和太阳能电站,因为当地的电网根本无法支撑如此巨大的电力需求。

国内的情况如出一辙。

字节跳动在2024年被曝出正在秘密建设自己的GPU集群,计划采购超过10万张英伟达H800 GPU,总价值超过40亿美元。阿里云、腾讯云和华为云也都在疯狂地扩建AI算力池。

为什么不能继续租用云服务?为什么要自己建?

答案很简单:控制权和成本。

租用云服务看似灵活,但当你每天的API调用量达到数十亿次时,云服务商给你的报价会让你怀疑人生。而且,全球的GPU供应本就紧张,英伟达的订单已经排到了2025年。如果你不去自己抢购、自己部署,就只能永远排在后面。

更关键的是,电力。

AI训练和推理对电力的需求已经到了变态的程度。国际能源署的数据显示,2022年全球数据中心的电力消耗约占全球总电力的1%,到2026年,这个比例可能会翻三倍。而其中,AI数据中心是增长最快的部分。

一个典型的AI数据中心,PUE(电能利用效率)即使优化到1.2,依然有20%的电能被浪费在散热上。而散热本身也需要大量的水。谷歌在俄勒冈州的数据中心,每年要消耗3亿多加仑的水用于冷却。

所以,互联网公司开始被迫成为能源公司。

微软在2023年签了一份长达20年的电力购买协议,从爱尔兰的一个海上风电场购买全部电力。谷歌和亚马逊也在全球范围内疯狂投资可再生能源项目,从太阳能电站到核聚变初创公司,无所不包。

这还没完。

如果说大模型的推理已经让互联网公司头疼不已,那么Agent(智能体)的到来,则彻底点燃了算力消耗的导火索。

什么是Agent?简单来说,就是让AI不仅能回答问题,还能自主执行任务。比如,你告诉AI“帮我规划一次去日本的旅行”,传统的大模型只会给你一堆建议。但Agent可以自己去查机票、比价、预订酒店、安排行程,甚至调用第三方API完成支付。

听起来很美好,但代价是什么呢?

每一个Agent任务,都需要进行多轮推理。假设一个旅行规划任务需要调用10次不同的API,每次API调用需要处理5000个token,那么一个用户的一次请求,就要消耗5万个token。而一个复杂的Agent任务,比如“帮我分析一下这100份财报,并生成一份投资建议报告”,可能需要几百甚至上千次推理。

Token的消耗,就是算力的消耗,就是电力的消耗,就是钱的消耗。

2024年初,一家名为“AI Agent”的初创公司发布了一款产品,号称可以自动完成企业报销流程。用户只需要拍下发票照片,Agent就会自动识别金额、分类、提交审批、生成财务报表。产品上线后大受欢迎,三个月内日活用户突破50万。

但创始人很快发现,自己的GPU账单涨得比用户还快。每个月的算力成本高达200万美元,而公司收入才150万美元。净亏损50万美元。

这就是Agent时代的尴尬:产品越好用,亏得越多。

传统互联网公司可以通过广告或增值服务来覆盖服务器成本,因为服务器成本足够低。但AI公司不行,因为每一次交互都在烧钱。除非你把产品设计得足够“蠢”,减少推理次数,但那样用户又不会买账。

于是,互联网公司只能继续“增重”——自建推理集群,自研更高效的芯片,自己建发电站。因为只有把整个产业链握在手里,才能把边际成本降到可控的范围。

一个有趣的现象是,现在的互联网巨头,正在变成芯片公司。

2023年,谷歌发布了第六代TPU(张量处理单元),专门用于AI训练和推理。谷歌声称,TPU v6的训练效率比英伟达A100高出30%,而功耗降低40%。更重要的是,谷歌不需要向英伟达采购,自己设计、自己流片、自己部署,完全掌控供应链。

亚马逊在2023年推出了第二代Trainium芯片,用于AI训练。Trainium的性能虽然不如英伟达的顶级产品,但价格便宜得多。亚马逊的策略很清晰:在推理场景,性价比远比绝对性能重要。

微软在2024年初被曝出正在秘密开发自己的AI芯片,代号“Athena”。据说,微软已经投入了超过20亿美元用于这个项目,第一批芯片将在2024年底投入使用。

国内的企业也不甘落后。百度早在2018年就推出了“昆仑”AI芯片,目前已经迭代到第二代。华为的昇腾系列虽然受制于制裁,但在国内AI算力市场依然占据重要地位。阿里巴巴的平头哥也在研发AI推理芯片。

为什么互联网公司要亲自下场做芯片?

第一,英伟达的GPU太贵了。H100的售价高达3万美元一张,而且你还买不到。如果你想部署一个万卡集群,光GPU的成本就是3亿美元。如果能自研芯片,成本至少可以降低一半。

第二,GPU并不完全适配所有的AI任务。英伟达的GPU是为通用计算设计的,但互联网公司有很多专门的场景——比如搜索推荐、广告点击率预估、短视频推荐——这些任务如果使用专门优化的ASIC芯片,效率和成本都会好得多。

但问题是,自研芯片本身就是一件极其“重”的事情。你需要组建几百人的芯片设计团队,需要和台积电或三星这样的晶圆厂合作,需要解决封装、测试、散热等一系列问题。整个周期至少需要两到三年,投入数十亿美元。

这对于小公司来说,是根本不可能完成的任务。AI时代的门槛,已经被拉高到了只有巨头才能参与的程度。

除了算力和电力,还有一样东西让互联网公司变得越来越重——数据。

传统互联网时代,数据是轻资产。你只需要一个MySQL数据库,就能存储几百万用户的信息。那时候的数据,主要是结构化的用户资料、行为日志,存储成本极低。

但AI时代的数据,完全是另一回事。

训练一个大模型,需要多少数据?GPT-3用了45TB的文本数据,相当于整个维基百科的几百倍。而GPT-4据传用了超过100TB的高质量数据。多模态模型需要的数据更多——图像、视频、音频,动辄PB级别。

存储这些数据本身就是一笔巨大的开销。更麻烦的是,数据需要清洗、标注、去重、隐私脱敏。这些工作无法自动化,需要大量的人工介入。

OpenAI曾经透露,为了标注GPT-4的训练数据,他们在肯尼亚雇佣了上千名数据标注员,每人每天要标注2000多个文本片段。这些人虽然不是技术团队,但同样是人力的成本。

数据还有另一个问题——合规性。

欧盟的GDPR、中国的个人信息保护法,都对数据的收集、存储、使用做出了严格规定。AI公司不能像过去那样随意爬取网络数据,必须确保数据的来源合法、授权清晰。这意味着需要组建专门的法务和合规团队,对每一条训练数据进行溯源和审核。

又一项重资产。

回顾整个互联网的发展史,我们会发现一个清晰的轨迹:

Web 1.0和Web 2.0时代,互联网的核心竞争力是创意和产品。一个优秀的程序员加一个好点子,就能创造出改变世界的产品。那是属于“小而精”的黄金年代。

但AI时代,核心竞争力变成了算力、电力和数据。这三样东西,没有一样是轻的。算力需要芯片,芯片需要晶圆厂和供应链;电力需要发电站和电网;数据需要存储、标注和合规审查。

互联网公司正在变得越来越“重”,不是因为它们想,而是因为它们不得不如此。

当然,这并不意味着“小而精”的模式彻底消亡了。在AI应用层,依然会有小团队做出很棒的产品。但请注意,这些产品本质上还是寄生在巨头的算力平台上。你可以用OpenAI的API快速开发一个应用,但每赚一块钱,就要分给OpenAI几毛钱的算力费。

真正掌握话语权的,是那些拥有算力、电力和数据的重资产巨头。互联网的门槛,从未像现在这样高。

这或许是一个时代的告别。那个几个人、几台服务器、几百万用户的轻量级神话,已经写入了历史。未来的互联网,属于那些敢于“增重”的玩家。

而我们每一个人,都是这场转变的见证者。