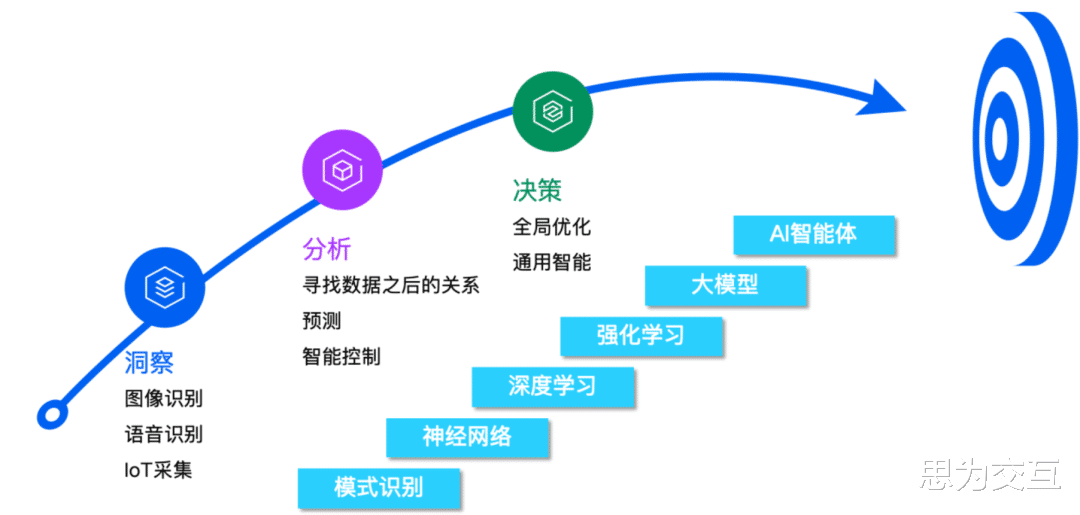

过去十年,制造业一直在做同一件事:教会机器“预测”。我们投入巨资部署工业物联网(IIoT),积累海量数据,只为提前知道设备何时会故障,市场风向会怎么变。这很酷,但还不够。真正的变革,发生在AI跨过那条“预测”的边界,开始直接“决定”下一步该怎么做的时候。

你可能没注意到,AI推理的成本在过去两年里降低了近300倍。这意味着,曾经需要庞大数据中心才能驱动的复杂智能,如今可以直接塞进生产线上的设备里。AI正从“办公室的数据分析师”,变为深入现场的“决策执行官”。

我们正从“预测性维护”迈向“规定性维护”。前者回答“会发生什么”,后者则回答“我们该如何以最优方式应对”。这不仅仅是技术的升级,而是价值的跃迁,是设备综合效率(OEE)冲向90%以上极限的关键。正如西门子高管所言,AI已不再是加分项,而是决定企业能否在未来存活的核心驱动力。

要实现这个飞跃,我们需要三大支柱:一个提供知识的“专业大脑”,一个用于验证的“虚拟沙盒”,以及一套确保一切可控的“信任框架”。

决策的“大脑”与“手脚”:工业基础模型与智能体

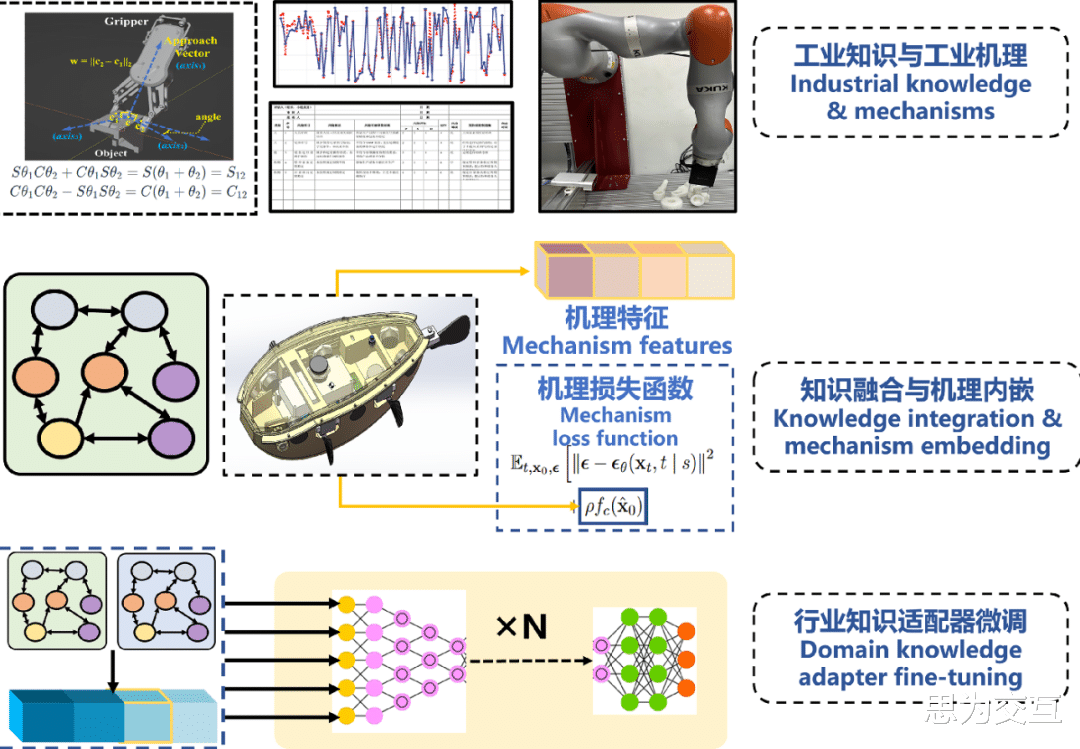

为什么不能直接把通用大模型搬到工厂里?因为工业场景远比日常对话复杂,它要求极高的专业性、可靠性和安全性。通用模型就像一个什么都懂点的“通才”,而工厂需要的是深耕特定领域的“专家”。

这就是工业基础模型(Industrial Foundation Model, IFM)存在的意义。它是一个装满了特定行业知识、故障逻辑和优化目标的专业“大脑”,能有效缓解我们面临的技术工人短缺难题。

但光有大脑还不够,决策还需要“手脚”去执行。“工业智能体群”就扮演了这个角色。基础模型负责思考和推理,智能体则像一群高效的“工蜂”,根据指令自主完成各种流程化的工作。这种“大脑+手脚”的模式,正在催生一个工业领域的“App Store”,让不同技术背景的从业者都能轻松调用AI能力,将智能决策贯穿到整个价值链中。

决策的“沙盒”:闭环数字孪生

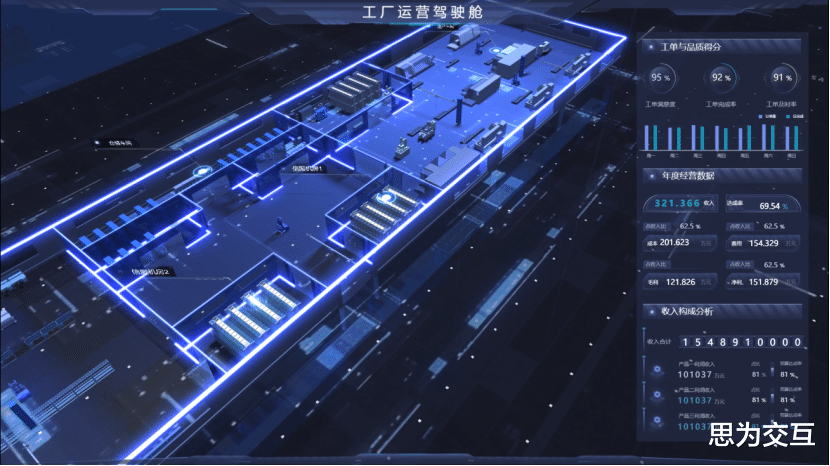

在工业世界里,任何决策的失误都可能代价高昂,我们没有试错的机会。那么,如何确保AI的决策既大胆创新又万无一失?答案是给它一个可以无限模拟、零风险的“安全沙盒”——数字孪生(Digital Twin)。

数字孪生不是简单的离线模拟,它是一个与物理实体实时同步、双向交互的虚拟世界。AI可以在这里尽情测试各种大胆的想法,比如调整一个从未尝试过的生产参数。一旦在虚拟世界里被验证为最优且无风险,这个决策才会被应用到现实世界。

更关键的是,数字孪生正在从模拟单个设备(资产孪生)走向模拟整条产线甚至整个工厂(系统孪生)。这让AI获得了“全局视野”,能够做出系统级的优化决策,避免“局部最优解导致全局受损”的常见错误。它构建了一个完美的“感知-行动-验证”闭环,是智能决策从理论走向现实的必要试验场。

决策的“红线”:可解释AI(XAI)

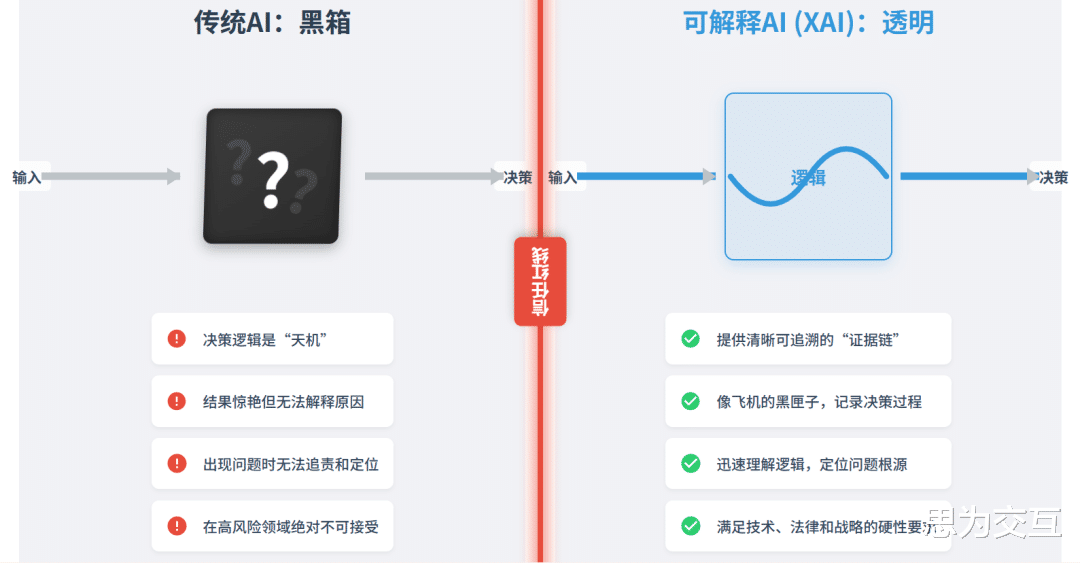

当AI开始控制化工厂的流程,或是调度整个电网的负荷时,一个终极问题浮出水面:我们该如何信任它?

传统AI就像一个“黑箱”,它能给出惊艳的结果,却无法解释原因。在人命关天、分秒必争的工业领域,一个无法解释、无法追责的系统是绝对不可接受的。这就是可解释AI(Explainable AI, XAI)必须存在的理由。

XAI并非要削弱AI的性能,而是要为它的每一个决策都提供一条清晰、可追溯的“证据链”。它像飞机的黑匣子,让我们在出现问题时,能够迅速理解AI的决策逻辑,定位问题根源。这不仅是技术需求,更是法律和战略的硬性要求。无论是欧盟的GDPR,还是中国的AI发展规划,都明确将“可解释性”列为核心。XAI是我们敢于将高风险任务交给AI的“信任红线”。

人的新角色:从执行者到“AI编舞师”

当AI成为自主决策的“智能体”,人类在生产中的角色也将被彻底重塑。机器将承担绝大部分重复、繁琐的“脑力苦力活”,而人类则被解放出来,专注于更具价值的工作。

未来,人机协作的核心不再是体力的互补,而是认知的互补。机器负责高效的计算和精准的执行,人类则负责创造、策略和伦理判断。我们不再是流水线上的“操作工”,而是更像一个“AI编舞师”或“模型管理员”,负责设计目标、监督过程、处理异常。

这种转变要求我们必须重新思考人才战略。未来制造业的竞争力,很大程度上取决于我们能否培养出足够多既懂业务、又具备AI思维的复合型人才。

结语:是时候了,迎接系统级自治工业AI的拐点已至,标志就是从“预测”到“决策”的跨越。这背后,是工业基础模型(知识)、闭环数字孪生(验证)和可解释AI(信任)三大支柱的战略性聚合。

对于制造业的领导者而言,现在必须开始行动:投资数字孪生,构建决策的验证中心;拥抱工业基础模型,实现核心流程的自动化;将可解释AI作为治理基石,建立人与机器之间的信任。

这场由智能决策驱动的革命已经开始,那些还在犹豫的企业,可能会被时代远远甩在身后。