作为一名 AI 算法工程师,过去两年我最大的困扰是:想跑个 200 亿参数的模型,要么蹲云端 API 的配额,要么攒钱买一堆消费级显卡堆服务器 —— 前者数据隐私没保障,后者占地方不说声音还狠吵。 不过技嘉 AI TOP ATOM的出现,让我意识到:桌面级 AI 超级计算机,真的能解决我们这些开发者的痛点。

从云端到本地:AI 大模型的 “下沉” 趋势近几年 AI 发展的关键词,除了 “大模型” 就是 “本地化”。GPT-4、Claude 3 这类千亿级模型虽然强大,但云端调用不仅成本高(按token计费),还面临数据泄露风险 —— 比如你用公司内部数据微调模型,总不能把敏感数据传到第三方服务器吧?

“本地部署大模型” 成为了刚需。不过传统方案基本都是笨重的服务器(占半个机房)+消费级显卡(内存不够跑大模型)。而技嘉AI TOP ATOM的出现,将数据中心级的算力,压缩到1个高50.5mm宽150mm深150mm的迷你机箱里,放在办公桌就能用。

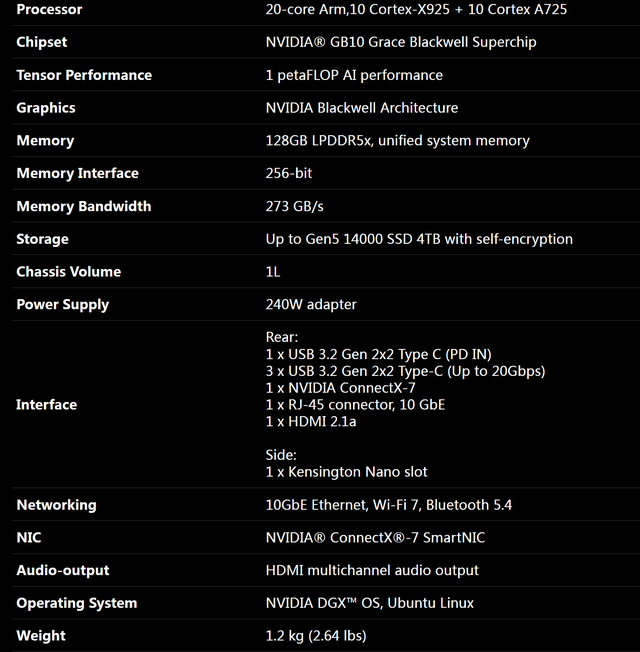

硬件:小机箱里的 “核弹级” 配置AI TOP ATOM 可以直接放在显示器旁边完全不占地方。而其内部的配置绝对会让大家吃惊:

● NVIDIA GB10 Grace Blackwell 超级芯片

NVIDIA最新的架构,集成了20核Arm CPU(10个Cortex-X925性能核+10个A725 能效核)和Blackwell GPU。

最关键的是,它能提供1 petaFLOP的FP4 AI算力—— 什么概念?相当于1000万亿次浮点运算/秒,足够本地跑200亿参数的大模型。

● 128GB 统一内存

几乎所有人都知道大模型最吃内存,AI TOP ATOM的128GB LPDDR5x 统一内存,带宽高达273GB/s,直接支持200B参数模型的本地加载——不用再分块处理,推理速度快了至少3倍。

● ConnectX-7 智能网卡:

数据中心级的网卡,支持10GbE以太网和低延迟通信。

甚至可以将两台 AI TOP ATOM 连起来直接算力翻倍,用来跑更大的模型(比如 405B 参数),对做分布式训练的开发者来说,这比买一台大型服务器划算多了。

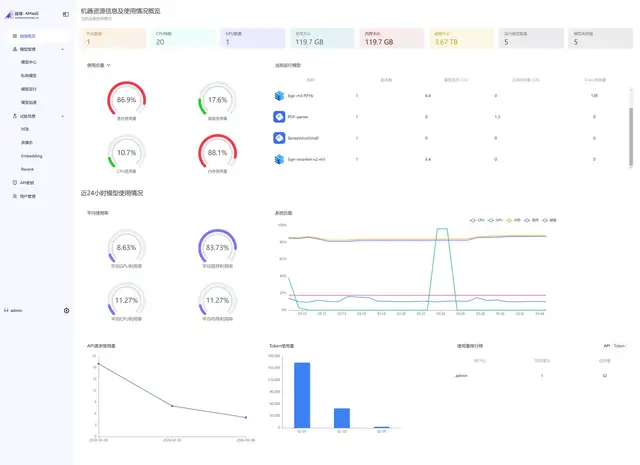

软件:开箱即用的 AI 开发环境作为程序员配置环境一切工作的地基!不过配置环境真的是很繁琐很闹心。

在这方面AI TOP ATOM预装了NVIDIA DGX OS,这是专为AI工作站设计的系统,内置了全套NVIDIA AI软件堆栈:CUDA、cuDNN、TensorRT、PyTorch、TensorFlow…… 甚至连 ComfyUI、VS Code 都预安装好了。

现在只需要把自己的数据集导入,用 TensorRT优化,不到2小时就能完成微调,再不用等待云端服务器资源分配。而且数据全程在本地,完全不用担心泄露。

应用场景:程序员的 “全能助手”说实话AI TOP ATOM对于开发者来说,几乎可以说是全能辅助

● 原型开发:快速验证模型想法,用它跑图像 + 文本的推理,实时性比云端好太多。

● 本地微调:用公司内部数据优化模型,比如训练一个能理解产品文档的聊天机器人,数据不用出公司内网。

● 边缘部署:它的小巧体积和低功耗,适合放在边缘设备旁边(比如工厂的机器人、商场的监控系统),直接在现场处理 AI 任务,延迟几乎为零。

● 数据科学:跑特征工程、预测建模,本地处理 TB 级数据,速度比普通台式机快 5 倍以上。

行业意义:AI 开发的 “平民化”过去,大模型开发是大厂的专利 —— 需要百万级的服务器集群。AI TOP ATOM的出现,让个人开发者和小团队也能拥有数据中心级的算力。这就像当年PC普及一样,降低了 AI 开发的门槛,让更多人能参与到大模型的创新中。

它的出现标志着一个趋势:AI 算力正在从云端走向桌面,从大厂走向普通开发者,桌面级AI成为现实!