在当今快速发展的人工智能领域,企业越来越重视大模型的私有化部署与测试,以确保数据的安全性和模型性能的优越性。为此,我们介绍了大模型Plus伴侣中的Lag[i]中间件,它不仅支持企业的私有语料整合,还能实现快速的私有化部署与高效的模型测试。本文将详细介绍如何利用Lag[i]中间件实现DeepSeek模型的快速私有化部署和测试。

大模型私有化部署的需求与挑战

随着深度学习技术的发展,基于大规模数据集训练的大模型如DeepSeek,在自然语言处理等领域展现出了卓越的能力。然而,对于企业而言,直接使用这些公开模型面临着数据隐私保护、模型定制化等多方面的挑战。因此,如何安全高效地进行私有化部署成为关键问题。

Lag[i]中间件助力快速私有化部署

Lag[i]中间件提供了一套完整的解决方案,帮助企业快速实现DeepSeek模型的私有化部署。通过其灵活的架构设计,Lag[i]中间件能够无缝对接企业内部环境。

1. 准备阶段:确保服务器上已经存在对应的模型文件。获取模型的路径名称。

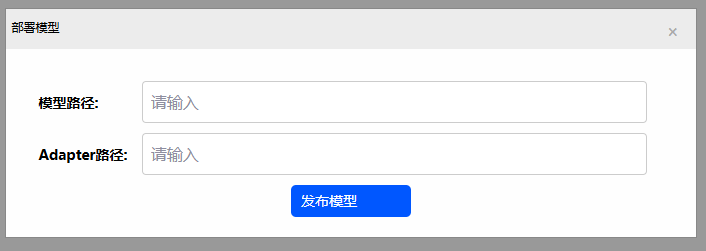

2. 配置阶段:打开Lag[i]中间件的配置界面或配置文件。在指定的配置项中填入模型的地址。

3. 启动阶段:确认配置无误后,点击启动模型的按钮或执行相应的启动命令。系统将自动加载模型并进行初始化。

4. 验证阶段:部署完成后,可以通过复制模型地址发送测试请求或查看系统状态来验证模型是否成功部署并正常运行。

高效模型测试方法

在成功部署DeepSeek模型后,Lag[i]中间件还提供了测试方法,帮助企业快速测试模型性能。

1. 将部署好的模型接入Lag[i]中间件:进入模型管理模块, 添加模型,将启动的好的DeepSeek模型信息录入, 这样部署的DeepSeek模型就被Lag[i]中间件管理。

2. Lag[i]中间件启用DeepSeek模型: 在管理页面开启该模型。

3. 测试评估: 您可以在聊天界面中对DeepSeek模型进行测试与评估。这个阶段的目标是验证模型在特定任务或应用场景下的表现是否符合预期,仔细观察模型的响应注意模型输出的相关性、准确性和流畅度。

结语

通过Lag[i]中间件的支持,企业能够更加便捷地实现DeepSeek模型的私有化部署和测试,有效解决了数据安全性和模型适应性的难题。未来,随着技术的不断进步,我们期待看到更多企业在人工智能领域的创新和发展。

👉Lag[i]中间件项目已开源👈

地址:https://github.com/landingbj/lagi

聪明的人,不该知道的绝不多问,不愿相信的一概不信。

—— 大仲马 《基督山伯爵》