当地时间1月5日,英伟达CEO黄仁勋在国际消费电子产品展览会(CES 2026)上发表主题演讲,着重介绍了英伟达对物理AI等AI未来发展趋势的见解,以及英伟达芯片的最新动态。

英伟达目前聚焦于跨行业的尖端模型开发。随着DGX云业务逐渐退出市场并转向研发,英伟达正着力开发如Earth 2、Cosmos(世界基础模型)、用于机器人和运动的GR00T模型等前沿模型。英伟达不仅开源这些模型,还开源其背后的数据集,以便开发者了解运作原理,期望各公司都能参与到即将到来的AI发展中。

Nvidia Omniverse如今可连接多台计算机,利用训练、模拟和推理构建全栈式人工智能平台。借助与语言相匹配的多个模型,计算能力可转化为数据。基于物理学原理的合成数据可用于Cosmos模型,转化为基于物理原理且易于理解的数据,进而训练新的AI平台。这有望减少物理AI平台对真实世界训练数据的需求,并将轨迹预测等要素转化为可用于训练的真实世界数据。

英伟达发布了Alpamayo系列开源AI模型和工具。该模型是首个面向自动驾驶车辆(AV)的开放式大规模推理VLA模型,能让车辆理解周围环境并解释自身行为。Alpamayo 1通过将可解释的推理与精确控制相结合,展示了一条通往L4级自动驾驶的实用路径。首款搭载Alpamayo技术的自动驾驶汽车是2025款梅赛德斯 - 奔驰CLA,将于2026年第一季度在美国上市。

西门子与英伟达宣布开展深度合作。鉴于全球劳动力短缺日益严重,AI驱动工业发展的需求愈发迫切。西门子正在将CUDA - X、Omniverse和AI模型集成到其全系列EDA、CAE和数字孪生工具及平台中,将物理AI应用于整个工业生命周期,涵盖从设计与生产、仿真到运营的各个环节。

AI计算需求正飞速增长。模型规模参数每年增长10倍,测试时间需求每年增长5倍,而代币成本每年下降10倍。这表明各方都在竞相迈向更高层次,意味着这是一个计算难题,必须每年推进计算技术的发展。

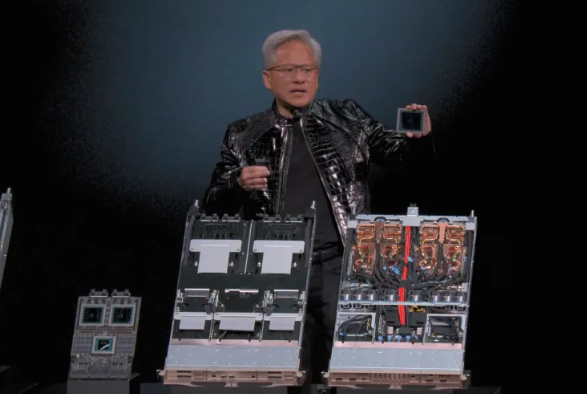

新一代AI服务器Vera Rubin已全面投产。Vera Rubin采用六款部件极致协同设计,包括NVIDIA Vera CPU、NVIDIA Rubin GPU、NVIDIA NVLink™ 6交换机、NVIDIA ConnectX® - 9 SuperNIC、NVIDIA BlueField® - 4 DPU和NVIDIA Spectrum™ - 6以太网交换机,可大幅缩短训练时间和推理令牌成本。每款Rubin GPU配备8个HBM4显存堆栈,提供288GB容量和22TB/s带宽。

与上一代Blackwell相比,Vera Rubin机箱组装时间从两小时缩短至五分钟,且80%的部件采用液冷散热。Vera Rubin的数据吞吐量大幅提升,在一个月内训练100万亿个代币的测试集,所需GPU数量仅为Blackwell的四分之一。Rubin的吞吐量约为Blackwell的10倍,代币成本仅为Blackwell的十分之一。Rubin的NVFP 4数据类型推理性能高达50 PFLOPS,是Blackwell GB200的5倍;NVFP4训练性能高达35 PFLOPS,是Blackwell的3.5倍。