作者

Samir Jaber

Samir Jaber 是一位经验丰富的科技作家、编辑和行业专家,专注于人工智能、边缘计算和先进工程系统领域。他是 Wevolver《Edge AI Technology Report》系列的主编,负责引领该系列报道的编辑方向,这是行业内最深入、最具应用驱动性的 Edge AI 探索之一。他的工作处于半导体、嵌入式智能与实际部署的交汇点,涵盖工业、汽车、医疗和消费系统等多个领域。

Samir 已撰写数百篇文章和技术报告,与 AI、IoT、Industry 4.0、先进制造、deep tech 和新兴技术领域的技术领导者、工程师和产品团队紧密合作。作为主编,他从整个 Edge AI 生态系统中策划多方观点,将技术进步转化为对该领域发展方向及实际应用的清晰洞察。

他还是 Wryters 的首席编辑兼创始人,这是一家精品内容工作室,专注于为工程和产品驱动型公司提供技术叙事服务。他的背景融合了机械工程、材料科学和纳米技术的学术研究,以及在纳米制造和微流体领域的获奖和专利工作,同时拥有多年数字营销、编辑领导力和技术沟通的实践经验。

Jake Hertz

Jake Hertz 是一名电气工程师、技术作家,专注于电子和半导体行业的公共关系专家。他拥有 EE 专业的 M.S. 和 B.S. 学位,曾为 MakerBot、UltiMaker、Hyundai 和 AT&T 等顶级品牌设计电子产品。他也是 TechInsights Microprocessor Report 的分析师,并是 Goldman Sachs 10KSB 项目的校友。

Jake 的通信业务公司 NanoHertz Solutions 与行业领导者合作,包括 NXP Semiconductors、Renesas、Synopsys、Analog Devices、Infineon 和 Texas Instruments。写作服务包括白皮书、应用笔记、博客和思想领导力文章。公关服务包括活动开发和为客户争取高曝光度的媒体投放。

John Soldatos

John Soldatos 于 2000 年获得雅典国立技术大学电气与计算机工程博士学位,目前(2014 年至今)担任英国格拉斯哥大学荣誉研究员。他曾任希腊雅典信息技术研究所(AIT)物联网(IoT)小组的副教授兼组长(2006–2019 年),以及匹兹堡卡内基梅隆大学兼职教授(2007–2010 年)。他在与大型跨国企业(如 IBM、 INTRACOM、INTRASOFT International、Netcompany)密切合作方面拥有丰富经验,担任研发顾问和交付专家,同时作为科学顾问和合作伙伴,服务于多家提供 AI/GenAI 产品和服务的高科技初创企业。Soldatos 博士是物联网(IoT)和人工智能(AI)技术及应用的专家,涉及智慧城市、金融和工业等领域。他是 150 多篇同行评审科学出版物的作者或合著者,也是 10 本 AI、IoT 和网络安全相关书籍的作者、合著者或编辑。在过去十年中,他还为各种组织撰写了数百篇技术和商业相关的博客文章、白皮书和文章。

John Soldatos 在多个社交媒体平台上活跃,发布有关技术、商业和金融的内容,包括 LinkedIn(15K+ 连接/关注者)和 TikTok(28K+ 关注者)。

前言AI 已经从计算机科学实验室中令人着迷的学术追求,转变为主流话题,现在经常出现在我们与家人朋友围坐在餐桌旁的对话中。这种转变反映了其深刻的社会融合,以及公众对其能力和影响的日益关注。

与此同时,一个专业化且同样具有变革性的方面——Edge AI——正迅速渗透到我们日常环境的方方面面。Edge AI 指的是将 AI 算法直接部署到本地设备和硬件上,例如传感器、摄像头和微控制器,而不是仅仅依赖远程云计算。这种本地化处理带来了诸多优势,包括近乎瞬时的决策能力(low latency)、增强的数据隐私以及减少的带宽消耗。

本质上,虽然通用 AI 正在改变我们谈论未来的方式,但 Edge AI 正在积极改变我们周围的物理世界,使现代生活几乎每个领域的系统都变得更智能、更快速、更自动化。

Edge AI 是一项协作努力——是一项团队运动——并通过教育、创新和合作伙伴关系迅速实现 AI 的民主化。从传感器到服务器,从 pre-seed 初创企业到大型科技公司,关键在于我们要全面思考 edge AI 如何解决我们面临的一些最大挑战,并解锁前所未见的机遇。这也是一项新兴技术和行业,我们需要保持开放的心态,迎接新的方法、架构和突破,以推动更高效 AI 的前沿。

EDGE AI FOUNDATION 的标语是"connecting AI to the real world",我想不出比这更好的方式来描述 Edge AI 的影响。每天我都会在社区中遇到新的公司,以及新的教育者和研究人员,他们都在思考 AI 如何在物理世界中运作。Edge AI 可能有许多名称——physical AI、embodied AI、tinyML、neuromorphic computing、generative and agentic edge AI,但它根植于现实世界,以更低的成本、更低的功耗和更高的影响力解决问题。

我们生活在一个以深刻技术增长和加速变革为定义的时代,特别是在 AI 领域。这份全面的 2026 报告是一份不可或缺且有价值的资源,面向行业专业人士——包括开发者、战略家、投资者和高管——他们正在积极应对 Rdge AI 技术复杂且快速演变的未来。

引言:分布式智能体时代人工智能领域"最不为人知的秘密"是边缘数据。智能的真正价值在行动点得以体现,在那里决策实时发生,并受到物理环境和运营约束的影响。"边缘数据的重要性是巨大的,"高通公司总裁兼首席执行官 Cristiano Amon 在 2025 年的一次演讲中表示,因为它能够将模型持续优化为一个动态、自适应的智能网络。换句话说,边缘是 AI 变得个性化、情境化和可自主掌控的地方。

这一观察捕捉到了定义 2026 年 AI 的转折点。虽然云基础设施对于训练和大规模协调仍然至关重要,但 AI 的重心已经转移。智能正越来越靠近必须做出决策的地方:机器、车辆、医疗设备、工厂和消费产品内部。AI 系统设计现在从根本上受到延迟、可靠性、隐私、能源效率和监管的影响。

这一转变催生了越来越被称为 Physical AI 的概念。这些系统通过传感器感知世界,在实时约束下进行推理,并直接在物理环境中行动。过去几年将多波 AI 浪潮压缩到了一条轨迹上。Perception AI 演变为 Generative AI。生成能力使 agentic 行为成为可能。Agentic AI 现在正在机器中进行物理实现。正如 NVIDIA 首席执行官 Jensen Huang 所描述的那样,Physical AI 是"Agentic AI 在物理系统中的体现"。

为了实现这一点,长期存在的"云与边缘"之争已经让位于一个更成熟的现实,我想称之为 AI 连续体。大型模型仍然在集中式环境中训练,但它们越来越多地在边缘进行蒸馏、适配和部署,在那里它们变得专业化、响应迅速且自主。

今年标志着从边缘推理到边缘代理的明确转变。设备不再局限于识别模式或分类输入。它们开始作为闭环系统的一部分进行观察、决策和行动,规划任务、与其他设备协调,并以最少的人工干预适应不断变化的条件。这一演进是由整个技术栈的进步汇聚而成的:紧凑的基础模型、异构计算架构、节能芯片、协作学习框架,以及专注于安全、隐私和可解释性的日益完善的信任栈。

《2026 Edge AI 技术报告》旨在为这一去中心化的未来提供技术和战略路线图。它围绕技术和能力构建,这些是工程师和产品团队必须掌握的构建模块,以便大规模部署智能系统:

• 认知核心(第 1–2 章):这两章探讨了现代边缘智能的软件基础。第 1 章探索了专为设备端部署而优化的紧凑基础模型和生成式推理。第 2 章将其扩展到多模态系统,展示视觉、音频和传感器数据如何融合,在边缘构建富含上下文的感知能力。

• 约束下的计算(第 3 章):边缘的自主行为最终受限于功耗、延迟和物理规律。第 3 章聚焦于定义这些极限的计算架构,从神经形态和事件驱动处理器,到传感器内计算和超低功耗设计。本章解释了为何边缘 AI 从根本上不同于云端 AI,以及新的硬件范式如何重塑始终在线、实时系统的可行性边界。

• 从推理到代理(第 4 章):在这些约束条件下,边缘系统正从被动推理向有限自主演进。第 4 章探讨了使设备能够在本地进行规划、决策和行动的 Agentic AI 框架。内容涵盖决策循环、记忆结构和安全护栏,使边缘系统能够独立执行任务,同时保持可控性和可预测性。

• 物理世界中的智能(第 5 章):本章展示代理能力如何通过与环境直接交互的机器得以体现。重点聚焦于机器人、车辆和工业设备等物理和具身 AI 系统,其中感知、控制和执行紧密耦合。本章还探讨了现实世界的约束条件,包括散热、可靠性、安全认证以及从仿真到现实的迁移。

• 运营骨干(第 6–7 章):随着边缘 AI 部署规模的扩大,运营成为瓶颈。这两章探讨了边缘 MLOps、编排、连接性和协作学习机制,使分布式系统能够保持可靠、安全和最新状态。

• 人与信任层(第 8–9 章):当边缘 AI 适应个体和环境时,它变得最强大——也最敏感。第 8 章探索设备端的超个性化和上下文自适应。第 9 章介绍信任栈,涵盖负责任边缘 AI 部署所需的安全、隐私、可解释性和治理。

• 展望未来(第 10 章):最后一章综合了塑造边缘 AI 下一阶段的技术轨迹、标准和监管力量。本章突出了新兴的创新前沿,以及对规划未来十年的工程师和组织的战略意义。

本报告是 Wevolver Edge AI Technology Report 系列的最新一期,延续了自 2023 年以来的年度报告。它在以往研究成果的基础上,融入了新的技术发展、数据驱动的洞察和前瞻性分析,与塑造下一代智能系统的工程师、架构师和决策者息息相关。

本报告凝聚了 Wevolver 编辑团队、学术研究人员、行业从业者和生态系统合作伙伴的贡献与见解。我们谨向今年的赞助商表示感谢:Arduino、Edge Impulse、Harwin、MIPS、Murata、Nordic Semiconductor、Synaptics 和 Synopsys,他们的支持使本工作的深度和技术严谨性得以实现。

这些页面中探讨的技术是 2026 年及以后的工程现实。

2026年人工智能的发展轨迹,不仅由2020年代初期所定义的参数量持续扩张所塑造,更受到向密集化、效率和架构专业化持续推进的深刻影响。虽然基于云的Large Language Models (LLMs) 继续快速演进,并作为众多AI工作流的核心支柱,但与此同时,另一类模型也在不断成熟,以应对现实世界部署中的种种约束。

Edge Foundation Models专为在消费电子产品和工业终端设备的热管理、功耗和内存限制范围内运行而设计。随着智能能力日益向行动端点靠近,这类模型的重要性愈发凸显。这一转变反映了神经计算领域的根本性重构。

Small Language Models (SLMs) 和紧凑型生成式transformers的日趋成熟,使得高级推理能力得以在本地执行,从而支持离线运行、隐私保护以及对延迟高度敏感的应用场景——在这些场景中,集中式基础设施往往会受到可用性、数据本地化或实时推理能力的限制。

效率实际上已成为一个工程边界。2026 年的行业讨论正围绕设备端语言模型的实用"Goldilocks zone"(最佳区间)汇聚,通常涵盖亚十亿到个位数十亿的参数范围。这一区间的模型在可用的语义深度与移动 System-on-Chips (SoCs) 和嵌入式平台的热、功耗及内存限制之间取得平衡。这种汇聚趋势因越来越多可用的小型模型家族而得到加强,例如 Meta 的 Llama 3.2 变体、Google 的 Gemma 3 模型和 Microsoft 的 Phi 系列 mini 模型,它们都在缩减规模的情况下展现出强劲性能 。这些系统共同表明,当模型针对受限部署环境进行设计和优化时,有意义的推理能力不再仅仅依赖于云端规模的参数数量。

1.1.1. 通过蒸馏规避暴力扩展实现这一效率转变的主要机制之一是知识蒸馏。开发者不再仅从原始网络规模语料库训练 SLMs,而是越来越多地依赖蒸馏工作流,其中大型预训练"教师"模型将其学到的表示和推理行为转移到更小的"学生"模型。正如 IBM 所述,这一过程超越了简单的输出模仿。通过 soft-label 监督,学生模型学习近似教师模型对 token 的完整概率分布,捕捉微妙的语义关系——通常称为"dark knowledge"——这些在传统 one-hot 训练目标中会丢失。

蒸馏有效地将教师模型内部世界模型的部分内容压缩到显著更小的参数占用空间中。虽然这种压缩无法复制原始系统的全部通用性,但它能在明确定义的领域内实现强劲性能。IBM 指出,当问题空间足够受限时,蒸馏后的 SLMs 可在信息提取、摘要和检索增强生成等任务上实现高准确度。这种任务边界效率特别适合边缘环境,因为本地执行是必需的,但功耗、内存和热预算仍然受到严格限制。

这一效率优先方法的补充示例由TinyLlama等模型提供。TinyLlama拥有约11亿参数,在约一万亿token的异常大规模语料库上进行了训练,表明激进的数据扩展和严谨的架构设计可以显著增强SLM的能力。这种方法不依赖参数增长,而是强调表示质量和训练效率, resulting in a model that outperforms many peers in the sub-2B类别中,同时更易于在设备端部署。

在实践中,知识蒸馏使得有意义的推理能力能够在设备端部署,而无需承担与云端推理相关的能耗和延迟成本。通过将复杂的模式学习前移至训练阶段,SLM可以在移动和嵌入式平台上本地执行推理,从而实现响应迅速、保护隐私的应用程序,而这些应用如果完全依赖集中式基础设施提供服务将是不切实际的。

1.1.2. 推理高效架构:内存、延迟和序列扩展除了训练时效率之外,架构创新在使语言模型适应边缘部署方面也发挥了决定性作用。设备端推理不仅受到计算吞吐量的限制,还受到内存带宽、缓存行为和端到端延迟的制约。因此,许多SLM中最具影响力的进展都集中在减少推理时开销,而非增加原始模型容量。

一种广泛采用的优化是Grouped-Query Attention (GQA)。在标准的多头注意力机制中,每个注意力头都维护自己的key-value (KV)缓存,导致内存使用量随头数量和序列长度线性增长。GQA通过允许多个query头共享一组较小的key-value投影来减少这一占用。这显著降低了推理过程中的KV缓存内存需求,使中小型模型能够在DRAM容量受限的设备上支持更长的有效上下文窗口。虽然GQA不改变基本的注意力机制,但它在表达力和内存效率之间提供了一种实用的权衡,这已成为面向边缘的模型设计中的常见做法。

与此类优化并行的是,2024-2025年人们对完全超越Transformer注意力范式的架构兴趣日益增加。以Mamba系列为代表的State Space Models (SSM)将序列建模视为连续时间动态系统,而非token到token的注意力过程。这种表述使得推理复杂度随序列长度线性扩展,避免了基于注意力的模型固有的二次方增长。对于涉及长流式输入的边缘场景——如音频、传感器数据或时间序列日志——这一特性能够实现更可预测的延迟和更低的内存压力。

重要的是,这些架构并非Transformer的通用替代品。相反,它们代表互补的工具,特别适用于长上下文处理、流式推理或严格延迟限制占主导地位特定工作负载。在实践中,许多边缘部署结合了多种技术——知识蒸馏、注意力优化(如GQA)以及选择性使用非注意力架构——以满足实际设备的操作约束,同时不牺牲任务级性能。

借助 Arduino 降低边缘 AI 的门槛

边缘 AI 开发日益跨越两个传统上相互独立的领域:实时嵌入式控制和应用程序级计算。许多现代边缘工作负载将传感器驱动的确定性行为与数据密集型任务(如视觉推理、用户交互或本地分析)相结合。在实践中,这通常意味着需要在微控制器固件和基于 Linux 的应用程序栈之间切换,而两者各自拥有不同的工具链、部署模型和运行假设。以连贯的方式桥接这些环境,已成为开发智能边缘系统的开发者们反复面临的挑战。

Arduino 通过重新思考边缘 AI 开发入门阶段硬件与软件的结合方式来解决这一问题。随着 Arduino* UNO™ Boards Q 和 Arduino* App Lab 的推出,重点在于将微控制器和微处理器的工作流统一为单一的开发体验,在保持易用性的同时支持有意义的设备端智能。

在硬件层面,UNO Q 将实时 STM32 微控制器与支持 Linux 的 Qualcomm Dragonwing™ 微处理器相结合。这种双核架构允许开发者根据运行需求划分工作负载。时间关键型功能(如电机控制、传感器采样和安全逻辑)在 MCU 上以确定性时序运行,而计算密集型任务(如计算机视觉、网络通信和用户界面)则在 MPU 上执行。两者之间的通信通过 Arduino* Bridge RPC 处理,使协调运行成为可能,同时无需开发者管理底层的进程间复杂性。

选择基于 Qualcomm 的 MPU 带来了视觉和媒体工作负载的集成加速能力,否则这些功能需要更大、更复杂的平台。MPU 上的硬件加速(包括 GPU 资源和图像信号处理)支持本地目标检测、图像分类和其他基于视觉的应用。与此同时,MCU 继续提供可预测的实时行为,这在机器人技术、自动化和交互系统中仍然至关重要。

软件在降低采用门槛方面发挥着同等重要的作用。Arduino App Lab 提供了一个统一的环境,在后台管理 Linux 配置、容器化和部署。在 Arduino App Lab 中,AI 功能通过称为 Bricks 的模块化组件交付。每个 Brick 将特定功能(如目标检测或分类)打包为即开即用的软件模块,可通过简洁的 Python API 进行集成。

这种模式使开发者能够专注于应用逻辑而非基础设施。典型的工作流程包括选择 Brick、配置参数、将应用部署到 UNO Q,然后通过内置的 Web 界面观察结果。Arduino App Lab 自动处理容器编排、运行时管理和更新,减少了通常在嵌入式 Linux 系统上部署 AI 工作负载相关的开销。

该方案旨在从学习环境扩展到早期工业应用。UNO Q 保留了熟悉的 UNO 外形规格和引脚兼容性,同时添加了用于模块化扩展的 Qwiic 连接器以及 CAN 和 Ethernet 等接口。集成的 eMMC 存储相比可移动介质提高了可靠性,使该平台适用于工业或现场环境的试点部署。团队可以使用与后期受控生产试验中相同的软件栈,来原型化基于振动的预测性维护或视觉检查等应用。

教育和可访问性仍然是核心考量因素。具备 C++、Python 或嵌入式逻辑基本经验的开发者,无需深入了解机器学习框架或 Linux 内部机制,即可构建功能性的 AI 应用。在学术和培训场景中,这将注意力从设置和工具链转向系统行为和应用设计。

展望未来,Arduino 认为随着模型不断缩小和优化,UNO Q 将能够支持日益强大的边缘工作负载。该平台拥有足够的余量在本地运行小型语言模型,从而实现私有、低延迟的语音和文本界面。Arduino App Lab 的计划扩展包括结合视觉和音频的多模态 Bricks,以及用于更自然交互的生成式组件。通过将硬件能力与易用的开发模型相结合,Arduino 正在扩大能够构建智能边缘系统的人群范围,并加快从原型到部署的速度。

1.2. 蒸馏与量化:面向边缘的数学压缩生成式AI在边缘端的可行性,基于一套精密的压缩技术栈,这些技术已从训练后的新奇方案,转变为模型生命周期中的核心组件。

1.2.1. Activation-Aware Weight Quantization (AWQ)在后训练量化技术中,Activation-Aware Weight Quantization (AWQ) 已成为一种广泛采用的方法,用于在受限硬件上部署中小型语言模型。AWQ 的核心理念在于,并非所有权重对模型准确性的贡献都相同;其影响取决于与之交互的激活值的幅度。AWQ 并非对所有权重一视同仁,而是选择性地为与较大激活值相关的一小部分权重保留更高精度,同时对剩余权重进行激进的量化 。

这种激活感知方法解决了困扰早期均匀量化方案的"离群值问题"。在这类方案中,少量极端激活值迫使量化范围扩大,从而降低了大多数权重的精度。AWQ 通过 channel-wise scaling 缓解了这一影响,有效地重新分配量化误差,从而保持任务级别的性能。重要的是,AWQ 无需训练且数据效率高,仅需一个适度的校准数据集即可确定最优缩放参数,这使其非常适合实际的边缘部署。

1.2.2. 超低精度模型:二进制与三进制前沿在 4-bit 和 8-bit 量化之外,正在进行的研究通过二进制和三进制神经网络探索极端数值压缩的极限。诸如 BitNet 之类的方法将模型权重限制为一小组离散值——通常为 -1、0 或 1——从根本上改变了推理计算的方式。通过用整数加法替换浮点数乘法,这些模型有望在算术层面显著降低计算能耗和硬件复杂度 。

关于结构化二值化技术的近期工作,包括 STBLLM 等方法,引入了逐层稀疏性和精度控制,以减轻与超低比特表示相关的表达能力损失 。在这些方法中,网络的早期和晚期层保留更高的表示能力,而更深的内部层则被激进度量化或二值化。虽然这些方法在 2026 年仍主要处于实验阶段,但它们指向了一类未来的生成模型,这些模型针对超低功耗环境进行了优化,而传统量化策略在这些环境中并不足够。

目前,二进制和三进制语言模型最好被视为研究前沿,而非可投入生产的解决方案。然而,它们的进展强调了一个更广泛的趋势:随着 edge AI 的成熟,效率提升越来越通过数学和架构简化来实现,而非通过渐进式的硬件扩展。

1.3. 硬件加速:NPU 时代基础模型的进步与边缘芯片的演进紧密相连。随着生成式工作负载迁移到消费级和工业级设备上,神经处理单元(NPU)已成为在严格的功耗和散热限制下进行持续 AI 推理的主要引擎。虽然 GPU 在开发和灵活工作负载方面仍然具有价值,但 NPU 在边缘端的 transformer 风格推理方面日益展现出更高的效率。

1.3.1. 异构计算架构现代 SoC 围绕异构计算架构设计,融合了通用 CPU、GPU、DSP 和专用 NPU。来自高通技术公司和苹果等供应商的平台集成了专门的 AI 引擎——如高通® Hexagon™ NPU 和苹果的 Neural Engine——这些引擎专为深度学习中的密集线性代数运算而设计。

与优先处理吞吐量和灵活性的 GPU 不同,NPU 针对确定性、低功耗执行进行了优化。其架构强调高吞吐量的乘加阵列,针对 INT8 和 INT4 精度进行了调整,这反映了量化推理在生产模型中日益重要的作用。这些加速器与软件栈紧密耦合,软件栈根据延迟、功耗和精度要求在计算域之间调度工作负载 。

当今一个明确的架构趋势是积极减少数据移动。在边缘工作负载中,在内存层级之间传输数据所消耗的能量远高于算术运算本身。当代 NPU 通过分块和大型片上 SRAM 缓冲等技术来缓解这一问题,使活跃模型权重和激活值靠近计算单元。通过最小化 DRAM 访问,这些设计既降低了推理延迟,也减少了功耗,使得在移动功耗范围内实现响应式的设备端语言和视觉工作负载成为可能。

1.3.2. 始终在线的传感枢纽(Always-On Sensing Hub)与高性能 NPU 相辅相成的是始终在线传感子系统的持续演进。这些超低功耗计算单元以毫瓦级功耗预算持续运行,负责处理音频、视觉和惯性传感器的数据流。如今,传感枢纽越来越多地集成了轻量级神经加速器,能够运行高度量化的"tiny"模型,用于事件检测和情境感知。

这些微模型并非执行完整的生成式推理,而是充当智能过滤器。它们在本地检测模式和情境触发器,仅在需要更高级别推理时才会将处理任务升级至主 NPU。这种分层执行模型实现了环境智能的多种形式——如情境感知交互或主动式协助——同时保持电池续航。通过将持续传感与重量级推理分离,边缘平台能够保持响应能力,而无需承担始终在线生成式模型的能量成本。

1.4. 人工智能的连续体(The Continuum of Artificial Intelligence)边缘基础模型(Edge Foundation Models)正逐步成熟为精密工程系统,专为与物理世界交互而设计。模型蒸馏、激活感知量化和专用 NPU 架构的进步共同重塑了智能在集中式基础设施之外的部署方式。计算能力不再是以云和边缘之间的二元选择存在,而是形成了一个连续体,涵盖毫瓦级传感枢纽、嵌入式控制器和高性能移动处理器。

这一转变使智能能够动态分配,将感知、推理和响应尽可能贴近行动点。其结果是一类新兴系统的出现,这些系统以更低的延迟、更强的隐私保障以及与环境和情境信号更紧密的耦合运行。正如后续章节将探讨的那样,这一连续体为多模态感知、自适应行为以及边缘端日益自主的运营提供了技术基础。

第二章:多模态边缘模型边缘智能的定义已从处理单一数据流(如文本或静态图像)扩展到多种感官输入的协同综合。多模态边缘 AI 指的是集成视觉、音频、radar、LiDAR 和惯性数据以构建对物理环境连贯理解的系统。这种能力是具身 AI 系统的基础,例如自主移动机器人(AMRs)、工业巡检无人机和先进假肢,这些系统必须在动态、部分可观察的环境中运行。将声音与视觉事件关联,或将热特征与振动模式关联的能力,使这些系统能够推理因果关系和上下文,而不仅仅依赖统计模式匹配。

多模态AI的核心工程挑战在于融合(fusion):即何时以及如何组合来自不同传感器信息的架构决策。如今,该领域已超越简单的拼接(concatenation),转向更为审慎的融合策略,以在表征丰富性、计算延迟和鲁棒性之间取得平衡。这些策略可分为早期融合、晚期融合和混合融合。

早期融合:数据级

早期融合在原始或轻度处理的传感器输入进入主神经网络之前将其组合。例如,在工业安全摄像头中,RGB像素数据可能与热成像在输入层堆叠,形成多通道张量(tensor)。这种方法使模型能够在初始特征提取阶段学习模态间的低层关联,例如表面外观与温度之间的关系。

虽然在输入紧密同步时效率较高,但早期融合在实际应用中较为脆弱。采样率、传感器对齐或视场(field of view)的差异会迅速降低性能,使得该策略不太适合异构的边缘部署。

晚期融合:决策级

晚期融合通过独立的编码器处理每个模态,仅在决策阶段组合其输出,通常通过合并特征向量或置信度分数来实现。这种模块化结构支持异步推理,允许每个模态按其自身的时间表运行。例如,音频模型可以处理语音命令,而视觉模型分析场景,两者的输出仅在需要做出决策时才进行融合。

该策略对传感器故障或性能下降具有鲁棒性;如果一个模态不可用,其他模态仍能有意义地贡献。然而,晚期融合往往无法捕捉细粒度的跨模态交互,限制了其在复杂感知任务中的有效性。

混合与中间融合

混合融合(或称中间融合)已成为边缘侧高性能多模态系统的主流方法。在这种范式中,各模态在网络内部的多个深度层级交换信息,而不仅仅是在输入或输出端。受Transformer启发的交叉注意力机制允许一个模态的特征在推理过程中调节或优化另一个模态的特征。

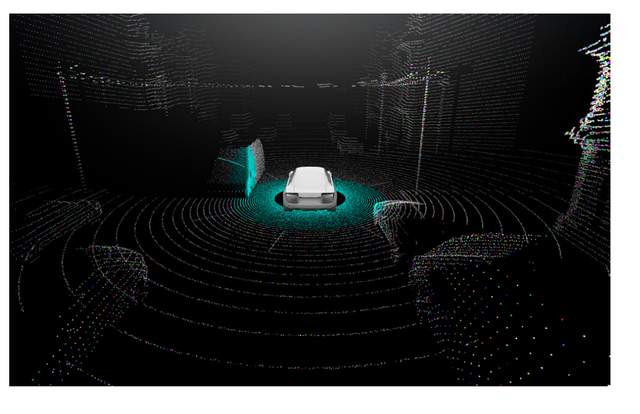

以自动驾驶车辆为例,源自LiDAR的深度信息可指导视觉特征提取,从而解决物体分类中的歧义问题。这种分层交互使每个传感器都能发挥其优势——例如LiDAR的几何精度和摄像头的语义细节——从而构建出更具鲁棒性和上下文感知能力的感知系统。受Granger风格模态影响分析启发的分析技术正越来越多地应用于研究中,以量化不同输入对最终预测的贡献程度,并减少对单一传感器的过度依赖。

边缘端情境感知多模态智能

边缘AI正从单一流推理转向多模态感知,使设备能够通过视觉、音频、雷达及其他传感器等多种传感器的组合,像人类一样理解物理环境。这一转变的驱动力源于实际需求:纯文本界面在用户通过键盘输入时行之有效,但物理AI系统必须解释感知到的世界并做出反应。例如,自动驾驶汽车可以融合摄像头和雷达数据进行导航,同时利用音频理解语音指令。在各种设备和应用中,用户期望正朝着沉浸式、情境感知的体验提升,这些体验能够即时响应,无需因往返云端而产生延迟。将这些模型从服务器环境迁移到边缘设备会加剧约束,因为丰富的情境感知必须在低功耗下实现实时响应。

对于芯片团队而言,多模态需求首先体现为硬性设计指标。客户通常带着目标模型而来,询问其是否能在特定的SoC配置上运行。每秒令牌数(tokens per second)的性能很快会遇到功耗、成本和硅片面积的约束。在实践中,团队会在每秒令牌数、每瓦每秒令牌数,甚至每平方毫米每秒令牌数之间进行优化。多模态工作负载会对整个平台而不仅仅是AI加速器造成压力。内存容量、外部DRAM带宽、传感器输入和漏电功耗经常会成为限制因素。在投入硅片制造之前,早期的架构探索对于合理确定计算能力、内部SRAM和内存接口规模至关重要。

多模态模型还会改变SoC内部的计算平衡。与单模态LLM相比,多模态系统通常会引入额外的输入模态,从而增加数据量和计算需求。在某些情况下,这使得多模态推理更适合专用NPU,因为高MAC利用率可以抵消参数带宽压力。为CNN和transformer风格视觉工作负载设计的NPU仍然有效,但随着多模态研究的发展,系统瓶颈越来越倾向于内存带宽和软件支持。

因此,异构计算已成为常态,应用处理器、NPU、DSP和微控制器协同工作以服务工作负载的不同部分。然而,这些计算模块的有效性仅与其底层基础相当。Synopsys提供定义这一基础的核心IP,包括嵌入式内存、逻辑库和片上非易失性内存IP(NVM)。这些元素共同决定了可实现的带宽、漏电行为、启动性能、校准数据等,使其成为任何多模态边缘SoC的首要设计考量。

Synopsys围绕这一全栈现实定位其广泛的IP产品组合。客户将经过硅片验证的NPU和矢量DSP与接口IP配对,以维持实时传感器输入和芯片间扩展。当多个高分辨率摄像头和雷达流并发运行时,高带宽内存接口(如LPDDR5/5X和下一代LPDDR6)至关重要。UFS等存储接口支持更快的启动和AI资产的本地存储。对于模块化设计,PCIe 5.0提供带宽和低延迟以连接外部加速器,尤其在机器人和汽车平台中。在高端领域,多芯片配置正在兴起,UCIe等chiplet链接能够实现模块化扩展,而无需重新设计整个SoC。

数据移动是许多多模态设计成功或失败的关键。常见模式包括用于缓冲和复用的深层片上SRAM层次结构、针对突发工作负载优化的时钟和电源门控,以及与真实传感器带宽需求相匹配的PHY选择。窄精度数据类型强化了这一方法。随着基于transformer的模型扩展,混合数据类型变得普遍,四位参数越来越常用于压缩模型权重并缓解DRAM带宽压力。这一转变推动NPU朝向混合模式计算发展,例如FP16特征图乘以INT4参数,并得到持续量化研究的支持。

多模态推理还扩大了攻击面。部署在开放环境中的设备必须解决篡改、侧信道风险、模型窃取、输入操纵和输出干扰等问题。Synopsys强调以硬件为根基的安全作为基础层,包括基于PUF的唯一身份识别以及用于启动和密钥管理的安全飞地。内存和高速互连的在线加密确保控制数据和传感器数据以及模型状态在通过LPDDR内存移动和跨越PCIe级链接时保持受保护,同时支持围绕完整性、来源和弹性的合规要求。

在未来几年,Synopsys预计多模态模型将遵循熟悉的发展轨迹:准确性首先提升,然后当这些模型进入实时边缘部署时,效率将成为主导约束。在效率阶段,若干设计优先级变得至关重要。这正是Synopsys IP发挥关键作用的地方。实时多模态工作负载高度依赖SoC的核心构建模块,这些IP组件共同决定了整个多模态管道能够以多高的效率和安全级别运行,使底层硅片与情境感知边缘AI日益增长的雄心保持一致。

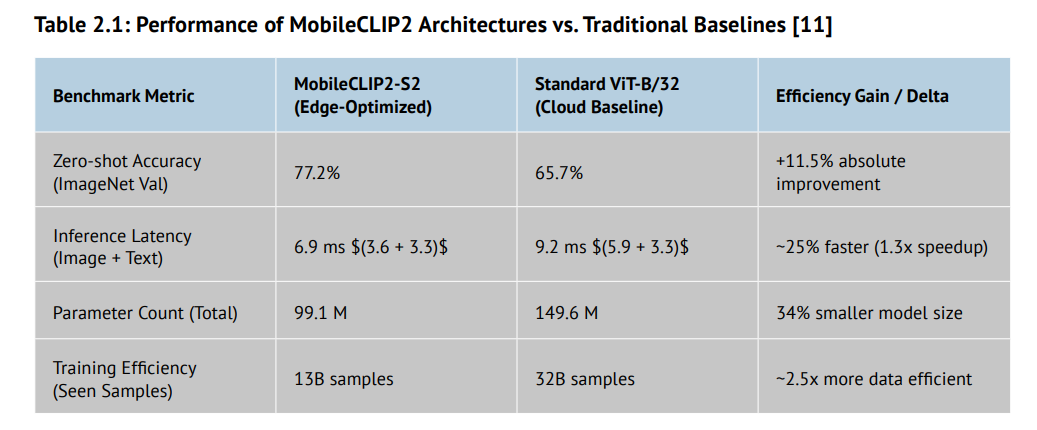

2.2. 视觉-语言模型(VLMs)与 MobileCLIP2边缘端多模态融合的一个典型代表是VLMs的出现。最近,像 MobileCLIP2 这样针对边缘端优化的 VLMs 已经证明,图像-语言对齐可以在设备上高效执行。与传统在固定标签集上训练的计算机视觉模型不同,VLMs 学习视觉输入与自然语言描述之间的共享嵌入空间。这使得边缘设备能够通过将视觉特征与文本提示匹配来识别先前未见过的对象,而无需依赖预定义类别 。

MobileCLIP2 通过一种旨在平衡性能与部署约束的训练方案实现这一能力。采用一组大型云端教师模型来生成高质量的合成标题和参考嵌入。然后训练一个较小的、针对移动端优化的学生模型,通过结合对比损失(用于对齐图像-文本对)和蒸馏损失(用于从教师模型转移表征结构)来近似这个多模态嵌入空间。

最终得到的模型参数量在约 1 亿至 1.5 亿之间,能够在现代智能手机 NPU 上以个位数毫秒的延迟实现图像-文本检索和零样本分类。这种效率水平对于设备端照片搜索、视觉辅助工具和私密内容理解等应用至关重要,在这些应用中响应速度和数据本地化是必不可少的。

尽管基于帧的相机在计算机视觉领域已主导数十年,但基于事件的视觉传感器在 2026 年正以日益增长的规模实现商业可行性。受生物视网膜启发,这些传感器以异步方式运行:每个像素仅在检测到亮度变化时才报告数据,而非以固定间隔捕获完整帧。由此产生的稀疏"事件"流提供微秒级的时间分辨率,同时避免了与静态场景相关的冗余处理 。

这种感知范式从根本上改变了边缘端感知的经济性。通过仅在发生变化时发射数据,基于事件的相机大幅降低了带宽和下游计算需求。其高时间精度使它们在涉及快速运动或高动态范围的场景中特别有效,而传统相机在这些场景中容易出现运动模糊或饱和。

在实践中,事件流正日益与标准 RGB 图像融合,以实现对高动态场景的理解。在避障或高速操作等任务中,事件数据提供精确的时间和运动线索,而基于帧的图像提供语义上下文。融合流水线利用这种互补信息来改进目标跟踪、去模糊视觉帧,或在快速运动下稳定感知,产生既时间精确又视觉丰富的复合表示。

Prophesee 等公司通过提供与广泛使用的边缘平台兼容的基于事件的视觉开发套件,加速了技术采用。这种可及性推动了神经形态边缘应用的实验,其中早期处理阶段(如光流估计)在传感器级别执行。将这些计算卸载减轻了对下游 NPU 的负担,并强化了传感硬件作为感知流水线中主动参与者而非被动数据源的角色。

2.4. 面向工业可靠性的多模态AI在工业环境中,多模态边缘 AI 的价值较少取决于模型峰值性能,而更多取决于真实运行条件下的鲁棒性。诸如视觉检测、状态监测和预测性维护等应用必须可靠运行,尽管面临光照变化、机械磨损、传感器噪声和漫长的部署生命周期。与消费类或机器人场景不同,工业系统很少能从大量标注数据中受益,尤其是对于那些发生频率低但运营成本高的故障模式。

在此背景下,一个核心挑战是数据稀缺。缺陷、故障和异常运行条件按设计本就是罕见事件。在部署 AI 系统之前等待足够的真实世界样本通常是不切实际的。因此,工业多模态工作流越来越强调以数据为中心的策略,通过增强有限数据集而非单纯依赖模型复杂度。合成数据生成已成为这一过程中的关键工具,使工程师能够在缺陷、错位、磨损模式或异常传感器信号出现在生产线之前进行模拟。

多模态在提高这些约束下的鲁棒性方面发挥着核心作用。仅靠视觉信号可能对光照变化或遮挡敏感,而振动或声学数据可能受到背景噪声或负载变化的影响。通过融合互补模态(如视觉、振动和声音),工业系统可以交叉验证观测结果并减少误报。例如,伴随相应振动特征的视觉异常比单独任一信号更可能指示真正的机械问题。

这种融合通常是务实的,而非由架构新颖性驱动。工业系统倾向于晚期或混合融合方法,允许单独调整、验证和更新各个传感器管道。这种模块化支持增量部署和维护,这对于停机成本高昂的设施至关重要。它还允许系统在某个传感器不可用或不可靠时优雅降级,保留部分功能而非完全失效。

Edge Impulse 等平台,以及西门子等公司的工业生态系统,展示了以数据为中心的工作流和多模态传感器融合如何转化为可部署的制造和维护边缘 AI 系统。通过强调合成数据工作流和跨异构边缘硬件部署,这些平台降低了工业团队采用多模态 AI 的门槛,无需深度学习专业知识。重要的是,重点不在于实现 state-of-the-art 基准测试,而在于在延长运行周期和受限硬件环境中提供稳定性能。

随着多模态边缘 AI 从试点走向生产,工业部署正在揭示在长期运行系统中真正经得起考验的因素。经验表明,模型性能受架构选择的影响较小,而更多受限于数据覆盖范围、传感器可靠性以及随时间隔离和维护各个组件的能力。这些约束正日益塑造整个边缘的多模态系统设计,倾向于采用模块化管道和保守的融合策略,以在长期运行周期内保持稳定。

在自主和机器人系统中,多模态感知是在最严格的操作约束下进行的。导航、避障以及与动态环境的交互要求感知系统不仅要准确,还要可预测且具有容错能力。因此,机器人技术已成为边缘多模态融合最具挑战性的试验场之一。

nuScenes 等基准测试在评估这些能力方面继续发挥着核心作用,重点关注模型如何有效融合 camera、LiDAR 和 radar 数据,以在复杂交通场景中检测物体并预测智能体轨迹。虽然这些基准最初是为感知和预测设计的,但它们正日益成为更高层次推理的试验平台。目前,视觉 - 语言组件正在自主管道中被探索,以提供上下文解释,通过来自环境的语义线索增强几何感知。这包括理解场景上下文,如临时道路状况或标志,而不仅仅依赖于物体检测和跟踪。

除了感知之外,定位仍然是自主操作的核心挑战。Simultaneous Localization and Mapping (SLAM) 系统已朝着紧密耦合的多模态融合方向发展,特别是通过 Visual–Inertial–LiDAR (VIL) 方法 。在这些系统中,视觉特征、惯性测量和深度观测在单个估计框架内联合优化,使得一种模态的误差可以被其他模态补偿。这种紧密耦合的公式提高了在单个传感器性能下降的环境中的鲁棒性,例如相机的低纹理走廊或干扰 LiDAR 返回的反射表面。

边缘计算平台的进步使得这些融合管道在研究环境之外越来越实用。当代边缘机器人平台提供足够的计算能力来运行实时 VIL SLAM 以及感知工作负载,使自主系统能够在不持续依赖云基础设施的情况下进行定位和导航。在软件层面,标准化的机器人框架和预优化的感知与定位模块降低了集成复杂度,使团队能够在不同平台上以更一致的方式部署多模态堆栈。

2.6. 边缘的多模态系统到2026年,多模态边缘AI已从孤立的感知模型转向集成系统,这些系统专为在现实世界约束下运行而设计。在移动设备、工业设备和自主平台中,共同的模式是务实融合,以平衡latency、robustness和maintainability的方式组合互补的传感器和模型。成功的部署不追求最大的模型复杂度,而是强调模块化pipelines、fault tolerance和context-aware inference,将多模态感知确立为边缘系统的运营基础设施,而非实验性能力。

第三章:边缘智能的超低功耗架构随着边缘智能日益普及,对持续、低功耗智能的需求已将硬件推向传统冯·诺依曼(von Neumann)模型的极限之外。数据移动已不再是一个可以通过扩展来管理的瓶颈,而是成为了嵌入式处理器中能耗的主要来源。

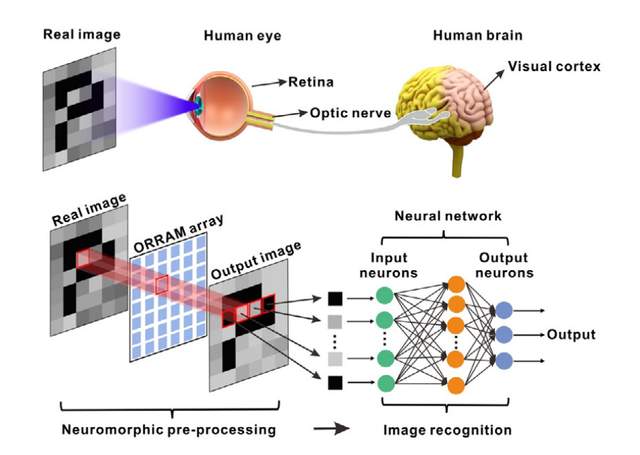

这种压力催生了新的计算架构,将处理更靠近数据生成的位置,无论是在传感器端、在非易失性阵列中,还是在事件驱动的神经基底内。总体而言,神经形态(neuromorphic)、传感器内(in-sensor)和超低功耗设计正在形成边缘计算后冯·诺依曼时代的基础。

神经形态系统模拟大脑的异步、事件驱动操作,仅在有意义的活动发生时才执行计算。通过移除固定频率的时钟信号,并允许信息通过脉冲(spikes)传播,这些系统消除了空闲周期,与同步数字逻辑相比,能耗降低了数个数量级。

新一代神经形态处理器正将事件驱动计算从实验室研究扩展到商业部署。例如,BrainChip 的 Akida Pico 通过仅在感知事件触发时进行计算,实现了低于一毫瓦的始终在线(always-on)推理。该设计采用神经形态处理单元,仅在感知事件触发时执行始终在线的分类和检测,功耗低于一毫瓦。BrainChip 有效地将智能置于传感器级别,这意味着它不需要恒定时钟周期来进行重复的内存访问。由于功耗低,可穿戴设备和工业监控等超低功耗应用可以在单颗纽扣电池上运行数月甚至数年

英特尔的 Loihi 2 以数字方式采用相同原理,在英特尔 4 工艺上制造的 128 个可编程神经核心中集成了约一百万个脉冲神经元。Loihi 2 的重要意义不在于神经元数量,而在于它证明了可编程的基于脉冲的计算可以使用标准半导体工艺流程进行扩展 。当在英特尔的 Hala Point 系统中聚合时,它可扩展至数十亿神经元,能效超过 15 TOPS/W。

一个互补的前沿方向是模拟存内计算(Analog In-Memory Computing,IMC)。IMC 不在内存和逻辑单元之间来回传输权重,而是将参数存储在非易失性单元中,在模拟域执行乘累加运算。Analog Inference 等初创公司正在开发电阻式和铁电存储器阵列,直接在阵列内执行神经运算。据 TDK Ventures 称,与数字推理相比,这种方法可将总功耗降低 90% 以上,并实现约 100 TOPS/W 的能效。尽管模拟可变性和精度仍是挑战,但它们与 SNN 共享相同的原则:最小化数据移动以最大化效率。

事件驱动和存内架构都是行业向稀疏、自适应处理更广泛转型的一部分。研究人员乐观地认为,采用这种范式可以重塑 AI 的能源经济格局,并使智能触达数十亿嵌入式设备。

面向下一代嵌入式设备的能效智能

开发者赋能是Nordic战略的核心支柱。许多物联网团队缺乏专门的数据科学资源,而易于使用的工具决定了边缘AI能否成为主流。通过Neuton实现的自动化模型创建降低了CPU运行推理的门槛,而对CPU和NPU双管线的SDK支持则简化了部署流程。参考应用、无线协议栈和集成示例均源自同一生态系统,为开发者提供了一个连贯的开发环境,缩短了原型设计周期并降低了集成复杂度。

增长领域反映了本地智能与低功耗连接自然结合的方向。可穿戴设备正朝着持续监测运动、生命体征和环境情境的方向发展。智能建筑正在添加能够实时理解占用模式、空气质量和能源使用的传感器。工业物联网系统则将更多诊断和异常检测功能迁移至边缘,以最小化延迟和网络负载。这些领域依赖于本地处理和长电池寿命,与Nordic的设计理念相契合,使得以更低的成本和更小的外形尺寸实现更丰富的传感和解释成为可能。

Nordic认为边缘AI的未来将由更广泛的普及性和跨设备品类的多样化所塑造。随着智能从云端向边缘迁移,机会在于赋能那些此前受限于功耗、计算能力或成本的产品。Nordic在模型效率、芯片集成和开发者就绪方面的工作,使公司成为新兴超低功耗、持续感知嵌入式系统类别的关键贡献者。

边缘AI洞察:Nordic Semiconductor

在可穿戴设备、智能家居系统和工业传感器领域,开发者正将更多智能推向必须在受限功耗下长时间运行的设备。这正在塑造一类新型的超低功耗计算架构,支持在小型嵌入式平台上进行有意义的AI推理。Nordic Semiconductor正通过芯片和无线技术推进这一方向,将高效的、基于CPU的智能带入那些此前缺乏足够功耗预算进行有意义推理的设备中。

Nordic多年来一直致力于优化无线设备的功耗特性,这一基础如今已延伸至其边缘AI战略。开发者通常希望为边缘设备添加智能功能,但传统框架往往生成的模型超出了小型嵌入式系统的约束。Nordic通过定制Neuton模型解决了这一问题,这些模型逐神经元增长,直至达到最小的可行结构。

这些模型大小不到5KB,可直接在任何Nordic SoC的CPU上运行。这使得模型的尺寸和计算需求远低于传统框架,首次使基于CPU的边缘AI在超低功耗无线设备上成为可行。

对于需要更高吞吐量的应用,Nordic推出了Axon NPU,这是一款专为音频分类、语音检测和紧凑视觉任务等工作负载设计的加速器。它支持LiteRT模型,其性能和效率目标专为实时推理而设定。

Neuton和Axon共同构成了两条互补的路径:

• Neuton在传感器节点的功耗预算内实现超小型模型的分析处理,不依赖NPU加速。

• Axon处理需要更高速率感知的工作负载。

这为开发者提供了工作负载类型与计算路径之间清晰而高效的匹配。

连接性仍然是这些系统运行的核心。Nordic将其第四代低功耗2.4GHz无线电集成到如nRF54LM20B等SoC中,该芯片还在单一设备中集成了Axon NPU、Arm Cortex-M33处理器、RISC-V协处理器、存储器和RAM。该无线电支持Channel Sounding等功能,提供精确的空间定位和测距能力。这种集成确保边缘AI系统能够在本地解释数据,并通过Bluetooth LE、Thread、Matter及其他协议高效地通信结果,即使工作负载增长也能保持可预测的能耗。

开发者赋能是Nordic战略的核心支柱。许多物联网团队缺乏专门的数据科学资源,而易于使用的工具决定了边缘AI能否成为主流。通过Neuton实现的自动化模型创建降低了CPU运行推理的门槛,而对CPU和NPU双管线的SDK支持则简化了部署流程。参考应用、无线协议栈和集成示例均源自同一生态系统,为开发者提供了一个连贯的开发环境,缩短了原型设计周期并降低了集成复杂度。

增长领域反映了本地智能与低功耗连接自然结合的方向。可穿戴设备正朝着持续监测运动、生命体征和环境情境的方向发展。智能建筑正在添加能够实时理解占用模式、空气质量和能源使用的传感器。工业物联网系统则将更多诊断和异常检测功能迁移至边缘,以最小化延迟和网络负载。这些领域依赖于本地处理和长电池寿命,与Nordic的设计理念相契合,使得以更低的成本和更小的外形尺寸实现更丰富的传感和解释成为可能。

Nordic认为边缘AI的未来将由更广泛的普及性和跨设备品类的多样化所塑造。随着智能从云端向边缘迁移,机会在于赋能那些此前受限于功耗、计算能力或成本的产品。Nordic在模型效率、芯片集成和开发者就绪方面的工作,使公司成为新兴超低功耗、持续感知嵌入式系统类别的关键贡献者。

3.2. TinyML、State-Space Models 与 MLPerf Tiny在亚毫瓦级别,神经网络效率既取决于算法设计,也取决于硬件。TinyML 领域的最新研究已超越量化 CNN,转向专为低占空比运行而协同设计的架构。

主要研究会议如今将 TinyML 视为核心关注领域。例如,IEEE 国际神经网络联合会议(IJCNN 2025)设立了专门的 Tiny Machine Learning 分会,聚焦于模型优化与硬件 - 软件协同设计。与此同时,第五届 tinyML 研究研讨会更名为 Edge AI Research Track 2025,并纳入 Edge AI 基金会的奥斯汀活动中。在这些研究领域内,state-space models(SSMs)已获得广泛认可。SSMs 提供了一种资源消耗更低的方式来建模长程时间依赖关系,使资源受限的 MCU 能够利用 SSM 对顺序传感器数据或时变信号进行实时分析,而无需承担与 transformer 架构相关的内存开销。

同样,量化感知训练使设计者能够将精度降低至 8 位或混合格式,同时保持准确性。通过这种方式,量化可以显著减少内存占用并提高占空比效率。这些方法都缩小了 transformer 级网络与经典 RNN 在边缘部署方面的性能差距。

MLPerf Tiny v1.3 基准测试已成为评估此类权衡的行业标准,用于测量参数量低于百万级的模型中的关键词识别和异常检测等任务。它还新增了流式基准测试,用于测量每次主动推理周期的能耗,以实现真正的占空比效率,而非峰值功率。

在领先的 MLPerf Tiny v1.3 结果中,Syntiant 的 NDP120 实现了 1.8 ms 的推理延迟,每次关键词检测能耗为 49.6 µJ 。STMicroelectronics 的 STM32U5 优先考虑能效,而其 M7 变体则专注于速度 。

TinyML 致力于使 AI 能够更广泛地应用于各行各业的各种设备。随着学术关注度的提升、新算法的出现以及更精细的基准测试,TinyML 正走在真正普及边缘 AI 的道路上。

虽然神经形态处理器最大限度地减少了内存传输,但传感器内计算通过将智能嵌入传感元件中,几乎完全消除了这些传输。智能视觉传感器不再传输高分辨率帧供外部分析,而是直接在图像传感器上处理视觉数据。

索尼的 IMX500/IMX501 堆叠式传感器仍然是行业标准,它将 CMOS 图像传感器与片上 DSP 相结合,直接在焦平面执行推理。通过仅输出语义元数据而非完整帧,该设计减少了数据带宽和下游计算负载,实现了更快、更高效的感知。LUCID Vision Labs 的 Triton Smart 相机等产品利用索尼的传感器,实现了高达 30 fps 的离线物体检测和 8 fps 的全分辨率成像。

基于事件的传感器通过消除传统帧并异步检测亮度变化,将这一理念更进一步。Prophesee 的 GenX320 是一款 320 x 320 像素的神经形态相机,它报告光照变化而非捕捉完整帧。它提供超过 140 dB 的动态范围,延迟低于 140 微秒,功耗低于 50 mW。它还作为 Raspberry Pi 5 入门套件的一部分提供。

通过将计算转移到数据采集点,传感器内和基于事件的视觉架构从根本上挑战了传感与处理之间的传统分离。这种融合大幅降低了功耗和延迟,同时在边缘应用中实现了实时视觉智能。

3.4. 透明度、伦理与可持续性随着neuromorphic和in-sensor系统自主性的提升,透明度和信任正成为工程层面的必备要求。Spiking neural networks的灵感来源于生物神经元,但由于其以时间维度编码信息,因而难以解释。针对spike-based saliency mapping和attribution的最新研究,旨在可视化哪些神经元或放电序列会影响输出结果,从而提升系统的可追溯性。其他研究方向则聚焦于加密框架和局部自适应学习规则,以降低数据泄露风险并增强用户信心。

可持续性维度同样紧迫。根据最新估算,AI数据中心在2024年消耗了约415 TWh的电力,超过了许多国家的年发电量,且预计到2030年将增长一倍以上。若将分析范围扩展至隐含碳(embodied carbon)和冷却系统能耗,报告中的数据可能仍低估了总排放量。将推理工作负载迁移至高效的edge devices,可通过延长设备使用寿命和实现本地化决策,减少数据传输能耗和电子垃圾(e-waste)。在伦理与可持续性方面的努力,正逐步降低edge AI部署所面临的顾虑与入门门槛。倘若edge AI能够更便捷地部署,智能化技术将在所有行业中变得更加普及。

3.5. 展望神经形态逻辑、in-sensor 推理和超低功耗微控制器的融合,共同指向了边缘智能的全新未来。如今,模拟与数字、感知与处理、模型与介质之间的界限正在消融。随着 Lava、Akida SDK 和 TensorFlow Lite Micro 等 SNN 框架日趋成熟,软件生态系统正在追赶其硬件对应方的效率。2026 年及以后,研究可能会聚焦于混合模拟 - 数字计算架构、能量自适应学习规则,以及传感器、处理器和算法之间的跨层协同优化。智能正不断向物理世界靠近,并在此过程中重新定义高效 AI 对于可持续边缘的意义。