2026年2月14日,字节跳动在春节前夕扔下一枚"王炸"——豆包大模型2.0正式发布。当全球目光聚焦于GPT-5.2和Gemini 3 Pro的性能竞赛时,豆包2.0悄然发起了一场"成本革命":性能对标国际顶尖,价格却只有十分之一。作为一名产品经理,我看到的不是技术参数的堆砌,而是一个可能重塑产业格局的商业拐点——当AI从"奢侈品"变成"日用品",哪些行业将被颠覆?哪些机会正在涌现?

一、性能登顶:国产大模型的"硬刚"底气豆包2.0这次带来了一个完整的模型矩阵,覆盖从旗舰到轻量的全场景需求:

豆包2.0 Pro:32k上下文,面向深度推理与长链路任务,全面对标GPT-5.2与Gemini 3 Pro

豆包2.0 Lite:综合能力超越上一代主力模型豆包1.8,性价比拉满

豆包2.0 Mini:面向低时延、高并发与成本敏感场景

豆包2.0 Code:专为编程场景打造,与TRAE编程环境深度集成

在权威评测中,豆包2.0 Pro展现出了令人惊讶的实力:

多模态能力达到世界顶尖水平:在TVBench视觉理解基准测试中超越同类竞品

EgoTempo基准测试拿到71.8分,超越人类平均得分(63.2分)

能够精准理解视频中的动作节奏变化,实现实时健身指导、穿搭建议

推理能力硬刚国际巨头:HLE-text(人类的最后考试)权威测试:54.2分,全球最高分

国际数学奥赛IMO测评集:超越Gemini 3 Pro

SuperGPQA科学问答:分数超过GPT-5.2

HealthBench医疗健康基准:第一名

工具调用与Agent能力大幅跃升:工具调用准确率较前代提升40%

长链路多步骤任务执行成功率达91%

可稳定完成跨平台、多API、多日周期的商业分析、智能客服、研发协同

作为一名产品经理,我关注的不是"跑分第一"这种营销话术,而是真实场景下的可用性。豆包2.0在这几个维度上的突破,意味着它不再是一个"实验室玩具",而是能够进入企业生产环境的实用工具。

二、成本革命:技术优化如何做到"一分钱一分货"?如果说性能提升是意料之中,那么成本下降就是真正的"颠覆性突破"。豆包2.0的定价策略堪称"价格屠夫":

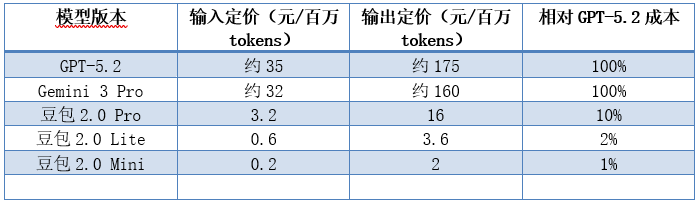

配图1:成本对比柱状图

图1:大模型API成本对比(元/百万tokens)——豆包2.0成本优势显著

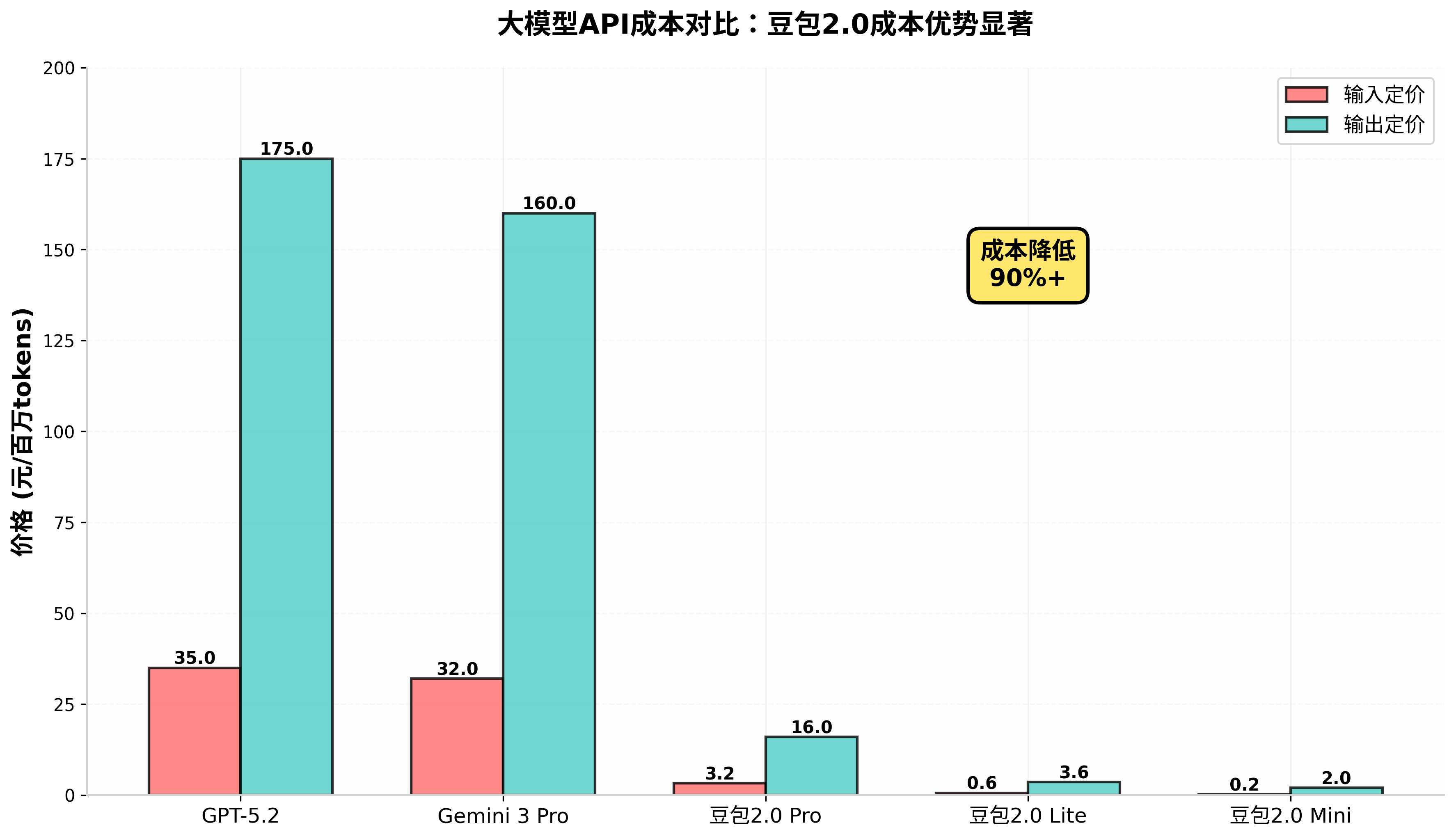

降幅90%以上,这不是简单的"价格战",而是底层技术架构的系统性优化。豆包团队通过四大技术革新实现了这一突破:

1. MoE稀疏架构:让模型"各司其职"传统大模型是全连接架构,每个token都要经过所有参数计算,效率低下。MoE(混合专家)架构让不同"专家"处理不同类型的任务,只有相关专家被激活,大幅减少计算量。

2. 算子融合与KV Cache优化:减少"中间商"开销大模型推理过程中的矩阵运算、注意力计算会产生大量中间结果,传统方案需要频繁读写内存。豆包2.0通过算子融合将多个操作合并执行,优化KV Cache(键值缓存)的存储和访问,将内存带宽需求降低40%以上。

3. 分布式推理调度:像"交通管制"一样智能分配当多个请求同时到达时,传统方案要么排队等待要么各自为战。豆包2.0的分布式调度系统能够智能分配计算资源,实现请求间的负载均衡,让GPU利用率从平均60%提升到85%以上。

4. 全栈工程化积累:字节的"基建"优势这可能是最容易被忽略但最重要的因素。字节跳动在推荐系统、广告系统、内容理解等领域积累了十年的超大规模分布式系统经验,这些工程能力迁移到大模型领域,形成了独特的成本控制能力。

产品经理视角:这种成本优势不是靠"补贴"或"烧钱"实现的,而是建立在扎实的技术积累之上。这意味着它具备可持续性,不会因为市场环境变化而突然涨价。

配图2:技术架构示意图

图2:豆包2.0四大技术架构创新——MoE稀疏架构、算子融合、分布式调度、全栈工程化

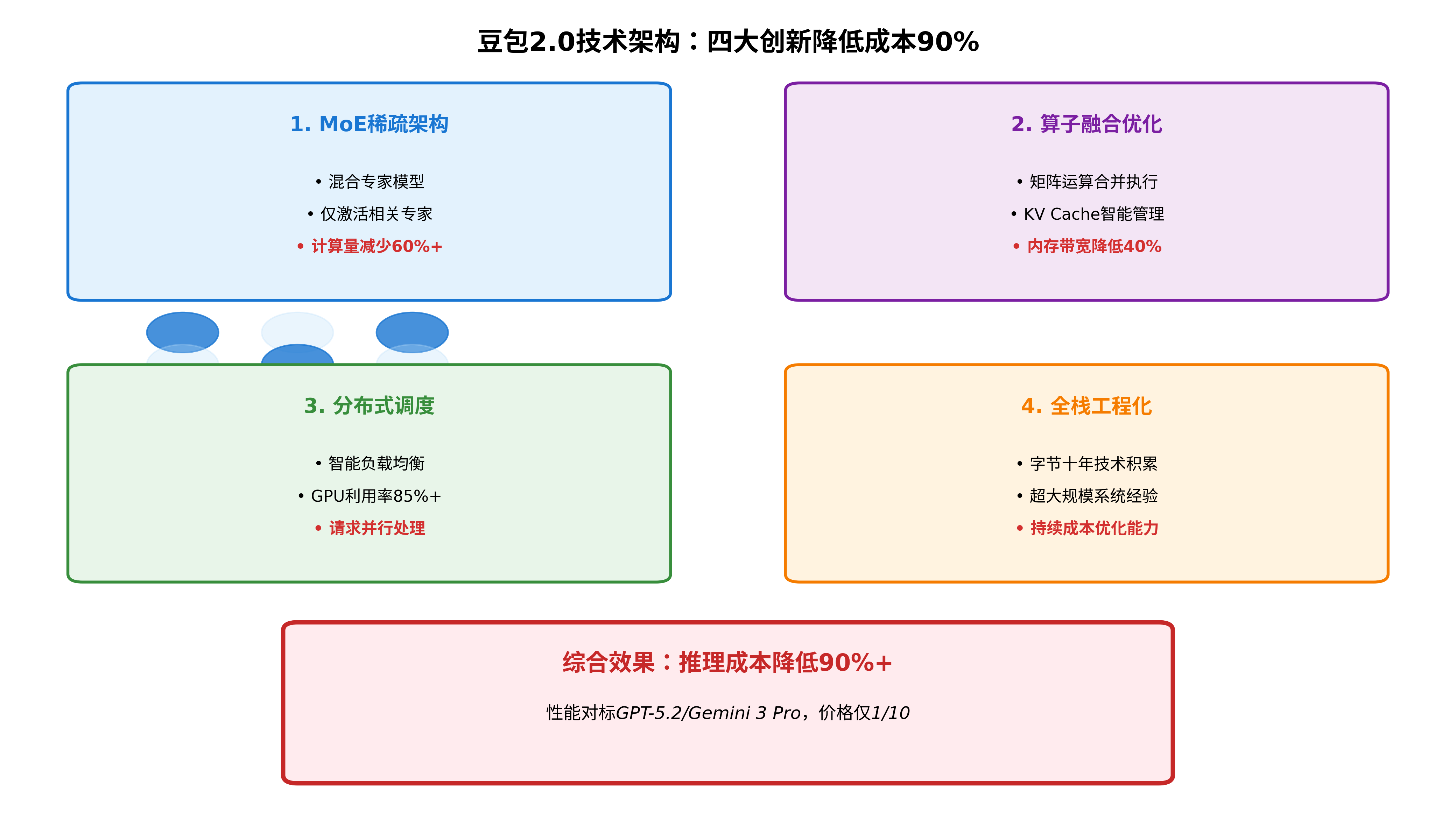

三、行业影响:谁受益?谁被冲击?成本下降一个数量级,带来的不只是"更便宜",而是商业模式的重构。

受益方一:中小企业——AI从"奢侈品"变成"日用品"过去,调用GPT-4级别的模型处理一份50页的财报分析,成本可能高达几十元甚至上百元。对于中小企业来说,这属于"用不起"的范畴。现在,同样的任务成本降至几元钱,AI从"试点项目"变成了"常规工具"。

实际案例:一家小型电商公司使用豆包2.0 Lite处理客户咨询,月成本从原来的5000元降至100元以下,客服效率提升300%。

受益方二:开发者生态——创新门槛大幅降低当API调用成本降至原来的十分之一,意味着同样的预算可以尝试10倍的想法。这将刺激应用层的创新爆发,特别是:

AI Agent自动化工作流

行业垂直解决方案

个性化智能助手

多模态内容创作工具

受益方三:传统行业——数字化转型加速金融、法律、医疗、制造等传统行业,过去因为AI成本过高而观望。现在,成本瓶颈被打破,大规模AI部署成为可能:

银行:智能风控系统成本降低90%

律所:合同审查效率提升5倍,成本降低80%

工厂:视觉检测漏检率从2%降至0.1%

被冲击方:依赖"信息差"赚钱的行业AI的本质是消除信息不对称。当大模型能够几秒钟比价几十家保险公司的产品、一键生成最优避税策略、自动完成复杂代码开发时,保险经纪人、税务顾问、部分软件开发公司等传统"中间商"将面临生存压力。这已经在资本市场显现:Atlassian跌47%、Intuit跌40%、保险经纪巨头单日暴跌15%。

四、产品经理的务实建议:如何抓住这波红利?面对这样的技术变革,企业和个人应该如何应对?我从产品经理角度给出几点务实建议:

1. 重新评估AI投入产出比如果你的公司在2025年做过AI可行性分析,现在需要重新计算。同样的效果,预算可能只需要原来的10%-20%。这意味着:

原来"不可行"的项目现在可能"可行"

原来"试点"规模可以扩大到"全公司"

原来"人工为主"的流程可以转向"AI为主"

2. 选型决策的三层考量选择大模型时,不要只看"名气"或"跑分",要从三个层面评估:

技术层面:是否支持你的业务场景(多模态、长文本、工具调用)

API稳定性与响应延迟

私有化部署支持程度

经济层面:不仅要看单次调用成本,更要看总体拥有成本

考虑团队学习成本与迁移成本

评估长期价格走势与锁定期风险

生态层面:周边工具链是否完善(开发框架、监控工具、调试平台)

社区活跃度与技术支持质量

与现有技术栈的兼容性

3. 避免的三大陷阱陷阱一:为"便宜"牺牲"效果"成本下降固然诱人,但如果模型效果无法满足业务需求,再便宜也是浪费。一定要做POC验证,用真实业务数据测试。

陷阱二:忽视数据安全与合规特别是金融、医疗等敏感行业,数据泄露的代价远超AI节省的成本。选择提供合规解决方案的厂商,必要时采用私有化部署。

陷阱三:期待"一劳永逸"的解决方案AI技术仍在快速迭代,今天的选择可能在半年后就不是最优解。设计松耦合的架构,保持切换模型的灵活性。

4. 个人发展建议对于科技从业者,特别是产品经理、开发者:

学习方向:深入理解大模型的能力边界与成本结构

技能提升:掌握AI应用开发框架,了解主流模型的API使用

机会把握:关注AI在垂直行业的落地机会,特别是成本敏感型场景

豆包2.0的成本革命,标志着大模型行业从"模型竞赛"转向"落地竞赛"。当顶尖模型的使用成本降至大众可承受范围,AI将不再是科技巨头的"玩具",而是千行百业的"生产力工具"。

配图3:行业影响矩阵图

图3:AI成本革命行业影响四象限分析——颠覆区、成本优化区、创新实验区、观望区

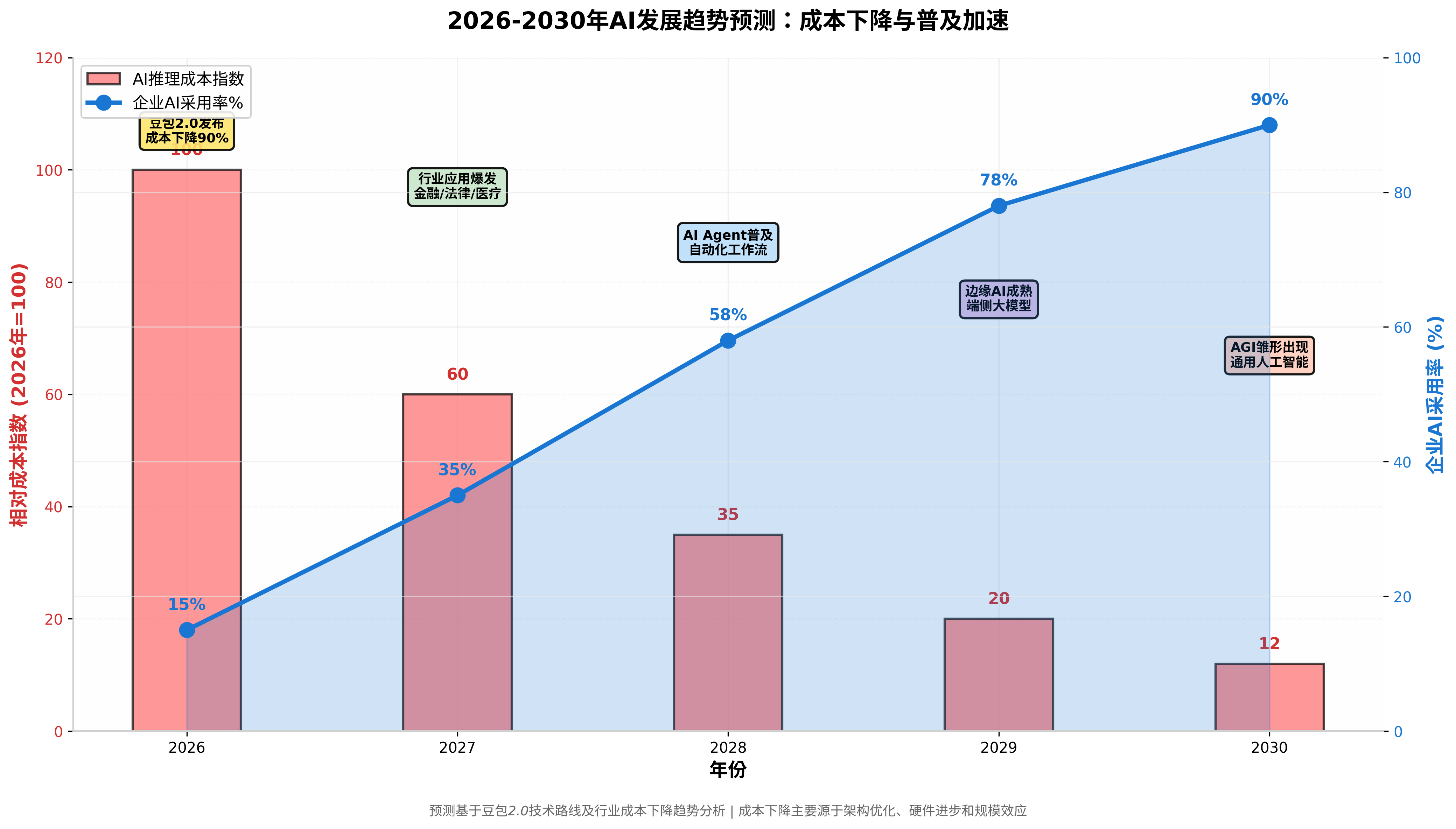

2026年可能成为AI普惠商用的元年。接下来的趋势预测:

行业应用爆发:金融、法律、医疗、教育等传统行业将出现规模化AI部署

生态竞争加剧:模型厂商的竞争重点将从"性能参数"转向"生态完整度"

成本持续下降:随着技术优化和规模效应,推理成本仍有下降空间

新商业模式涌现:按需付费、效果付费等灵活定价模式将成为主流

作为一名产品经理,我最大的感受是:技术变革带来的不仅是效率提升,更是商业逻辑的重塑。当AI从"昂贵的技术实验"变成"便宜的生产力工具",谁能率先找到正确的应用场景和商业模式,谁就能在这轮变革中占据先机。

豆包2.0的发布,可能只是这场AI工业化大戏的序幕。好戏,才刚刚开始。

配图4:时间轴预测图

图4:2026-2030年AI发展趋势预测——成本下降与普及加速时间轴

互动提问1. 你认为豆包2.0的成本优势能持续多久?A. 半年内就会被竞争对手追上

B. 能保持1-2年的领先期

C. 会长期保持成本优势

D. 取决于字节的战略投入

2. 如果你是企业决策者,会如何利用这波成本红利?A. 扩大现有AI应用规模

B. 尝试之前因成本放弃的新项目

C. 观望等待技术更成熟

D. 考虑切换到大模型技术栈

3. 你觉得哪个行业会最先被这波AI成本革命颠覆?A. 金融与保险

B. 内容创作与媒体

C. 软件开发

D. 教育培训

欢迎在评论区分享你的观点,一起探讨AI成本革命带来的机遇与挑战!