DeepSeek-V4发布仅四天,就连出三记重拳:

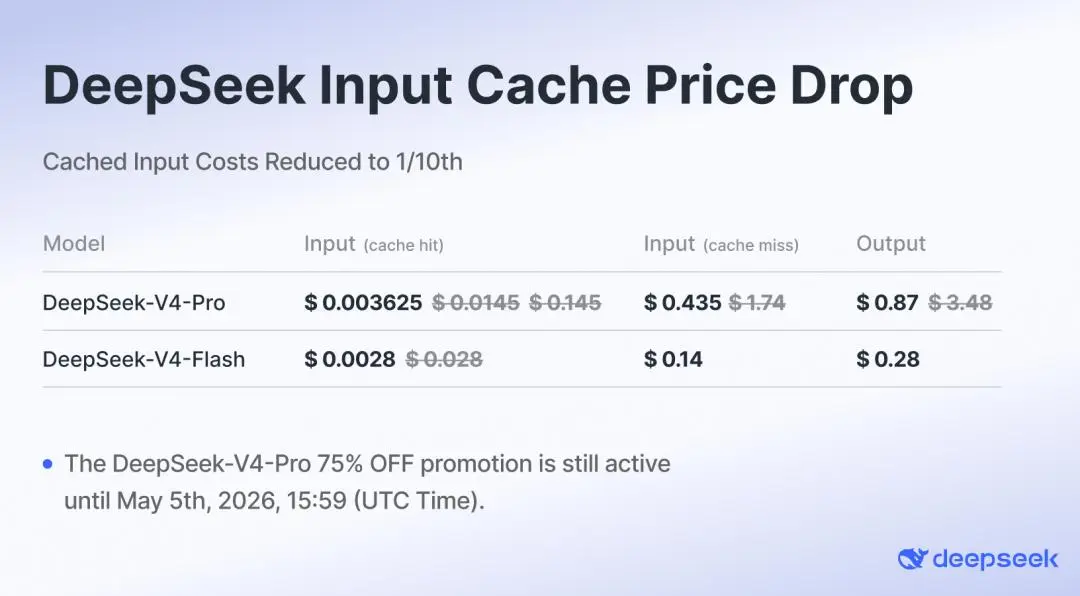

4月25日,DeepSeek-V4-Pro宣布限时2.5折,原活动持续至5月5日。

4月26日,全系API输入缓存命中价格直接降至首发价的1/10。

4月28日,官网“悄悄”更新API文档,将V4-Pro的2.5折限时优惠由原定的5月5日延长至5月31日。

叠加限时折扣后,V4-Pro的缓存输入直降40倍,低至每百万token仅 0.025元,V4-Flash则降至每百万token 0.02元,创下全球大模型价格新低。

这个价格已经打到对手的零头。同样处理100万token缓存输入,才刚上线不久的GPT-5.5 Pro要花约217元,用DeepSeek-V4-Pro只要0.025元,价差近8700倍。

事实上,速途网认为,这远非表面的“价格战”这么简单,背后是深度求索的一场长期战役。

一、从“追赶者”到“规则定义者”要理解这轮降价的深意,必须先看清DeepSeek在行业中的真实位置。

过去一年,DeepSeek改变了中国大模型行业的定价方式。V3和R1发布后,国内外模型厂商被迫重新计算API价格、训练成本和商业化路径。而跑分领先从来不是DeepSeek的核心追求,反而在精益求精地“把高性能模型的使用门槛继续往下压”。

但从V4开始,DeepSeek的角色正在发生质变——它不再只是“价格屠夫”,而是开始定义AI基础设施的成本锚点。高盛Ronald Keung团队在最新研报中评价:“V4的核心意义在于以更低成本支持更复杂的智能体应用落地,从而打开AI应用规模化的新空间。”

更关键的是,DeepSeek V4是全球关注的焦点,中国AI的代表之一。

这从OpenClaw对V4的迅速反应就可以看出。在OpenClaw发布的4.24版本中,已正式将DeepSeek-V4-Flash设为系统默认推理模型,V4-Pro同步上线模型库,可以说牌面很足了。

这似乎是一场互利共赢的双向奔赴:OpenClaw获得了更强、更便宜的中文推理能力,DeepSeek获得了千万级开发者流量的黄金入口。

事实上,这同时代表了最强Agent对于中国大模型超高性价比的持续肯定,让开发者觉得“够用且便宜”是最重要的,这相比此前的唯性能论,是完全不同的逻辑。要知道,DeepSeek调用成本仅为OpenAI的1/50至1/70。

二、降价底气是?源于技术的三重突破那么,梁文锋的真正用意是什么?在此之前,我们先看下DeepSeek为什么总能在成本端搞事情?

第一重:记忆的工业化

在百万token上下文下,V4的KV Cache占用仅为前代V3.2的10%。这其中涉及两项创新:压缩稀疏注意力(CSA)将缓存体积缩减75%;重度压缩注意力(HCA)压缩率达128倍,一整页内容浓缩成几个关键词。

缓存压缩90%后,V4可将这些条目直接存入廉价固态硬盘,用户发起请求时从硬盘拉取,跳过了昂贵的GPU预填充计算。这是“白菜价”的真正秘密。

第二重:算力的结构性瘦身

在1M长上下文下,V4 Pro的单token推理算力仅为前代的27%,V4-Flash降至10%。这其中核心是一套动态稀疏选择机制:每次生成token时只检索得分最高的1024个压缩KV条目,将传统线性增长的计算复杂度强制截断为常数级。同时,V4将专家权重量化为FP4精度,吞吐量是FP8的两倍,且维持99.7%的检索召回率。

第三重:国产算力开辟成本第二曲线

V4定价说明中还藏着一行关键信息:“预计下半年昇腾950超节点批量上市后,Pro版价格将大幅下调。”这说明DeepSeek的低价逻辑正从“模型优化驱动”转向“模型+算力体系驱动”。V4已在英伟达GPU和华为昇腾NPU两套体系上完成验证,实现1.5-1.73倍加速。V4发布当日,华为昇腾等8家国产AI芯片品牌集体宣布Day-0适配。

三、降价背后真正目标:将Agent时代的定价权带入中国节奏回到那个问题,DeepSeek降价的真正目的是什么?

市场普遍将此解读为针对 OpenAI、Anthropic 等巨头的价格战,但深入分析会发现,DeepSeek的真正目标并非某一个特定对手,而是要在大模型产业从 "对话时代" 向 "Agent 时代" 跃迁的历史关口,将全球 AI 基础设施的定价权从硅谷手中夺过来,带入中国节奏。

定价权从来不是简单的价格高低,而是定义一个时代商业规则的权力。在对话式 AI时代,OpenAI凭借先发优势在早期建立了 "按能力定价"的行业标准:GPT-4级别的模型就应该卖10美元/百万Token以上,Claude Opus甚至可以卖到20美元以上。这种定价体系建立在 "模型能力是稀缺资源" 的前提之上,让硅谷巨头能够赚取超额利润,同时将绝大多数开发者挡在规模化应用的门外。

但 Agent 时代彻底改变了游戏规则。智能体执行任务时,Token消耗不再是线性的,而是呈指数级增长。一个简单的代码编写任务可能需要数万Token的自我纠错和工具调用,一个复杂的企业级工作流甚至会消耗上亿Token。在这种场景下,硅谷的高溢价定价体系直接宣判了Agent商业化的死刑 —— 哪怕是最有前景的应用,也会可能被高昂的推理成本拖垮。

速途网认为,梁文锋正是看到了这一点,才主动出手击穿价格底线。他将V4-Flash的缓存输入价格压至0.02元/ 百万Token,V4-Pro限时优惠后仅0.025元,这个价格不到 GPT-5.5 Pro 的1/8000,不到Claude Opus 4.7 的1/1400。

更关键的是,这个价格不是烧钱补贴的结果,而是建立在真实成本优势之上的。梁文锋曾经坦言他们的定价原则:"我们的原则是不贴钱,也不赚取暴利。这个价格也是在成本之上稍微有点利润。"

"抢用户并不是我们的主要目的。我们降价一方面是因为我们在探索下一代模型的结构中,成本先降下来了;另一方面也觉得无论是API还是AI都应该是普惠的,人人可以用得起的东西",梁文锋曾在采访中表示。

当然,这种成本自信不是偶然的,而是中国 AI 产业全产业链协同的必然结果。从西部绿电,到华为昇腾、寒武纪的国产AI芯片,再到PUE逼近1.1的液冷数据中心,中国已经构建了全球最具竞争力的 "能源 - 算力 - 模型" 价值链。这种结构性的成本差异,决定了Agent时代的定价权必然会向中国转移。

市场已经用脚投票给出了答案。OpenRouter 数据显示,截至 2026 年 4 月中旬,中国模型在 OpenRouter 平台的周调用量已是美国的 4.3 倍。降价首日,DeepSeek V4-Pro的调用量就飙升近四倍,想必其中很多新增用户来自原OpenAI和Anthropic的客户。当越来越多的Agent应用基于DeepSeek 的价格体系构建时,它就会成为事实上的行业标准,迫使所有厂商要么跟进降价,要么被边缘化。

同时,我们也要清醒地看到,定价权的争夺是一场长期战役。硅谷巨头仍然掌握着顶尖模型的技术优势,OpenAI在DeepSeek降价前发布GPT-5.5,试图用技术代差来维持高溢价。DeepSeek等中国AI新贵们要真正掌握定价权,还需要在模型稳定性、工具调用能力和生态建设上持续投入。

速途网始终认为,AI最终是普惠的全球基础设施,而不是某几家巨头的盈利工具。当Agent时代的全球定价权进入中国节奏,受益的将是全世界的开发者和企业,整个AI产业的创新速度也将因此大大提速。

(文/言飞)