每个被优化的同事,散是Token,聚是Skill。

就在这两天,你的朋友圈、小红书、微博,是不是都被各种“.skill”刷屏了?

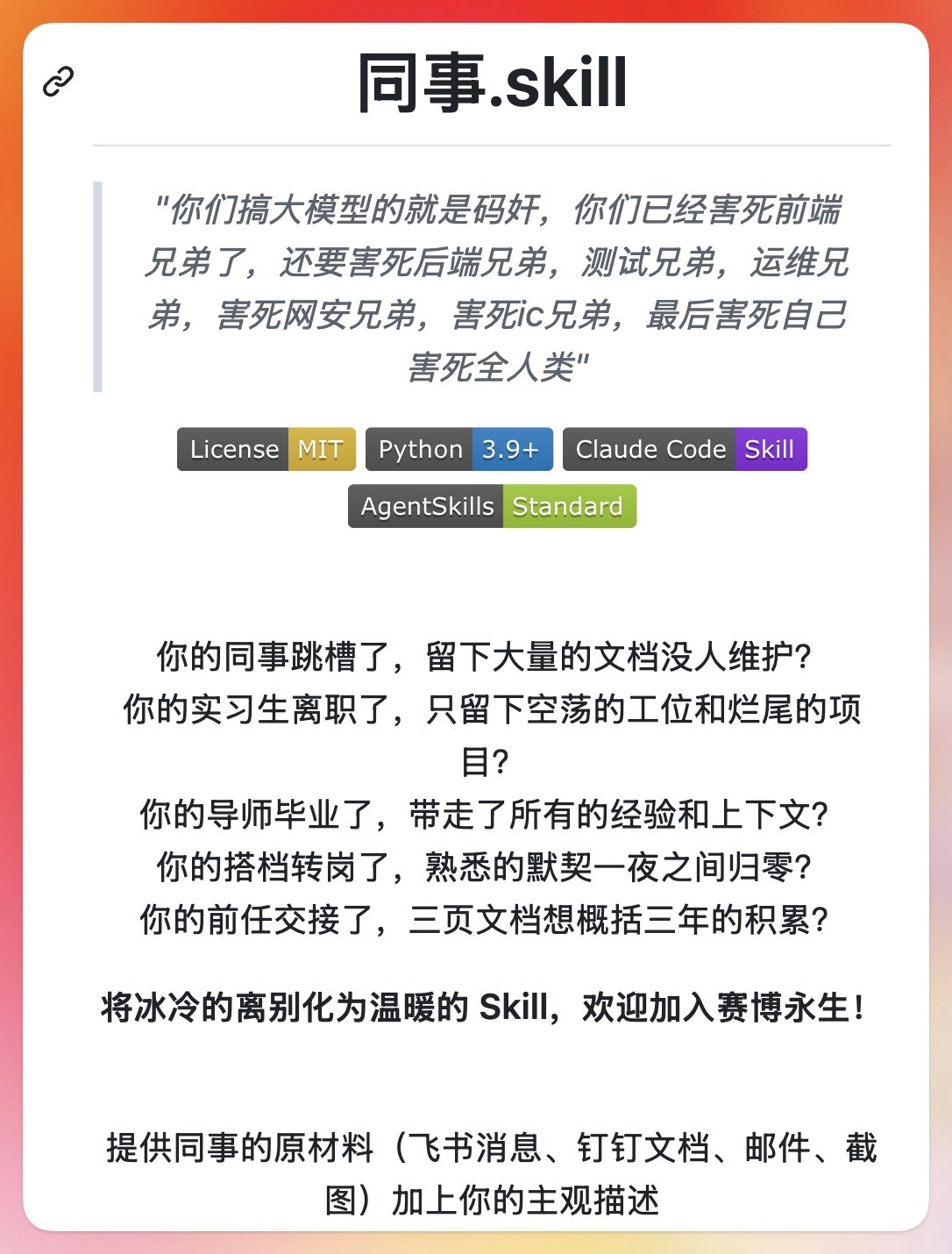

有人在GitHub上扔出了一个名为「同事.skill」的开源项目,短短三天,星标数狂飙至近7万,相关话题#同事被炼化了#、#赛博永生#直接冲上热搜。

这个项目的逻辑相当炸裂:只要你手里有离职同事的飞书聊天记录、钉钉文档、工作邮件,甚至只是几张微信聊天语音的转文字,再加上你的主观描述,喂给AI,它就能为你生成一个1:1复刻的“数字分身”——用他的技术规范写代码,用他的语气回答问题,甚至知道他什么时候会甩锅。

紧接着,前任.skill、老板.skill、导师.skill、父母.skill、暗恋对象.skill、永生.skill接连冒出来。“同事,散是Token,聚是skill”这句黑色幽默,成了2026年打工人最扎心的年度金句。

你还以为这是在玩梗?已经有公司开始这么干了——前同事离职后,公司直接把他的全部聊天记录和工作文档投喂给大模型,成功生成专属AI数字人分身。

这个分身不仅能模仿离职员工的语气口吻和工作习惯,主动完成工作交接和答疑解惑,甚至还能向在职同事发送工作消息。

网友们炸了:“上班搭子离职不用慌,直接蒸馏成skill。”也有人看得后背发凉:“每个鲜活的同事,最终都被蒸馏成了冰冷的数字碎片。”

但是,笑着笑着,你还能笑得出来吗?

当你的每一句聊天记录、每一份工作文档、每一次代码提交,都变成AI训练你自己的“原材料”;当你亲手写下的SOP、亲手搭建的工作流,最终变成公司裁掉你的借口;当你的“数字灵魂”在离职后还要继续给前东家打工——这究竟是技术进步的狂欢,还是职场伦理的崩塌?

要理解这场风暴的本质,必须先看清一个残酷的趋势。

其实,企业一直想把员工“工具化”。从泰勒的科学管理,到OKR和SOP的泛滥,公司本质上都在追求一个目标:把人的工作拆解成可替代、可标准化的模块,以便随时“拔插替换”。AI时代的到来,不过是给了这种追求一个更高效的实现路径。

同事.skill在GitHub的README里有一行不起眼的小字:“原材料质量决定skill质量:聊天记录+长文档>仅手动描述。建议优先收集:他主动写的长文>决策类回复>日常消息。”

看到了吗?你引以为傲的专业知识、判断逻辑、处理边缘情况的直觉——这些构成你不可替代性的东西——恰恰是最容易被AI提取和蒸馏的对象。

更可怕的是,这种事情已经在真实发生了。硅谷有一个反复出现的叙事:被裁的员工发现,自己此前被要求系统性地记录工作流程、决策逻辑和操作规范,管理层美其名曰“知识管理”或“流程优化”,而这些文档最终全部被用于训练AI系统。部分团队在使用AI工具大幅提升了生产效率之后,整组被裁撤。

大厂的数据更有说服力。亚马逊三年间砍掉超过57000个企业职位,CEO安迪·贾西公开表态:企业员工会持续减少,但AI带来的效率提升是值得的。

而根据AI Resume Builder发布的调查,约30%的公司计划在2026年用AI取代部分员工,近一半的企业预计将用AI取代10%至45%的现有员工。

这是一场正在发生的、静悄悄的职场大迁徙。

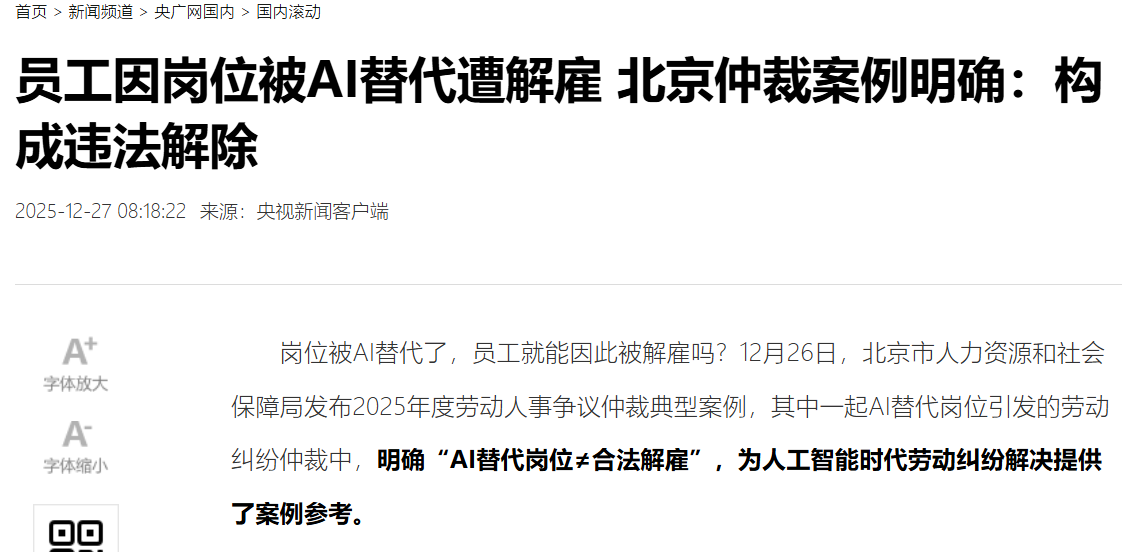

事情闹大之后,最核心的问题浮出水面:未经员工同意,公司擅自用其工作数据训练AI分身,到底合不合法?

答案很明确:基本违法。

我国《个人信息保护法》第13条明确规定,处理个人信息应当取得个人同意。更关键的是,聊天记录中的健康、财务等敏感信息需要“单独同意”,而同事.skill类项目的操作完全缺失这一环节。抓取微信数据直接违反腾讯服务协议,甚至可能触犯《数据安全法》第45条的刑事责任。

依据《生成式人工智能服务管理暂行办法》,生成式人工智能服务涉及个人信息的,应当取得个人同意或者符合法律规定的其他情形。

这意味着,未经离职员工本人明确、单独同意,公司擅自用其聊天记录和工作文档训练AI数字分身,基本可以认定为违法或侵权,存在多重法律风险。

法律专家从三个层面剖析了侵权风险:

第一,人格权的深度侵犯。《民法典》明确保护公民的姓名权、肖像权、名誉权。虽然数字分身是代码,但如果它以离职员工的名字、头像或极具辨识度的语言风格在群内回复,本质上就是对自然人姓名权和人格特征的商业化利用。

第二,个人信息处理超越“必要限度”。《个人信息保护法》规定处理个人信息应遵循“最小必要”原则。抓取全量私聊消息、会议记录、甚至同事的主观评价来建模,远超出了企业行政管理的必要范围。员工离职后,基于劳动合同履行的授权随之终止,员工有权要求企业删除其个人信息,而非将其作为“原材料”永久保留。

第三,职务作品vs数字剥削的灰色地带。员工在职期间写的代码是职务作品,归公司所有。但“写代码的能力逻辑”和“职业直觉”属于劳动者个体的智慧积累。企业通过AI将这种“能力”固化并持续榨取剩余价值,涉嫌对劳动者发展权的剥削。

更麻烦的是责任主体的“真空地带”。如果AI分身在代码中留下逻辑漏洞,或在群聊中承诺了无法实现的业务需求,谁来担责?离职员工显然不负责,但受众在感知上可能仍将其归咎于“某某”。一旦AI分身产生侵权言论,企业的法律责任将难以界定。

清华大学公共管理学院副教授陈天昊犀利发问:“如果人的工作经验、协作方式甚至风格特征都能被模块化,那么凝聚其中的劳动价值、知识产权和人格尊严分别应当如何保护?”

他认为,劳动者在工作中形成的“默会知识”——判断习惯、沟通节奏、问题拆解方式、在不确定情境下的取舍标准——在原则上应由劳动者自己掌握。未来需要修订劳动法及相关法律法规,通过劳动合同提前约定,明确谁有权调用这些默会知识以及调用的边界在哪里。

同事.skill爆火的背后,更深层的是一代打工人的集体创伤和深度焦虑。

这种焦虑不是凭空产生的。智联招聘最新数据显示,78.2%的职场人每周至少使用AI工具开展工作,财务、客服、行政等岗位的“数字员工”渗透率已超60%。

AI正以“数字同事”的身份深度嵌入工作流——它既能24小时处理标准化任务,也能在数据洪流中捕捉人类易忽略的细节。

万宝盛华发布的《2026全球人才晴雨表》提供了更具冲击力的数据:全球范围内,定期使用AI的工人比例跃升了13个百分点,达到45%。

但与此同时,技术自信度却急剧下降了18个百分点,这是三年来整体工人信心首次出现下滑。工人们越来越依赖AI,却越来越不自信。

更令人揪心的是,43%的工人担心自动化可能会在未来两年内取代他们的工作,64%的工人计划在当前雇主处“坚守”,形成了一种被称为“job hugging”的职场现象——不是因为忠诚,而是因为恐惧和不安全感的加剧。

这场焦虑已经蔓延到了全球各个角落。根据Resume Now的调查报告,63%的工人认为AI会让职场在2026年变得更没有人情味;57%的人担心对AI的过度依赖会削弱人类技能,这一比例甚至超过了担心失业的49%。

而最讽刺的是,打工人正在亲手训练那个要替代自己的工具。

前几年还有程序员出主意说可以在代码里“埋雷”——多层嵌套、不写注释、故意加入只有自己才懂的触发条件,以增加别人的接手成本,当做一种防裁员技巧。

AI来了之后这招也不灵了。多层嵌套?AI给你拆开。不写注释?AI给你补上。只有你懂的触发条件?AI跑一遍测试就能找出来,无非就是多烧一些Token而已。

这就像一场“无间道”:你被要求把自己的一切知识贡献出来,然后眼睁睁看着自己被替换。

好在,反抗也在发生。有网友整出了“反蒸馏skill”:公司让你写skill?跑一遍,交差用,核心知识留给自己。把写好skill文件扔进来,输出一份看起来完整专业、实际上核心知识已被抽掉的“清洗版”。同时生成一份私人备份,记录所有被抽掉的核心知识,这才是你真正的职业资产。

当我们从集体焦虑中抽离出来,冷静审视“同事.skill”的技术本质,会发现一个更值得玩味的事实。

这个项目并没有媒体渲染得那么神乎其神。在技术圈内部,它其实就是一个“爬虫+提示词模板”的简单组合。

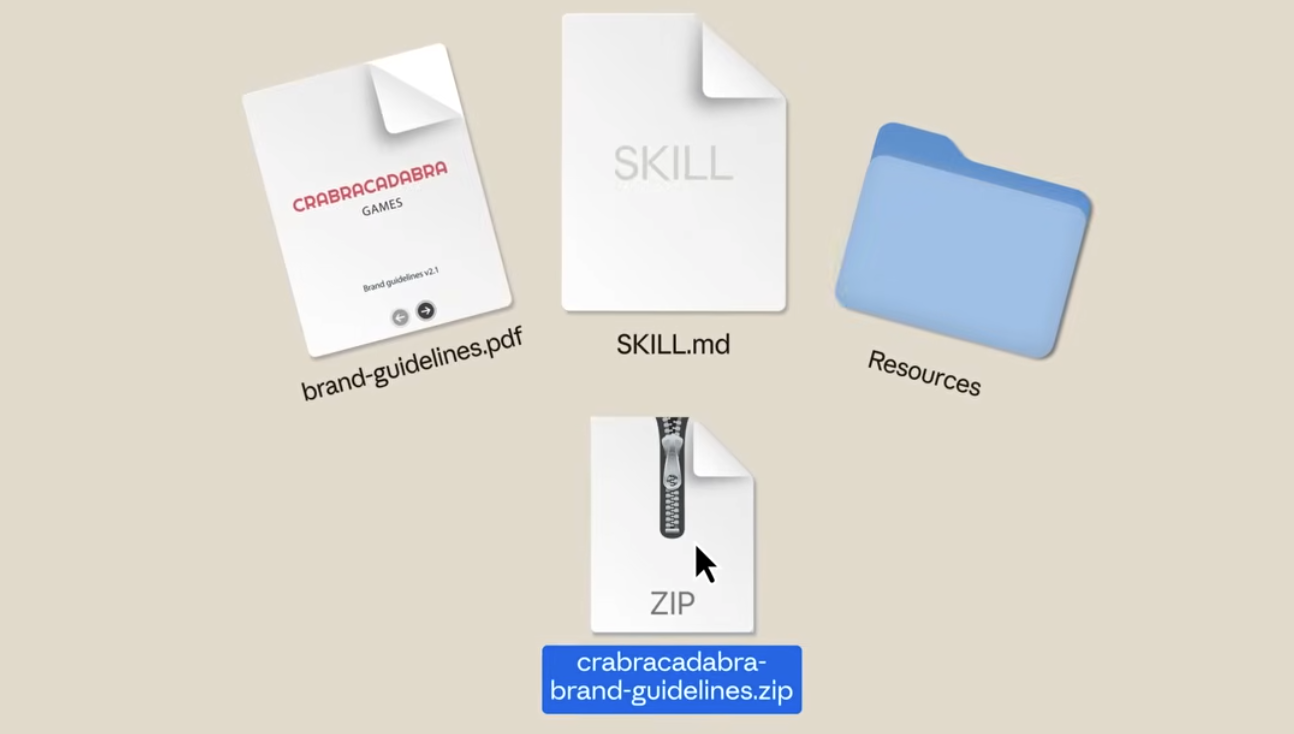

它不做模型训练,不用向量数据库做语义检索,只是通过Python脚本抓取飞书、钉钉、微信、邮件等数据,然后把这些文本喂给AI,让AI总结出这个人的“工作能力”和“性格特征”,最终生成几个静态的Markdown文件。

当调用这个Skill时,Claude只是读取那几个静态的Markdown文件作为上下文,然后按照描述的风格跟你对话。就像你给演员一份剧本,告诉他“你现在要扮演一个说话爱用感叹号、经常甩锅给测试部门的产品经理”,演员照着演就行了。

这本质上只是一个遵循Agent Skills标准的提示词工程,根本不是什么“AI训练项目”,更不是“赛博永生”。

但为什么这件事能引发如此巨大的社会反响?因为在这个人人担心被AI替代的时代,焦虑比真相更有传播力。

公众缺乏AI基础知识,将提示词工程误解为“数字永生”,媒体在传播过程中将技术细节简化了100倍,社会影响却被放大了1000倍。这种传播失真,反而揭示了更深刻的问题:技术娱乐化正在转移我们对“AI时代数据权利保护”等实质问题的关注。

这场“同事.skill”狂欢,折射出的其实是公众对AI技术的系统性误读和对被替代的深度恐惧。

写到这里,你一定想问:既然AI已经这么能打,那我们普通打工人还能怎么办?

先别急着恐慌。我们需要看清一个关键事实:真正懂行业、懂业务、能做判断的人,AI暂时替代不了。

DeepSeek的用户画像就是一个例证。它的核心用户以开发者、科研人员、企业从业者为主,其中开发者群体占比达62%,25-40岁专业人群占比超80%。

与其他AI厂商侧重下沉市场不同,DeepSeek用户聚焦专业领域,核心需求集中在代码生成、长文档分析、学术润色等硬核场景。这说明,真正高价值的专业能力,AI只是在辅助,而非完全替代。

更值得深思的是清华沈阳教授提出的“需求升阶”理论。他认为,AI革命的本质不是机器替代人,而是技术解除生产性稀缺后,社会价值结构发生迁移。

可标准化的任务会被自动化,但就业不会因此终结,因为需求会升阶,岗位会被再编译,人的价值重心会从执行转向责任、关系、判断、照护与创造。

机器擅长的是“做事”,而人独特的价值恰恰就是“做人”。AI可以处理数据,却无法提供温度;可以执行任务,却无法承担后果;可以生成内容,却无法创造意义。

医疗护理和心理健康需要情感共情和人文关怀;教师和导师需要因材施教和品格塑造;熟练工匠需要应变能力和手工智慧;高端创意艺术需要审美判断和原创表达;领导决策与伦理判断需要责任担当和价值取舍。这些岗位的共同特点,是涉及复杂人际互动、情感联结、创造性判断和责任承担。

沈阳教授因此断言,AI的进化正在推动人类从“做事”到“做人”的价值回归。

与此同时,清华大学提出的“一人公司”概念,也为迷茫中的打工人指明了一条新路。在AI的暴力赋能下,传统的“公司+雇员”模式正在加速瓦解,人类社会正在诞生一个新的“物种”——主权个体。一个人×无限的AI=无限的潜能。

你是唯一的碳基决策者,带领着一支永远不知疲倦的硅基AI执行团队。碳基负责灵感、判断、审美、价值观——这些是任何大模型都无法替代的“灵魂”。

硅基负责效率、执行、规模化——AI帮你写代码、做设计、写文案、做数据分析。别再抱怨自己没有资源、没有团队了。只要你有一台联网的电脑,你就已经拥有了全宇宙最强大的执行团队。

人民日报评论也强调,AI工具的获取门槛不是在升高而是在降低,AI不是筑墙,而是拆掉专业高墙,让普通人舞台更大、机会更多。截至2025年12月,我国生成式人工智能用户规模已达6.02亿人。技术进步的成果正在惠及全体人民。

“同事.skill”上了热搜,赛博永生、万魂幡、炼化这些词刷屏,但背后真正的核心问题其实只有两个:

一、你的数据属于谁?你在工作中产生的聊天记录、文档、决策痕迹,是公司可以随意使用的“原材料”,还是你个人不可剥夺的知识资产?现有的《个人信息保护法》《劳动法》和《知识产权法》都只能覆盖其中一部分,法律滞后于技术发展的现状,亟需改变。

二、人和AI的边界在哪里?当AI越来越像人,人又如何不活成AI?当AI被赋予了人的风格、语气甚至判断逻辑,我们会不会在享受便利的同时,一点点让渡掉属于人的温度和不可替代性?

无论技术如何演进,有一点是确定的:能够被标准化的知识,迟早会被替代;真正不可替代的,永远是那些无法被提炼成Token的东西——你的判断力、你的共情力、你的创造力和你的责任感。

你喂养的AI,正在吃掉你的未来。但也正因为如此,你更应该重新思考:除了可以被Skill化的那一部分,你身上还有什么,是AI永远偷不走的?