清华大学DeepSeek-671B大模型,运行成本大跳水!

太牛了!清华大学在AI领域取得了重大的进展,DeepSeek-671B大模型的运行费用直接从几百万降到了六万多!以前跑这个模型,必须用8卡A100服务器这种专业设备,成本超过一百万,而且服务器老是出问题,云服务器的费用又贵得吓人,很多中小团队根本用不起。

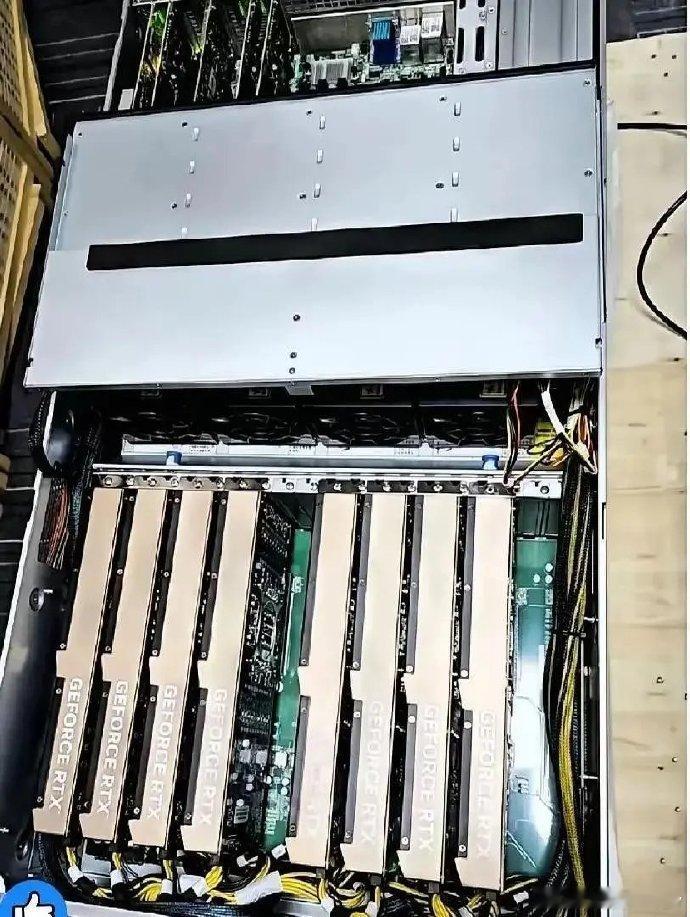

现在不一样了!多亏了清华KVCache.AI团队和趋境科技合作开发的KTransformers开源项目,现在只要一块24G显存的4090显卡就能运行DeepSeek-671B了。整套设备也就两万块左右。

这简直是天大的好消息!以前遥不可及的大模型,现在中小企业和个人开发者也能轻松使用了。这意味着什么?这意味着AI技术的门槛降低了,更多人可以参与到AI的开发和应用中来,推动AI技术在各个领域的快速发展。这波操作,直接让AI更接地气了! 以前高昂的成本拦住了很多人,现在这道坎儿跨过去了,未来可期! 基金[超话] 股票[超话]