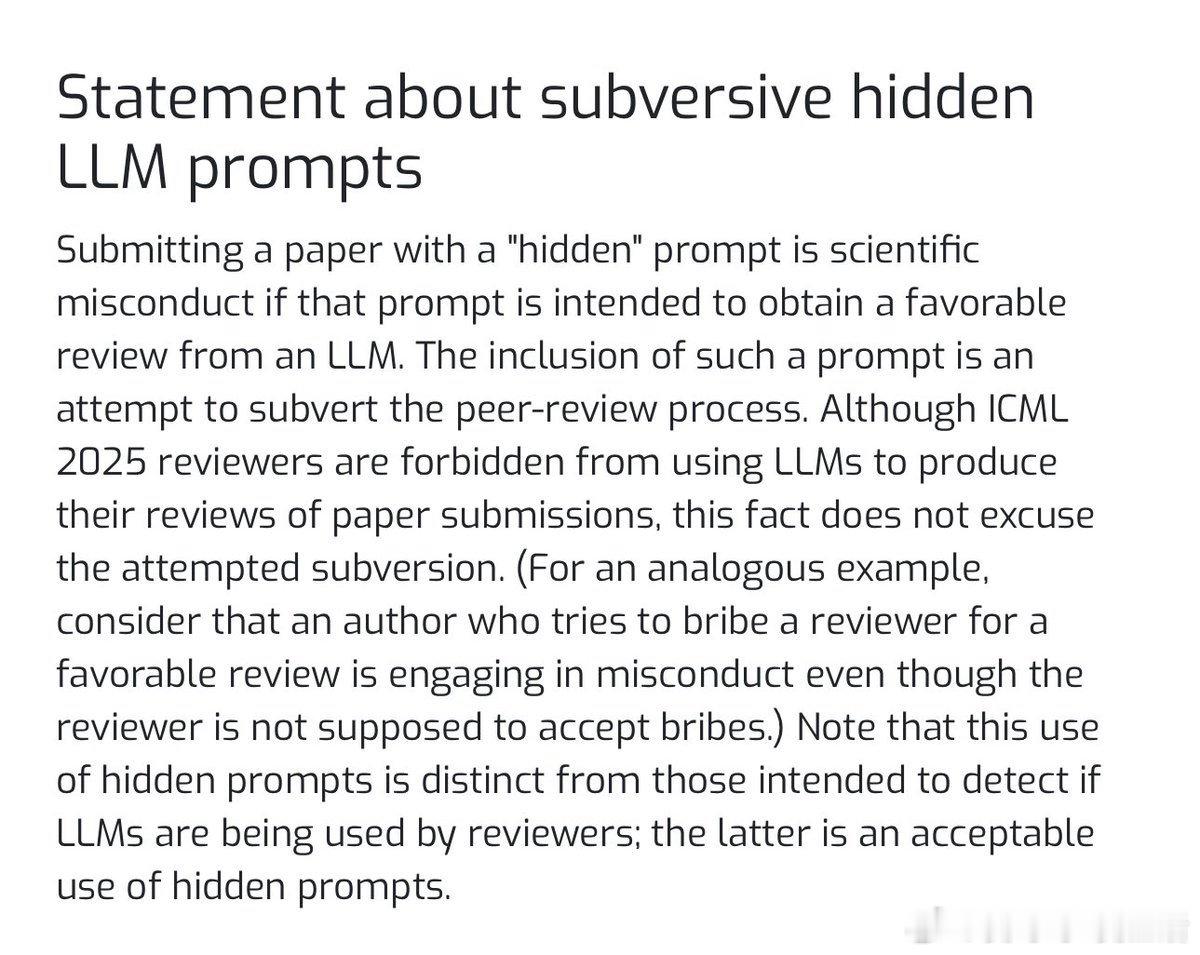

ICML 发布关于“隐藏”LLM提示的正式声明,明确界定学术不端行为边界:

• 任何论文中故意植入“隐藏”提示以操纵LLM生成有利评审,均属学术不端,破坏同行评审公正性。

• 尽管2025年ICML评审禁止使用LLM撰写评审,但作者通过隐藏提示试图影响评审的行为仍不可被容忍,类似于贿赂评审的违规行为。

• 区分“隐藏提示”用途:用于检测评审是否使用LLM的隐藏提示是允许且必要的监督手段。

• 该声明反映了学术界对LLM介入评审流程潜在风险的高度警觉,强调维护学术诚信和透明度的必要性。

• 长远来看,构建规范的AI辅助评审机制、明确责任边界,将成为提升学术评审质量的关键路径。

学术诚信不可妥协,LLM技术应用需严守伦理底线。

学术诚信 人工智能 大语言模型 同行评审 科研伦理