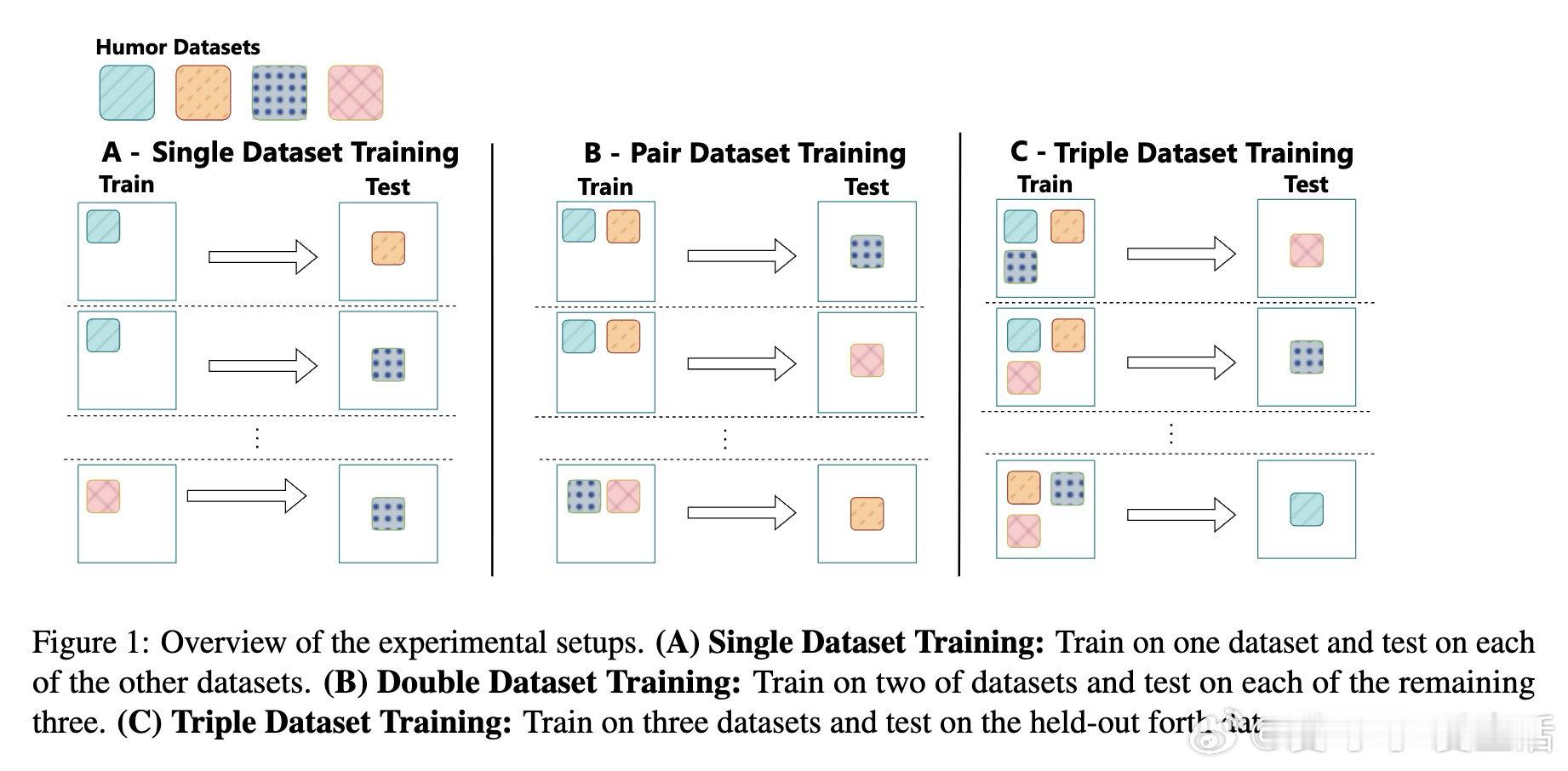

多样化训练数据显著提升大语言模型(LLMs)对幽默类型的迁移学习能力,但复杂幽默类型仍需专门训练。📊

• 实验覆盖四种幽默数据集:Amazon产品问答(讽刺)、Reddit父亲笑话(叙事型双关)、讽刺新闻标题、单行笑话,文本风格和结构差异显著。

• LLaMA-2和Mistral-7B模型在零-shot条件下表现接近随机(40%-56%准确率),微调后均能显著提升对训练域内幽默的识别。

• 迁移学习表现不对称:Dad Jokes作为训练源能较好迁移至其他幽默类型(最高达75%准确率),但从其他类型迁移到Dad Jokes效果较差(仅51%-62%)。

• Headlines和One Liners之间双向迁移效果较好,结构简洁、风格相似是关键因素。

• 增加训练数据多样性(多数据集联合训练)提升迁移性能,尤其对结构较简单的幽默类型帮助明显;复杂幽默如Dad Jokes在多样性训练下表现反而略降,表明其独特性需求专门化学习。

• 在多样性训练下,模型在各自训练领域的准确率仅小幅下降,显示出训练数据多样化对保持原有性能影响有限。

• Mistral在迁移准确率和整体表现上优于LLaMA-2,暗示模型架构和预训练背景对幽默迁移能力有影响。

• 语义嵌入分析揭示Dad Jokes和Amazon数据集内部相似度高,One Liners多样性最大;跨数据集嵌入相似度与迁移效果呈正相关。

• 研究首次系统评估了LLMs幽默迁移学习,提出生成负样本的新方法并公开数据与代码,推动未来多样幽默类型的泛化研究。

幽默的迁移学习揭示了其内在结构和复杂层次:简单幽默可靠多源训练获得较好泛化,复杂幽默则需深入专门学习。未来应拓展更多幽默类型、多模态及跨文化研究,深化模型与人类幽默认知的契合。

详细阅读👉 arxiv.org/abs/2508.19402

代码与数据👉 github.com/morturr/HumorTransferLearning.git

人工智能 大语言模型 幽默识别 迁移学习 自然语言处理