英文题目:Motion Planning Diffusion: Learning and Adapting Robot Motion Planning With Diffusion Models

中文题目: 运动规划扩散:利用扩散模型学习与适应机器人运动规划

作者:João Carvalho,An Thai Le,Piotr Kicki,Dorothea Koert,Jan Peters

作者单位: 德国达姆施塔特工业大学、波兹南理工大学、IDEAS等

期刊:IEEE Transactions on Robotics(IF 10.5 中科院一区,JCR Q1)

发表时间:2025年7月28日

链接:https://ieeexplore.ieee.org/document/11097366

引文格式:Carvalho J, Le A T, Kicki P, Koert D, Peters J. Motion planning diffusion: learning and adapting robot motion planning with diffusion models[J]. IEEE Transactions on Robotics, 2025, 41:4884-4901.

01 全文速览

机器人运动规划有一条很经典、也很“辛苦”的路线:

先用采样式规划器,比如 RRT-Connect,找到一条能走但不一定好看的路径;

再交给 CHOMP、TrajOpt、GPMP 这类优化方法,把它继续修平、修短、修得更可执行。

这条路线能用,但问题也很明显:

初始化强依赖经验

高维复杂场景下,采样慢

初始路径常常不够平滑

遇到窄通道,优化器很容易卡在局部极小值

这篇论文想解决的,正是这个老问题。作者提出了MPD,Motion Planning Diffusion。它的核心不是再做一个更快的 RRT,也不是再调一个更强的 CHOMP,而是换了一个思路:

既然我们已经解过很多类似的规划问题,那就让模型先学会这些轨迹的分布,再在新任务上边生成、边适应。

也就是说,MPD不再把轨迹初始化当成一个纯手工步骤,而是把它升级成一个可学习的先验分布。这个先验由扩散模型来学;而新场景下的碰撞约束、平滑需求、末端位姿目标等,则通过代价函数在去噪过程中持续引导。最终生成的,不是一条死板的轨迹,而是一批既贴近先验、又满足当前任务约束的候选轨迹。

🔥核心亮点

✅论文抓住了优化式运动规划最痛的地方:初始化。

CHOMP、TrajOpt、GPMP 这类方法并不是不好,而是太吃初值。MPD 的价值,就在于给这些方法之前那一步,提供了一个更聪明的轨迹先验。

✅它不是直接在稠密路点上学,而是转向了B-spline参数化。

这一步非常关键。因为 B-spline 控制点维度更低、天然平滑、还能高频插值,比直接在所有 waypoint 上建模更适合规划问题。

✅它把生成模型和优化目标真正接在了一起。

MPD 不是先采样一条轨迹再后处理,而是在扩散去噪过程中,利用代价梯度持续把样本往低代价区域推。这相当于一边“生成”,一边“规划”。

✅实验覆盖从2D到7自由度机械臂,还做了真人示教。

论文不仅在多个模拟环境中验证了方法,还在真实 Panda 机械臂抓取放置任务中,用人体拖动示教采集轨迹,再通过 MPD 适配训练时没出现的新障碍物。这个闭环很完整。

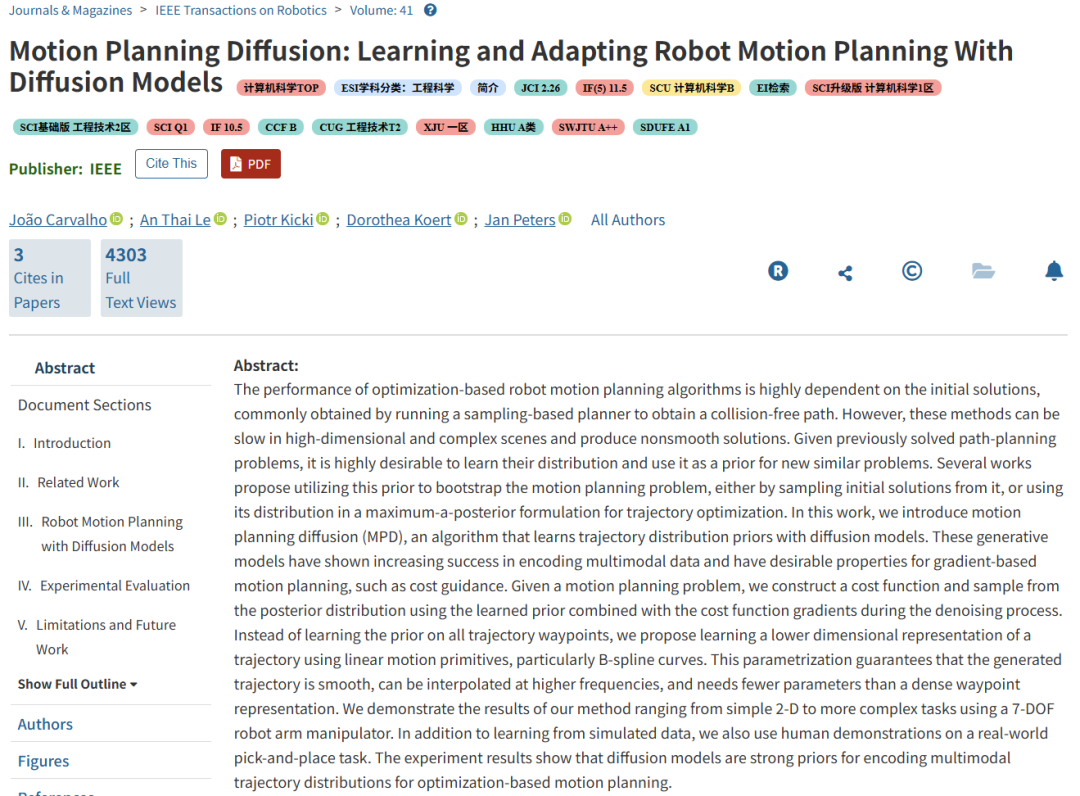

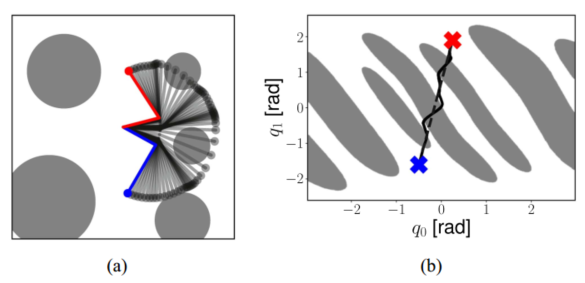

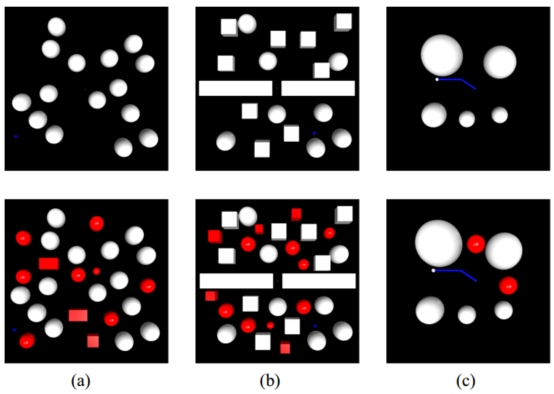

图1: 这些图说明了当机器人的配置空间中有狭窄通道时,对基于优化的运动规划方法使用良好初始化的需要。

如图1所示,传统优化式规划在窄通道下非常依赖初始化:直线初始化会把 CHOMP 困在局部极小值,而先用 RRT-Connect 找到无碰路径,再交给 CHOMP 平滑,结果就明显更好。这个例子其实就是整篇论文的出发点。

02 研究内容

🎯 2.1 这篇论文真正要解决的,不是“会不会规划”,而是“能不能学会规划的先验”

作者首先重新写了运动规划问题。

对于一个d自由度机器人,给定起点

*起终点约束

*零初末速度、加速度

*关节限位

*无碰撞

*同时尽量短、平滑、可执行

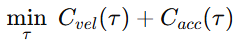

论文把它写成优化问题:

并结合起终点、关节约束和无碰撞条件进行求解。进一步,作者把硬约束松弛为代价项,得到更常见的形式:

这一步本身并不新,但接下来论文的关键转向在于:

与其把它只当作一个单次优化问题,不如把它写成规划即推断。

🧠 2.2 从轨迹优化到后验采样,MPD 的核心思路其实很清楚

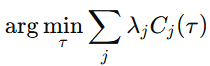

论文采用的是 planning-as-inference 视角。

目标不再只是找到一个最小代价轨迹,而是从一个后验分布中采样:

这里:

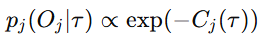

如果把代价写成似然的指数形式,就会得到:

于是原来的规划问题,就变成了:

从一个既符合历史经验,又满足当前场景约束的后验轨迹分布中采样。

这一步的意义很大。

因为它意味着,运动规划不再只是沿着代价面往下滑,而是有了一个数据驱动的经验偏好。这在多模态路径、窄通道、以及示教迁移任务里尤其重要。

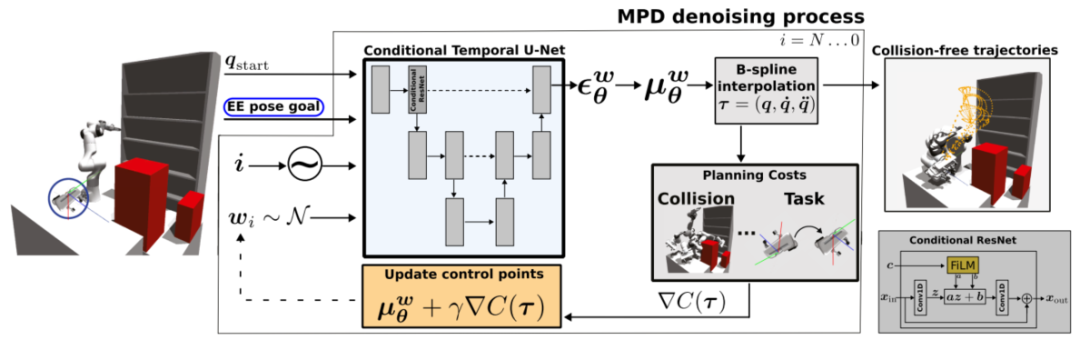

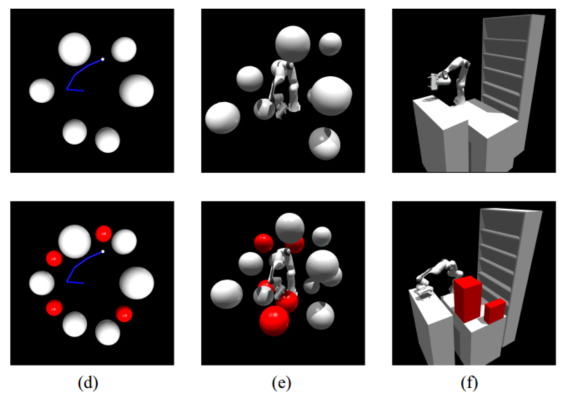

图2:使用MDP推理概述。

如图2所示,MPD 的推理流程非常清晰:起始关节位姿和目标末端位姿作为条件输入,扩散模型在去噪过程中不断输出 B-spline 控制点,并结合规划代价梯度,把样本逐步推向无碰、平滑且任务可达的轨迹区域。

🧩 2.3 扩散模型在这里不是“噱头”,它承担的是轨迹先验建模

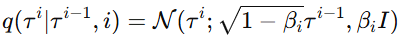

论文采用 DDPM/DDIM 框架来建模轨迹先验。

对于无条件扩散,前向过程就是不断加噪:

反向过程则学习从噪声中恢复轨迹分布。论文并不直接学习后验均值,而是学习噪声项 (epsilon_ heta),对应的均值写成:

训练目标是经典的噪声预测损失:

如果进一步加入上下文 c,比如起始关节角和目标末端位姿,就得到条件扩散模型

这就是为什么扩散模型适合这类问题。

因为机器人规划本来就是多模态的:同一个起点和终点,可能存在左绕、右绕、上绕、下绕等多种可行路径。论文在引言里就拿 2 连杆机器人举了这个例子。

🌿 2.4 这篇论文最漂亮的一步,是把轨迹表示从稠密 waypoints 换成了 B-spline

如果说 MPD 的“灵魂”是扩散模型,那么它的“骨架”就是 B-spline。

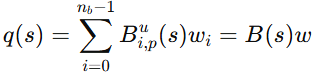

论文没有直接把轨迹表示成一串稠密路点,而是写成 B-spline 控制点的线性组合:

其中:

w_i是控制点

为什么这一点很重要?

因为在运动规划里,轨迹不仅要避障,还要平滑。若直接在 waypoint 上学习,局部点位一旦为了避障发生大幅修改,轨迹整体很容易变得锯齿化,还得额外引入平滑正则;而 B-spline 天然具有平滑性和局部性,修改局部控制点时,影响也更可控。论文明确指出,这能显著减少超参数调节负担,并降低去噪生成的维度。

边界条件也处理得很漂亮:

这样就能自然保证起终点以及边界速度、加速度约束。

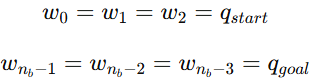

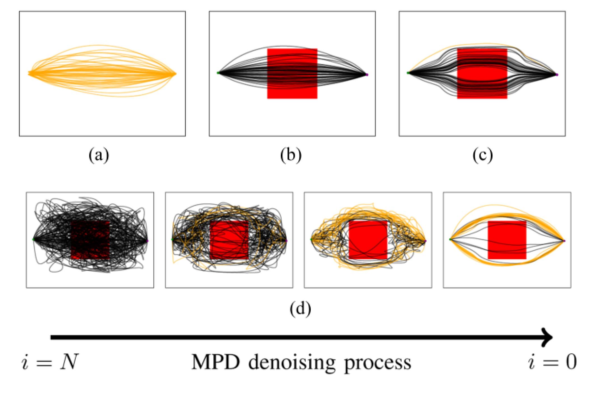

图3:使用线性相位时间缩放时产生的轨迹。

如图3所示,B-spline 控制点虽然数量远少于稠密轨迹点,但依然能够生成连续、平滑、可高频插值的轨迹,这也是 MPD 相比直接生成 waypoint 的关键优势之一。

⚙️ 2.5 MPD 不是先生成再修,而是在去噪过程中把代价梯度“揉进去”

这篇论文真正让人眼前一亮的,是它没有把生成和规划分开。

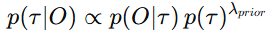

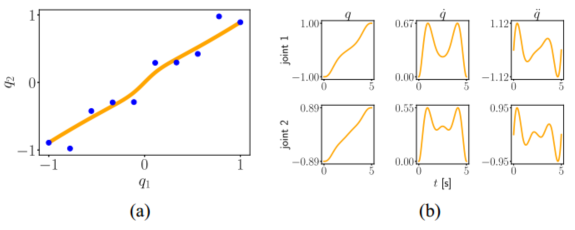

论文从后验采样出发,推导出在第 (i) 个去噪步,目标条件下的采样可以看成对先验均值进行代价梯度修正。关键思想可以概括为:

这意味着,去噪过程中每一步都可以利用当前轨迹的代价梯度,把样本往更低碰撞、更平滑、更满足任务目标的区域推。

换句话说,MPD 不只是“从数据里回忆一条老轨迹”,而是会在当前场景中边生成边适应。

论文还特别强调了一个问题:

为什么不能先从先验里采样,再单独做代价优化?

答案是,不够好。因为如果初始样本有很大一段已经深陷碰撞区域,后面再靠优化往外推,会非常困难。相反,MPD 在去噪过程中持续引入代价引导,更容易把整条轨迹保持在后验高概率区域内。

🧪 2.6 实验不是只做一个场景,而是把问题从简单一路推到真实机器人

论文实验设置相当完整。作者围绕五个问题展开验证:

Q1:MPD 能否学到高度多模态的无碰轨迹分布?

Q2:与其他生成模型相比如何?

Q3:去噪过程中的 cost guidance 是否必要?

Q4:B-spline 参数化到底带来了什么?

Q5:能否从人类示教中学习先验,并在测试时适配新障碍?

实验环境从易到难依次包括:

2D 点机器人简单障碍环境

2D 稠密窄通道环境

2 连杆平面机器人

4 连杆平面机器人

7 自由度 Panda 机械臂球体障碍环境

Panda 机械臂仓储货架环境

这些任务有一个共同特点:

训练时给定一批无碰路径;

测试时则会在环境中加入训练时没有的新障碍物,考察模型到底是真的学会了“轨迹分布 + 适应机制”,还是只是在背训练数据。

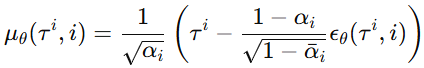

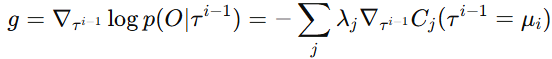

图4:用于运动规划实验的环境,具有不同的机器人模型和不断增加的复杂性。在二维任务中,机器人用蓝色表示(作为RobotPointMass2D的点)。最下面一行显示了带有额外障碍(红色)的任务,这些障碍在培训中不存在。

如图4所示,论文构建了从 2D 到 7 自由度机械臂、从简单障碍到仓储场景的一系列测试环境,并且专门在下方红色障碍中展示了测试阶段新增物体,这对验证模型的适应能力非常关键。

视频1:EnvWarehouse-RobotPanda任务中的轨迹生成过程(模拟环境)这个视频展示了 MPD 在仓储场景中的轨迹生成过程。与传统先规划、后修正的方式不同,MPD 是在扩散去噪过程中不断结合任务代价进行引导,使生成的候选轨迹逐步贴近无碰、平滑且可执行的解。从这个动态过程可以更直观地看到,MPD 并不是简单复现训练轨迹,而是在当前环境约束下持续完成适配。视频2:EnvWarehouse-RobotPanda任务中的轨迹生成过程(真实机器人)如果说模拟视频说明了 MPD 能够在复杂场景中生成轨迹,那么这个真实机器人视频说明的,是这套方法不仅能在仿真里成立,也能够落到真实机械臂平台上执行。对机器人规划方法来说,这一步很关键。因为很多生成式方法在模拟中看起来很漂亮,但真正到了实体机器人上,往往会暴露出轨迹不稳定、执行不顺滑或者适配能力不足的问题。这个视频恰恰补上了方法落地层面的说服力。

📊 2.7 这篇论文最有说服力的地方,在于它把几个关键对比都做透了

首先是 Q3,也就是最重要的一个对比:

只从扩散先验采样,再做代价优化,和MPD在去噪过程中持续引导,到底差在哪?

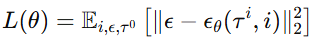

图5 :使用MPD进行采样的好处,而不是首先从先验中进行采样,然后优化成本函数。

视频3:EnvWarehouse-RobotPanda任务中的动觉教学人体演示这个视频展示了论文中一个非常有意思的细节:轨迹先验并不完全来自传统规划器,而是部分来自真实的人体动觉教学。也就是说,研究者直接拖动 Panda 机械臂完成抓取与放置,让系统记录这些人类示教轨迹,再由模型学习其中隐含的运动偏好与操作风格。这样的数据来源,使 MPD 学到的先验不只是“几何上可行”,还更接近真实人类会采用的运动方式。

当前者遇到新加入的红色障碍物时,很多轨迹仍然无法有效绕开;而 MPD 通过在后验中逐步采样,能够得到更多无碰、更多样、同时又更贴近原先演示分布的轨迹。

其次是 Q4,对 B-spline 的分析。论文指出,B-spline 版本最直接的收益就是平滑性更强、表示维度更低、推理更快。Fig. 12 则从平滑度分布上进一步证明,在加入额外障碍物的所有任务上,B-spline 表示生成的轨迹整体更平滑。

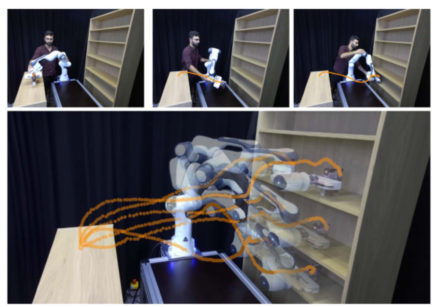

最后是 Q5,也就是最有现实味道的一组实验。作者没有继续使用采样规划器生成“专家轨迹”,而是让人通过 kinesthetic teaching 拖动 Panda 机械臂做抓取放置示教,采集约 100 条演示轨迹,再通过噪声扩充到约 4k 条。测试时,在场景里额外加入谷物盒、茶盒等训练时没有的物体。结果显示:单纯diffusion prior会撞上新障碍,而MPD借助碰撞代价引导后,能够在保持接近人类示教风格的同时绕开障碍并到达目标位姿。这一步很能说明方法的实际价值。

视频4:仅依赖扩散先验时,轨迹会与新障碍物发生碰撞

这个视频对应的是论文中非常关键的一组对比。它说明,仅仅学到一组看起来合理的轨迹先验,并不等于机器人已经具备了对新场景的适应能力。当测试环境中出现训练阶段没有见过的新障碍物时,单纯依赖扩散先验生成的轨迹,仍然可能沿着原有偏好直接穿过去,最终发生碰撞。这个结果很重要,因为它明确说明了:只会生成还不够,真正有价值的是生成过程中能否持续结合当前环境进行修正。视频5:MPD生成的轨迹依然贴近先验,但能够主动绕开新障碍与视频4形成鲜明对比,这段视频展示了 MPD 真正的价值所在。它并不是完全抛弃原先学到的轨迹先验,而是在保留原有运动风格和分布特征的基础上,借助碰撞代价引导,在去噪生成过程中主动绕开测试阶段新增的障碍物。换句话说,MPD 的优势不只是能生成一条新轨迹,而是能在保持先验一致性和适应环境变化之间取得平衡。这一点,正是论文标题中 learning and adapting 的核心。

如图5所示,MPD 的优势并不只是“能生成轨迹”,而是能在去噪过程中持续把样本往后验高概率区域推,因此比“先采样再优化”更容易得到多样且无碰的结果。

图6:(上图)在EnvWarehouse-RobotPanda环境中,通过动觉教学为拾取和放置任务进行人类演示。末端执行器的轨迹用橙色表示。(下)几个演示的叠加。机器人配置显示在演示的最后。

如图6所示,作者进一步把 MPD 用到了真人拖动示教的抓取放置任务中。训练数据并未包含测试时桌面上的新障碍物,因此单纯依赖 diffusion prior 会撞上障碍;而加入碰撞代价引导后,MPD 能生成既贴近人类示教风格、又能绕障的轨迹。

03 创新点

① 把机器人运动规划中的“轨迹先验”真正做成了可生成、可适配的分布模型

过去很多工作也会谈先验,但常见做法要么是 k-NN 检索历史轨迹,要么是 ProMP、GP 这类更偏单峰的模型。

MPD 的推进在于:它用扩散模型去学习多模态轨迹分布,并把这种分布直接用于新规划问题的后验采样。这使它天然更适合处理存在多条可行路径的机器人规划任务。

② 不是在 dense waypoints 上暴力生成,而是切到了更符合控制与规划需求的 B-spline 表示

这一点非常值得控制领域读者注意。

因为 B-spline 不只是降维工具,它直接改变了轨迹表示的“物理气质”:

平滑性天然更好

局部修改更稳定

高阶导数更容易处理

更适合把速度、加速度和约束统一进规划代价中

③ 把代价引导嵌进扩散去噪过程,而不是生成结束后再补救

这是 MPD 和很多生成式规划思路最本质的区别。

论文不是先“想出一条轨迹”再“修正一下”,而是在每一步反向扩散里都利用代价梯度做引导。这样得到的不是一个脱离任务目标的生成结果,而是一个生成与优化同步发生的过程。

④ 把方法从模拟专家轨迹一路推到了真人示教与真实机械臂场景

很多方法在模拟环境里成立,并不等于能迁移到现实。

这篇论文至少走完了很关键的一步:

从人类示教学习轨迹先验,再在测试时适配未见过的新障碍。

这一点说明 MPD 不只是仿真上的漂亮方法,而是开始触碰真实机器人任务里的“可迁移规划”问题了。

04 总结与展望

这篇论文最值得机器人与控制领域关注的,不只是它用了扩散模型,而是它切中的问题非常准确:

机器人运动规划,真正缺的往往不是一个更强的局部优化器,而是一个更聪明的轨迹先验。

MPD 做的,就是把这个先验从经验启发式,推进到可学习、可采样、可适应的新阶段。它不再满足于先用采样式方法给优化器喂一条“差不多能走”的路径,而是希望模型自己学会什么样的轨迹更像“好轨迹”,再在新场景中根据碰撞、平滑、任务末端位姿等要求,把这些轨迹改到能真正执行。

从控制视角看,这篇工作的价值在于它并没有脱离轨迹优化的基本逻辑,而是把数据驱动先验和任务代价通过后验采样严密地接了起来;从机器人应用视角看,它又给出了从 2D 到机械臂,再到真人示教抓取放置的完整验证链条。这让它既有方法上的新意,也有工程上的说服力。

如果把这篇论文放到更大的脉络里看,它释放出的一个信号也很清楚:

未来的机器人运动规划,可能不再只是搜索和优化两件事,而会越来越多地变成生成、推断与控制约束的融合问题。

未来研究将聚焦于以下几个方向:

🔭1.从固定时长轨迹走向最优时间轨迹

论文当前采用固定轨迹时长 (T) 的设定,并明确说明最小时间轨迹优化留待未来研究。这意味着 MPD 目前更偏向几何-动力学可行性与平滑性,而非真正的时间最优。后续如果能把时间缩放也纳入生成与引导过程,方法会更完整。

🧱2.从静态场景适配走向更复杂环境建模

当前方法对新障碍物的适应主要依赖可微代价和环境 SDF。未来若要进一步进入动态障碍、时变场景乃至更强感知不确定性问题,环境表征与引导机制都需要继续增强。这里是基于论文当前 SDF 代价建模框架做出的合理延伸。

🌐3.从单任务条件生成走向更强泛化的条件扩散规划

论文已经支持以起始关节角和末端位姿作为条件输入,这比只给定关节目标更自然。但如果未来要适配更复杂任务,诸如语言目标、场景图、视觉编码甚至任务序列,都可能成为新的条件变量。这个方向和机器人通用规划的发展非常一致。这里属于基于论文现有条件建模方式做出的合理延伸判断。

🤝4.从示教先验走向更自然的人机协同规划

论文在真人示教抓取放置任务上的结果非常亮眼,它说明 MPD 适合做一种“带人类偏好的规划器”。未来继续往前走,很可能会进入人类示教风格保持、任务偏好编码、交互式再规划这些更贴近人机协同的问题。

声明:本文仅供学术交流,版权归原作者所有。如有错误或侵权,请联系更正或删除,欢迎留言探讨。