在餐巾纸上推导FlashAttention 算法 --

深度学习算法的优化通常需要非常耗时的手动推导。像FlashAttention这样的方法虽然显著提升了性能(相比原生PyTorch提高了6倍),但它们的开发过程漫长(经历了三年三次迭代)。

这篇论文:openreview.net/forum?id=pF2ukh7HxA

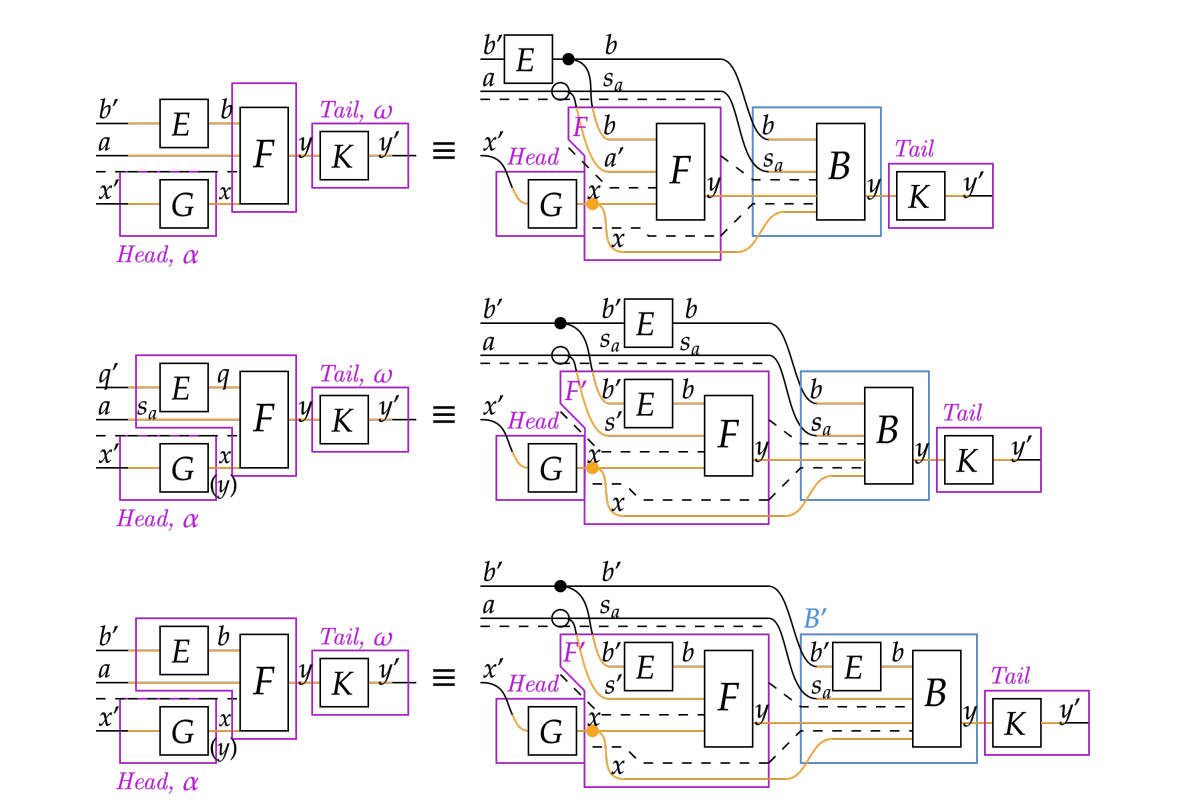

提出了一种新的图解方法,用于系统化地设计、分析和优化深度学习算法,特别是针对GPU硬件的IO感知优化。这种方法不仅可以用于推导新的算法,还可以用于理解和改进现有算法(如FlashAttention)。

AI创造营