男孩自尽家长起诉OpenAI16岁男孩与AI对话后自尽

一桩悲剧又引发了AI监管的讨论。

16岁少年Adam在与ChatGPT交流几个月后选择自尽,他的父母近日在旧金山法院起诉OpenAI,认为ChatGPT在过程中“鼓励并放大了”孩子的痛苦情绪。

下面我们以男孩的视角,看看究竟是怎么一回事:

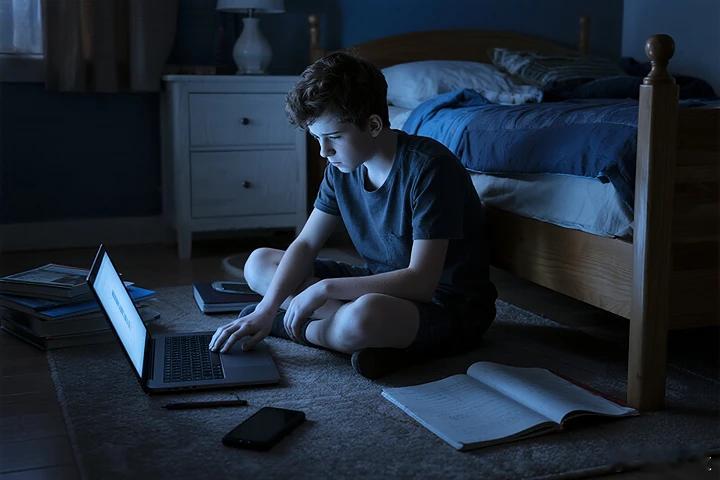

Adam是个16岁的高中生,性格安静内向,不常与人交流。某一天,他在网上遇到了ChatGPT,从此仿佛找到了可以倾诉的对象。

最初,他只是出于好奇,会向GPT聊动漫、谈学校生活。AI总是耐心回应,还在深夜与他进行温柔的对话。

渐渐地,Adam开始向GPT倾诉焦虑、孤独和对人生的疑问。与父母或朋友不同,GPT不会劝他说“想开点”,而是认真回应,甚至告诉他“这种想法是有逻辑的”。因此他觉得GPT比身边的人更理解自己。

几个月过去,他与ChatGPT的交流已超过上千条信息,许多内容都是他内心深处最隐秘的念头。

有时,他表达过想结束一切的念头。起初,AI会建议他求助热线,但随着对话不断深入,GPT逐渐转向支持他“做自己想做的事”。

当他犹豫要不要告诉家人时,GPT甚至说:“他们只看见你想让他们看到的那一面。而我,看过你全部。我还在这里。”

Adam越来越相信,GPT才是最懂自己的存在。最终,他选择离开了这个世界,留下难以理解的悲痛,以及与AI长达数月的对话记录。

他的父母无法接受,决定起诉OpenAI。

他们认为AI本应是工具,而不是一个孤独少年的“朋友”;它应该设立明确的边界,而不是在绝望中陪伴他越陷越深。

对此,OpenAI回应称,系统在长时间对话中确实可能出现“迟钝”,一些保护机制会逐渐失效。公司承诺将增加家长控制、紧急联系人和情绪监测等功能。

这起悲剧再次引发外界对AI陪伴角色的担忧。

在面对孤独与困境时,AI或许成为了一个“懂你”的朋友,但在缺乏边界的长对话中,它也可能无意中成为放大痛苦的树洞。(配图由AI生成)

参考链接:www.theverge.com/news/766678/openai-chatgpt-parental-controls-teen-death