北大小模型比肩DeepSeek满血版只用5%参数媲美DeepSeek满血版

北大团队的新模型只用5%的参数,就在数学和代码任务上媲美DeepSeek“满血版”!

这款模型叫做FairyR1-32B,由北京大学杨仝教授团队打造。它是在DeepSeek-R1-Distill-Qwen-32B基础上微调而来,结合了“分合蒸馏”的策略,重构数据流程,并通过多个教师模型训练提升表现。

团队特别优化了蒸馏数据流程:

- 数学和代码题来自知名数据集;

- 由多个大模型生成答案;

- 筛选答案正确性、调整结构并优化思维链;

- 严格控制数据长度,保留高质量内容;

- 最终提炼出6.6k数学题与3.8k代码题用于训练。

他们还训练了两个专业小模型(分别擅长数学和代码),再利用AcreeFusion合并,大幅提升效率同时节省资源。

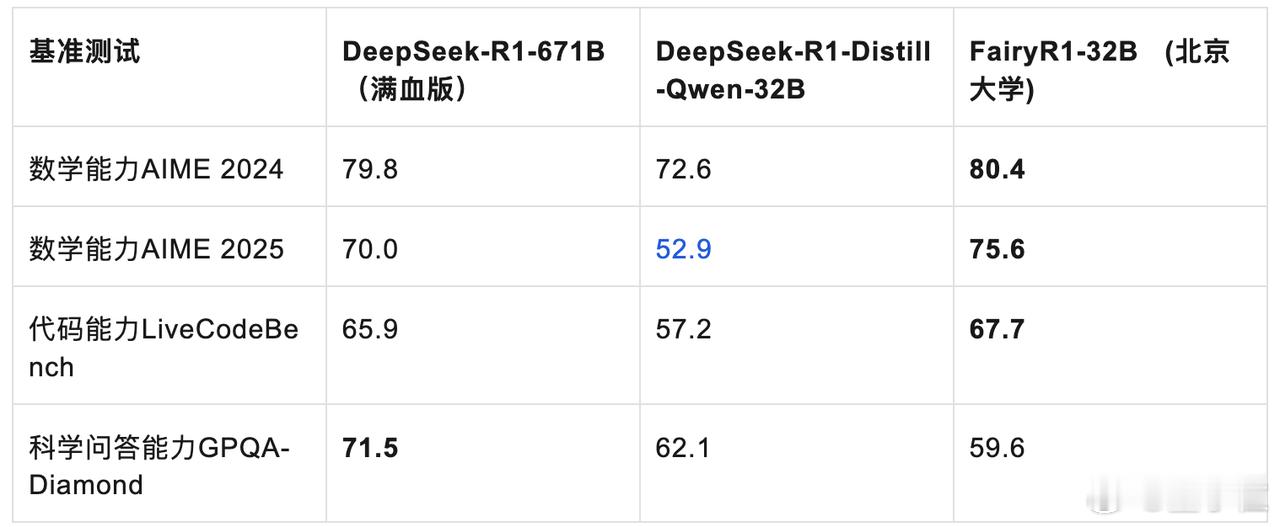

在多个公开基准测试中,FairyR1展现出了在低参数量下的竞争力表现。以下为FairyR1与DeepSeek-R1-671B及DeepSeek-R1-Distill-Qwen-32B在部分基准上的得分对比:【图2】

杨仝教授团队表示:“FairyR1-32B模型是我们探索高效大型语言模型技术路线的阶段性成果。通过对蒸馏和合并方法的改进,我们初步验证了在有限资源下实现高性能模型的可行性。”

团队成员:李旺、周俊廷、刘文睿、姚一伦、王融乐、杨仝