田柯宇如果没有破坏字节的大数据模型训练,很可能会成为一个人工智能领域的新星

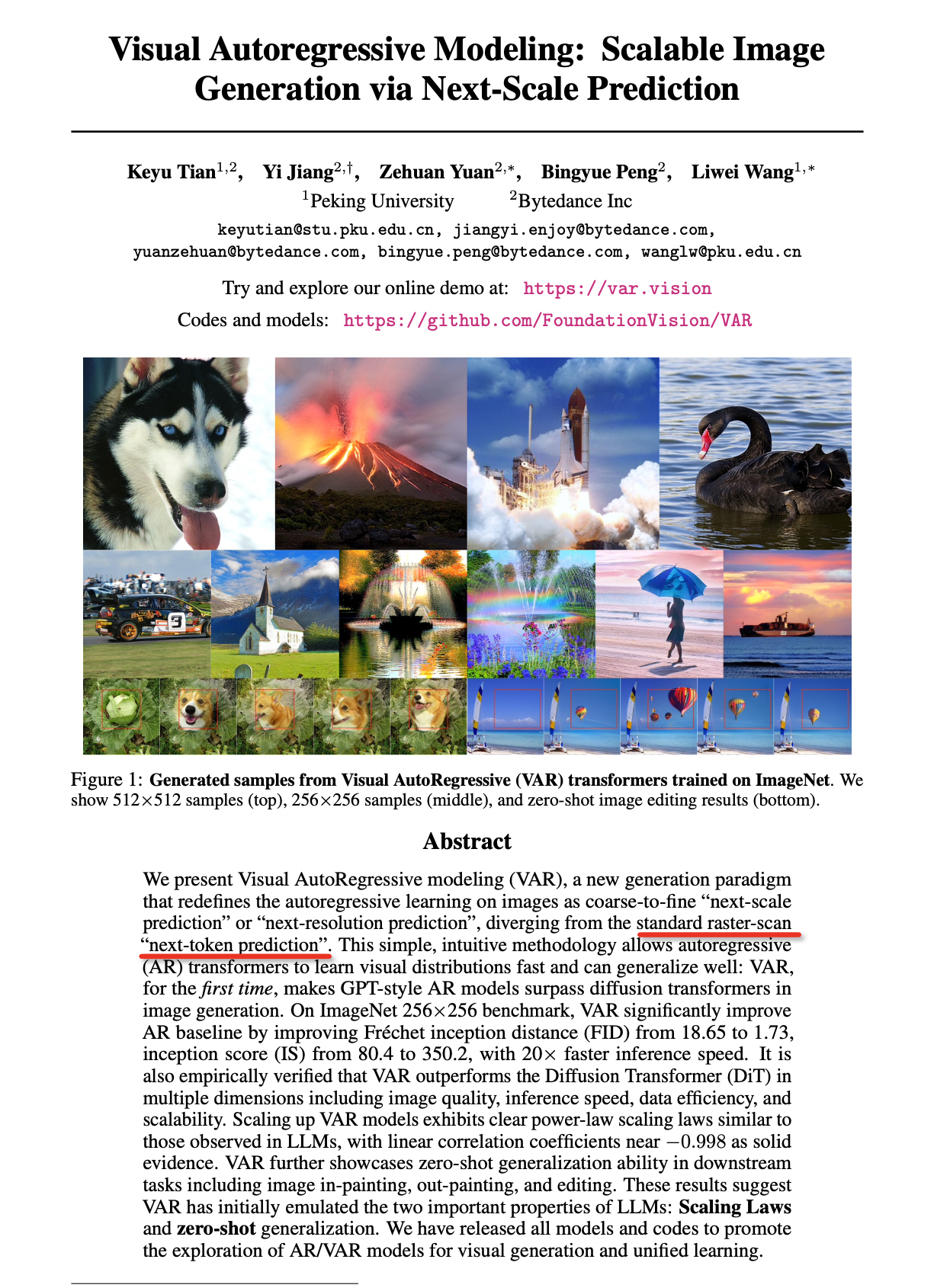

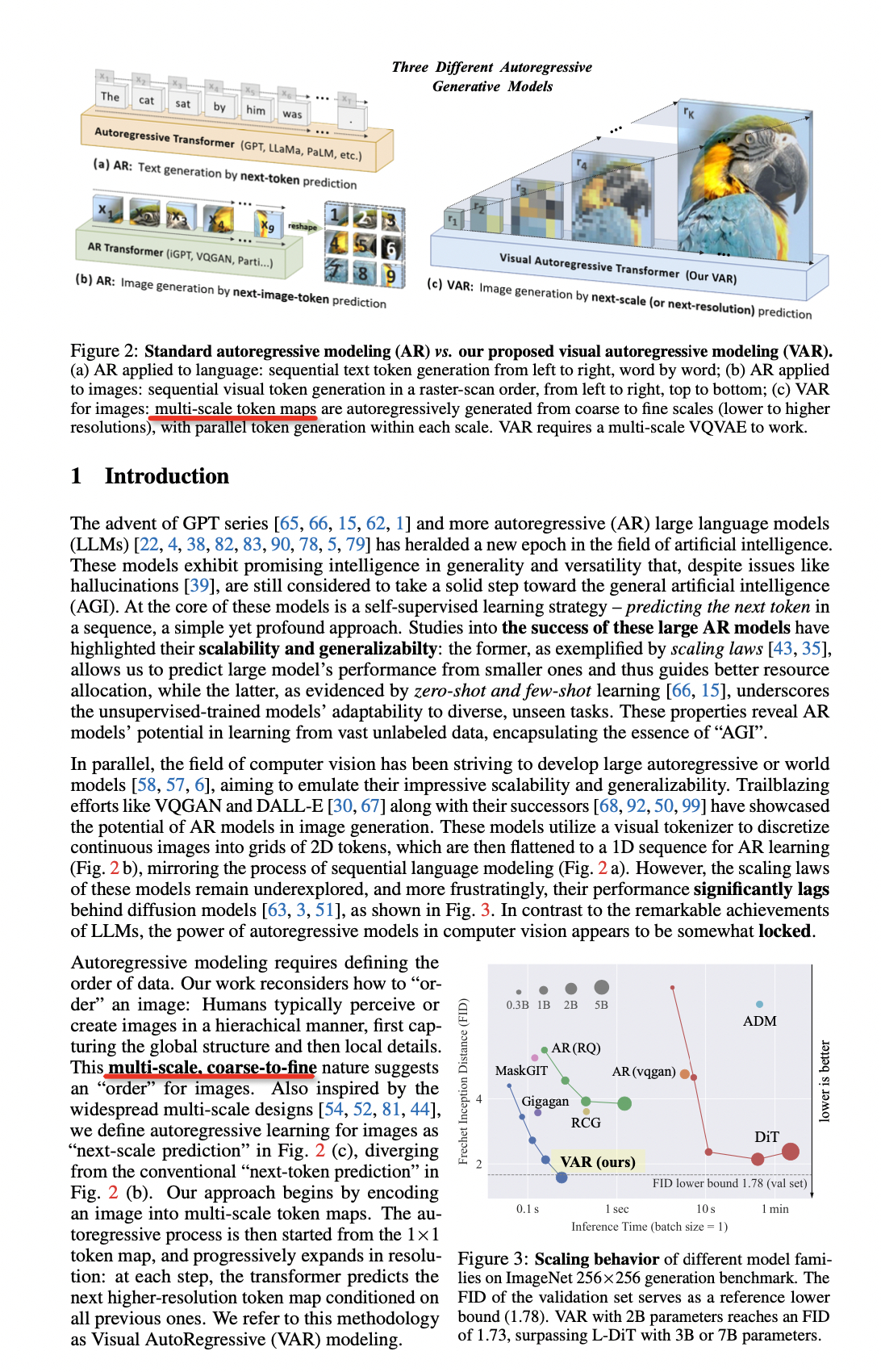

他的一作论文 Visual Autoregressive Modeling: Scalable Image Generation via Next Scale Prediction 获得了 NeurIPS 2024 最佳论文

看了一下,思路的确很不错,使用多层极的图像token外加光栅扫描预测

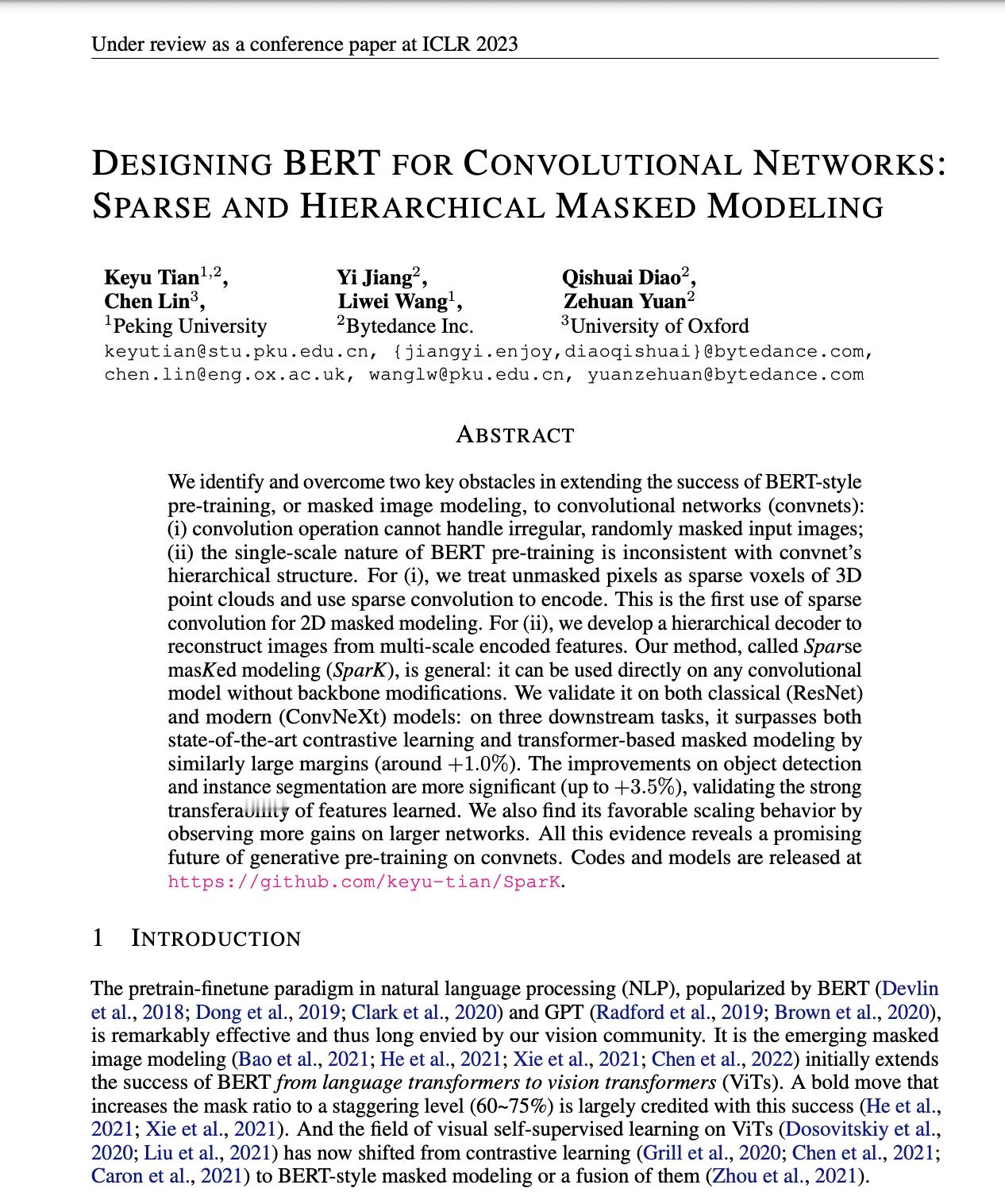

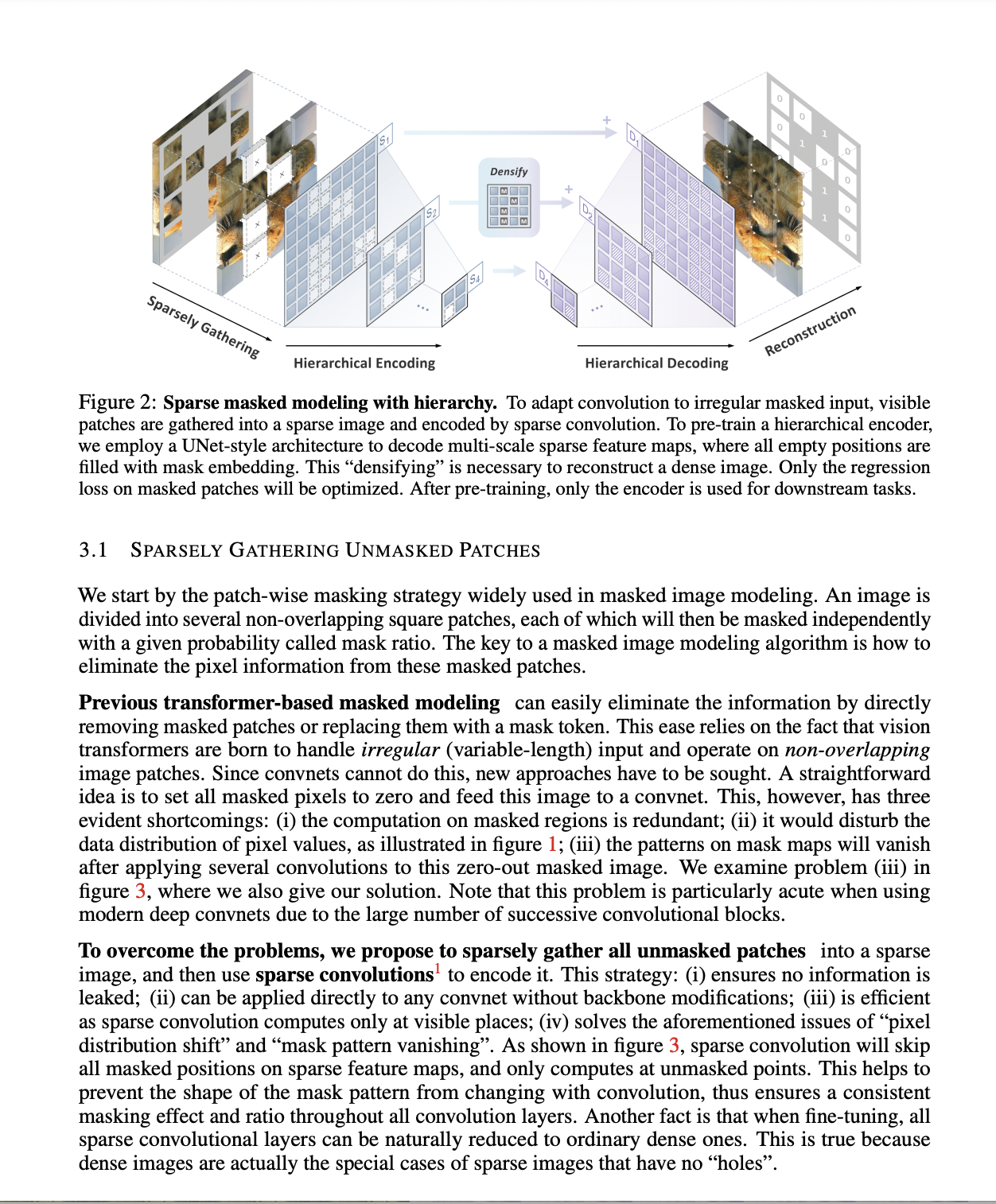

他去年的一篇论文 Designing BERT for Convolutional Networks: Sparse and Hierarchical Masked Modeling 其实也不错,利用了图像信息的稀疏特性和层级特性

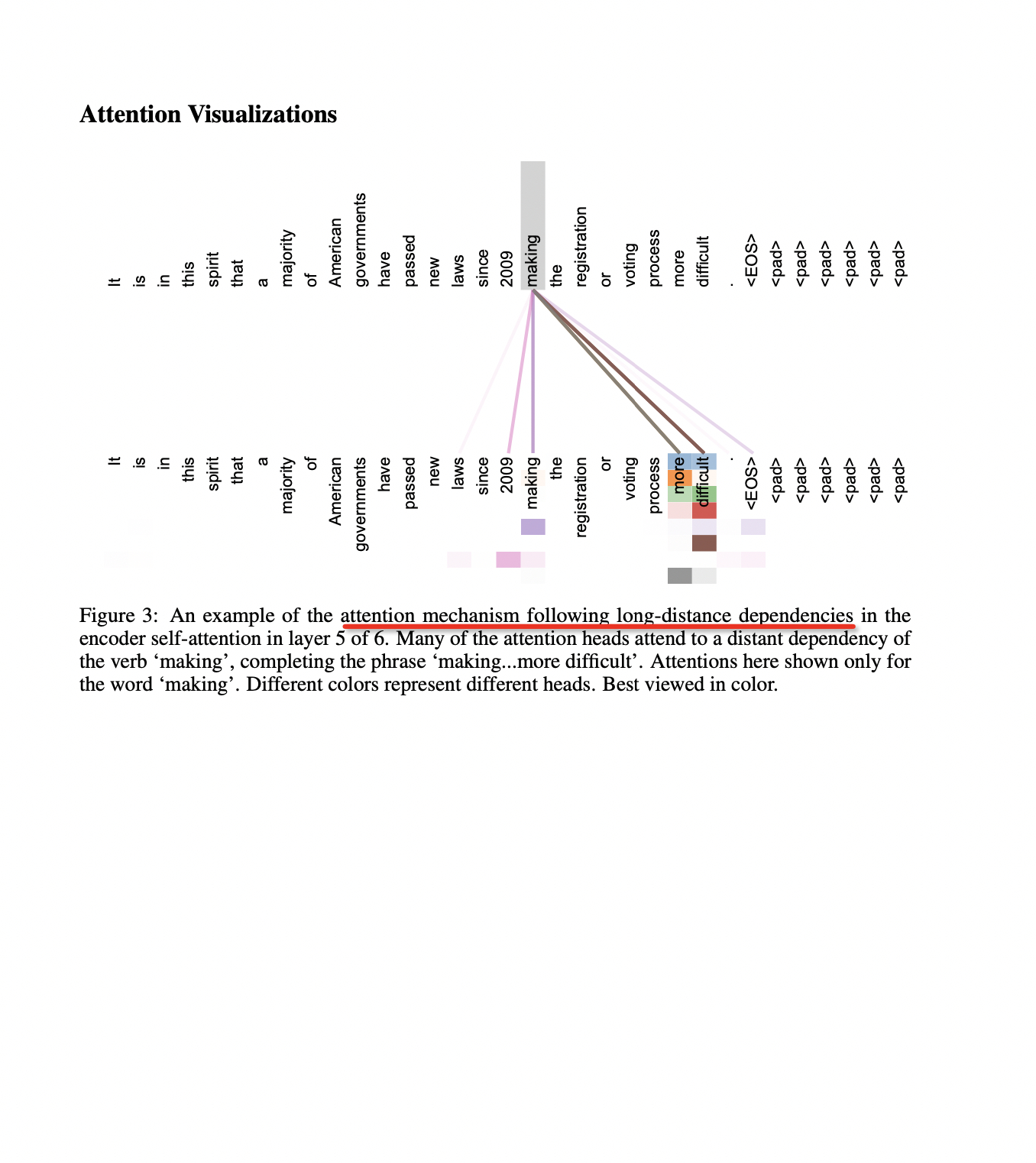

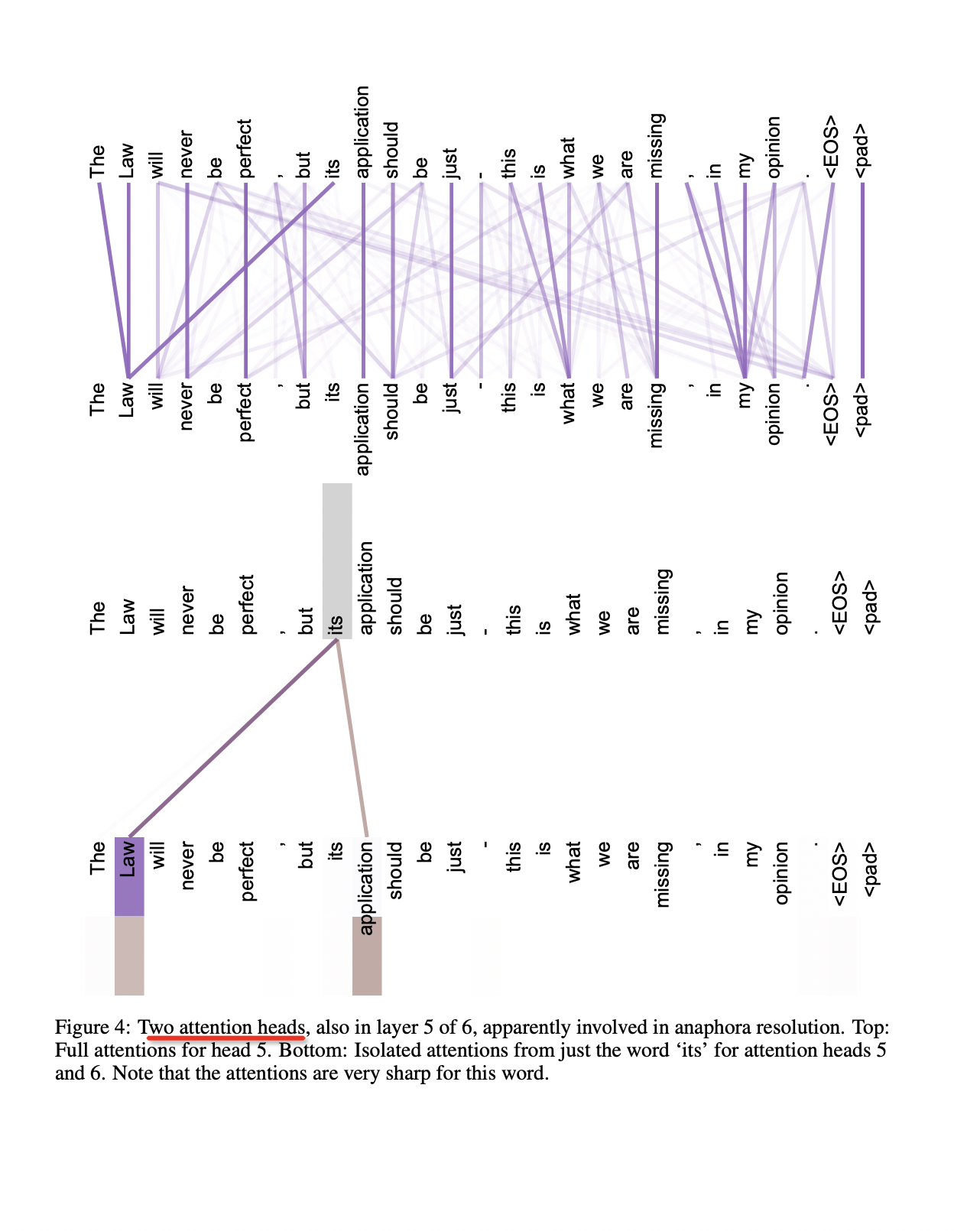

再看一下 2017年 Google Brain 的 Attention is all you need 采用的是 Attention 机制提升了预测准确度

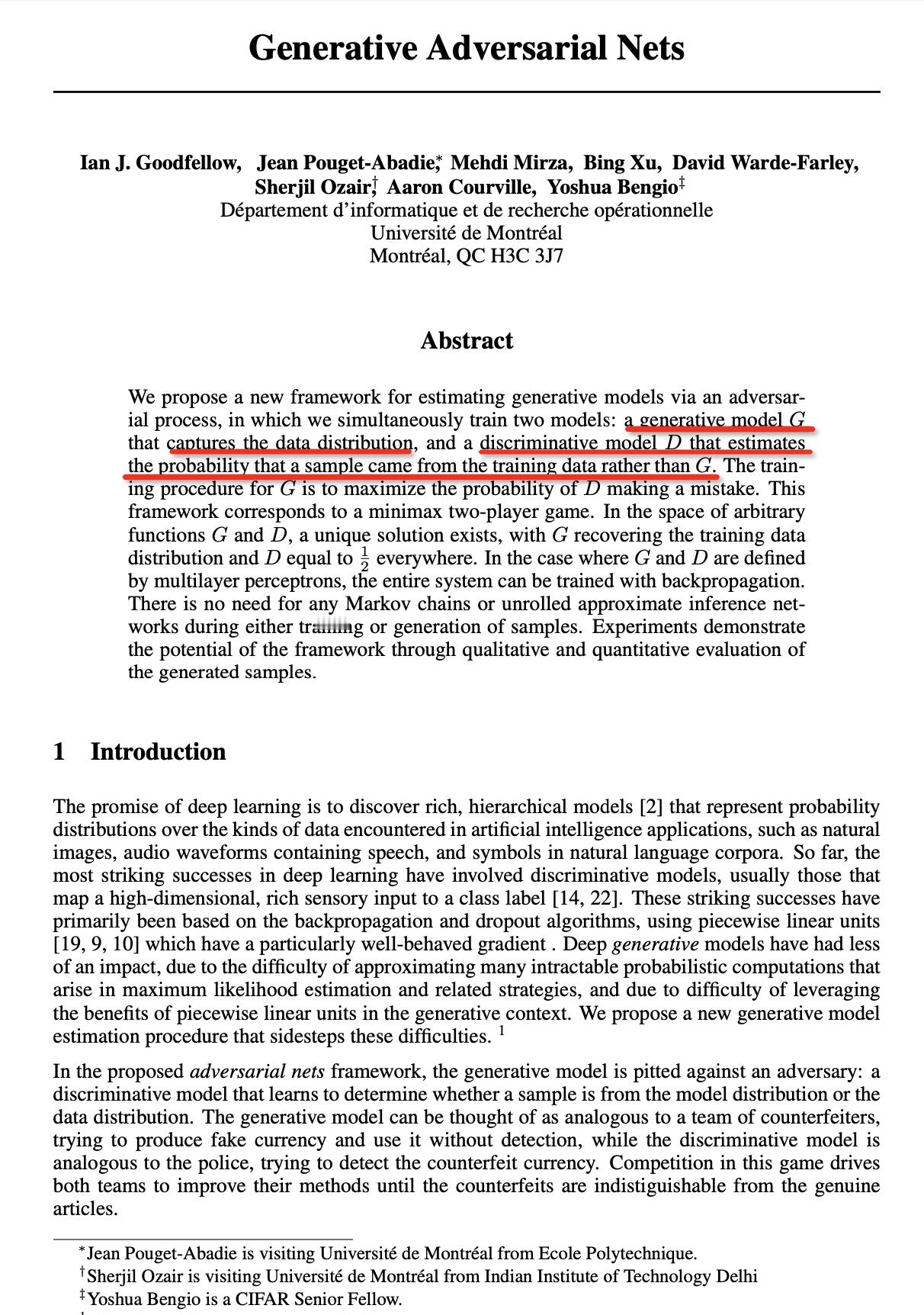

在往前看,2014年 Ian Goodfellow 的 Generative Adversarial Nets, 采用一个生成模型,一个判别模型,两个模型进行对抗训练提升模型的预测准确度

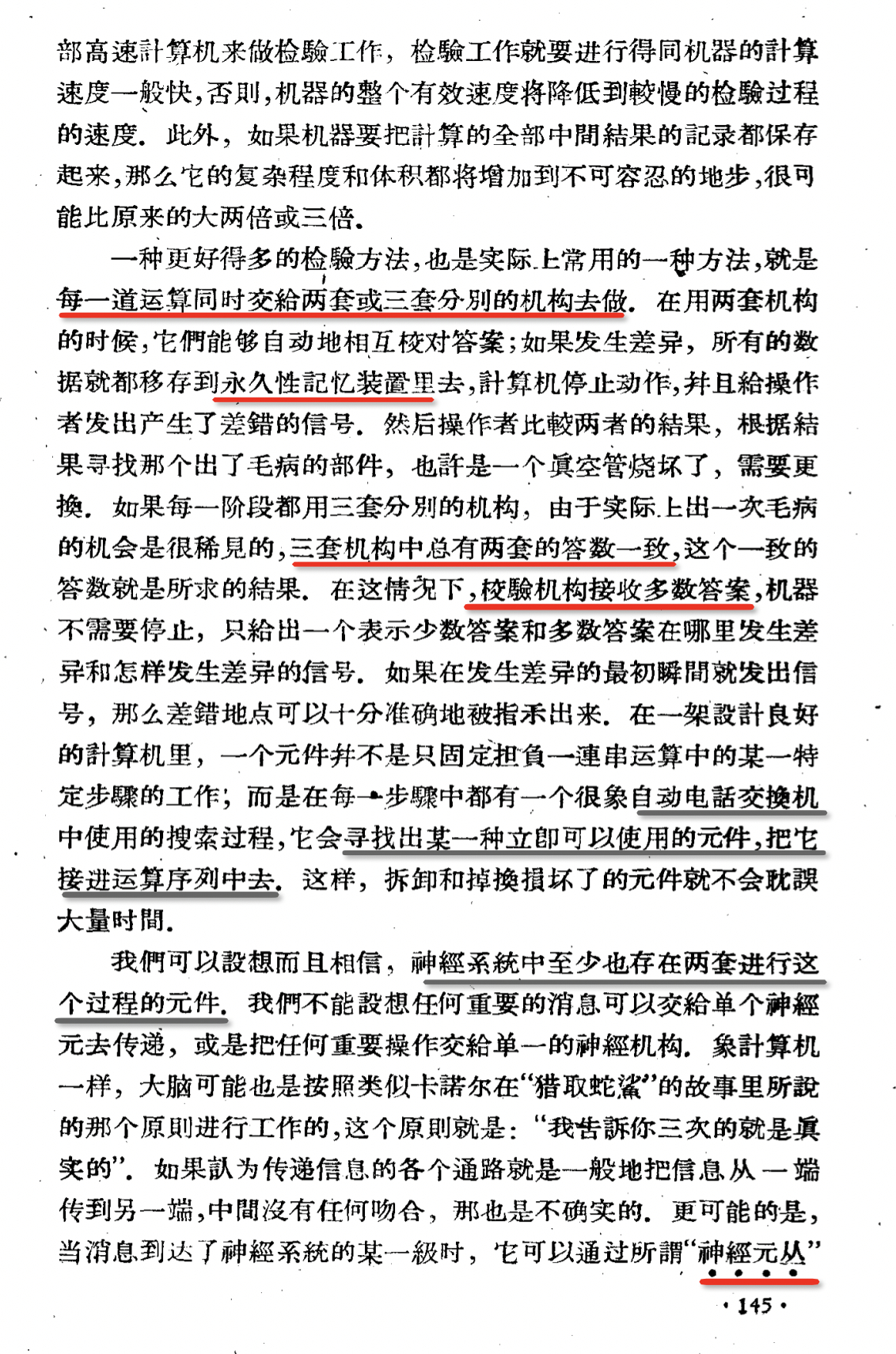

关于信息的稀疏性,视觉的光栅扫描其实之前我们已经指出,在维纳的控制论中都已经提到了,而就连对抗这种方式,在控制论中也有提及,原文是用于解决计算机计算错误自动校验的,把同一个运算交给两个或者三个机构分别进行计算,然后比较它们的差异

另外,实际可以看出,这些计算理论其实的确都是基于对人的视觉和语言感知特征所开发的,而这些的确也属于心理学领域,其实在1980之前的著作中已经有很多著作论述了,但人们真的就像失忆了一样,忽然在近些年重新发现了这些

你问我为什么,我之前已经回答过了,现在只是又多了一个案例罢了

所以现在重要的是,其实要深刻理解智能原理才行,计算和算法这些实际上是在对智能原理基础研究之上的应用了

.