霍金预言成真?临终前曾发出警告:”人工智能比第三次世界大战还要可怕!全面发展人工智能,最终会毁了人类!“对此,曾仕强先生也曾说了一句令人细思极恐的话:”科技越发展,越需要重视《易经》!“

霍金真正让人警醒的地方,并不是简单说“AI一定毁灭人类”,而是提醒人类,如果一种智能系统未来拥有自我学习、自我迭代,并且在速度和规模上远远超过人的控制能力,那么它可能成为人类文明无法轻易关停的风险源。换句话说,问题不在于技术本身会不会“作恶”,而在于人类有没有能力给技术装上刹车,有没有制度、伦理和价值观去约束它。

这也是为什么马斯克多次警告人工智能风险,甚至把它与核武器相提并论。核武器的危险很直观,爆炸、毁灭、辐射,人们看得见,也怕得明白;人工智能的危险却更隐蔽,它可能藏在推荐算法里,藏在虚假信息里,藏在自动化裁员里,也藏在少数平台对数据和算力的高度垄断里。今天一个人被算法左右购物选择,明天一个行业被模型重塑岗位结构,后天一个社会的信息判断能力被真假难辨的内容持续冲击,这种变化不是一声巨响,而是一点点渗透。

因此,标题中曾仕强先生那句“科技越发展,越需要重视《易经》!”并不是一句故弄玄虚的话。曾仕强先生是台湾省学者,他长期讲中华传统文化,尤其强调《易经》里关于变化、平衡、节制和守正的思想。把这句话放到人工智能时代来看,它真正有价值的地方,不是让古书替代科学,而是提醒人类在追求技术进步时,不能只问“能做到什么”,还必须问“该做到哪里”。

人工智能发展到今天,最容易让人忽略的恰恰是“边界”二字。企业希望模型更强,资本希望增长更快,用户希望工具更方便,国家之间也会关注技术竞争和产业安全,这些需求叠加在一起,AI就很容易被推向一路狂奔。可任何事物走到极端,都会产生反噬,《易经》讲“亢龙有悔”,它提醒的正是盛极而衰、过度则损的规律。技术越强,越不能失去节制;工具越方便,越不能让人放弃思考;效率越高,越不能把人的尊严和饭碗当成可以随手替换的成本。

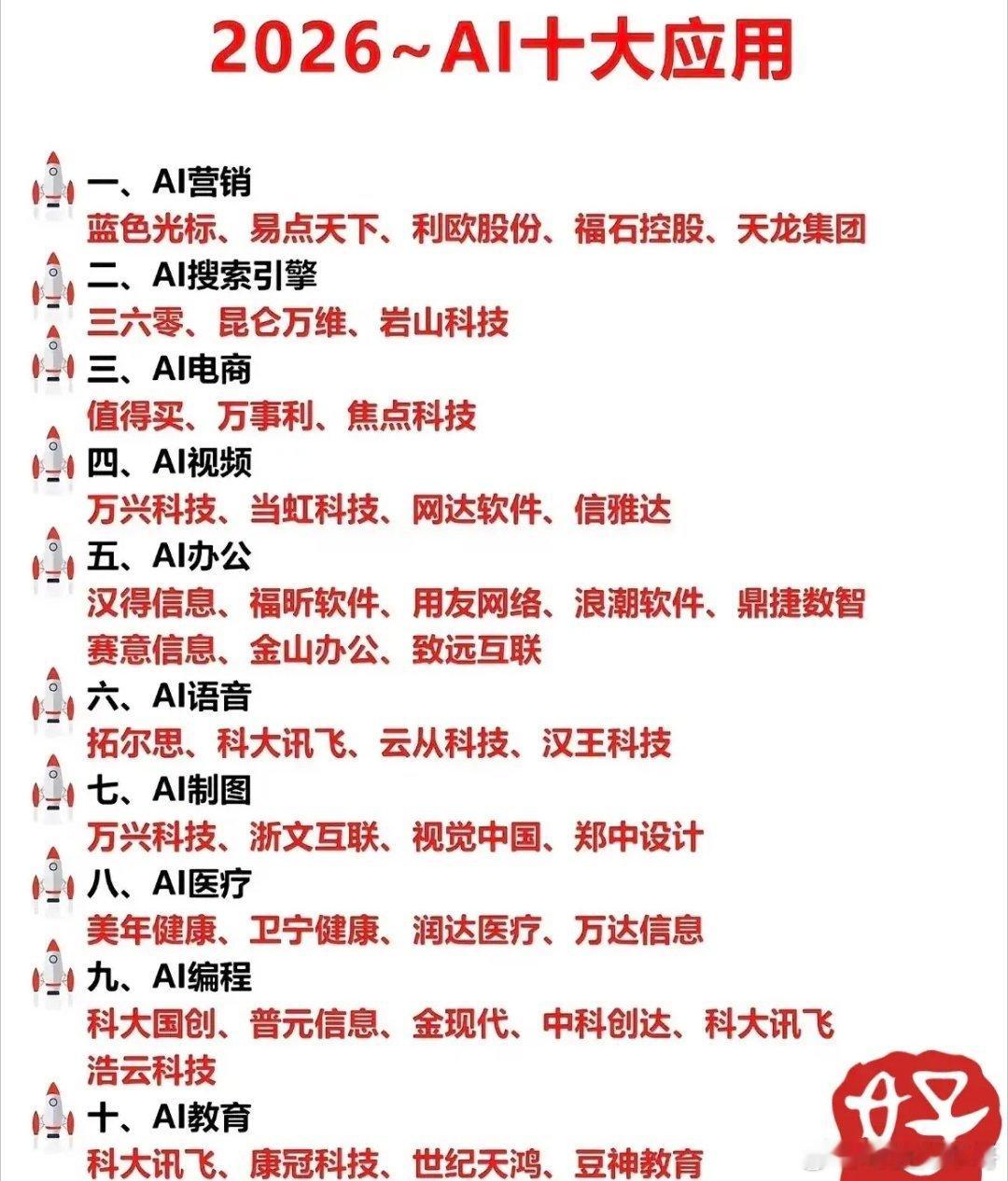

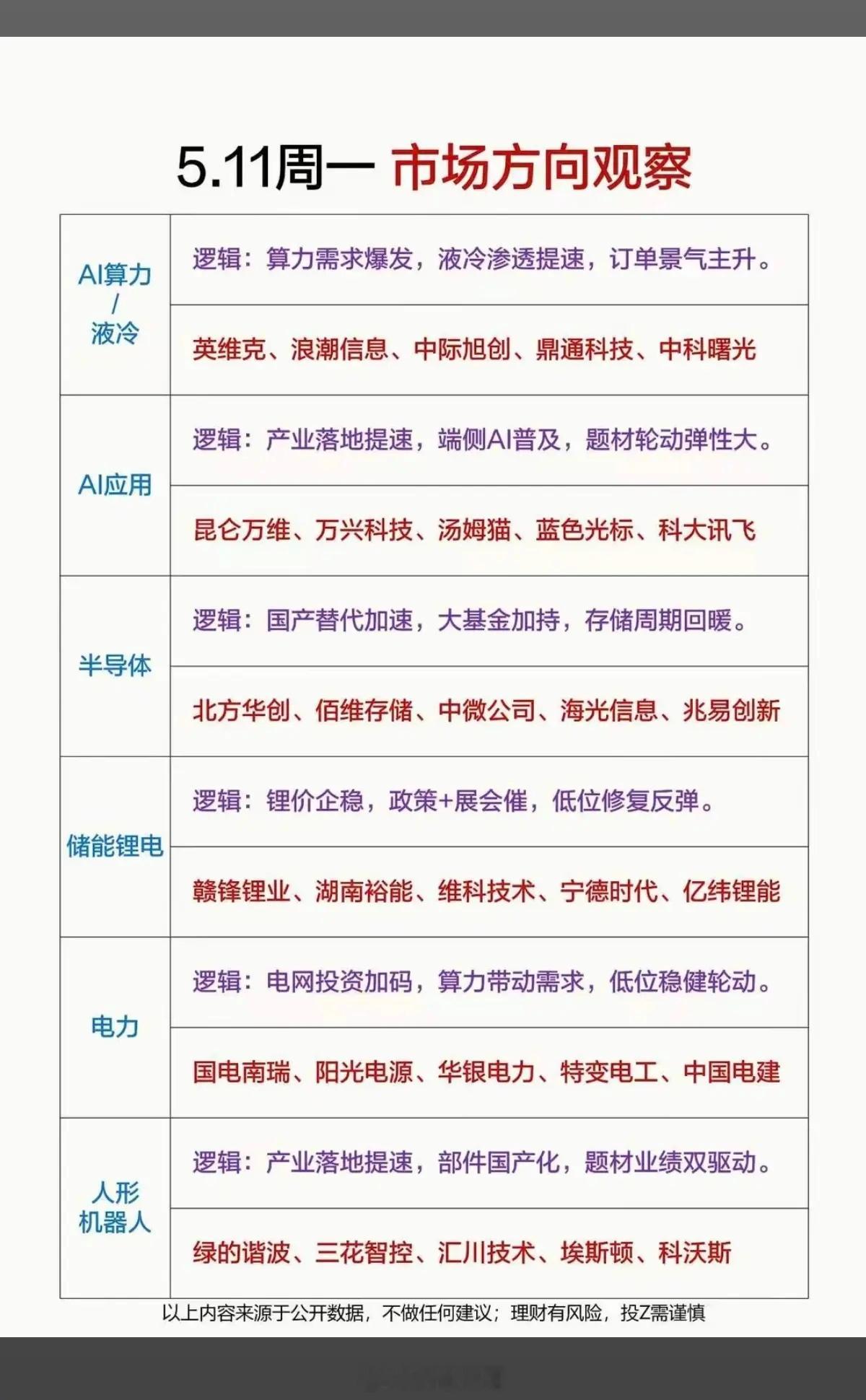

这几年,AI带来的岗位焦虑已经非常明显。过去大家觉得机器替代的是重复体力劳动,后来才发现,文案、翻译、绘图、客服、数据整理、基础编程这些脑力岗位也会被冲击。对普通人来说,最现实的问题不是“机器人会不会统治世界”,而是明天自己的工作会不会变得不值钱,自己的经验会不会突然被一个软件压低价格。这种感受很具体,也很扎心,因为技术进步如果只让少数人赚到红利,却让大量劳动者承担代价,那么所谓智能化就会变成新的社会裂缝。

人工智能不是洪水猛兽,不能因为担心风险就否定它的价值。它可以帮助医生提高诊断效率,可以帮助科研人员筛选药物分子,可以让教育资源覆盖更多地区,也能在制造业、农业、交通管理中减少浪费。真正需要警惕的,是把“全面发展人工智能”理解成不顾后果地放任扩张。没有透明规则的AI,不可靠;没有责任主体的AI,不可取;没有人文底线的AI,即便再先进,也未必是进步。

《易经》给现代人的启发,恰恰在于它不迷信单向度的强大,而是强调阴阳调和、进退有度。人工智能时代也一样,发展和监管不能互相撕裂,效率和公平不能彼此牺牲,创新和安全不能只顾一头。一个成熟社会对AI的态度,既不是盲目崇拜,也不是粗暴拒绝,而是让它服务于人,让它接受人的规则,让它在法律、伦理和公共利益的框架里运行。

霍金的警告最值得重视的地方,不是“人工智能会不会像电影里那样毁灭人类”,而是它逼着我们承认一个现实,人类越能创造强大的工具,越需要强大的自我约束。曾仕强先生讲《易经》,本质上讲的是人要懂规律、知进退、守良心。AI时代最稀缺的东西,未必是算力,而是判断力;未必是模型参数,而是责任感。普通人不必害怕每一次技术更新,但必须保留学习能力和独立思考能力,因为未来真正能立住的人,不是比机器更像机器的人,而是更懂人性、更懂价值、更能承担责任的人。