FSD 模型是如何训练的?大 AI 教小 AI。

虽然我们无法了解具体的架构细节(也看不懂),但 Elon Musk 还是带到了一点基本路线。

简单来讲,特斯拉目前和接下来会越来越多的以云端的世界模型为仿真器,以车端的 FSD 模型为驾驶 Agent,一个 AI 在另一个 AI 的脑海里玩游戏,游戏任务是驾驶汽车从 a 点到 b 点,游戏激励是驾驶全程中确保安全、舒适、高效。

这件事的源头是 GoogleDeepMind CEO Demis Hassabis 在他们内部访谈中分享的,DeepMind 在用他们的世界模型 Genie 3 训练他们玩游戏的 Agent SIMA。

整个训练过程就是 Genie 3 不断生成新的游戏画面,而 SIMA 在生成的画面里玩游戏,这种情况下 SIMA 的训练数据几乎是无限的。

Elon 评论说,我们在 xAI 和特斯拉也在用同样的方法。xAI 的视频模型要 11 月才发布,这里先不展开。那特斯拉是否已经在这样做了?从技术上看,是很有可能的。

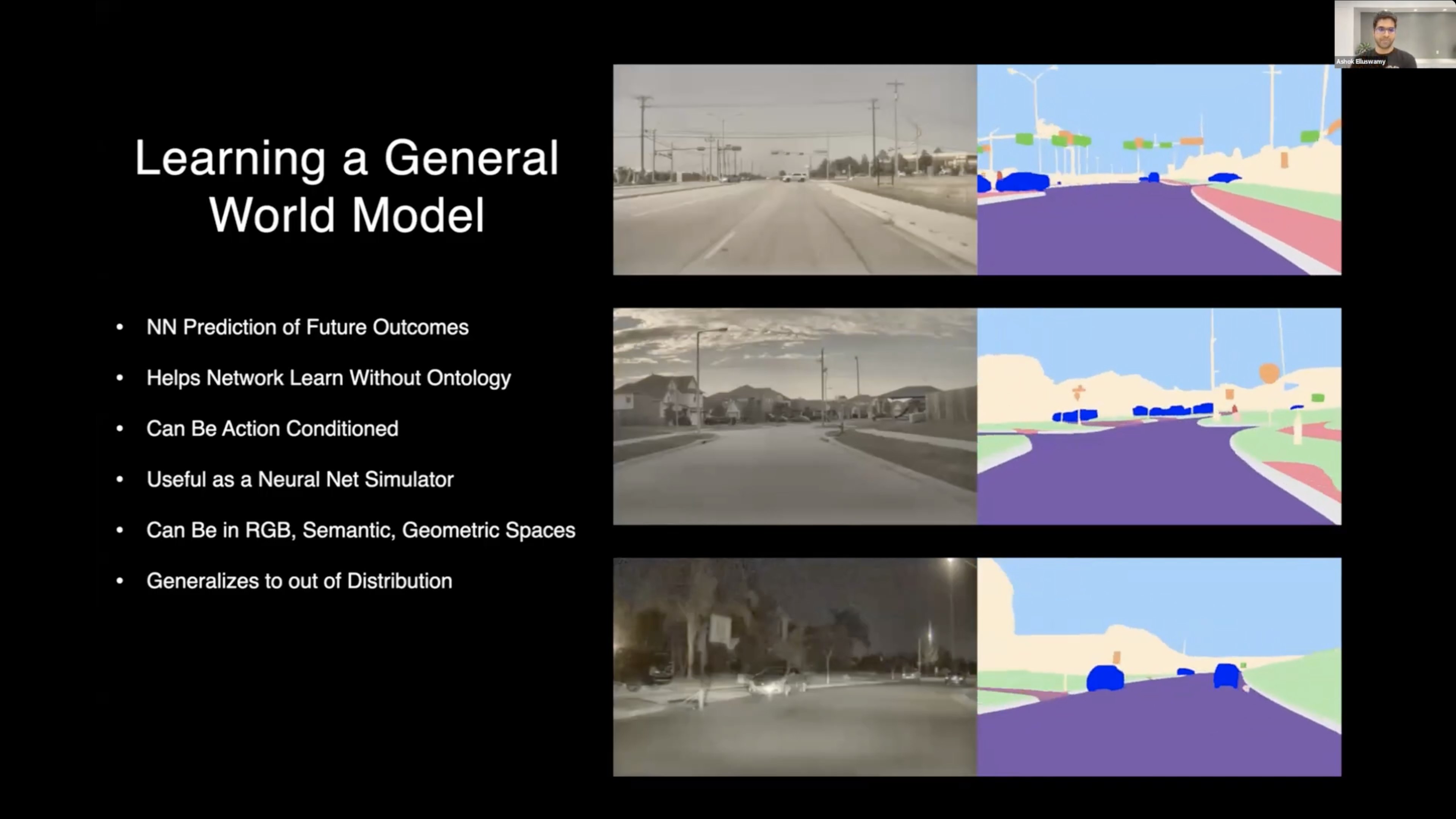

特斯拉在 2023 年的 CVPR 上由如今的 FSD 老大 Ashok 分享了他们的世界模型,彼时的特斯拉世界模型已经带有一定的传感器仿真能力,也有了对场景的语义推理和理解能力,还有 8 个摄像头的画面联合预测,确保物体的跨视角一致性。

而在重组 Dojo 团队,推动 Dojo 3 和 FSD AI5/AI6 芯片合并的过程中 Elon 又说,未来绝大多数的训练实际上是为了训练而进行的推理,也就是生成合成数据。

也就是说,接下来 FSD 模型,比如 FSD v14 的训练过程很可能是大量依赖特斯拉世界模型不断生成的场景里去跑,而不是大量依赖采集自量产车队的数据去训练的。

模型的训练算力需求大降(FSD 模型训练的实质是世界模型在进行推理),也从根本上摧毁了 Dojo 继续存续的前提。

顺便说一句,这种「基于强大基础模型生成的合成数据训练新的模型」的策略在 LLM 领域也很普遍,比如 GPT-5 发布后 OpenAI 研究科学家 Rapha Gontijo Lopes 就发了这么一条:GPT-5 证明了合成数据持续奏效,OpenAI 拥有全球最强的合成数据团队。

这可能是辅助驾驶转向自动驾驶的过程中,接下来的一个技术趋势。

总结:

1. FSD 的训练过程逐步转变为以「世界模型生成数据集,数据集训练 FSD 模型」为主。

2. 从算力消耗的分布上看,采集车队的数据训练世界模型消耗的训练算力逐渐走低,运行世界模型生成新的数据集的推理算力逐渐走高。我们需要更多的「推理集群」,而不是「训练集群」。