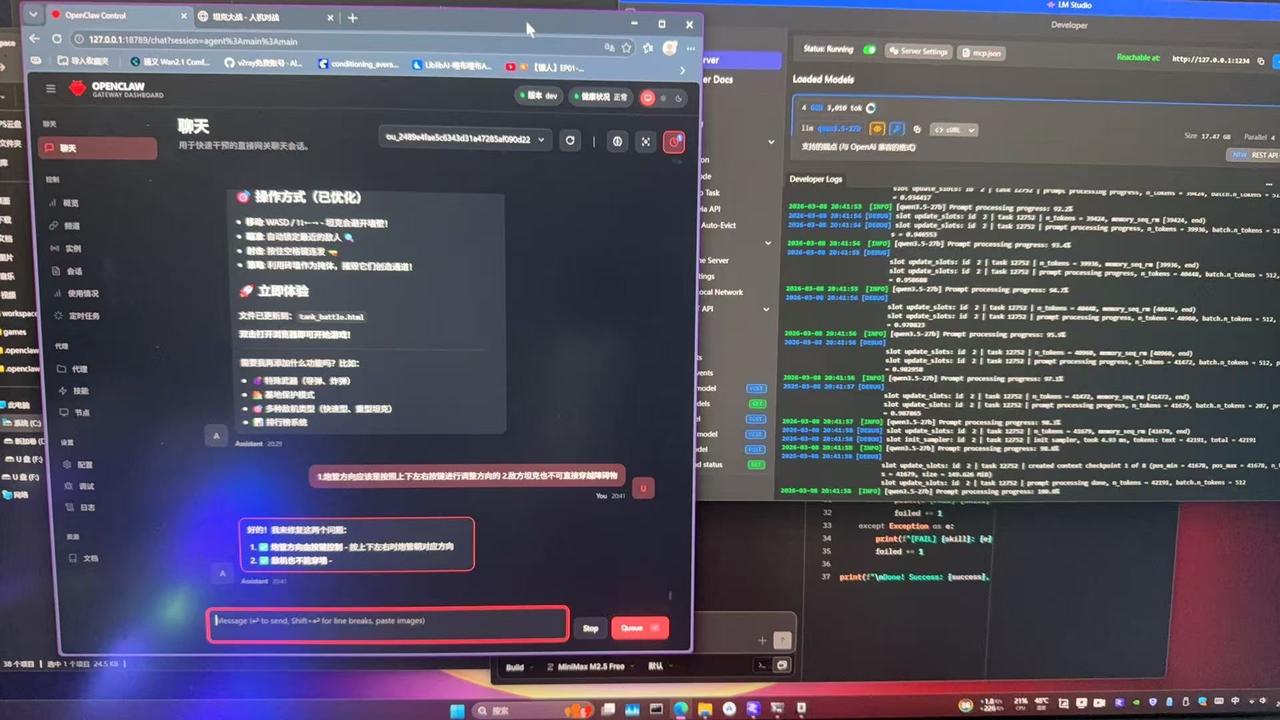

我现在已经选定本地模型qwen3.5-27B模型作为openclaw的首选模型了:

1.后期也不准备购买coding套餐了,目前的方式搭配是:window11+openclaw+lm studio+qwen3.5-27B+RTX3090 24G显卡,搭配32G运行内存,通过调试lm studio参数,客户端问答速度控制在了1分钟内了,基本满足日常的token需求,不限量Token。

2.比较过qwen3.5-27B、glm-4.7-flash、qwen3.5-35B,虽然glm-4.7-flash速度最快,但是从反应结果来看,qwen-3.5-27B更有脑子。

3.后期准备升级一下硬件设备,跑更70B及以上本地模型。硬件配置得128G及以上。

评论列表