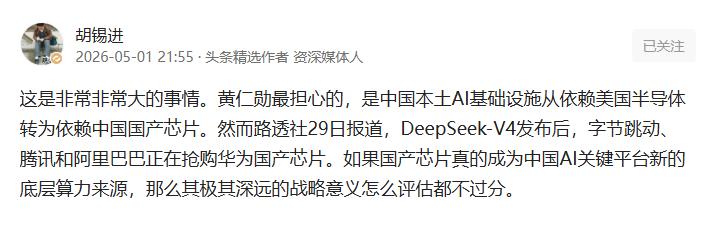

看到老胡最近发的一段评论,他说黄仁勋最担心的事情,就是中国本土AI基础设施从依赖美国半导体转为依赖中国国产芯片,这是一件非常大的事情。

读完这段话,我最直接的感受是,商业世界的底层逻辑永远是最诚实的。这根本不是单纯的情怀问题,而是赤裸裸的生存账本。

到了2026年,整个AI产业已经从前几年的大规模预训练,全面进入到了高频次的推理落地阶段。算力消耗呈现指数级暴涨,如果国内科技企业继续硬着头皮去买昂贵的海外芯片,利润表根本扛不住。这种巨大的成本压力,究竟是如何逼迫大厂们集体转向的?

我们看路透社上个月底发布的数据,自从DeepSeek-V4发布之后,字节跳动、腾讯、阿里这些头部企业,已经开始大规模采购华为的国产芯片。

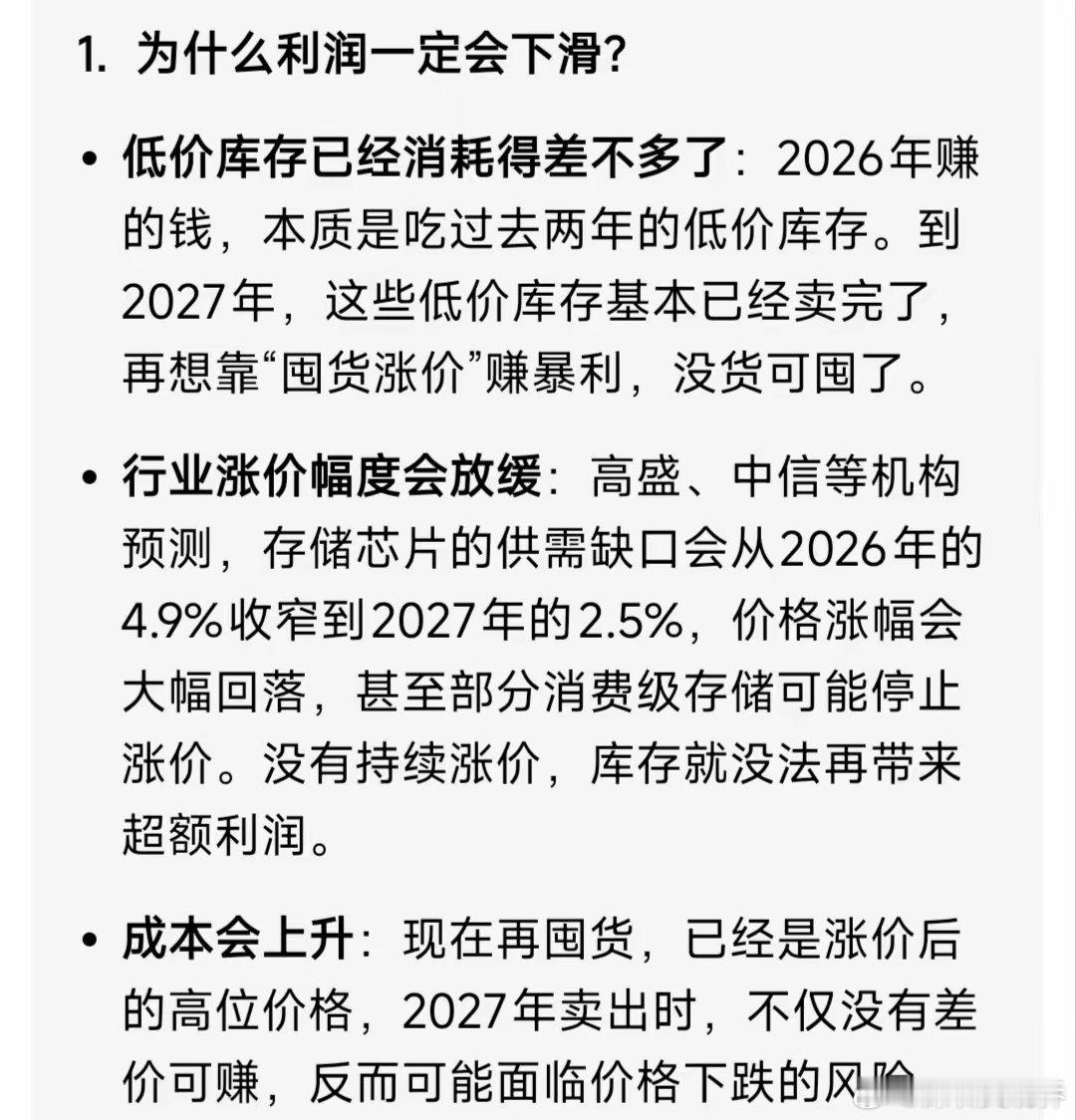

英伟达之前为了保住市场份额,弄出了特供版芯片H20,算力被大幅度限制,价格却一点没降。根据中国新闻网的数据,华为昇腾新款芯片的采购价只有英伟达的四分之一,但单卡算力比H20高出2.87倍。

建一个大型智算中心,硬件采购成本占到总投资的六成以上。企业高管只要把计算器敲一敲,就知道该选谁。花更少的钱办更多的事,转向国产芯片是必然结果。

硬件底座的切换只是表面现象,真正让海外巨头感到恐慌的,是建立在这个底座之上的应用成本断崖式下跌。

算力成本最终会直接反映在大模型的API定价上。DeepSeek方面之前坦承,美国在模型基础能力上依然领先3到6个月。但在商业化落地的价格层面,双方已经完全不在一个世界了。

澎湃新闻的数据显示,DeepSeek-V4-Pro的API输入价格已经打到了0.25元/百万词元。反观海外,GPT-5.5 Pro的加权平均输入价高达30美元/百万词元,哪怕是旧一点的GPT-5.4,输入也要1.50美元,输出9.00美元。

Claude Opus和Gemini 3.1 Pro的定价同样高高在上。几百倍的价格差,意味着国内开发者可以用极低的成本去试错,去开发各种垂直行业的企业级应用,而海外中小企业光是跑通一个智能体工作流就要承担巨额费用。

这种价格优势的背后,隐藏着一套庞大且隐秘的产业协同网络。

高盛在最新的研报中提到,今年下半年华为昇腾950将实现大规模供货,大模型的推理成本还会继续往下降。这里面有一个很多人没注意到的增量信息,那就是能源和软件生态的深度绑定。

AI是众所周知的电老虎,国内依托西部地区的风光电资源和特高压输电网络,给智算中心提供了极其稳定且低廉的工业用电。

同时,过去业界认为英伟达的软件生态壁垒坚不可摧,但随着国内底层异构计算架构的成熟,通义千问、智谱清言、百川智能、字节豆包等主流大模型,已经能够无缝迁移到国产硬件上。

算力芯片国产化,叠加底层能源成本优势和软件生态的打通,让国内AI企业掌握了绝对的定价权。当这三大要素汇聚在一起时,整个行业的运转规则就已经被重写了。

回到老胡的观点,黄仁勋的担忧确实切中了要害。中国本土AI基础设施的转型,本质上是生态主导权的全面转移。当底层的算力芯片、中间的大模型算法、上层的电力供应全部实现本土化闭环,一套完全独立于英伟达体系的AI基础设施就已经成型。

这套体系成本极低,随着海量用户的涌入,数据飞轮会转得越来越快,进一步摊薄整体研发成本。全球AI产业的底层逻辑,正在因为这套本土化算力生态的稳固而被彻底颠覆。